参考博客:https://blog.csdn.net/ZJRN1027/article/details/80199248

1、计算cost的过程

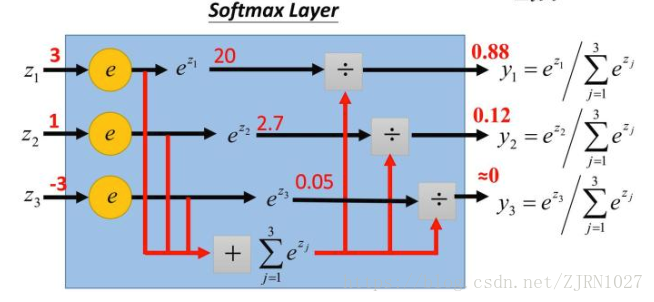

1)对神经网络的输出(logits)进行softmax,即概率归一化;

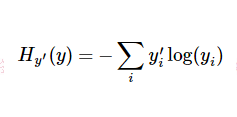

2)结合样本的标签labels计算交叉熵cross-entropy,作为loss;

3)对batch中所有样本的loss进行平均得到cost

2、tensorflow中计算loss的函数

1)tf.nn.sparse.softmax_cross_entropy_with_logits():输入的label格式为1维的向量

2)tf.nn.softmax_cross_entropy_with_logits():输入的label格式为one-hot格式,即矩阵