模板匹配

原理

模板匹配和卷积原理很像,模板在原图像上从原点开始滑动,计算模板与(图像被模板覆盖的地方)的差别程度,这个差别程度的计算方法在opencv里有6种,然后将每次计算的结果放入一个矩阵里,作为结果输出。假如原图形是AxB大小,而模板是axb大小,则输出结果的矩阵是(A-a+1)x(B-b+1)。

方法

cv2.matchTemplate(img, template, methods)

参数methods可以用下面几种方法:

- TM_SQDIFF:计算平方不同,计算出来的值越小,越相关

- TM_CCORR:计算相关性,计算出来的值越大,越相关

- TM_CCOEFF:计算相关系数,计算出来的值越大,越相关

- TM_SQDIFF_NORMED:计算归一化平方不同,计算出来的值越接近0,越相关

- TM_CCORR_NORMED:计算归一化相关性,计算出来的值越接近1,越相关

- TM_CCOEFF_NORMED:计算归一化相关系数,计算出来的值越接近1,越相关

具体公式可参考:Opencv官网

举例说明:

要求:用下图所示的模板来匹配图片,将图片中此模板对应的区域用矩形圈出来。

img = cv2.imread('lena.jpg', 0)

template = cv2.imread('face.jpg', 0)

h, w = template.shape[:2]

methods = ['cv2.TM_CCOEFF', 'cv2.TM_CCOEFF_NORMED', 'cv2.TM_CCORR',

'cv2.TM_CCORR_NORMED', 'cv2.TM_SQDIFF', 'cv2.TM_SQDIFF_NORMED']

# 先使用计算平方的方法匹配模板

res = cv2.matchTemplate(img, template, cv2.TM_SQDIFF)

# 得到计算值的最大值、最小值以及它们的左上角的位置

min_val, max_val, min_loc, max_loc = cv2.minMaxLoc(res)

# 运用所有方法

for meth in methods:

img2 = img.copy()

# 匹配方法的真值

method = eval(meth)

res = cv2.matchTemplate(img, template, method)

min_val, max_val, min_loc, max_loc = cv2.minMaxLoc(res)

# 如果是平方差匹配TM_SQDIFF或归一化平方差匹配TM_SQDIFF_NORMED,取最小值;否则取最大值。

if method in [cv2.TM_SQDIFF, cv2.TM_SQDIFF_NORMED]:

top_left = min_loc

else:

top_left = max_loc

bottom_right = (top_left[0] + w, top_left[1] + h)

# 画矩形

cv2.rectangle(img2, top_left, bottom_right, 255, 2)

plt.subplot(121), plt.imshow(res, cmap='gray')

plt.xticks([]), plt.yticks([]) # 隐藏坐标轴

plt.subplot(122), plt.imshow(img2, cmap='gray')

plt.xticks([]), plt.yticks([])

plt.suptitle(meth)

plt.show()

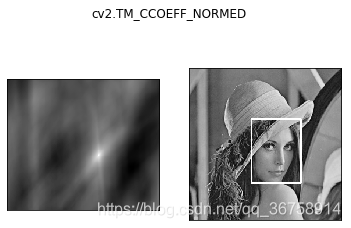

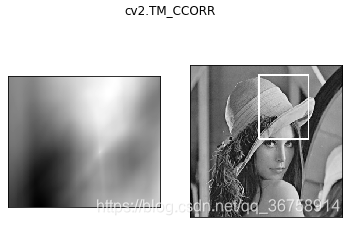

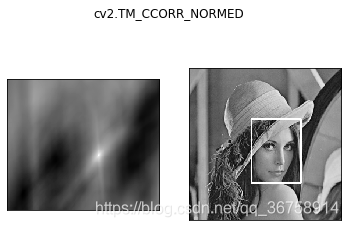

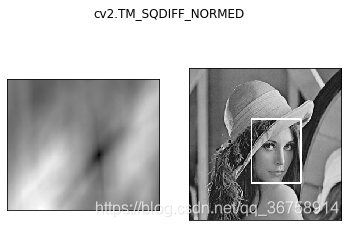

最终结果为:

由结果可知,大多数情况下模板匹配是成功的(除CCORR方法外)。

左图代表的是每种方法的评价标准,除了平方差匹配TM_SQDIFF或归一化平方差匹配TM_SQDIFF_NORMED外,其他方法都是在某点的计算数值越大,匹配度越高。

匹配多个对象

如果需要匹配多个对象,则不能直接用cv2.minMaxLoc(res)来找匹配度最高的区域。而是应该设一个较大的阈值,只要匹配度大于这个阈值,都应该被视为“匹配”。

如有下面的图片和模板:

![]()

img_rgb = cv2.imread('mario.jpg')

img_gray = cv2.cvtColor(img_rgb, cv2.COLOR_BGR2GRAY)

template = cv2.imread('mario_coin.jpg', 0)

h, w = template.shape[:2]

res = cv2.matchTemplate(img_gray, template, cv2.TM_CCOEFF_NORMED)

threshold = 0.8

# 取匹配程度大于%80的坐标,而不是找匹配度最大的坐标。

loc = np.where(res >= threshold)

for pt in zip(*loc[::-1]): # *号表示可选参数;[:,:,-1]表示调转loc中坐标的顺序,比如原来是(40, 69),现在变成(69, 40)。

bottom_right = (pt[0] + w, pt[1] + h)

cv2.rectangle(img_rgb, pt, bottom_right, (0, 0, 255), 2)

cv2.imshow('img_rgb', img_rgb)

cv2.waitKey(0)

得到结果:

由于这种方法是通过设置阈值来实现的,所以匹配到的图片位置可能更多,比如匹配到的左上角坐标是(69, 40),但由于(70, 40)离得比较近,故这个点也会被考虑在匹配范围之内,从而再画一个矩形。

PS: np.where()函数的用法

方法1:

np.where(condition, x, y)

满足条件(condition),输出x,不满足输出y。

方法2:

np.where(condition)

输出满足条件 (即非0) 元素的坐标。这里的坐标以元组的形式给出,通常原数组有多少维,输出的元组中就包含几个数组,分别对应符合条件元素的各维坐标。

如上面马里奥的例子,输出的元组loc中有两个数组,代表两个维度,即y方向和x方向。