CPU性能优化手段——缓存

我们都知道CPU是计算机的核心,也是程序所运行之处,人们为了提高程序运行的效率,CPU做了很多优化。缓存就是为了减少访问主内存的开销而使用的。

缓存同步协议——MESI协议

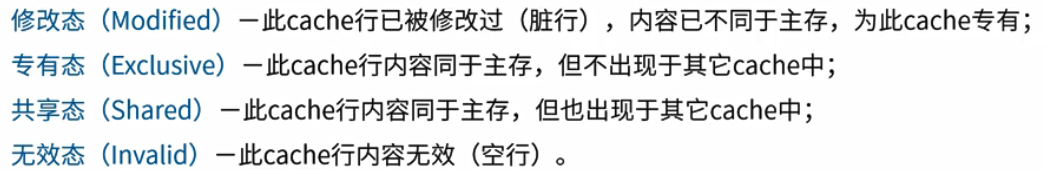

MESI规定了每个缓存都必须有一个状态位,具体如下:

当使用多处理器的时候,单个CPU对缓存进行修改的之后需要通知给其他CPU。这说明CPU既要控制自己的读写操作,还要监听其他CPU发出的通知,从而保证最终一致。

运行时指令重排

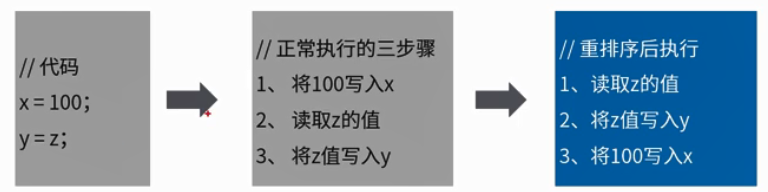

当CPU写缓存的时候发现缓存区块正被其他CPU占用的时候,为了提高CPU处理性能,可能将后面的读缓存命令优先执行。

注意:重排并非随意重排,需要遵守as-if-serial语义:即编译器和处理器不会对存在数据依赖关系的操作做重排序,即不会影响原先期望的结果

两个问题

1.CPU高速缓存下有一个问题:

缓存中的数据与主内存的数据并不是实时同步的,各CPU间缓存数据也不是实时同步的。在同一个时间点,各CPU所看到的同一内存地址的数据的值可能是不一样的。

2.CPU执行指令重排序优化下有一个问题:

虽然遵守了as-if-serial语义,单仅在单CPU自己执行的情况下能保证结果正确。但是当时多核多线程的情况下,指令逻辑无法分辨因果关联,可能出现乱序执行,导致程序运行结果错误。

解决方案

内存屏障

处理器提供了两个内存屏障(Memory Barrier) 用于解决上述两个问题:

写内存屏障(Store Memory Barrier):在指令后插入Store Barrier,能让写入缓存中的最新数据更新写入主内存,让其他线程可见。

强制写入主内存,这种显示调用,CPU就不会因为性能考虑而去对指令重排了。

读内存屏障(Load Memory Barrier):在指令前插入Load Barrier,可以让高速缓存中的数据失效,强制从新主从内存加载数据。

强制读取主内存内容,让CPU缓存与主内存保持一致,避免了缓存导致的一致性问题

结语

这里只是简单提了一下CPU与缓存之间的关系而已,主要是为了后面讲JVM线程安全问题。