一、关于warp-ctc

CTC可以生成一个损失函数,用于在序列数据上进行监督式学习,不需要对齐输入数据及标签,经常连接在一个RNN网络的末端,训练端到端的语音或文本识别系统。CTC论文

CTC网络的输入

CTC网络的输入是一个样本(图像)经过网络(一般是CNN+RNN)计算后生成的特征向量(特征序列),这部分可参考CRNN论文

特征序列里各个向量是按序排布的,是从图像样本上从左到右的一个个小的区间映射过来的,可以设置区间的大小(宽度),宽度越小,获得的特征序列里的特征向量个数越多,极端情况下,可以设置区间宽度为1,这样就会生成width(图像宽度)个特征向量(作为后续RNN的输入)。

将CNN产生的一系列(假设为width个)特征序列作为后续RNN(在CRNN中用的是Bi-LSTM)的输入,可以得到一个width维的概率矩阵,这个概率矩阵就可以作为CTC的输入,用来计算CTC loss。

CTC网络的计算过程

CTC网络的计算是为了得到特征序列最可能对应的标签对象,对语音识别是一段话,对文本识别是一段文字。

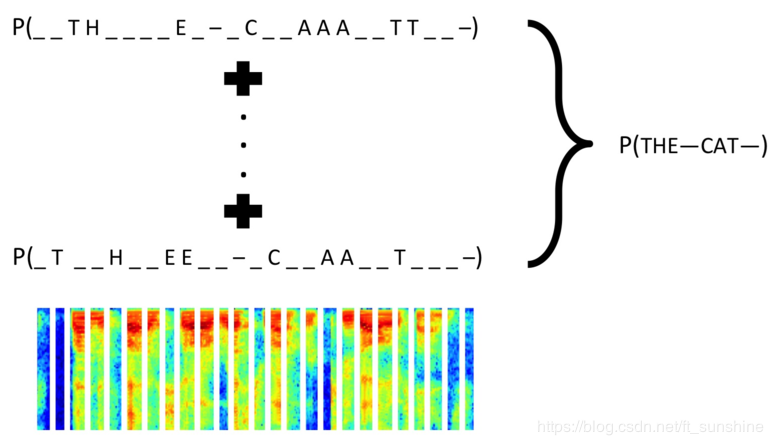

计算特征序列里每个特征向量(共N个)分别对应的n个可能结果的概率。如果当前的特征向量的预测结果不在样本标签列表里,就置预测结果为blank空格或下划线。计算结果从一个N维的特征序列,得到一个N×n的概率矩阵(就是上面所说的)。

计算上述预测的N×n的概率矩阵的所有可能结果的概率,中间涉及到去除重复字母和blank的操作。N个n维的特征向量(即N×n的概率矩阵)对应的所有可能的结果有Nn

NXn个,涉及到组合学,计算所有可能概率的成本会很高,但是CTC运用了动态规划(前后向算法,这部分推荐看一下HMM)以大幅降低计算的复杂性。

CTC网络的输出

对识别过程,取出最大概率对应的结果作为识别结果输出;

对训练过程,取最大概率对应的结果跟真实标签之间的差异(计算编辑距离等方法),作为训练Loss,反向传输给前端网络。

原文链接:https://blog.csdn.net/ft_sunshine/article/details/90300938

二、pytorch环境配置warp-ctc

注:本次编译是按照https://github.com/SeanNaren/warp-ctc的instruction进行的

服务器个人账户环境:

torch0.4.1

python3.7.0

cuda9.0

cudnn

2.1 torch0.4.1

目前pytorch的版本为pytorch1.3.1,官网“get started”提供的下载方式是针对最新版本的。对于旧版本的pytorch,

可以采用pip安装。

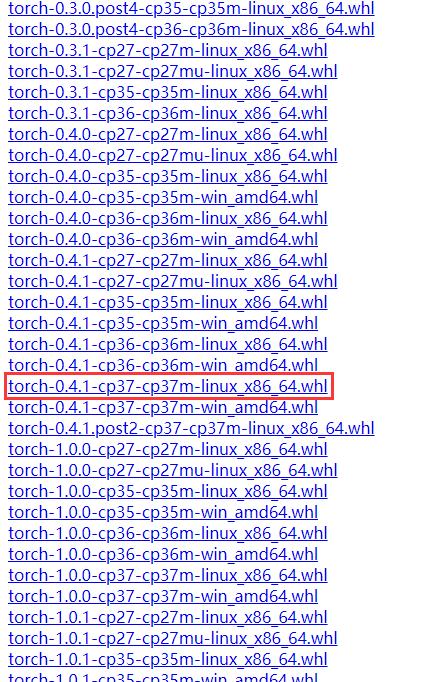

pytorch发布的各个版本的torch链接为:https://download.pytorch.org/whl/cu90/torch_stable.html

在官网上也可以找到旧版本。

进入pytorch官网,点击“get started”进入如下界面:

可以看到“Previous PyTorch Versions”的选项,选择,下拉,进入

COMMANDS FOR VERSIONS < 1.0.0

找到“via pip",可以找到相应的pytorch版本(不全)。

从上面的链接下载

torch-0.4.1-cp37-cp37m-linux_x86_64.whl

来自 <https://download.pytorch.org/whl/cu90/torch_stable.html>

这一版本的torch,然后进行安装。

2.2 torch0.4.1的安装

在命令行输入以下指令:

#新建一个虚拟环境

conda create -n torch0.4.1 python=3.7.0

#进入虚拟环境

conda activate torch0.4.1

#pip安装torch0.4.1

pip install torch-0.4.1-cp37-cp37m-linux_x86_64.whl

#pip安装torchvision

#如果pip安装失败,改成conda install torvision

pip install torchvision

如此,完成torch0.4.1的安装

测试

python

import torch

torch.cuda.is_available()

#输出:True

print(torch.__version__)

#输出:0.4.1

这样即完成torch0.4.1的配置了。

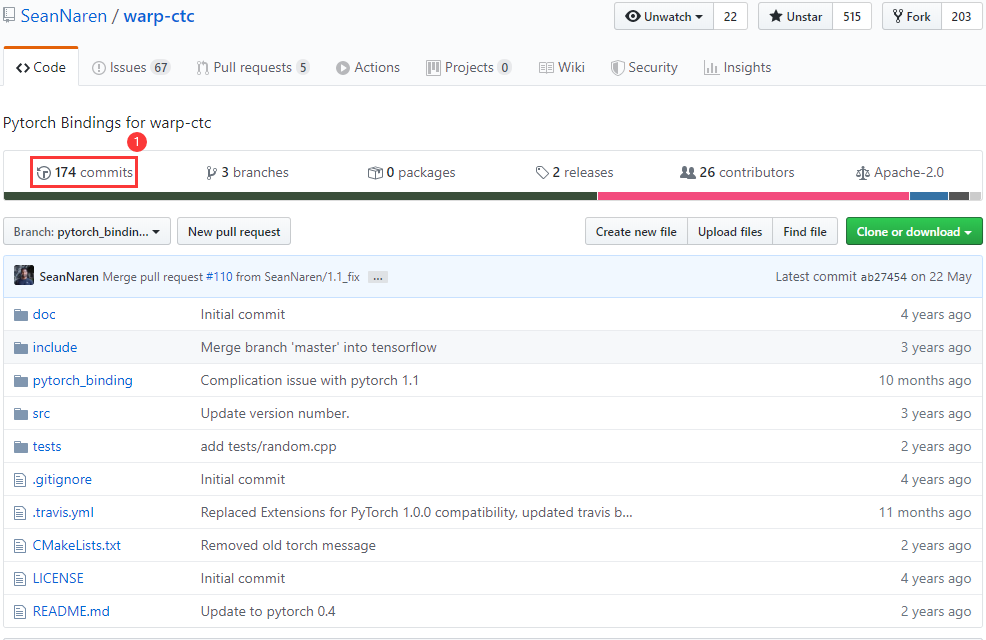

三、在pytorch环境编译warp-ctc

git clone https://github.com/SeanNaren/warp-ctc.git

cd warp-ctc

mkdir build

cd build

cmake ..

make

cd ../pytorch_binding

python setup.py install

但是这样出问题了!

问题一:

在服务器个人账户下,无法使用

git clone https://github.com/SeanNaren/warp-ctc.git

git clone [email protected]:SeanNaren/warp-ctc.git

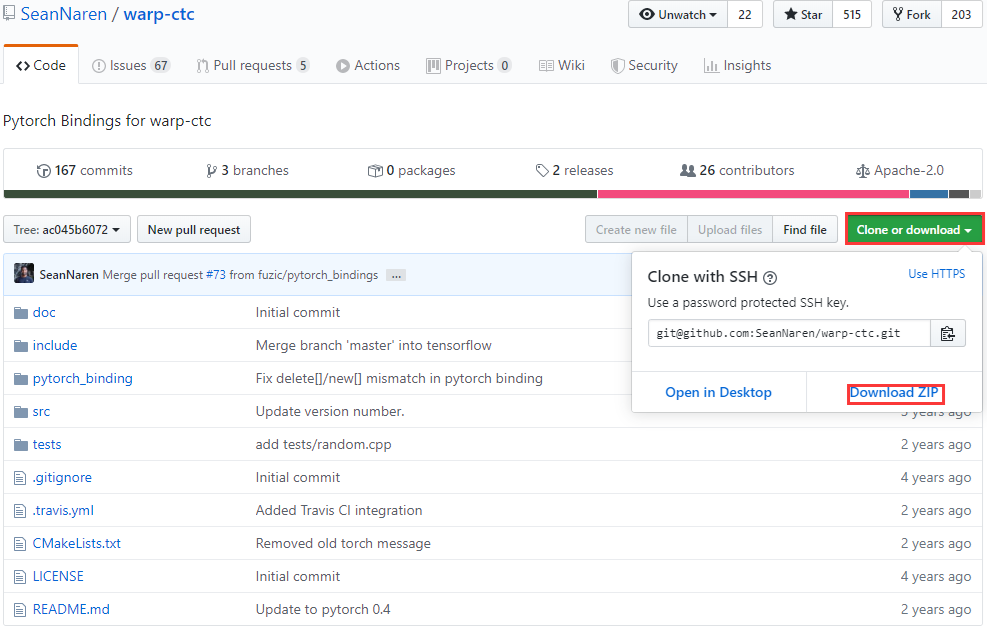

因此采用把安装包下载下来,然后在指定目录下解压,编译。

这里面zip解压后得到的文件夹名不是“warp-ctc”,需要将其改为“warp-ctc”。

然后按照:

conda activate torch0.4.1

cd warp-ctc

mkdir build

cd build

cmake ..

make

cd ../pytorch_binding

python setup.py install

进行操作

再次出现问题

问题二:

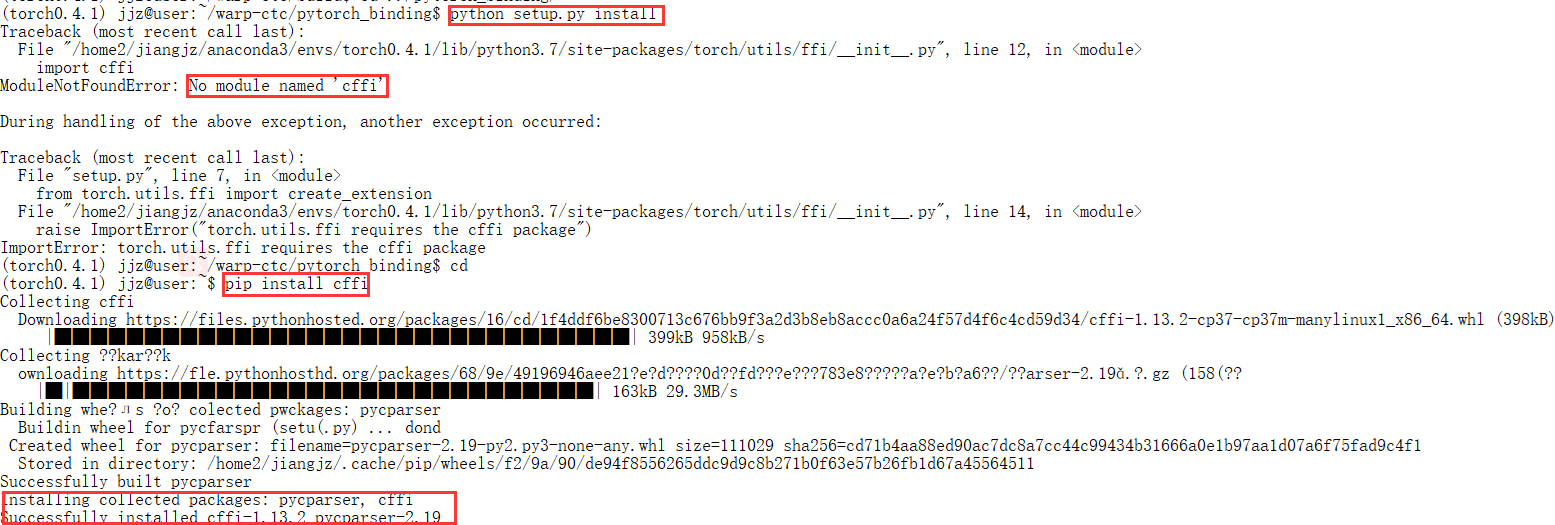

python setup.py install 时,发生错误

应该是torch0.4.1版本过于陈旧,而warp-ctc在不断更新,因此,旧版本的pytorch0.4.1缺少编译warp-ctc的包或者接口

解决方法,参见链接

https://www.twblogs.net/a/5c2a85a1bd9eee01606d3c4c

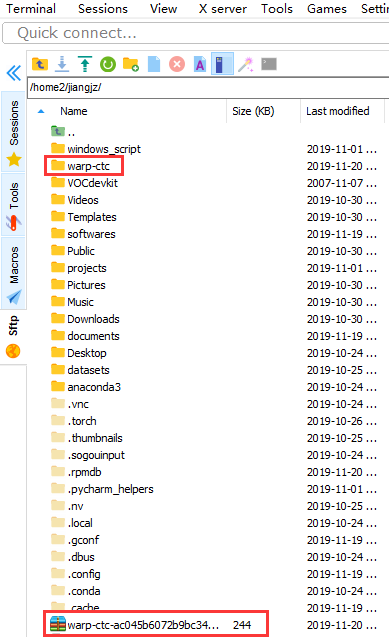

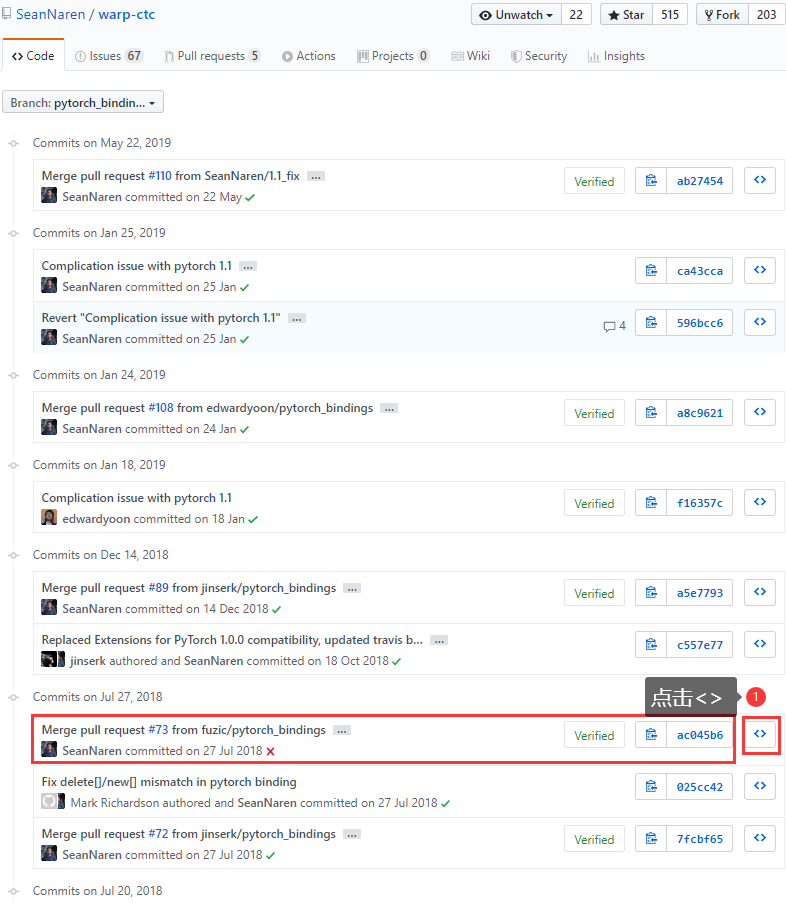

下载旧的版本。

网上有很多教程,其中issues里面的一个解决方案时用“

ac045b6072b9bc3454fb9f9f17674f0d59373789”

来自 <https://github.com/SeanNaren/warp-ctc/issues/101>

这一版本。

具体操作如下:

然后按照上面的流程操作即可:

conda activate torch0.4.1

cd warp-ctc

mkdir build

cd build

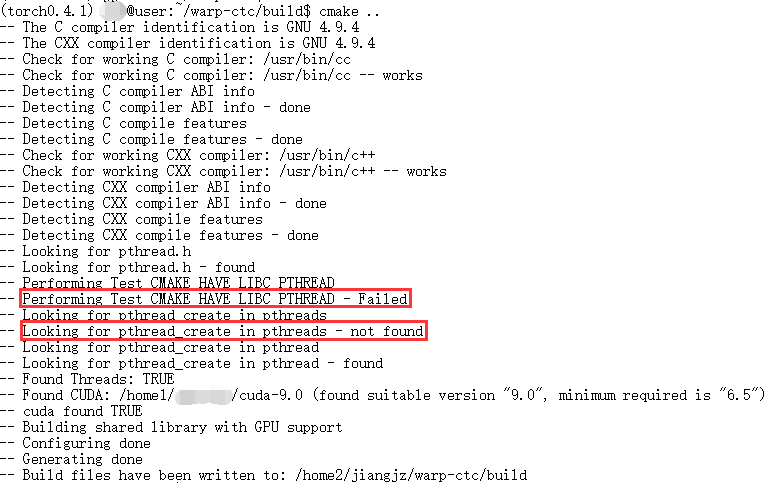

cmake ..

make

cd ../pytorch_binding

python setup.py install

在“cmake ..“过程中,会出现下图的问题,但对后面的”make“和”python setup.py install“似乎没有什么影响

在执行”python setup.py install“时,可能会遇到缺少安装包的情况,此时,直接pip install对应的包应该能够解决问题的。

我遇到的情况如下图所示:

再次执行“python setup.py install”:

配置环境变量:

执行

vi ~/.bashrc

进入配置文件(关于vim编辑问题,可以查阅vim教程)

在文件最后加入

export WARP_CTC_PATH="/home2/jiangjz/warp-ctc/build"

保存退出,然后让配置生效

source ~/.bashrc

最后进行验证:

python

import torch

from warpctc_pytorch import CTCLoss

ctc_loss = CTCLoss()

# expected shape of seqLength x batchSize x alphabet_size

probs = torch.FloatTensor([[[0.1, 0.6, 0.1, 0.1, 0.1], [0.1, 0.1, 0.6, 0.1, 0.1]]]).transpose(0, 1).contiguous()

labels = torch.IntTensor([1, 2])

label_sizes = torch.IntTensor([2])

probs_sizes = torch.IntTensor([2])

probs.requires_grad_(True) # tells autograd to compute gradients for probs

cost = ctc_loss(probs, labels, probs_sizes, label_sizes)

cost.backward()

print(cost)

来自 <https://github.com/SeanNaren/warp-ctc>

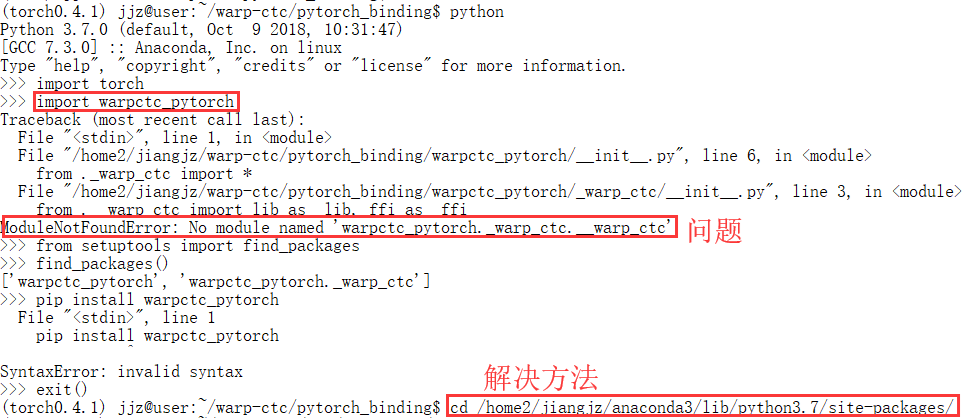

这里在“from warpctc_pytorch import CTCLoss”时报了错:

解决方法是添加环境变量(这一块有点紊乱了,但是将warp-ctc的路径添加到环境变量,应该能够解决问题)

重新运行:

具体解决方法见下面的链接:

https://github.com/SeanNaren/deepspeech.pytorch/issues/155

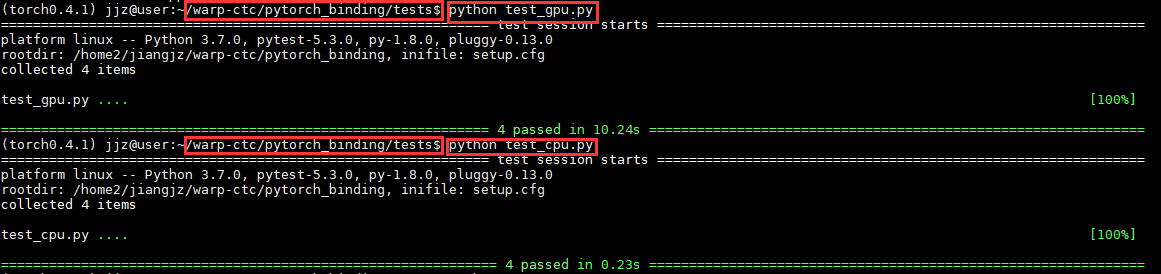

最后将测试过程再次贴出来: