版权声明:本文为博主原创文章,遵循 CC 4.0 BY-SA 版权协议,转载请附上原文出处链接和本声明。

本文前提:已经安装了docker,nvidia-docker.

安装mmdection,要求的环境与正在使用的cuda,python版本不同,要安装高版本的cuda.

想到Nvidia人性化的提供了各种镜像供我们直接下载使用。

地址:https://hub.docker.com/r/nvidia/cuda

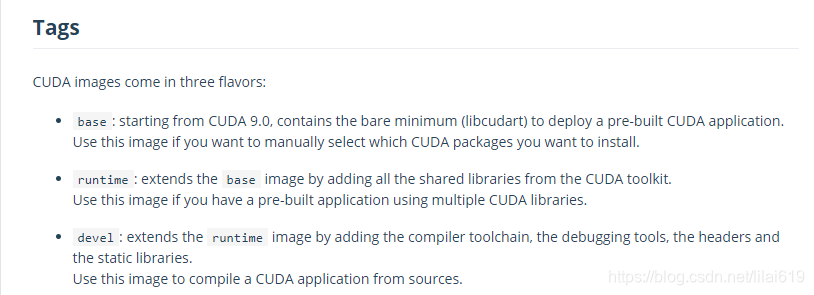

首先,需要注意的base、runtime、devel三者的区别。

★★★ devel版本里面才有 NVCC 编译器 ★★★

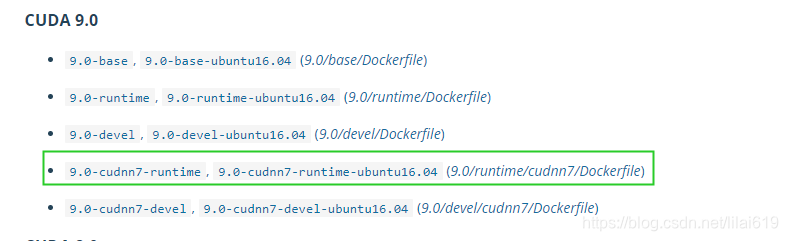

其次,根据自己的系统、cuda、cudnn版本选择下载。

1:打开对应链接,就可以看到对应的官方提供的Dockerfile文件。

2:下载该文件,并重命名为Dockerfile.

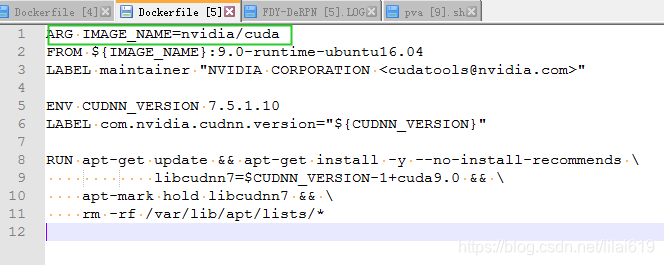

3:修改,如下

4:到该Dockerfile所在路径

docker build -t fcll:v0.1 .

5:其他常用操作

容器:

docker stop 容器ID 停止运行容器

docker start 容器ID 运行容器

docker ps -a 查看所有容口

docker rm 容器ID 删除指定容器

docker logs 容器ID 查看容器日志

docker exec -it 容器ID /bin/sh 进入到运行中的容器,cat /etc/resolv.conf 查看文件

ctrl+p+q 退出并保持运行容器

docker export 容器ID > docker_tensorflow.tar 导出容器

cat docker_tensorflow.tar | docker import - [image name]:[tag] 导入容器

镜像:

docker images 查看所有镜像

docker rmi -f 镜像ID 删除指定镜像

docker run -d 镜像ID 创建容器ID

docker run -p 8080:8080 -t mxnet/env 创建并运行一个容器

docker run -dti --name tensortest tensorflow/tensorflow /bin/sh ==>创建一个容器不进入

docker save 镜像ID > 镜像.tar ==》保存镜像 docker save 4431ddcz7e4a > /home/docker_tensorflow.tar

docker load < 镜像.tar ==》加载镜像 docker load < /home/docker_tensorflow.tar

docker tag 镜像ID 镜像名称 ==》起镜像别名 docker tag 77146ca185 tensorflow:gpu 重命名

docker pull 镜像名

docker build -t tensorflow/tensorflow . ==>生成镜像 folder(jar包和dockerfile)

【docker volume】

sudo docker volume create --name vol_simple

–

sudo docker run -d -v /root/data: /root/data tensorflow/bin/bash参考链接: