什么是Requests

Requests是采用Apache2 Licensed开源协议的HTTP库,用python语言基于urllib编写的。

使用 Requests会比urllib更加方便,可以节约我们大量的工作。Requests是python实现的最简单易用的HTTP库。

Requests模块 需要单独通过pip安装(pip install Requests)

requests功能介绍

很多情况下的网站如果直接response.text会出现乱码的问题,所以使用response.content,这样获取的数据是二进制数据;同样的,这个方法也可以用于下载图片以及视频资源

这样返回的数据格式其实是二进制格式,然后通过decode()转换为utf-8,这样就解决了通过response.text直接返回显示乱码的问题.

请求发出后,Requests 会基于 HTTP 头部对响应的编码作出有根据的推测。当你访问 response.text 之时,Requests 会使用其推测的文本编码。你可以找出 Requests 使用了什么编码,并且能够使用 response.encoding 属性来改变它.

不管是通过response.content.decode("utf-8)的方式还是通过response.encoding="utf-8"的方式都可以避免乱码的问题发生

requests提供的请求方式

1 import requests 2 3 requests.post("http://httpbin.org/post") # 向HTML网页提交POST请求方法,对应HTTP的POST 4 requests.put("http://httpbin.org/put") # 向HTML网页提交PUT请求的方法,对应HTTP的PUT 5 requests.delete("http://httpbin.org/delete") # 向HTML页面提交删除请求,对应HTTP的DELETE 6 requests.head("http://httpbin.org/get") # 获取HTML网页头的信息方法,对应HTTP的HEAD 7 requests.get("http://httpbin.org/get") # 获取HTML网页的主要方法,对应HTTP的GET

GET请求

- 简单get请求

1 import requests 2 response = requests.get('http://httpbin.org/get') 3 print(response.text)

- 带参get请求

1 import requests 2 response = requests.get("http://httpbin.org/get?name=zhaofan&age=23") 3 print(response.text)

若想要在URL查询字符串传递数据,通常通过httpbin.org/get?key=val方式传递。

Requests模块允许使用params关键字传递参数,以一个字典来传递这些参数。

1 import requests 2 data = { 3 "name":"guomuzi", 4 "age":25 5 } 6 response = requests.get("http://httpbin.org/get",params=data)。 7 # 通过params参数传递一个字典内容,从而直接构造url 8 print(response.url) 9 print(response.text)

注意:第二种方式通过字典的方式的时候,如果字典中的参数为None则不会添加到url上

- 添加headers

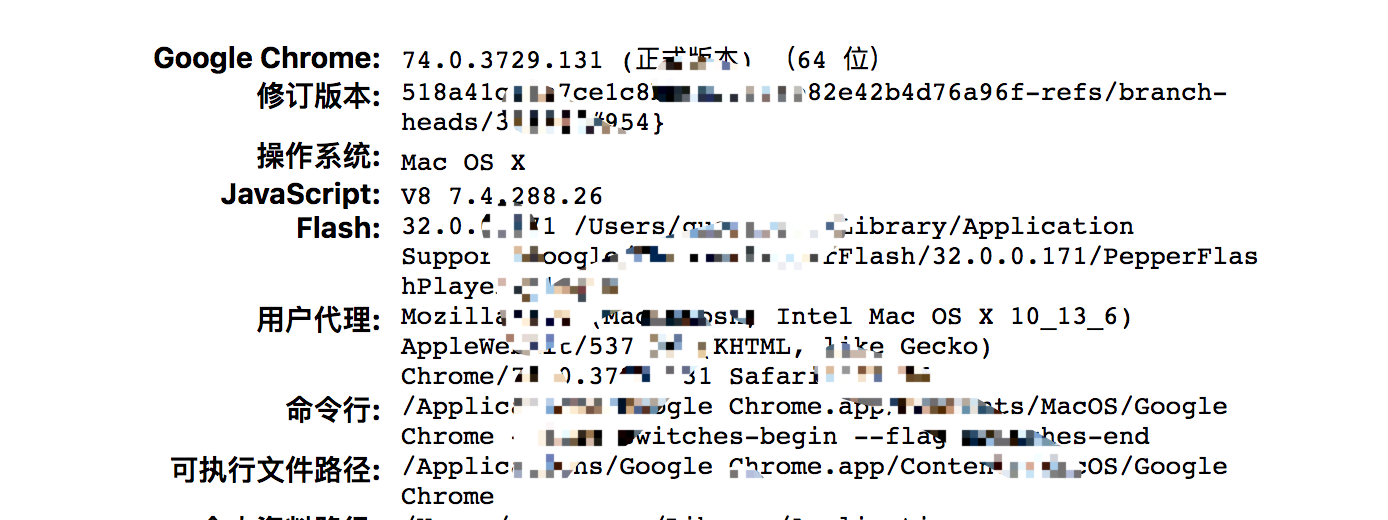

Requests和urllib模块一样可以定制headers的信息,当直接通过requests请求某些网站的时候,默认是无法访问的,因为有的网站需要头部信息,在谷歌浏览器地址栏输入 chrome://version 查看用户代理,将用户代理添加到头部信息

1 import requests 2 3 headers = { 4 "User-Agent":"Mozilla/5.0 (Macintosh; Intel Mac OS X 10_12_4) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.36" 5 } 6 response =requests.get("https://www.zhihu.com",headers=headers) 7 8 print(response.text)

POST请求

通过在发送post请求时添加一个data参数,这个data参数可以通过字典构造成,这样对于发送post请求就非常方便

同样在发送post请求的时候也可以和发送get请求一样通过headers参数传递一个字典类型的请求头数据

1 import requests 2 3 data = { 4 "name":"zhaofan", 5 "age":23} 6 response = requests.post("http://httpbin.org/post",data=data) 7 print(response.text)

response响应

可以通过response获得很多属性.

import requests response = requests.get("http://www.baidu.com") print(type(response.status_code),response.status_code) # 获取响应类型 和 状态码信息 print(type(response.headers),response.headers) # 获取响应类型 和 头部信息 print(type(response.cookies),response.cookies) # 获取响应类型 和 cookie信息 print(type(response.url),response.url) # 获取响应类型 和 URL信息 print(type(response.history),response.history) # 获取响应类型 和 响应历史信息 print(type(response.text),response.text) # 获取响应类型 和 返回的是 unicode型的文本数据 print(type(response.content),response.content) # 获取响应类型 和 返回的是 bytes 型的二进制数据

状态码判断

Requests还附带了一个内置的状态码查询对象

例如:200: ('ok', 'okay', 'all_ok', 'all_okay', 'all_good', '\o/', '✓')

import requests response= requests.get("http://www.baidu.com") if response.status_code == requests.codes.ok: print("访问成功")

解析json

requests里面集成的json其实就是执行了json.loads()方法,两者的结果是一样的

import requests import json response = requests.get("http://httpbin.org/get") print(type(response.text)) print(response.json()) print(json.loads(response.text)) print(type(response.json()))

requests高级用法

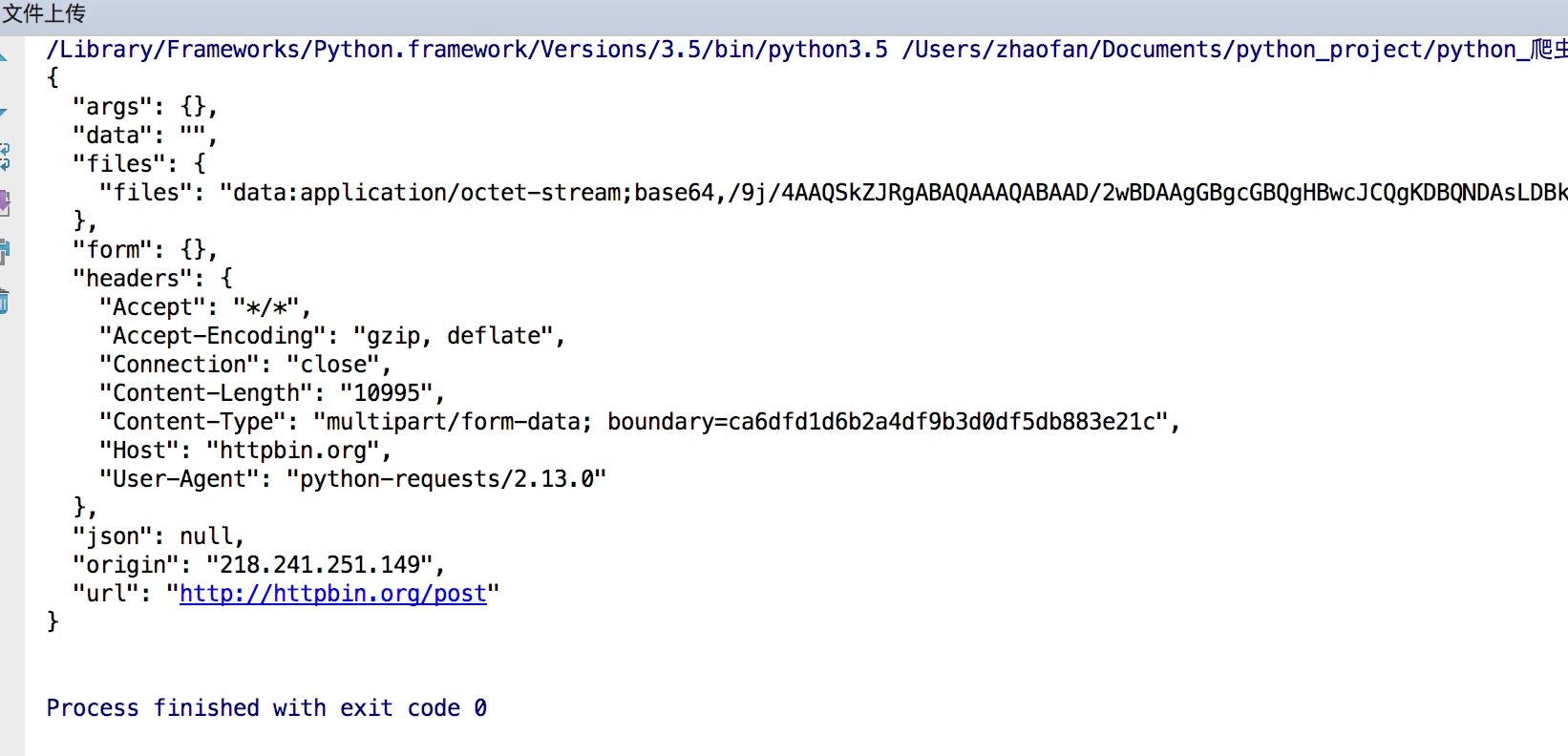

文件上传

实现方法和其他参数类似,也是构造一个字典然后通过files参数传递

1 import requests 2 3 files= {"files":open("git.jpeg","rb")} 4 response = requests.post("http://httpbin.org/post",files=files) 5 print(response.text)

结果如下:

获取cookie

import requests response = requests.get("http://www.baidu.com") for key,value in response.cookies.items(): print(key+"="+value)

会话维持

cookie的一个作用就是可以用于模拟登陆,做会话维持

import requests s = requests.Session() s.get("http://httpbin.org/cookies/set/number/123456") response = s.get("http://httpbin.org/cookies") print(response.text)

证书验证

现在的很多网站都是https的方式访问,所以就涉及到证书的问题

例如 默认的12306网站的证书是不合法的,会提示如下错误,为了避免这种情况的发生可以通过verify=False,但是这样是可以访问到页面,但是会提示:

InsecureRequestWarning: Unverified HTTPS request is being made. Adding certificate verification is strongly advised. See: https://urllib3.readthedocs.io/en/latest/advanced-usage.html#ssl-warnings InsecureRequestWarning)

解决方法为:

import requests from requests.packages import urllib3 urllib3.disable_warnings() response = requests.get("https://www.12306.cn",verify=False) print(response.status_code)

代理设置

1 import requests 2 3 proxies= { 4 "http":"http://127.0.0.1:9999", 5 "https":"http://127.0.0.1:8888" 6 } 7 8 # 如果代理需要设置账户名和密码,需要将字典更改为如下: 9 proxies = { 10 "http":"http://user:[email protected]:9999" 11 } 12 13 # 如果代理是通过sokces这种方式,则需要pip install "requests[socks]" 14 proxies= { 15 "http":"socks5://127.0.0.1:9999", 16 "https":"sockes5://127.0.0.1:8888" 17 } 18 19 response = requests.get("https://www.baidu.com",proxies=proxies) 20 print(response.text)

超时设置 通过timeout参数可以设置超时的时间

认证设置

如果碰到需要认证的网站可以通过requests.auth模块实现

1 import requests 2 from requests.auth import HTTPBasicAuth 3 4 response = requests.get("http://120.27.34.24:9001/",auth=HTTPBasicAuth("user","123")) 5 print(response.status_code) 6 7 # 还可以 8 response = requests.get("http://120.27.34.24:9001/",auth=("user","123")) 9 print(response.status_code)

异常处理

所有的异常都是在requests.excepitons中

详细的可以看:http://cn.python-requests.org/zh_CN/latest/_modules/requests/exceptions.html#RequestException

1 import requests 2 from requests.exceptions import ReadTimeout,ConnectionError,RequestException 3 4 try: 5 response = requests.get("http://httpbin.org/get",timout=0.1) 6 print(response.status_code) 7 except ReadTimeout: 8 print("timeout") 9 except ConnectionError: 10 print("connection Error") 11 except RequestException: 12 print("error")

其实最后测试可以发现,首先被捕捉的异常是timeout,当把网络断掉的haul就会捕捉到ConnectionError,

如果前面异常都没有捕捉到,最后也可以通过RequestExctption捕捉到