1.ResNet意义

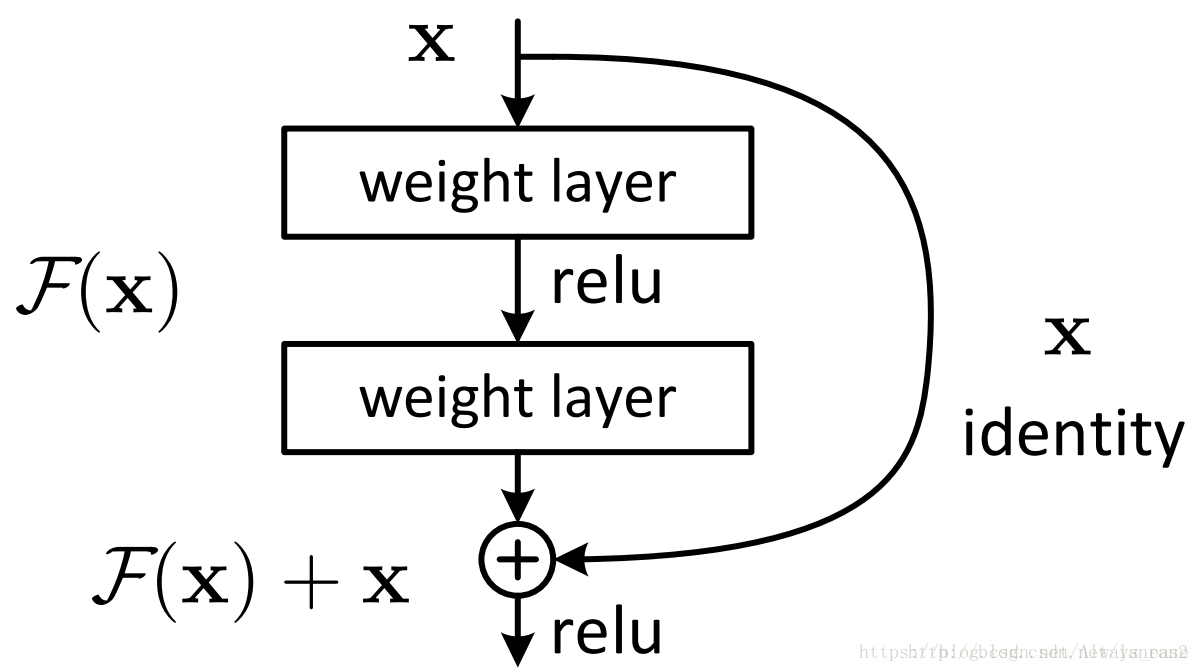

深度残差网络,它允许网络尽可能的加深。最后的输出是 y=F(x)+x。残差指的就是F(x)部分 。

理论上,对于“随着网络加深,准确率下降”的问题,Resnet提供了两种选择方式,也就是identity mapping和residual mapping,如果网络已经到达最优,继续加深网络,residual mapping将被push为0,只剩下identity mapping,这样理论上网络一直处于最优状态了,网络的性能也就不会随着深度增加而降低了。

2.ResNet结构

它使用了一种连接方式叫做“shortcut connection”,顾名思义,shortcut就是“抄近道”的意思。

真正在使用的ResNet模块,文章中就提出了两种方式 :

两种结构分别针对ResNet34(左图)和ResNet50/101/152(右图),一般称整个结构为一个”building block“。

右图又称为”bottleneck design”,目的就是为了降低参数的数目,第一个1x1的卷积把256维channel降到64维,然后在最后通过1x1卷积恢复,整体上用的参数数目:1x1x256x64 + 3x3x64x64 + 1x1x64x256 = 69632,而不使用bottleneck的话就是两个3x3x256的卷积,参数数目: 3x3x256x256x2 = 1179648,差了16.94倍。

对于常规ResNet,可以用于34层或者更少的网络中,对于Bottleneck Design的ResNet通常用于更深的如101这样的网络中。

note:1、1*1卷积在大多数情况下作用是升/降特征的维度,这里的维度指的是通道数(厚度),而不改变图片的宽和高。右图使用64个1*1的卷积得到channel=64。

2、参数数目=卷积核大小*input channel*output channel(忽略bias)

如果F(x)和x的channel个数不同怎么办:虚线的的Connection部分(”第一个绿色矩形和第三个绿色矩形“)分别是3x3x64和3x3x128的卷积操作,他们的channel个数不同(64和128),所以采用计算方式: y=F(x)+Wx。其中W是卷积操作,用来调整x的channel维度的

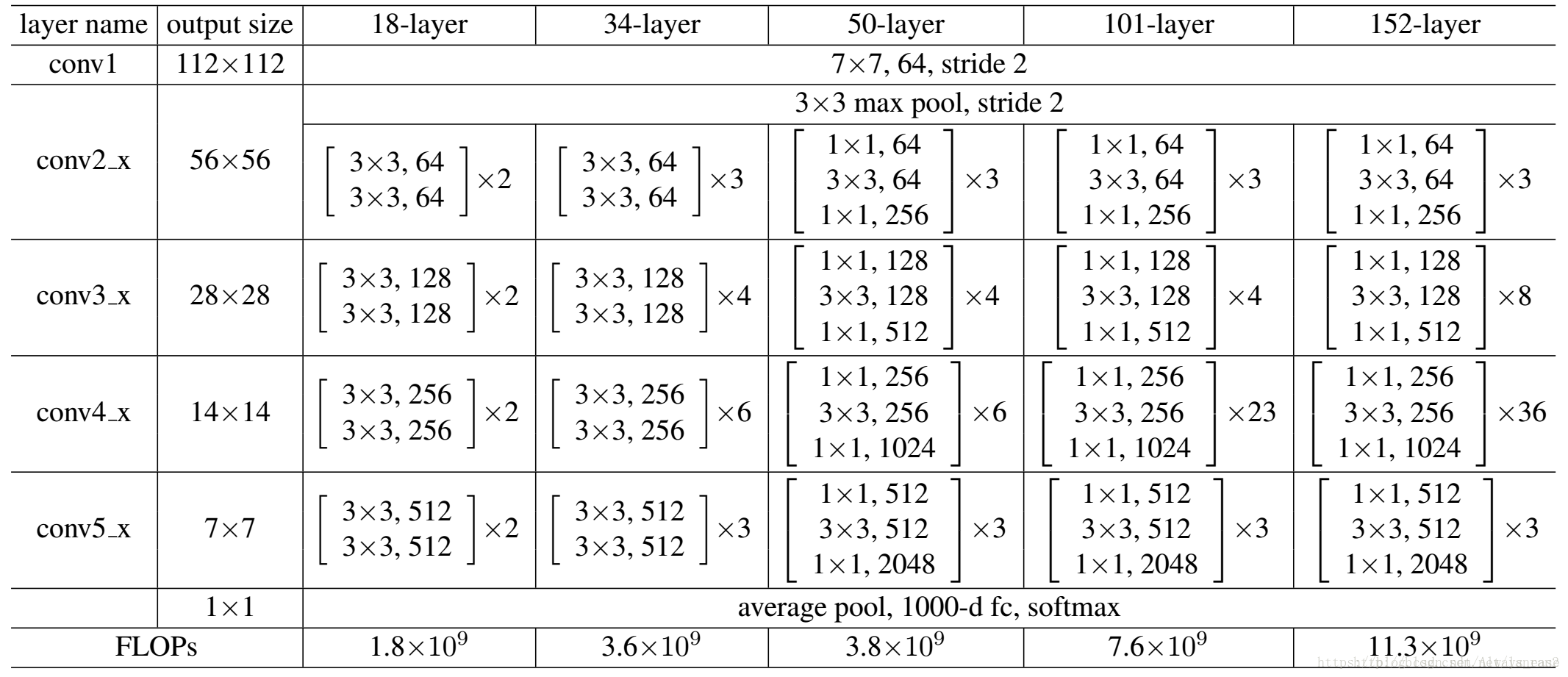

3.ResNet50和ResNet101

上面一共提出了5中深度的ResNet,分别是18,34,50,101和152,首先看表2最左侧,我们发现所有的网络都分成5部分,分别是:conv1,conv2_x,conv3_x,conv4_x,conv5_x

拿101-layer举例:首先有个输入7x7x64的卷积,然后经过3 + 4 + 23 + 3 = 33个building block,每个block为3层,所以有33 x 3 = 99层,最后有个fc层(用于分类),所以1 + 99 + 1 = 101层

注:101层网络仅仅指卷积或者全连接层,而激活层或者Pooling层并没有计算在内

4.ResNet50结构

https://blog.csdn.net/Seven_year_Promise/article/details/69358681

结构详解:https://blog.csdn.net/Seven_year_Promise/article/details/69360488?utm_source=blogxgwz0

5.ResNet34代码

#------------------------------用50行代码搭建ResNet-------------------------------------------

from torch import nn

import torch as t

from torch.nn import functional as F

class ResidualBlock(nn.Module):

#实现子module: Residual Block

def __init__(self,inchannel,outchannel,stride=1,shortcut=None):

super(ResidualBlock,self).__init__()

self.left=nn.Sequential(

nn.Conv2d(inchannel,outchannel,3,stride,1,bias=False),

nn.BatchNorm2d(outchannel),

nn.ReLU(inplace=True),

nn.Conv2d(outchannel,outchannel,3,1,1,bias=False),

nn.BatchNorm2d(outchannel)

)

self.right=shortcut

def forward(self,x):

out=self.left(x)

residual=x if self.right is None else self.right(x)

out+=residual

return F.relu(out)

class ResNet(nn.Module):

#实现主module:ResNet34

#ResNet34包含多个layer,每个layer又包含多个residual block

#用子module实现residual block , 用 _make_layer 函数实现layer

def __init__(self,num_classes=1000):

super(ResNet,self).__init__()

self.pre=nn.Sequential(

nn.Conv2d(3,64,7,2,3,bias=False),

nn.BatchNorm2d(64),

nn.ReLU(inplace=True),

nn.MaxPool2d(3,2,1)

)

#重复的layer,分别有3,4,6,3个residual block

self.layer1=self._make_layer(64,64,3)

self.layer2=self._make_layer(64,128,4,stride=2)

self.layer3=self._make_layer(128,256,6,stride=2)

self.layer4=self._make_layer(256,512,3,stride=2)

#分类用的全连接

self.fc=nn.Linear(512,num_classes)

def _make_layer(self,inchannel,outchannel,block_num,stride=1):

#构建layer,包含多个residual block

shortcut=nn.Sequential(

nn.Conv2d(inchannel,outchannel,1,stride,bias=False),

nn.BatchNorm2d(outchannel))

layers=[ ]

layers.append(ResidualBlock(inchannel,outchannel,stride,shortcut))

for i in range(1,block_num):

layers.append(ResidualBlock(outchannel,outchannel))

return nn.Sequential(*layers)

def forward(self,x):

x=self.pre(x)

x=self.layer1(x)

x=self.layer2(x)

x=self.layer3(x)

x=self.layer4(x)

x=F.avg_pool2d(x,7)

x=x.view(x.size(0),-1)

return self.fc(x)