1.你写爬虫的时候都遇到过什么反爬虫措施,你是怎么解决的?

- 通过headers反爬虫:解决策略,伪造headers

- 基于用户行为反爬虫:动态变化去爬取数据,模拟普通用户的行为

- 通过动态更改代理ip来反爬虫

- 基于动态页面的反爬虫:跟踪服务器发送的ajax请求,模拟ajax请求,selnium 和phtamjs

2.用的什么框架,为什么选择这个框架(我用的是scrapy框架,所以下面的问题也是针对scrapy)

scrapy

- 基于twisted异步io框架,是纯python实现的爬虫框架,性能是最大的优势

- 可以加入request和beautifulsoup

- 方便扩展,提供了很多内置功能

- 内置的cssselector和xpath非常方便

- 默认深度优先

二.框架问题(scrapy)可能会根据你说的框架问不同的问题,但是scrapy还是比较多的

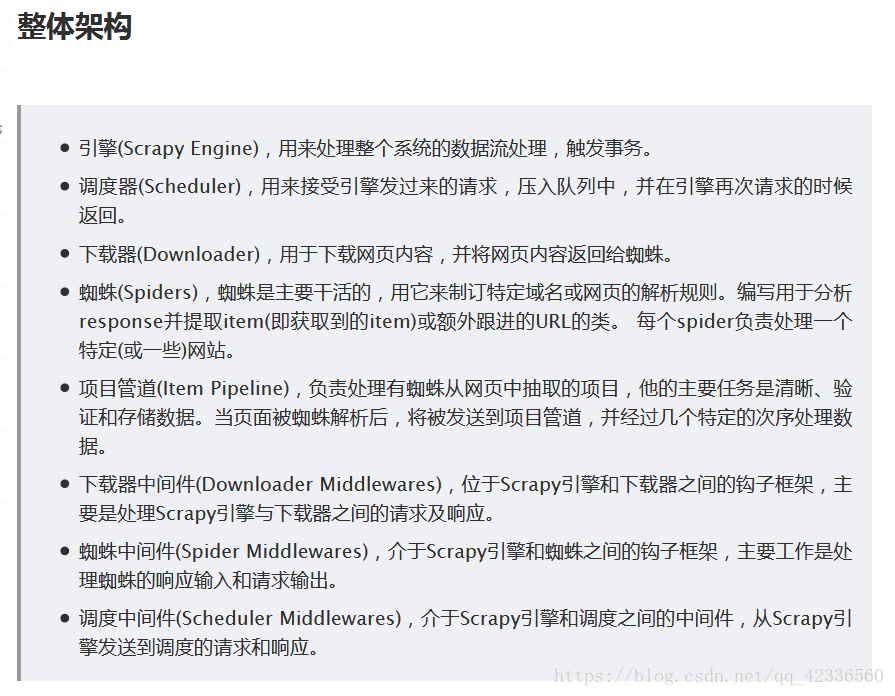

1.scrapy的基本结构(五个部分都是什么,请求发出去的整个流程)

流程

1.引擎打开一个域名,蜘蛛处理这个域名,并让蜘蛛获取第一个爬取的URL。

2.引擎从蜘蛛那获取第一个需要爬取的URL,然后作为请求在调度中进行调度。

3.引擎从调度那获取接下来进行爬取的页面。

4.调度将下一个爬取的URL返回给引擎,引擎将他们通过下载中间件发送到下载器。

5.当网页被下载器下载完成以后,响应内容通过下载中间件被发送到引擎。

6.引擎收到下载器的响应并将它通过蜘蛛中间件发送到蜘蛛进行处理。

7.蜘蛛处理响应并返回爬取到的项目,然后给引擎发送新的请求。

8.引擎将抓取到的项目项目管道,并向调度发送请求。

系统重复第二步后面的操作,直到调度中没有请求,然后断开引擎与域之间的联系

2.scrapy的去重原理 (指纹去重到底是什么原理)

需要将dont_filter设置为False开启去重,默认是False;

对于每一个url的请求,调度器都会根据请求的相关信息加密得到一个指纹信息,并且将指纹信息和set()集合中得指纹信息进行比对,如果set()集合中已经存在这个数据,就不在将这个Request放入队列中。如果set()集合中没有,就将这个Request对象放入队列中,等待被调度。

3.scrapy中间件有几种类,你用过那些中间件,

scrapy的中间件理论上有三种(Schduler Middleware,Spider Middleware,Downloader Middleware),在应用上一般有以下两种

1.爬虫中间件Spider Middleware

主要功能是在爬虫运行过程中进行一些处理.

2.下载器中间件Downloader Middleware

主要功能在请求到网页后,页面被下载时进行一些处理.

4.scrapy中间件再哪里起的作用(面向切面编程)