多任务理解

多任务即为同一时间内同时进行多个任务(比如在听歌的同时进行python开发)

并发

指的是任务数多余cpu核数,通过操作系统的各种任务调度算法,实现用多个任务“一起”执行(实际上总有一些任务不在执行,因为切换任务的速度相当快,看上去一起执行而已)

并行

指的是任务数小于等于cpu核数,即任务真的是一起执行的

threading

创建线程

import threading

from time import sleep,ctime

def sing():

for i in range(3):

print("正在唱歌...%d"%i)

sleep(1)

def dance():

for i in range(3):

print("正在跳舞...%d"%i)

sleep(1)

if __name__ == '__main__':

print('---开始---:%s'%ctime())

t1 = threading.Thread(target=sing) # 创建线程

t2 = threading.Thread(target=dance)

t1.start() # 启动线程

t2.start()

封装线程执行代码

过使用threading模块能完成多任务的程序开发,为了让每个线程的封装性更完美,所以使用threading模块时,往往会定义一个新的子类class,只要继承threading.Thread就可以了,然后重写run方法#coding=utf-8

import threading

import time

class MyThread(threading.Thread):

def run(self):

for i in range(3):

time.sleep(1)

msg = "I'm "+self.name+' @ '+str(i) #name属性中保存的是当前线程的名字

print(msg)

if __name__ == '__main__':

t = MyThread()

t.start()

注意

python的threading.Thread类有一个run方法,用于定义线程的功能函数,可以在自己的线程类中覆盖该方法。而创建自己的线程实例后,通过Thread类的start方法,可以启动该线程,交给python虚拟机进行调度,当该线程获得执行的机会时,就会调用run方法执行线程。

线程的执行顺序

#coding=utf-8

import threading

import time

class MyThread(threading.Thread):

def run(self):

for i in range(3):

time.sleep(1)

msg = "I'm "+self.name+' @ '+str(i)

print(msg)

def test():

for i in range(5):

t = MyThread()

t.start()

if __name__ == '__main__':

test()

执行结果:(运行的结果可能不一样,但是大体是一致的)

I'm Thread-1 @ 0

I'm Thread-2 @ 0

I'm Thread-5 @ 0

I'm Thread-3 @ 0

I'm Thread-4 @ 0

I'm Thread-3 @ 1

I'm Thread-4 @ 1

I'm Thread-5 @ 1

I'm Thread-1 @ 1

I'm Thread-2 @ 1

I'm Thread-4 @ 2

I'm Thread-5 @ 2

I'm Thread-2 @ 2

I'm Thread-1 @ 2

I'm Thread-3 @ 2

说明

从代码和执行结果我们可以看出,多线程程序的执行顺序是不确定的。当执行到sleep语句时,线程将被阻塞(Blocked),到sleep结束后,线程进入就绪(Runnable)状态,等待调度。而线程调度将自行选择一个线程执行。上面的代码中只能保证每个线程都运行完整个run函数,但是线程的启动顺序、run函数中每次循环的执行顺序都不能确定。

总结

- 每个线程默认有一个名字,尽管上面的例子中没有指定线程对象的name,但是python会自动为线程指定一个名字。

- 当线程的run()方法结束时该线程完成。

- 无法控制线程调度程序,但可以通过别的方式来影响线程调度的方式。

多线程-共享全局变量

from threading import Thread

import time

g_num = 100

def work1():

global g_num

for i in range(3):

g_num += 1

print("----in work1, g_num is %d---"%g_num)

def work2():

global g_num

print("----in work2, g_num is %d---"%g_num)

print("---线程创建之前g_num is %d---"%g_num)

t1 = Thread(target=work1)

t1.start()

#延时一会,保证t1线程中的事情做完

time.sleep(1)

t2 = Thread(target=work2)

t2.start()

执行结果

---线程创建之前g_num is 100--- ----in work1, g_num is 103--- ----in work2, g_num is 103---

列表当做实参传递到线程中

from threading import Thread

import time

def work1(nums):

nums.append(44)

print("----in work1---",nums)

def work2(nums):

#延时一会,保证t1线程中的事情做完

time.sleep(1)

print("----in work2---",nums)

g_nums = [11,22,33]

t1 = Thread(target=work1, args=(g_nums,))

t1.start()

t2 = Thread(target=work2, args=(g_nums,))

t2.start()

运行结果:

----in work1--- [11, 22, 33, 44] ----in work2--- [11, 22, 33, 44]

总结:

在一个进程内的所有线程共享全局变量,很方便在多个线程间共享数据

缺点就是,线程是对全局变量随意遂改可能造成多线程之间对全局变量的混乱(即线程非安全)

多线程开发可能遇到的问题

假设两个线程t1和t2都要对全局变量g_num(默认是0)进行加1运算,t1和t2都各对g_num加10次,g_num的最终的结果应该为20。

但是由于是多线程同时操作,有可能出现下面情况:

- 在g_num=0时,t1取得g_num=0。此时系统把t1调度为”sleeping”状态,把t2转换为”running”状态,t2也获得g_num=0

- 然后t2对得到的值进行加1并赋给g_num,使得g_num=1

- 然后系统又把t2调度为”sleeping”,把t1转为”running”。线程t1又把它之前得到的0加1后赋值给g_num。

- 这样导致虽然t1和t2都对g_num加1,但结果仍然是g_num=1

同步

说明 python的threading.Thread类有一个run方法,用于定义线程的功能函数,可以在自己的线程类中覆盖该方法。而创建自己的线程实例后,通过Thread类的start方法,可以启动该线程,交给python虚拟机进行调度,当该线程获得执行的机会时,就会调用run方法执行线程。同步就是协同步调,按预定的先后次序进行运行。如:你说完,我再说。

"同"字从字面上容易理解为一起动作

其实不是,"同"字应是指协同、协助、互相配合。

如进程、线程同步,可理解为进程或线程A和B一块配合,A执行到一定程度时要依靠B的某个结果,于是停下来,示意B运行;B执行,再将结果给A;A再继续操作。

解决线程同时修改全局变量的方式

对于上一小节提出的那个计算错误的问题,可以通过线程同步来进行解决

思路,如下:

系统调用t1,然后获取到g_num的值为0,此时上一把锁,即不允许其他线程操作g_num

t1对g_num的值进行+1

t1解锁,此时g_num的值为1,其他的线程就可以使用g_num了,而且是g_num的值不是0而是1

同理其他线程在对g_num进行修改时,都要先上锁,处理完后再解锁,在上锁的整个过程中不允许其他线程访问,就保证了数据的正确性

自定义线程

"""

开辟一个子线程执行多个任务(有序的执行)

"""

import threading

# 方案1

# # 任务1

# def work1():

# print(threading.current_thread())

# print("工作1...")

#

# # 任务2

# def work2():

# print(threading.current_thread())

# print("工作2...")

#

# def func():

# print(threading.current_thread())

# work1()

# work2()

#

# if __name__ == '__main__':

#

# # 创建一个子线程执行任务

# work_thread = threading.Thread(target=func)

# # 启动线程

# work_thread.start()

# 方案2

class MyThread(threading.Thread):

# 重写

# 如果自定义线程后 如果重新了父类的init方法必须要先调用父类同名方法 init

def __init__(self, name):

super(MyThread, self).__init__()

self.name = name

# 任务1

def work1(self):

print(self.name)

print(threading.current_thread())

print("工作1...")

# 任务2

def work2(self):

print(self.name)

print(threading.current_thread())

print("工作2...")

# 程序员需要实现一个方法run

def run(self):

print(threading.current_thread())

self.work1()

self.work2()

if __name__ == '__main__':

# 通过自定义线程类创建子线程

my_thread = MyThread("自定义线程")

# 启动线程

my_thread.start()

互斥锁

理解

互斥锁好比,生活中上卫生间,一个人进入会将门锁上,另一个人必须等待其解锁后才可进入进行工作、

demo

# 创建锁

mutex = threading.Lock()

# 锁定

mutex.acquire()

# 释放

mutex.release()

注意

如果这个锁之前是没有上锁的,那么acquire不会堵塞

如果在调用acquire对这个锁上锁之前 它已经被 其他线程上了锁,那么此时acquire会堵塞,直到这个锁被解锁为止

上锁解锁过程

当一个线程调用锁的acquire()方法获得锁时,锁就进入“locked”状态。每次只有一个线程可以获得锁。如果此时另一个线程试图获得这个锁,该线程就会变为“blocked”状态,称为“阻塞”,直到拥有锁的线程调用锁的release()方法释放锁之后,锁进入“unlocked”状态。

线程调度程序从处于同步阻塞状态的线程中选择一个来获得锁,并使得该线程进入运行(running)状态。

总结

锁的好处

确保了某段关键代码只能由一个线程从头到尾完整地执行

锁的坏处:

阻止了多线程并发执行,包含锁的某段代码实际上只能以单线程模式执行,效率就大大地下降了由于可以存在多个锁,不同的线程持有不同的锁,并试图获取对方持有的锁时,可能会造成死锁

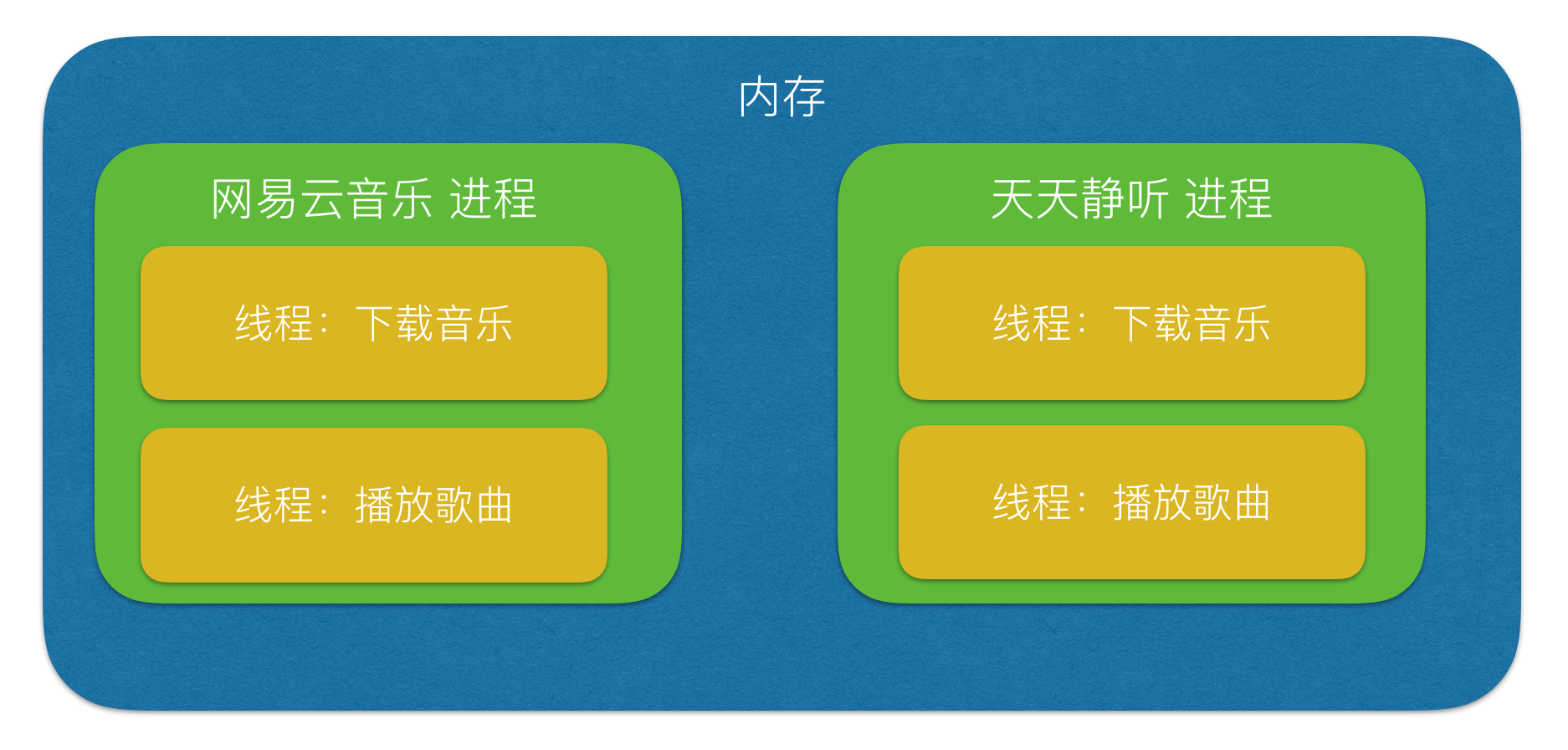

进程

程序:例如xxx.py这是程序,是一个静态的进程:一个程序运行起来后,代码+用到的资源 称之为进程,它是操作系统分配资源的基本单元。

不仅可以通过线程完成多任务,进程也是可以的

进程:一个程序运行起来后,代码+用到的资源 称之为进程,它是操作系统分配资源的基本单元。

不仅可以通过线程完成多任务,进程也是可以的

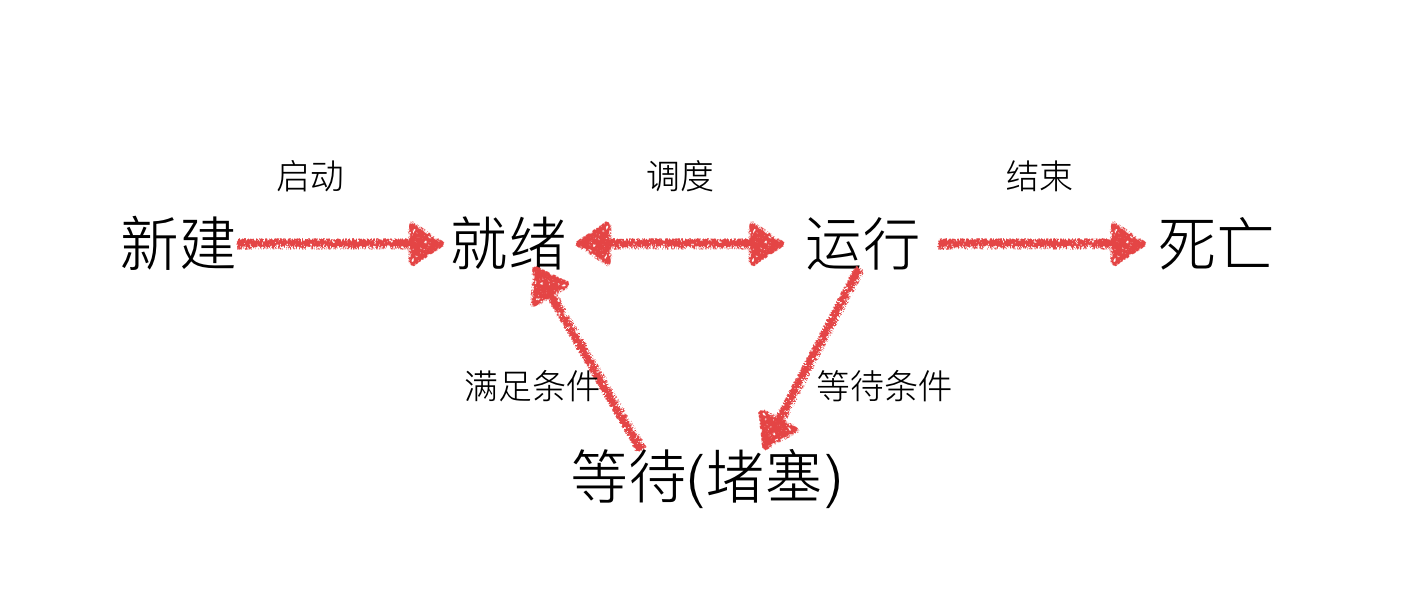

进程的状态

工作中,任务数往往大于cpu的核数,即一定有一些任务正在执行,而另外一些任务在等待cpu进行执行,因此导致了有了不同的状态 就绪态:运行的条件都已经慢去,正在等在cpu执行

执行态:cpu正在执行其功能

等待态:等待某些条件满足,例如一个程序sleep了,此时就处于等待态

进程的创建-multiprocessing

multiprocessing模块就是跨平台版本的多进程模块,提供了一个Process类来代表一个进程对象,这个对象可以理解为是一个独立的进程,可以执行另外的事情

demo

# -*- coding:utf-8 -*-

from multiprocessing import Process

import time

def run_proc():

"""子进程要执行的代码"""

while True:

print("----2----")

time.sleep(1)

if __name__=='__main__':

p = Process(target=run_proc)

p.start()

while True:

print("----1----")

time.sleep(1)

- 创建子进程时,只需要传入一个执行函数和函数的参数,创建一个Process实例,用start()方法启动

进程pid

# -*- coding:utf-8 -*-

from multiprocessing import Process

import os

import time

def run_proc():

"""子进程要执行的代码"""

print('子进程运行中,pid=%d...' % os.getpid()) # os.getpid获取当前进程的进程号

print('子进程将要结束...')

if __name__ == '__main__':

print('父进程pid: %d' % os.getpid()) # os.getpid获取当前进程的进程号

p = Process(target=run_proc)

p.start()Process语法结构如下:

Process([group [, target [, name [, args [, kwargs]]]]])

- target:如果传递了函数的引用,可以任务这个子进程就执行这里的代码

- args:给target指定的函数传递的参数,以元组的方式传递

- kwargs:给target指定的函数传递命名参数

- name:给进程设定一个名字,可以不设定

- group:指定进程组,大多数情况下用不到

Process创建的实例对象的常用方法:

- start():启动子进程实例(创建子进程)

- is_alive():判断进程子进程是否还在活着

- join([timeout]):是否等待子进程执行结束,或等待多少秒

- terminate():不管任务是否完成,立即终止子进程

Process创建的实例对象的常用属性:

- name:当前进程的别名,默认为Process-N,N为从1开始递增的整数

- pid:当前进程的pid(进程号)

Process Josn

demo

from multiprocessing import Process

import time

import random

def test():

for i in range(random.randint(1,5)):

print('-----%d-----'%i)

time.sleep(1)

if __name__ == '__main__':

test = Process(target=test)

test.start()

test.join() #等待

print('----main----')

给子进程指定的函数传递参数

# -*- coding:utf-8 -*-

from multiprocessing import Process

import os

from time import sleep

def run_proc(name, age, **kwargs):

for i in range(10):

print('子进程运行中,name= %s,age=%d ,pid=%d...' % (name, age, os.getpid()))

print(kwargs)

sleep(0.2)

if __name__=='__main__':

p = Process(target=run_proc, args=('test',18), kwargs={"m":20})

p.start()

sleep(1) # 1秒中之后,立即结束子进程

p.terminate()

p.join()

运行结果:

子进程运行中,name= test,age=18 ,pid=45097...

{'m': 20}

子进程运行中,name= test,age=18 ,pid=45097...

{'m': 20}

子进程运行中,name= test,age=18 ,pid=45097...

{'m': 20}

子进程运行中,name= test,age=18 ,pid=45097...

{'m': 20}

子进程运行中,name= test,age=18 ,pid=45097...

{'m': 20}

进程间不同享全局变量

# -*- coding:utf-8 -*-

from multiprocessing import Process

import os

import time

nums = [11, 22]

def work1():

"""子进程要执行的代码"""

print("in process1 pid=%d ,nums=%s" % (os.getpid(), nums))

for i in range(3):

nums.append(i)

time.sleep(1)

print("in process1 pid=%d ,nums=%s" % (os.getpid(), nums))

def work2():

"""子进程要执行的代码"""

print("in process2 pid=%d ,nums=%s" % (os.getpid(), nums))

if __name__ == '__main__':

p1 = Process(target=work1)

p1.start()

p1.join()

p2 = Process(target=work2)

p2.start()

运行结果:

in process1 pid=11349 ,nums=[11, 22] in process1 pid=11349 ,nums=[11, 22, 0] in process1 pid=11349 ,nums=[11, 22, 0, 1] in process1 pid=11349 ,nums=[11, 22, 0, 1, 2] in process2 pid=11350 ,nums=[11, 22]

消息队列

Queue

#coding=utf-8

from multiprocessing import Queue

q=Queue(3) #初始化一个Queue对象,最多可接收三条put消息

q.put("消息1")

q.put("消息2")

print(q.full()) #False

q.put("消息3")

print(q.full()) #True

#因为消息列队已满下面的try都会抛出异常,第一个try会等待2秒后再抛出异常,第二个Try会立刻抛出异常

try:

q.put("消息4",True,2)

except:

print("消息列队已满,现有消息数量:%s"%q.qsize())

try:

q.put_nowait("消息4")

except:

print("消息列队已满,现有消息数量:%s"%q.qsize())

#推荐的方式,先判断消息列队是否已满,再写入

if not q.full():

q.put_nowait("消息4")

#读取消息时,先判断消息列队是否为空,再读取

if not q.empty():

for i in range(q.qsize()):

print(q.get_nowait())

运行结果:

False True 消息列队已满,现有消息数量:3 消息列队已满,现有消息数量:3 消息1 消息2 消息3

说明

初始化Queue()对象时(例如:q=Queue()),若括号中没有指定最大可接收的消息数量,或数量为负值,那么就代表可接受的消息数量没有上限(直到内存的尽头);

Queue.qsize():返回当前队列包含的消息数量;

Queue.empty():如果队列为空,返回True,反之False ;

Queue.full():如果队列满了,返回True,反之False;

Queue.get([block[, timeout]]):获取队列中的一条消息,然后将其从列队中移除,block默认值为True;

1)如果block使用默认值,且没有设置timeout(单位秒),消息列队如果为空,此时程序将被阻塞(停在读取状态),直到从消息列队读到消息为止,如果设置了timeout,则会等待timeout秒,若还没读取到任何消息,则抛出"Queue.Empty"异常;

2)如果block值为False,消息列队如果为空,则会立刻抛出"Queue.Empty"异常;

Queue.get_nowait():相当Queue.get(False);

Queue.put(item,[block[, timeout]]):将item消息写入队列,block默认值为True;

1)如果block使用默认值,且没有设置timeout(单位秒),消息列队如果已经没有空间可写入,此时程序将被阻塞(停在写入状态),直到从消息列队腾出空间为止,如果设置了timeout,则会等待timeout秒,若还没空间,则抛出"Queue.Full"异常;

2)如果block值为False,消息列队如果没有空间可写入,则会立刻抛出"Queue.Full"异常;

- Queue.put_nowait(item):相当Queue.put(item, False);

Queue实例

我们以Queue为例,在父进程中创建两个子进程,一个往Queue里写数据,一个从Queue里读数据:

from multiprocessing import Process, Queue

import os, time, random

# 写数据进程执行的代码:

def write(q):

for value in ['A', 'B', 'C']:

print('Put %s to queue...' % value)

q.put(value)

time.sleep(random.random())

# 读数据进程执行的代码:

def read(q):

while True:

if not q.empty():

value = q.get(True)

print('Get %s from queue.' % value)

time.sleep(random.random())

else:

break

if __name__=='__main__':

# 父进程创建Queue,并传给各个子进程:

q = Queue()

pw = Process(target=write, args=(q,))

pr = Process(target=read, args=(q,))

# 启动子进程pw,写入:

pw.start()

# 等待pw结束:

pw.join()

# 启动子进程pr,读取:

pr.start()

pr.join()

# pr进程里是死循环,无法等待其结束,只能强行终止:

print('')

print('所有数据都写入并且读完')

进程和线程的区别

优缺点

线程和进程在使用上各有优缺点:线程执行开销小,但不利于资源的管理和保护;而进程正相反。

同步与异步

同步交互:指发送一个请求,需要等待返回,然后才能够发送下一个请求,有个等待过程;异步交互:指发送一个请求,不需要等待返回,随时可以再发送下一个请求,即不需要等待。 区别:一个需要等待,一个不需要等待,在部分情况下,我们的项目开发中都会优先选择不需要等待的异步交互方式。

进程池Pool

当需要创建的子进程数量不多时,可以直接利用multiprocessing中的Process动态成生多个进程,但如果是上百甚至上千个目标,手动的去创建进程的工作量巨大,此时就可以用到multiprocessing模块提供的Pool方法。

初始化Pool时,可以指定一个最大进程数,当有新的请求提交到Pool中时,如果池还没有满,那么就会创建一个新的进程用来执行该请求;但如果池中的进程数已经达到指定的最大值,那么该请求就会等待,直到池中有进程结束,才会用之前的进程来执行新的任务,

demo

# -*- coding:utf-8 -*-

from multiprocessing import Pool

import os, time, random

def worker(msg):

t_start = time.time()

print("%s开始执行,进程号为%d" % (msg,os.getpid()))

# random.random()随机生成0~1之间的浮点数

time.sleep(random.random()*2)

t_stop = time.time()

print(msg,"执行完毕,耗时%0.2f" % (t_stop-t_start))

po = Pool(3) # 定义一个进程池,最大进程数3

for i in range(0,10):

# Pool().apply_async(要调用的目标,(传递给目标的参数元祖,))

# 每次循环将会用空闲出来的子进程去调用目标

po.apply_async(worker,(i,))

print("----start----")

po.close() # 关闭进程池,关闭后po不再接收新的请求

po.join() # 等待po中所有子进程执行完成,必须放在close语句之后

print("-----end-----")执行结果

----start---- 0开始执行,进程号为21466 1开始执行,进程号为21468 2开始执行,进程号为21467 0 执行完毕,耗时1.01 3开始执行,进程号为21466 2 执行完毕,耗时1.24 4开始执行,进程号为21467 3 执行完毕,耗时0.56 5开始执行,进程号为21466 1 执行完毕,耗时1.68 6开始执行,进程号为21468 4 执行完毕,耗时0.67 7开始执行,进程号为21467 5 执行完毕,耗时0.83 8开始执行,进程号为21466 6 执行完毕,耗时0.75 9开始执行,进程号为21468 7 执行完毕,耗时1.03 8 执行完毕,耗时1.05 9 执行完毕,耗时1.69 -----end-----

进程池的使用

import time, multiprocessing, sys

#复制任务

def copy_work():

print('正在复制。。。', multiprocessing.current_process())

time.sleep(1)

if __name__ == '__main__':

pool = multiprocessing.Pool(3)

for i in range(10):

#同步模式

#pool.apply(copy_work)

#异步模式

pool.apply_async(copy_work)

pool.close()

pool.join()

进程等待

XXX.wait()

进程池实例

import multiprocessing, time, os

# 复制服务

def copy_work(name):

#构建文件夹目录结构

print(multiprocessing.current_process())

old = 'old' + '/' + name

new = 'new' + '/' + name

#打开目标复制文件

old_open = open(old, 'r')

#新建copy文件

new_open = open(new, 'w')

#循环读取与写入

while True:

old_f = old_open.read(1024)

if old_f:

new_open.write(old_f)

else:

break

# 程序入口

if __name__ == '__main__':

old_name = input('请输入copy目标文件夹名称')

name_list = os.listdir(old_name)

#print(name_list) # 测试使用

#循环遍历取其中中的文件名称

pool = multiprocessing.Pool(3)

#for i in range(3):

for name in name_list:

pool.apply_async(copy_work, args=(name, ))

pool.close()

pool.join()