阵列的瓶颈主要体现在2个方面,带宽与IOPS(单位时间传输的数据量,和单位时间完成的I/O数)。

带宽:

存储系统的带宽主要取决于阵列的构架,光纤通道的大小以及硬盘的个数。

所谓阵列构架影响存储系统带宽,指的是存储系统内部架构会存在一些内部带宽,类似于PC的系统总线,尽管阵列的构架因不同厂商不同型号的产品而各有不同,不过一般情况下,内部带宽都设计的很充足,不会是瓶颈的所在。

光纤通道对带宽的影响还是比较大的,例如数据仓库环境中,对数据的流量要求很大,而一块2Gb的光纤卡,所能支撑的最大流量应当是2GB/8=250Mb/s的实际流量,必须配备4块光纤卡才能达到1Gb/s的实际流量,所以对于数据仓库的环境来说,升级到光纤4Gb并非是厂商过于超前的产品更新,在大流量的数据环境下绝对有必要考虑更换4GB的光纤卡。

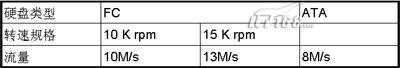

但是对于存储系统的带宽来说,硬盘接口的带宽限制是最重要的。当前面的瓶颈不再存在的时候,带宽就完全取决于硬盘的个数了,我下面列一下不同规格的硬盘所能支撑的流量大小,数据取自硬盘厂商的标准参数:

如果我们假定一个阵列有120块15K rpm转速的光纤硬盘,那么硬盘上最大的可以支撑的数据流量为120*13=1560Mb/s,当前端接口不成为瓶颈的时候,1560Mb/s就是理论上的最大数据流量。

而如果要实现上述的最大带宽,如果前端采用2GB的光纤卡,可能需要配置6块才能够,而4GB的光纤卡,配置3-4块就够了。因此我们可以知道,前端的光纤接口必须与后端磁盘个数相匹配。

IOPS:

决定IOPS的主要因素取决于阵列的算法,cache命中率,以及磁盘个数。

阵列的算法也因为不同厂商不同型号的产品而不同,如我们最近遇到在HDS USP上面,可能因为ldev(lun)存在队列或者资源限制,而单个ldev的IOPS就上不去。所以,决定采购某型号的存储之前,有必要了解这个存储的一些算法规则与限制。

cache命中率对实际IOPS有决定性的影响,Cache命中率取决于数据的分布,cache size的大小,数据访问的规则,以及cache的算法,如果完整的讨论下来,这里将变得很复杂,可以有一天来慢慢讨论。

我们这里把这些内部原理都省略掉,只强调:对于一个存储阵列来说,读cache的命中率越高,一般就表示它可以支持更多的IOPS,为什么这么说呢?这个就与我们下面要讨论的硬盘IOPS有关系了。

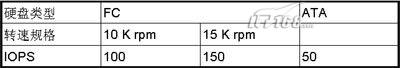

每个物理硬盘能处理的IOPS是有限制的,如

同样,如果一个阵列有120块15K rpm转速的光纤硬盘,那么,它能支撑的最大IOPS为120*150=18000,这个为硬件限制的理论值,如果超过这个值,硬盘的响应可能会变的非常缓慢而不能正常提供业务。较高的读cache命中率,能降低硬盘的IOPS负荷,让硬盘在较小的压力下良好工作。

RAID5与RAID10的不同机制上,读数据时,IOPS性能其实没有差别。但是,相同的业务,在写入数据时,采用不同的RAID机制最终落在磁盘上的IOPS是有差别的,我们评估的正是磁盘的整体IOPS,如果达到了磁盘的限制,性能肯定是上不去了。

那我们假定一个case,业务应用的IOPS是10000,读cache命中率是30%,读IOPS为60%,写IOPS为40%,磁盘个数为120,那么分别计算在RAID5与RAID10的情况下,每个磁盘的IOPS为多少。

RAID5:

1. 单块盘的IOPS = (10000*(1-0.3)*0.6 + 4 * (10000*0.4))/120

2. = (4200 + 16000)/120

3. = 168

这里的10000*(1-0.3)*0.6表示是读的IOPS,比例是0.6,除掉cache命中,实际只有4200个读IOPS。

而4 * (10000*0.4) 表示写的IOPS,因为每一个写,在RAID5中,实际发生了4个io,所以写的IOPS为16000个。

为了考虑RAID5在写操作的时候,那2个读操作也可能发生命中,所以更精确的计算应该为:

1. 单块盘的IOPS = (10000*(1-0.3)*0.6 + 2 * (10000*0.4)*(1-0.3) + 2 * (10000*0.4))/120

2. = (4200 + 5600 + 8000)/120

3. = 148

这样我们计算出来单个盘的IOPS为148个,基本达到磁盘IOPS极限,在这种情况下,磁盘的工作状态是非常不理想的。

RAID10对IOPS性能的影响

1. 单块盘的IOPS = (10000*(1-0.3)*0.6 + 2 * (10000*0.4))/120

2. = (4200 + 8000)/120

3. = 102

可以看到,因为RAID10对于一个写操作,只发生2次io,所以,同样的压力,同样的磁盘,每个盘的IOPS只有102个,还远远低于磁盘的极限IOPS。

这里回到我们先前讨论的case上来,在我们先前采用RAID5的时候,通过分析,每个磁盘的IOPS在高峰时期,快达到200了,导致响应速度巨慢无比。改造成RAID10,每个磁盘的IOPS降到100左右,很好的避免了这个性能问题。

因此,我们可以得出结论:

影响读数据的关键因素是cache命中率,在读数据的情况下,RAID5与RAID10性能本身没有太大差别。但是对于写数据的一些应用,尤其是小I/O频繁写入的一些应用,如企业ERP生产系统等等,RAID10相比RAID5可能产生较大的性能差异。而大型文件存储,数据仓库,如医疗PACS系统、视频编辑系统则从空间利用的角度,建议采用RAID5。