neirhttps://zhuanlan.zhihu.com/p/42417456

https://stackoverflow.com/questions/47781375/tensorflow-dataset-shuffle-large-dataset?rq=1

https://github.com/tensorflow/tensorflow/issues/14857 大文件shuffle

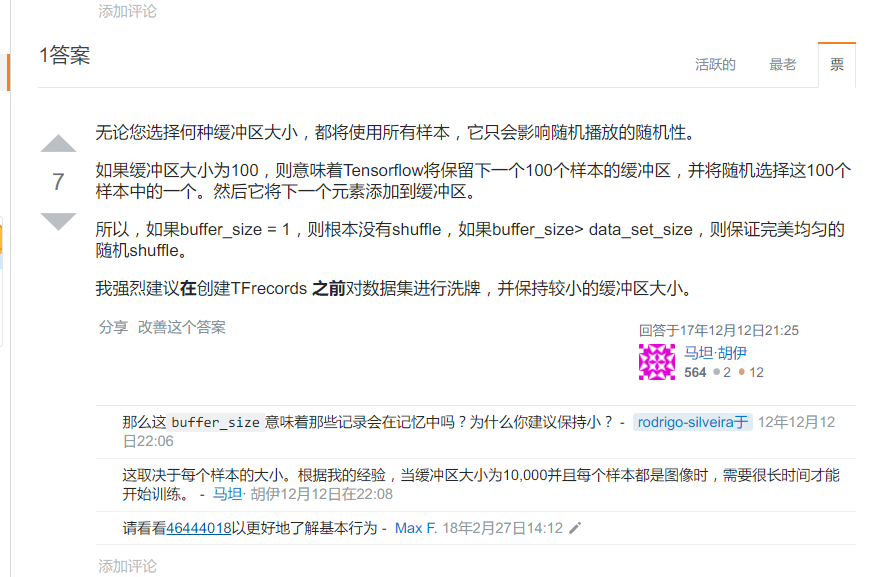

说了那么多简单一句总结就是shuffle的buffer_size控制着随机程度,buffer_size等于1时完全按原顺序,

buffer_size等于样本数应该就是完全随机了(均匀)

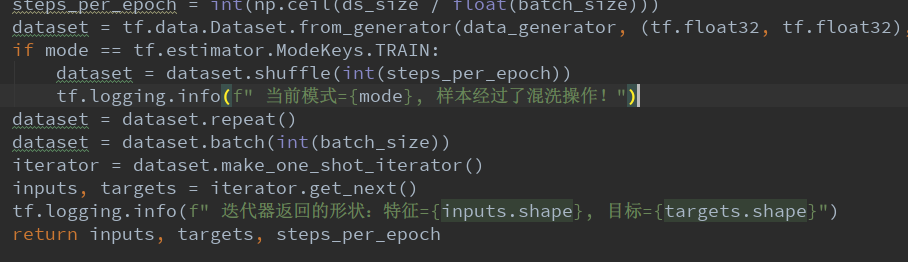

1. 以下这种方式很占内存,分批之后将所有批次放入缓冲区shuffle。

2. 这种方式没有那么消耗内存,说明了两种方式的不同