前言

做SLAM或是CV方向的应该大都接触过TUM提供的各种数据集,如RGBD数据集、单目数据集等。最近TUM发布了关于VIO即视觉惯性状态估计的对应数据集,成为了继飞行数据集EuRoc、MAV、车辆数据集Kitti等之后的又一个常用大型数据集。

本博客将就其数据集的论文《The TUM VI Benchmark for Evaluating Visual-Inertial Odometry》对TUM VIO数据集进行简要介绍,并用VINS跑跑看。

数据集链接:https://vision.in.tum.de/data/datasets/visual-inertial-dataset

摘要

视觉里程计和SLAM方法在诸如AR或机器人之类的领域中具有广泛的应用。惯性测量辅助视觉传感器极大地提高了跟踪精度和鲁棒性,引发了对视觉惯性(VI)里程计开发的极大兴趣。在本文中,我们提出了TUM VI基准测试集,这是一种新颖的数据集,在不同的场景中具有多种序列,用于评估VIO。它提供具有1024x1024分辨率,20 Hz,高动态范围和光度校准的相机图像。 IMU以200 Hz的频率测量3个轴上的加速度和角速度,而摄像机和IMU传感器在硬件中进行时间同步。对于轨迹评估,我们还在序列的开始和结束处以高频率(120 Hz)从运动捕捉系统中提供准确的姿态地面真值,我们准确地将其与摄像机和IMU测量对准。具有原始数据和校准数据的完整数据集可公开获取。我们还在数据集上评估了最先进的VIO方法。

相关工作

表I介绍了包含视觉和IMU数据的最相关数据集。

The EuRoC MAV、PennCOSYVIO 、Zurich Urban MAV等数据集并不包含光度校准,也不包含IMU和相机图像的准确ground truth(即真值)或时间同步,而TUM的基准测试集就具备。

传感器设置与校准参数

如图2,传感器设置包括两个单色相机组成的深度相机和IMU。左图显示了所有相关坐标系的示意图。 我们规定:位姿变换矩阵 SE(3)表示从A坐标系 到B坐标系 的变换。对于坐标系,使用以下缩写:

| 缩写 | 含义 |

|---|---|

| I | IMU |

| C0 | camera 0 |

| C1 | camera 1 |

| M | IR-reflective markers |

| G | grid of AprilTags |

| W | world frame(reference frame of MoCap system) |

Time Alignment, Hand-Eye Calibration, IMU Axis Scaling and Misalignment

T_i_c0:

-0.999506 0.00759167 -0.030488 0.0447659

0.0302105 -0.0343071 -0.998955 -0.0755245

-0.00862969 -0.999383 0.0340608 -0.0465419

0 0 0 1

T_i_c1:

-0.999497 0.00813335 -0.0306525 -0.0561178

0.0307588 0.0132798 -0.999439 -0.0738562

-0.00772172 -0.999879 -0.0135233 -0.0494102

0 0 0 1

T_w_moc:

-0.999641 0.0266075 -0.00313757 0.146549

-0.00698843 -0.145899 0.989275 -0.192952

0.0258644 0.988942 0.146032 0.766471

0 0 0 1

T_mark_i:

0.99975 -0.0167084 0.0148858 -0.0105073

0.0166986 0.99986 0.000784897 -0.0596456

-0.0148968 -0.00053613 0.999889 -0.0389606

0 0 0 1

cam_time_offset_ns: 126788

mocap_time_offset_ns: -6022600

accel_bias: -1.30318 -0.391441 0.380509

accel_scale:

1.00422 0 0

-7.82123e-05 1.00136 0

-0.0097745 -0.000976476 0.970467

gyro_bias: 0.0283122 0.00723077 0.0165292

gyro_scale:

0.943611 0.00148681 0.000824366

0.000369694 1.09413 -0.00273521

-0.00175252 0.00834754 1.01588

IMU参数校准

rostopic: /imu0

update_rate: 200.0 # Hz

# Values from allan plots

# sequence: dataset-calib-imu-static2.bag (full data range)

#accelerometer_noise_density: 0.0014 # m/s^1.5

#accelerometer_random_walk: 0.000086 # m/s^2.5

#gyroscope_noise_density: 0.000080 # rad/s^0.5

#gyroscope_random_walk: 0.0000022 # rad/s^1.5

# Inflated values (to account for unmodelled effects)

# Those values work well with Kalibr cam-imu calibration.

# - white noise multiplied by 2

# - bias random walk multiplied by 10

accelerometer_noise_density: 0.0028 # m/s^1.5

accelerometer_random_walk: 0.00086 # m/s^2.5

gyroscope_noise_density: 0.00016 # rad/s^0.5

gyroscope_random_walk: 0.000022 # rad/s^1.5

数据集

序列

校准序列

- calib-cam

用于校准相机内参和深度相机的外参。 以低帧速率记录了AprilTags网格,其中视角和摄像机运动变化较小。 - calib-imu

用于cam-imu校准以找到相机和IMU之间的相对位姿。 包括激发所有6个自由度April网格前的快速运动。 选择短时曝光以避免运动模糊。 - calib-vignette

用于晕影校准。 带有校准标签的特征运动在白墙前方。 - imu-static

只有IMU数据以估算噪声和随机游走参数(静止111小时)。

数据集序列

- room

房间内带有运动捕捉系统的序列,可以在整个轨迹中提供 ground truth。 - corridor

走廊和几个办公室中的序列,可以为开始和结束段提供 ground truth。 - magistrale

在大学建筑的中央大厅移动的序列,开始和结束段提供ground truth。 - outdoors

在大学校园外移动的序列,开始和结束段提供ground truth。 - slides

在大学建筑的中央大厅移动的序列,其中小部分在没有视觉特征的封闭管中运动,开始和结束段提供ground truth。

格式

1)ROS Bag Files

对于每个序列,我们提供三种不同的ROS包文件,原始包和两种校准包。

原始包包含在手眼标定、时移或IMU校准之前已记录的数据。 它们包括以下topic:

/cam0/image raw

/cam1/image raw

/imu0

/vrpn client/raw transform

前两个包含有相机的图像。 消息中的大多数字段都是一目了然的并遵循标准约定。但请注意frame_id提供以纳秒为单位的曝光时间。

在IMU topic中,我们没有给出方向,但我们使用orientation covariance的第二项来提供IMU的摄氏度温度。 最后一个topic包含原始动作捕捉位姿TWM。 对于每个位姿,动作捕捉时间中都有一个时间戳,一个平移向量和一个旋转四元数。

校准包包含与原始包相同的主题,但具有校准数据。 不同之处是:

1、动作捕捉位姿已与IMU坐标系对齐(通过手眼校准,TWI)

2、使用中值滤波器移除动作捕捉位姿的异常值

3、通过使用时移校准,动作捕捉位姿的时间戳与IMU时间同步

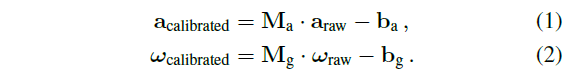

4、IMU数据已根据以下两式进行处理

提供两种校准包:一种具有全分辨率,一种具有四分之一分辨率(每个尺寸的半分辨率)。 下采样版本有助于使用存储或带宽受限制的用户。

其中校准包下载地址:

Bag 1024×1024: http://vision.in.tum.de/tumvi/calibrated/1024_16/

Bag 512×512: http://vision.in.tum.de/tumvi/calibrated/512_16/

评估结果

下表为使用TUM的基准数据集来评估最先进的单目和双目视觉惯性方法的性能。

我的实验

TUM的网站上并没有提供VINS的配置文件,原本以为还需要自己写,后来发现最新的VINS-Mono已经配置好了图像下采样版本的yaml,直接用就可以。这里我使用了corridor4的校准数据集,因为其最小。

roslaunch vins_estimator tum.launch

roslaunch vins_estimator vins_rviz.launch

rosbag play /home/your path/dataset/dataset-corridor4_512_16.bag

运行结果图

过程中可以看到设备在一个房间中乱晃,然后经过一条长走廊再往回走,最后仍能回到最初的房间。

这个是TUM对corridor4使用不同的VIO算法得到的轨迹图。

接下来还需要再研究一下如何与动作捕捉的 ground truth以衡量误差。