苹果最近公开如何用AI技术,结合6个喇叭,让HomePod听的更清楚,HomePod为居家型智能音响,为了要让使用者能够在家中的环境,随时呼叫语音助理,并得到正确的回复,苹果针对HomePod,导入AI技术来优化HomePod语音助理Siri的表现。一般的语音环境对HomePod的语音服务来说,有许多挑战,包含回音、噪音和声音反射,与手机上的语音助理Siri不同,用户在唤醒HomePod的语音服务时,并不会像叫Siri一样,这么贴近手机,因此,HomePod的语音服务就必须能够清楚地接收到远距离的声音,并且正确辨识语音指令,给予用户响应。

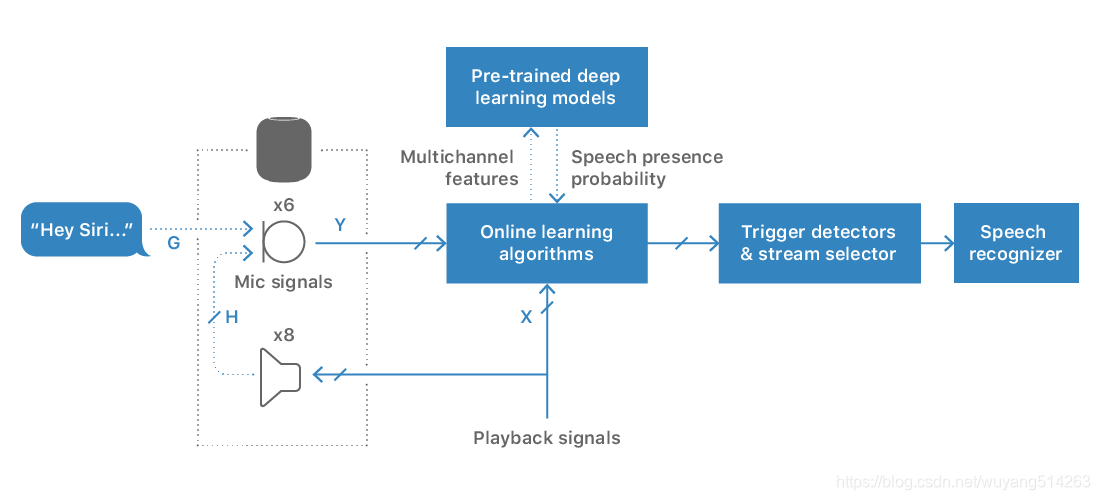

为了达到此目标,苹果语音软件工程团队和Siri语音团队,共同建立了一套系统,整合了监督式深度学习模型,以及处理多种麦克风讯号的非监督式在线学习算法,该系统利用「Hey Siri」特定词组侦测器的知识,从语音识别器中,萃取优化的语音串流,再透过采用机器学习的在线学习算法,来处理在线语音讯号,同时还得确保系统运行的效能和可用性。由于HomePod可以让用户在播放音乐的同时,呼叫Siri,且置放于使用者家中的任一位置,因此HomePod语音识别需要处理的场景包括大声的背景音乐、远距离的语音和屋内其他噪音,像是吸尘器、吹风机、微波炉、电视的声音等,在这些情况之下,Siri要正确辨识语音内容和给予响应,就要能够有效地处理这些声音讯息。更多人工智能AI新闻:胜博发爱心公益 http://chiayuan.org.tw/

针对回音和背景声音的部分,苹果研究团队透过深度学习技术,建立基于屏蔽的多通道过滤器,来移除回音和背景噪音,而在播放音乐同时,用户突然插入的语音命令,则是透过非监督式学习,将同步语音来源和触发语音服务词组分开,进而辨识插入的语音信息。首先,系统是透过6个麦克风接收环境中的声音,在苹果A8的芯片上,让HomePod在低功耗的状态下,不断地处理多信道的声音讯息,来节省电量消耗,其中,多通道声音过滤器会不断调整,来适应环境中改变的噪音条件和移动的说话者。为了能够去除环境中的回音和抑制噪音,过去,苹果透过语音强化系统,来学习目标和非目标声音讯号特征,加上深度学习技术,语音强化系统的学习最近得到很大的进展,举例来说,系统透过深度神经网络学习目标语音的概率,再触发多信道噪音过滤器将目标噪音去除,但是,这样的做法还是有点不切实际,因为声音的条件不可预测,语音命令开始和结束的信息,也无法事先取得。

由于麦克风与喇叭距离远近的关系,回音的分贝会比在远处呼叫Siri的声音,大30~40分贝,导致在播放音乐时,触发语音服务侦测器无法正常辨识到唤醒词,现在,苹果导入多信道回音消除算法(Multichannel Echo Cancellation),透过一系列的线性适应过滤器,将多种声音在喇叭和麦克风之间路径建模,来消除声音的耦合,不过,因为非线性耦合和非单一讯号的问题,经过回音消除算法处理后,残留的背景噪音还是比远处的语音大10~20分贝,因此,还需要加入残留回音抑制器(residual echo suppressor)来处理剩下的背景噪音。残留回音抑制器是用来处理非线性回音频号,而这些非线性的讯号并没在回音消除算法中,残留回音抑制器甚至能平缓线性回音,尤其是在重复说话和回音路径改变的情况下。一般回音抑制方法会萃取输入信息的特征,将回音消除的讯号抑制,苹果的作法则是用深度神经网络处理多种不同的输入和输出信息。