前言:大家好,我是覃秉丰,又在周二和大家见面了。继我们上周介绍的①机器学习;②人工智能,机器学习,神经网络以及深度学习之间的关系;③深度学习应用;④神经网络发展史这四小节内容后,今天我们要介绍的是深度学习领域的几个重要人物,你可以称他们为深度学习界的“四大天王”。

1.5深度学习领域重要人物

深度学习领域有很多做出过卓越贡献的大师,下面简单介绍几位。

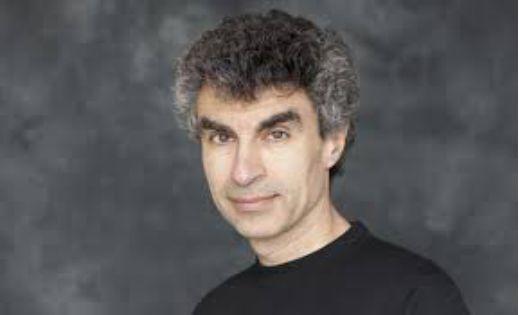

Geoffrey Hinton:

英国出生的计算机学家和心理学家,以其在神经网络方面的贡献闻名。Hinton是反向传播算法和对比散度算法的发明人之一,也是深度学习的积极推动者。目前担任多伦多大学计算机科学系教授。

2013年3月加入Google,领导Google Brain项目。

Hinton被人们称为“深度学习教父”,可以说是目前对深度学习领域影响最大的人。而且如今在深度学习领域活跃的大师,有很多都是他的弟子,可以说是桃李满天下。图1.25为Geoffrey Hinton。

Yann LeCun:

法国出生的计算机科学家,他最著名的工作是光学字符识别和计算机视觉上使用卷积神经网络(CNN),他也被称为卷积网络之父。

曾在多伦多大学跟随Geoffrey Hinton做博士后。1988年加入贝尔实验室,在贝尔实验室工作期间开发了一套能够识别手写数字的卷积神经网络系统,并把它命名为LeNet。这个系统能自动识别银行支票。

2003年去了纽约大学担任教授,现在是纽约大学终身教授。

2013年12月加入了Facebook,成为Facebook人工智能实验室的第一任主任。图1.26为Yann LeCun。

Yoshua Bengio:

毕业于麦吉尔大学,在MIT和贝尔实验室做过博士后研究员,自1993年之后就在蒙特利尔大学任教。在预训练问题,自动编码器降噪等领域做出重大贡献。

Hinton、LeCun和Bengio被人们称为“深度学习三巨头”。这“三巨头”中的前两人早已投身工业界,而Bengio仍留在学术界教书,他曾说过:“我留在学术圈为全人类作贡献,而不是为某一公司赚钱”。

2017年初Bengio选择加入微软成为战略顾问。他表示不希望有一家或者两家公司(他指的显然是Google和Facebook)成为人工智能变革中的唯一大玩家,这对研究社区没有好处,对人类也没有好处。图1.27为Yoshua Bengio。

Andrew Ng(吴恩达):

吴恩达是美籍华人,曾经是斯坦福大学计算机科学系和电气工程系的副教授,斯坦福人工智能实验室主任。他还与Daphne Koller一起创建了在线教育平台Coursera。

2011年,吴恩达在Google创建了Google Brain项目,通过分布式集群计算机开发超大规模的人工神经网络。

2014年5月,吴恩达加入百度,负责百度大脑计划,并担任百度公司首席科学家。

2017年3月,吴恩达从百度离职。图1.28为吴恩达。

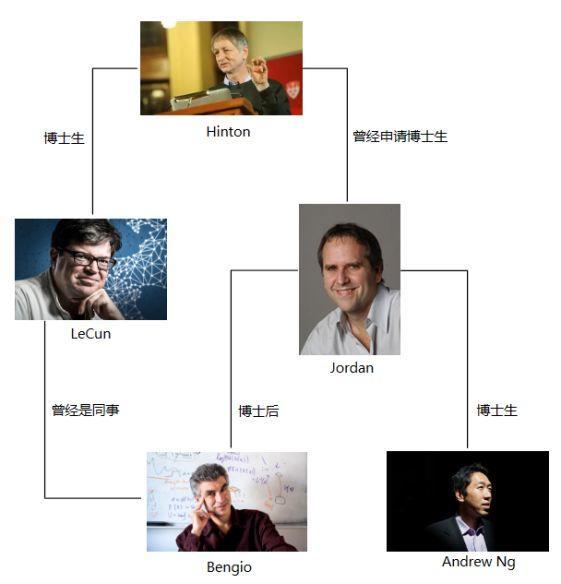

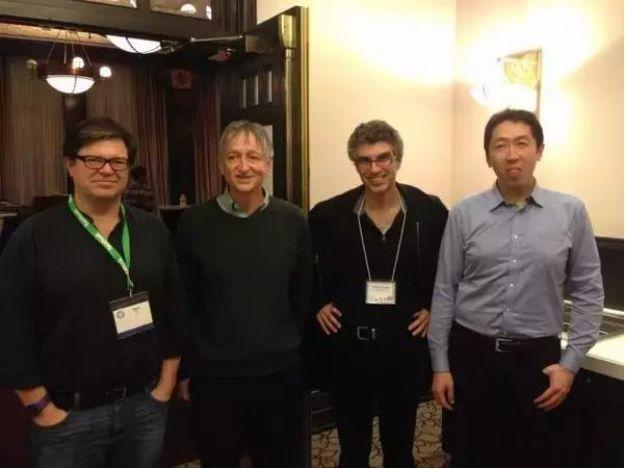

LeCun是Hinton的博士生,另一位人工智能大师Jordan曾经申请过Hinton的博士生,Bengio是Jordan的博士后,Andrew Ng是Jordan的博士生,LeCun与Bengio曾经是同事。这几位大师互相之间有着很深的渊源。图1.29为人物关系图,图1.30为LeCun、Hinton、Bengio和Andrew Ng的合照。

1.6新一轮人工智能爆发的三要素

这一轮人工智能大爆发的主要原因有3个,深度学习算法,大数据,以及高性能计算。

深度学习算法—— 之前人工智能领域的实际应用主要是使用传统的机器学习算法,虽然这些传统的机器学习算法在很多领域都取得了不错的效果,不过仍然有非常大的提升空间。深度学习出现后,计算机视觉,自然语言处理,语音识别等领域都取得了非常大的进步。

大数据 —— 如果把人工智能比喻成一个火箭,那么这个火箭需要发射升空,它的燃料就是大数据。以前在实验室环境下很难收集到足够多的样本,现在的数据相对以前在数量、覆盖性和全面性方面都获得了大幅提升。一般来说深度学习模型想要获得好的效果,就需要把大量的数据放到模型中进行训练。

高性能计算 —— 以前高性能计算大家用的是CPU集群,现在做深度学习都是用GPU,或者GPU集群。想要使用大量的数据来训练复杂的深度学习模型那就必须要具备高性能计算能力。如果只是使用几个CPU来训练一个复杂模型可能会需要花费几周甚至几个月的时间。把数百块GPU连接起来做成集群,用这些集群来训练模型,原来一个月才能训练出来的网络,可以加速到几个小时就能训练完,可以大大减少模型训练时间。

写在最后的话:如果你也是个深度学习爱好者,或者有任何的疑问,可以加我的个人微信号:sdxxqbf 。

独家连载系列文传送门:

深度学习从0到1(1)

深度学习从0到1(2)