开源实时日志分析ELK平台能够完美的解决我们上述的问题,ELK由ElasticSearch、Logstash和Kiabana三个开源工具组成。

官方网站:https://www.elastic.co/products

-

Elasticsearch是个开源分布式搜索引擎,它的特点有:分布式,零配置,自动发现,索引自动分片,索引副本机制,restful风格接口,多数据源,自动搜索负载等。

-

Logstash是一个完全开源的工具,他可以对你的日志进行收集、过滤,并将其存储供以后使用(如,搜索)。

-

Kibana 也是一个开源和免费的工具,它Kibana可以为 Logstash 和 ElasticSearch 提供的日志分析友好的 Web 界面,可以帮助您汇总、分析和搜索重要数据日志。

ELK下载:https://www.elastic.co/downloads/

ELK工作原理:

ElasticSearch

配置ElasticSearch:

| 1 2 |

|

然后编辑ES的配置文件:

| 1 |

|

修改以下配置项:

| 1 2 3 4 5 6 7 |

|

其他的选项保持默认,然后启动ES:

| 1 |

|

注意:

1.需要添加用户elk,ES不能以root用户进行启动

2.可能出现的错误:

- max file descriptors [4096] for elasticsearch process likely too low, increase to at least [65536]

| 1 2 3 |

|

- max number of threads [1024] for user [work] likely too low, increase to at least [2048]

| 1 2 3 4 |

|

- max virtual memory areas vm.max_map_count [65530] likely too low, increase to at least [262144]

| 1 2 3 4 5 |

|

- 另外再配置ES的时候,threadpool.bulk.queue_size 已经变成了thread_pool.bulk.queue_size ,ES_HEAP_SIZE,ES_MAX_MEM等配置都变为ES_JAVA_OPTS这一配置项,如限制内存最大最小为1G:

| 1 |

|

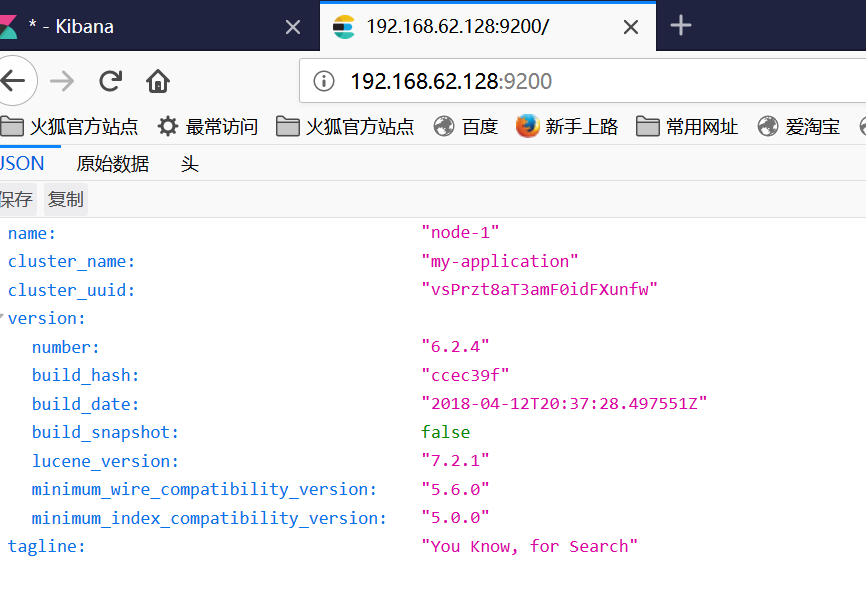

然后可以打开页面http://node1:9200/,将会看到以下内容:(我是通过外部访问虚拟机,因此为了简单没有配置host文件,直接用ip访问)

Logstash

配置Logstash:

| 1 2 |

|

编写配置文件(名字和位置可以随意,这里我放在config目录下,取名为log_app.conf):

| 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 |

|

其他的选项保持默认,然后启动Logstash:

| 1 2 |

|

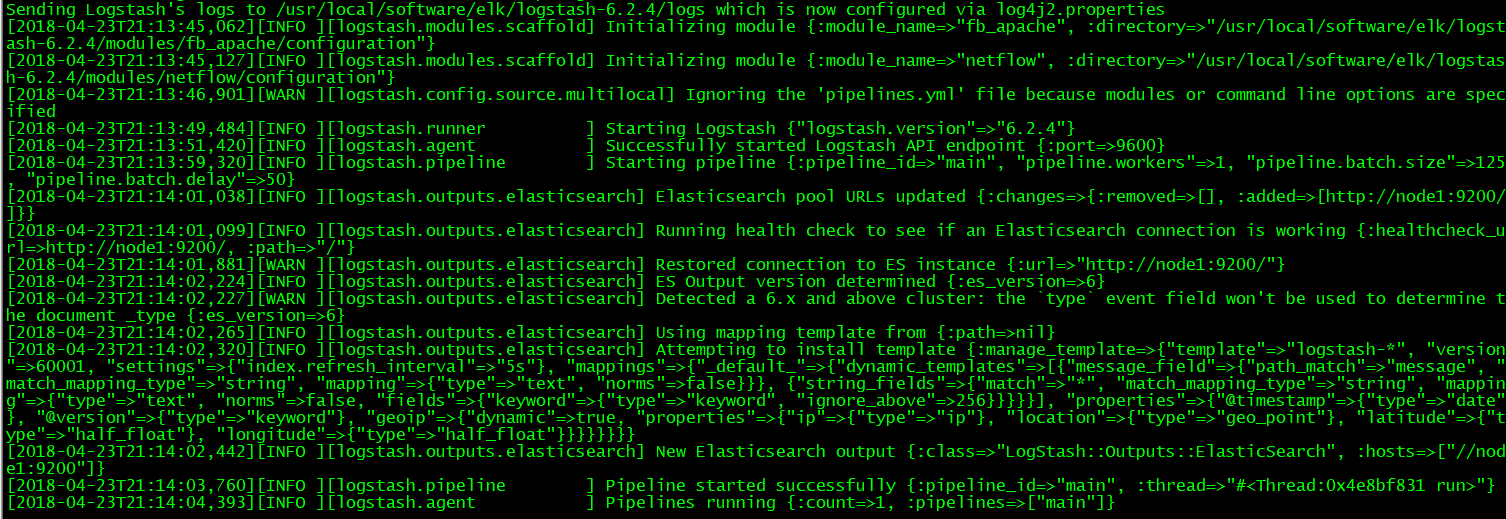

日志:

Kibana

配置Kibana:

| 1 2 |

|

修改以下几项(由于是单机版的,因此host的值也可以使用localhost来代替,这里仅仅作为演示):

| 1 2 3 4 |

|

启动kibana:

| 1 |

|

启动后界面:

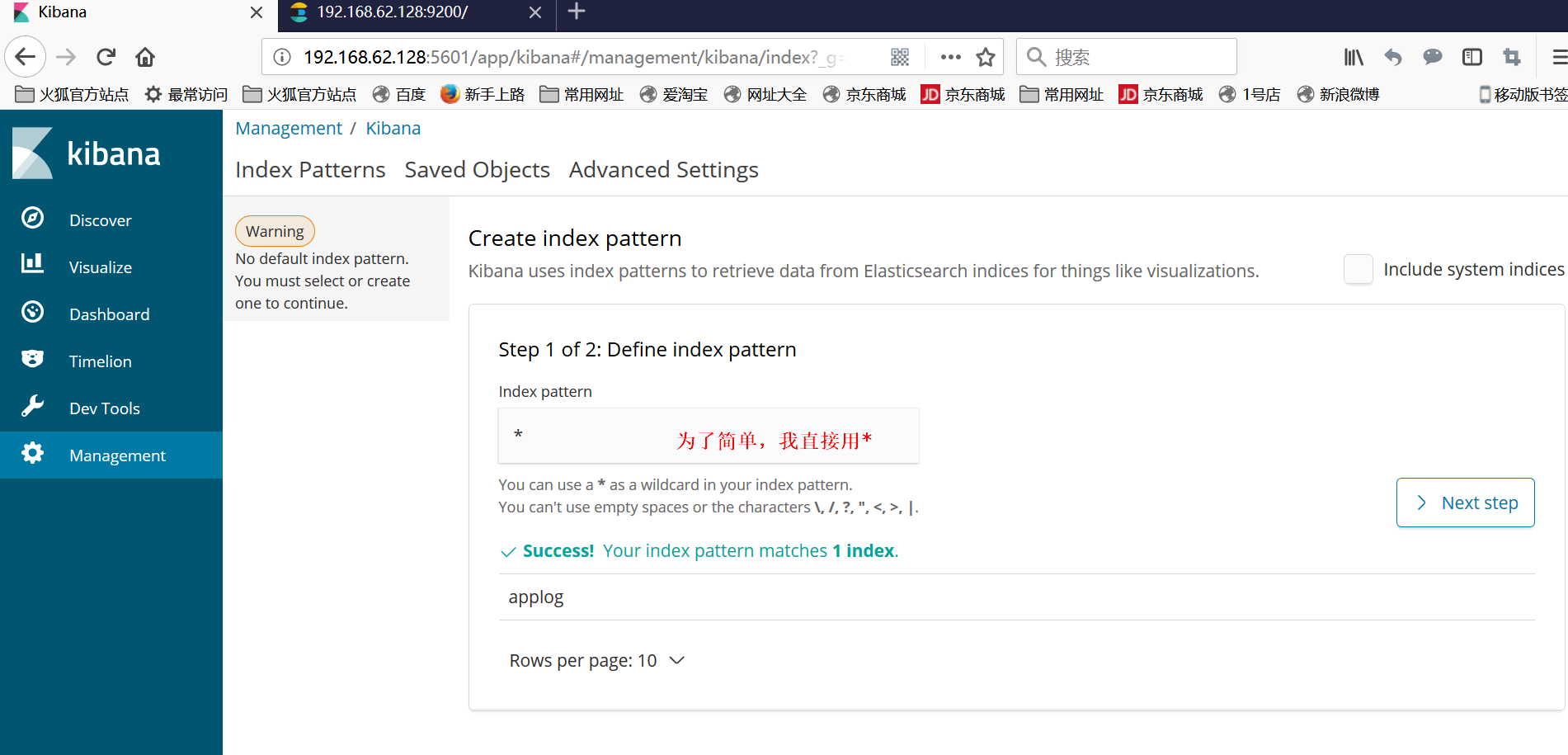

然后需要创建index,步骤如下:

①点击左边iscover出现以下界面

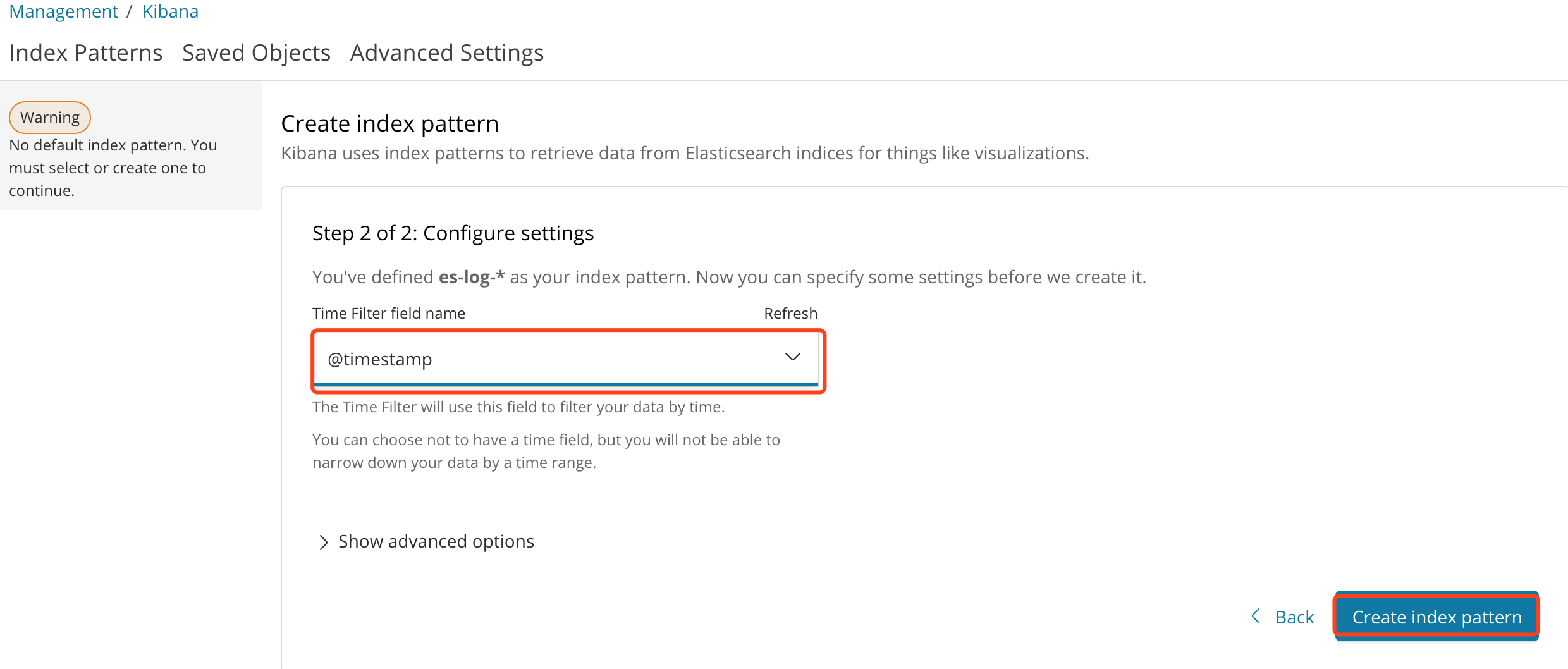

②按照注释配置,然后点击Next step,在第二页 选择@timestamp点击create创建

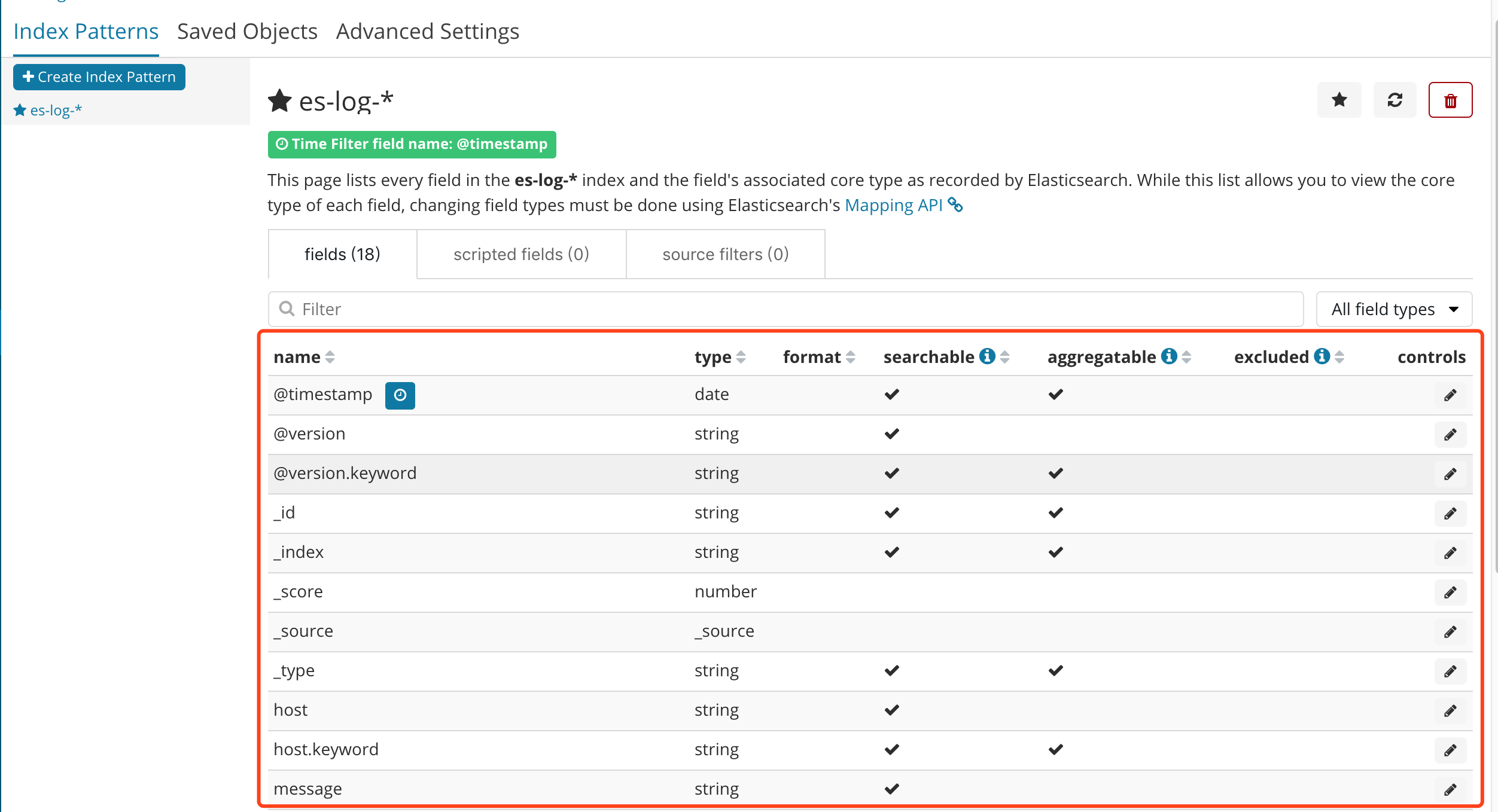

③创建完成之后,可以看到以下一个界面,红框内是 自动生成的域,也可以理解为 跟数据库中的字段类似,其中有一个message字段,就是我们想要的日志信息。

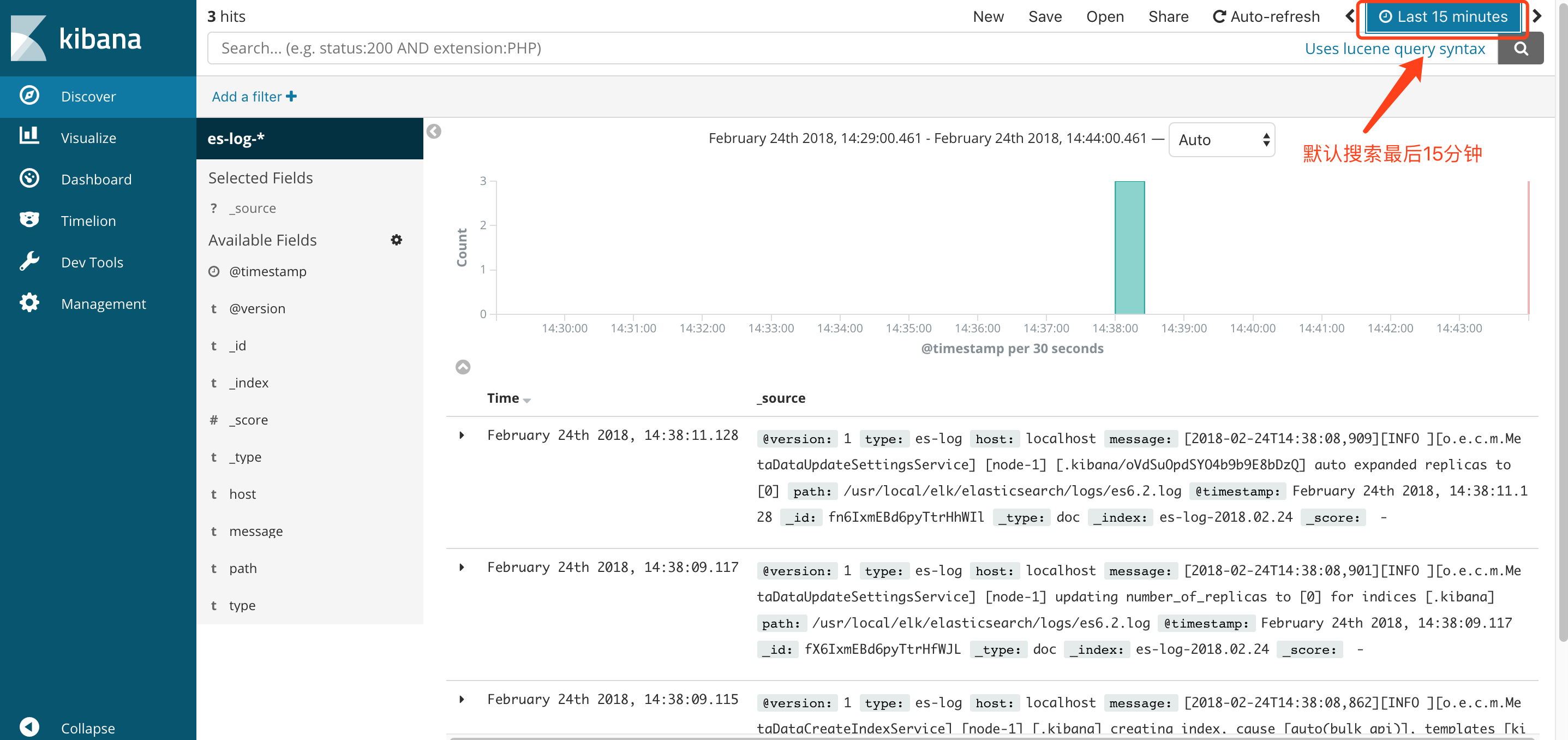

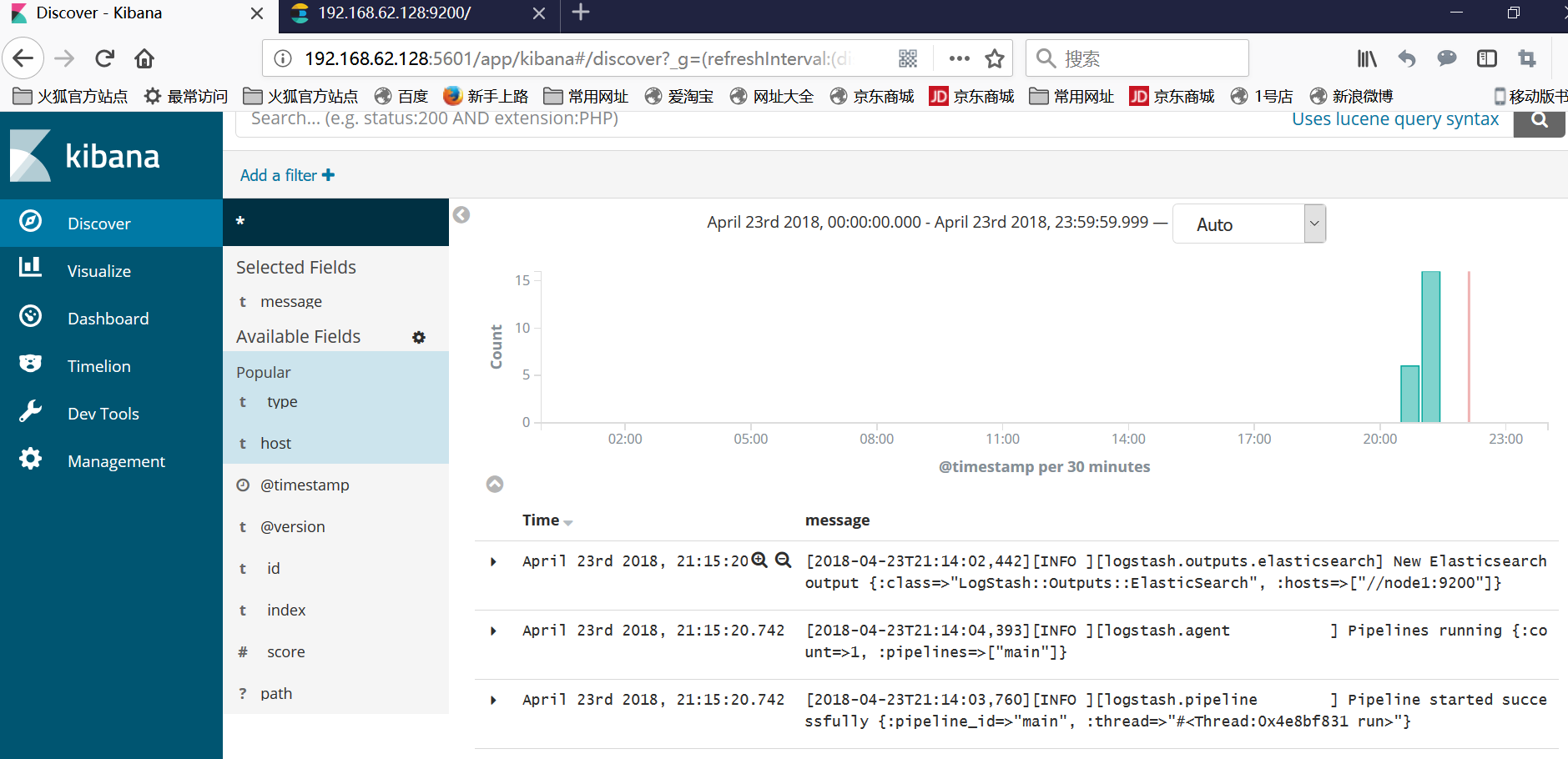

④再次点击Discover出现以下界面,可以看到默认搜索的是最后15分钟的日志,可以通过点击设置搜索的时间范围.

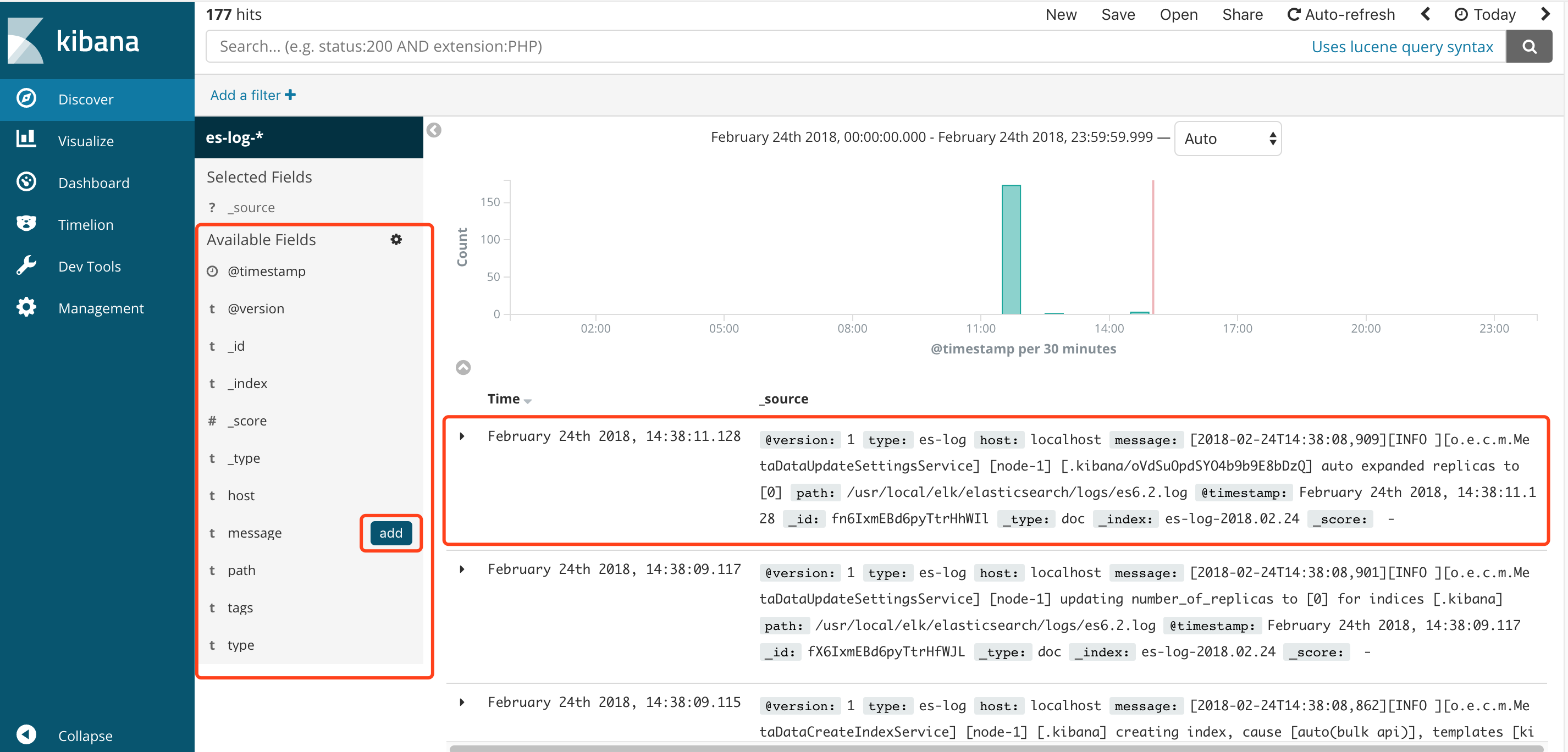

⑤可以点击右侧域的add设置需要显示的字段

添加完成之后,日志显示如下:

参考:https://my.oschina.net/itblog/blog/547250

https://blog.csdn.net/abcd_d_/article/details/53018927