文章目录

- 一、什么是hadoop

- 二、什么是MapReduce

- 三、什么是HDFS

- 四、什么是YARN

- 五、HDFS组成

- 六、yarn组成

- 七、hadoopHA

- 八、yarnHA

- 九、HDFS写数据

- 十、HDFS读数据

- 十一、safeMode

- 十二、nameNode元数据管理

- 十三、checkPoint

- 十四、MR组成

- 十五、mapTask并行度

- 十六、reduce并行度

- 十七、bean排序

- 十八、自定义partioner

- 十九、mapReduce数据压缩

- 二十、join on reduce

- 二十一、join on map

- 二十二、groupComparator

- 二十三、自定义inputFormat

- 二十四、自定义outputFormat

- 二十五、小文件处理

- 二十六、计数器

- 二十七、多job串联

- 二十八、mapreduce参数优化

一、什么是hadoop

海量数据储存、计算平台

二、什么是MapReduce

分布式计算框架

三、什么是HDFS

分布式文件存储系统

四、什么是YARN

分布式计算资源调度平台

五、HDFS组成

namenode、datanode

六、yarn组成

resourceManager、nodeManger

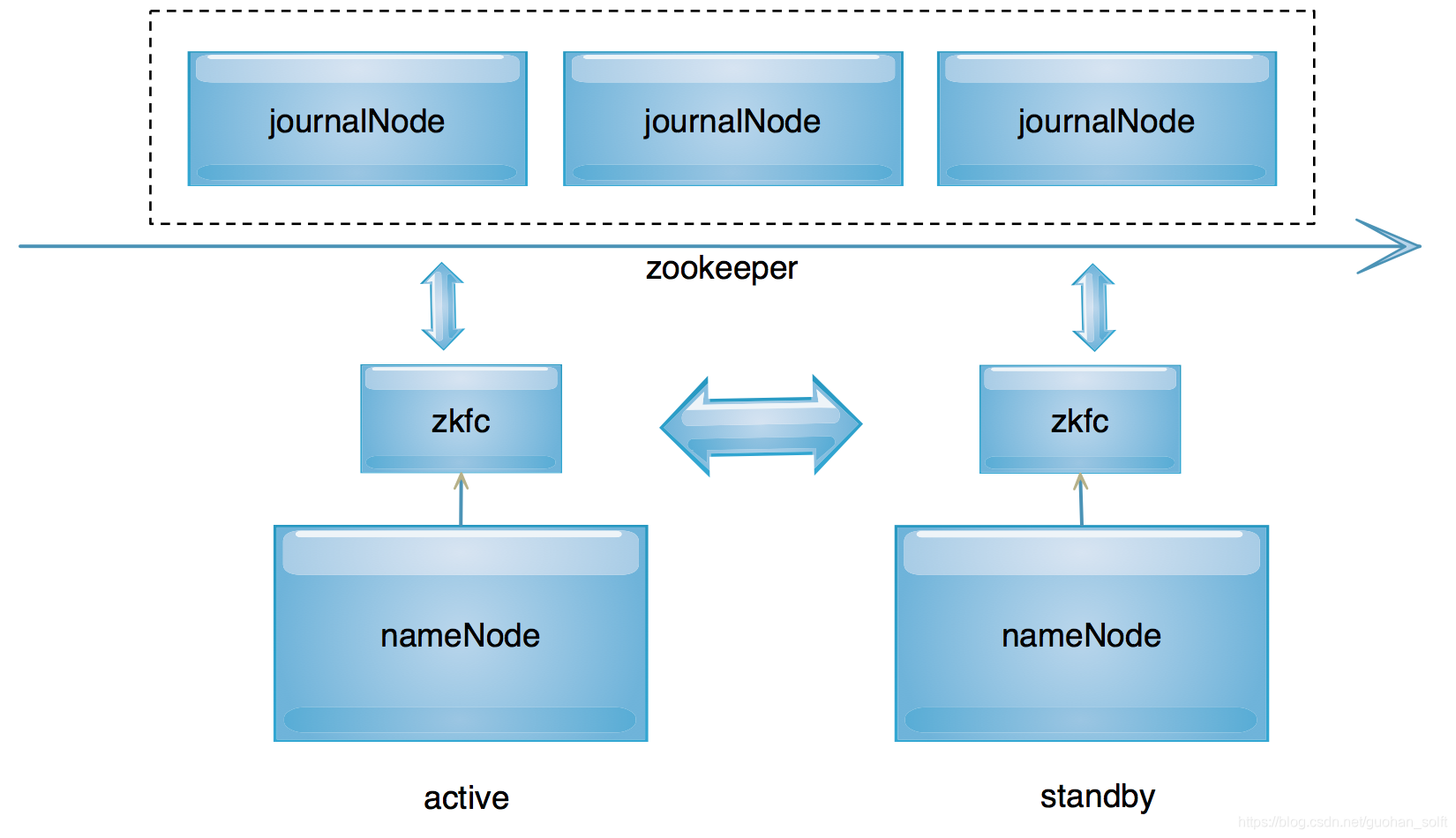

七、hadoopHA

nameNode:active、standBy

zkfc:监听nameNode进程状态

journalNode: nameNode元数据存放节点

八、yarnHA

两个resourceManger

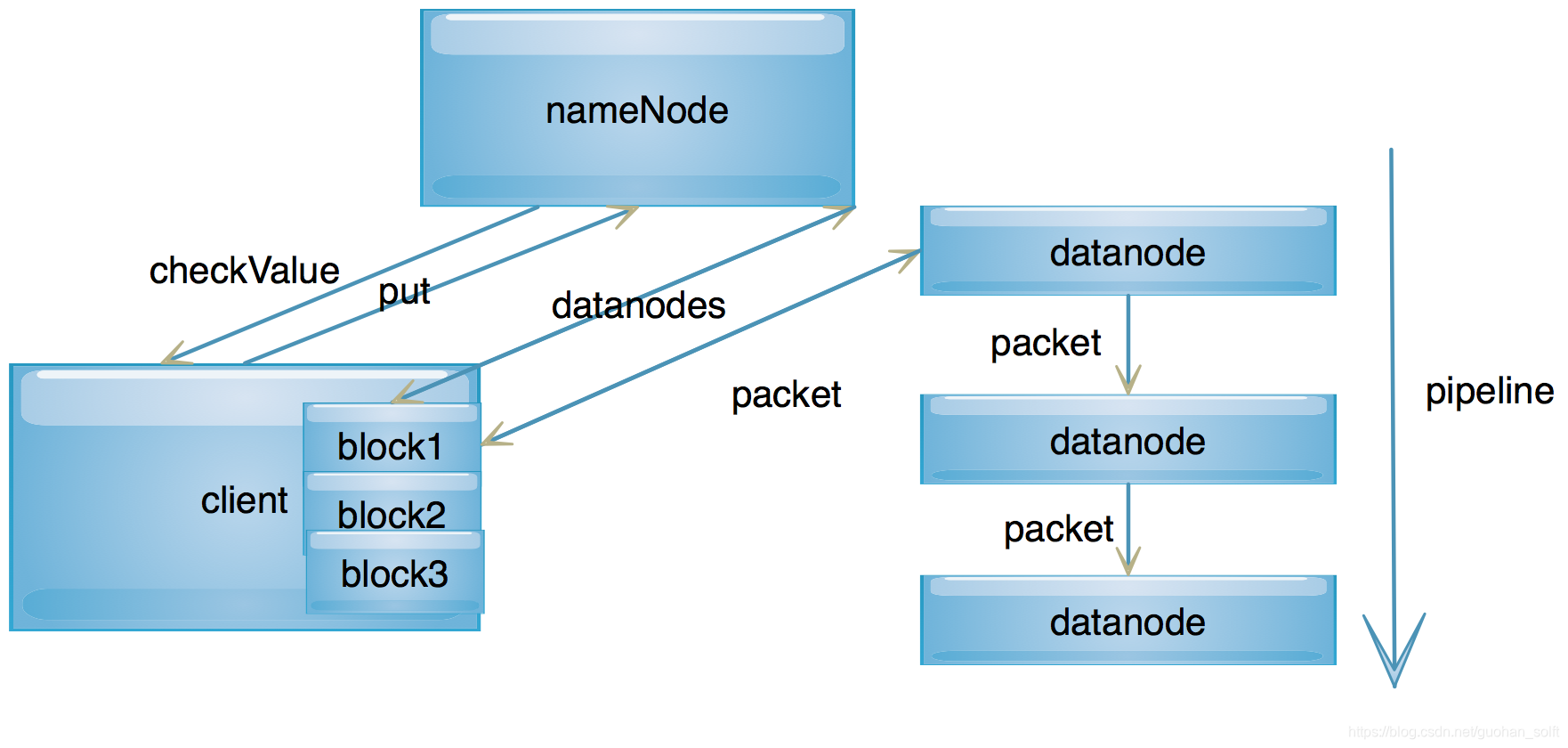

九、HDFS写数据

client -put-> name node – checkValue —> client — block --> name node —dataNodes —> client —>dataNode1 ->client — block1 —>dataNode1 -> dataNode2 -> dataNode3

client --block2 —>namenode — dataNodes —> client —block2–> dataNode1 —> dataNode2 —> dataNode3

循环 剩余block

十、HDFS读数据

client —file —> name node —dataNodes—> client —block1—>dataNode1 —client —block2—>dataNode1…

十一、safeMode

nameNode冷启动,元数据从fsImage中加载,fsImage包含blockID信息但不包含其对应的dataNode信息,从而导致namenod误认为文件丢失超过比例,从而将启动安全模式,随着dataNode汇报心跳发送block信息,元数据的dataNode信息被补全就会自动退出安全模式

强制退出: hdfs namenode --safemode leave

十二、nameNode元数据管理

内存元数据--完整

fsImage + edits = 完整

十三、checkPoint

secondaryNameNode

定期将nameNode中的fsImage和edits文件下载到本地并merge到内存的过程

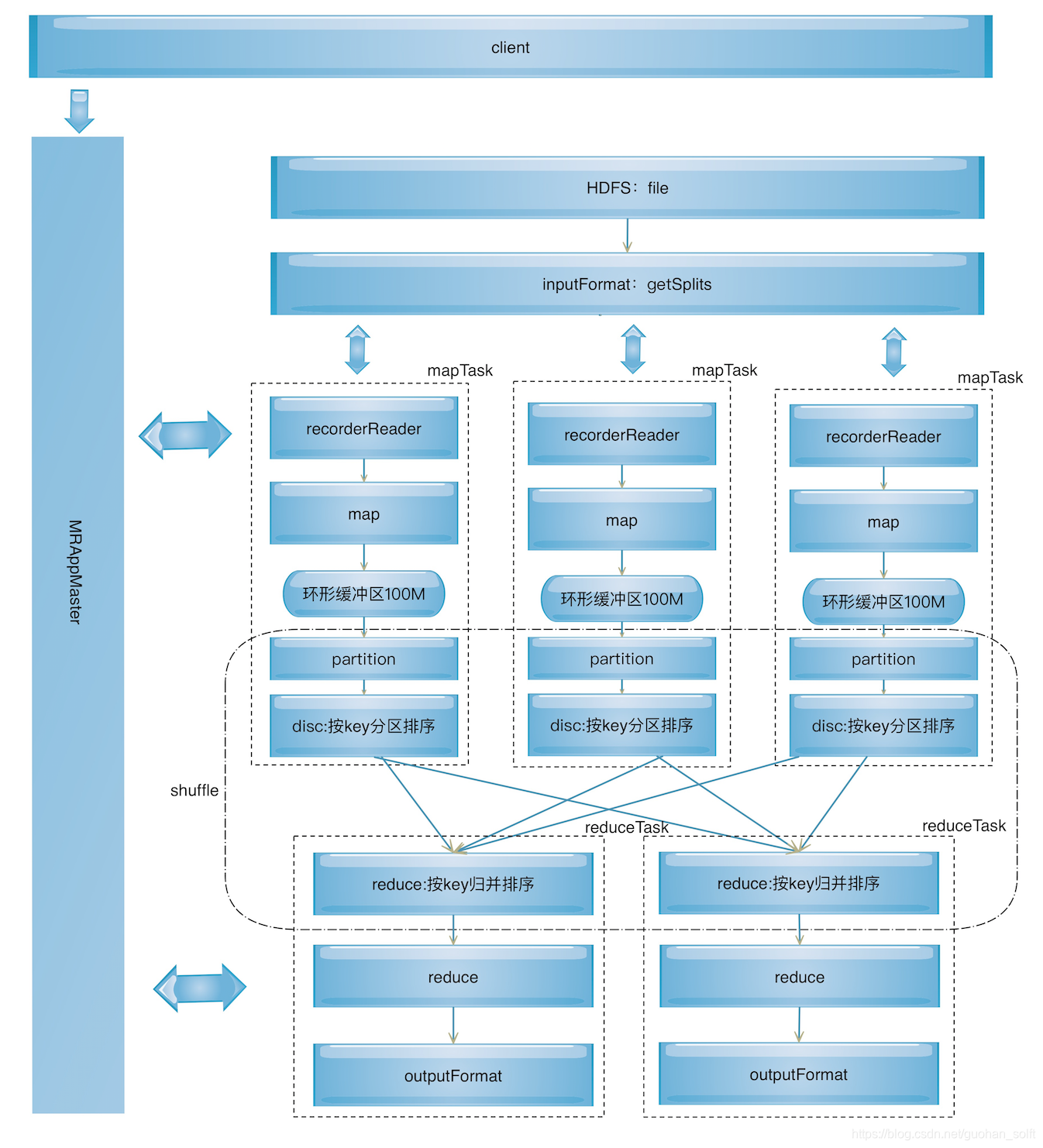

十四、MR组成

并发阶段:mapTask

汇聚阶段: reduceTask

程序总管:MRAppMaster

十五、mapTask并行度

splitSize

fileSize / splitSize = mapTask num

多个小文件就会有多个mapTask

优化经验:

1、每个map允许时间不易太短

2、设置jvm重用

3、大文件调大blockSize或者设大splitSize

4、小文件split前进行合并

十六、reduce并行度

手动设置: job.setNumReduceTasks(4);

注意问题:

1、全局汇总reduce只能有一个

2、个数不宜太多

十七、bean排序

实现WritableComparable接口

实现序列化方法:write/readFields

实现比较方法:compareTo

十八、自定义partioner

继承Partitioner

重写getPartition

按key根据reduceTask数量进行hash取模分配

十九、mapReduce数据压缩

压缩map或reduce计算的结果

原则:运算密集型少用压缩,IO密集型多用压缩

压缩文件读取:自带inputFormat类中自带读取功能

二十、join on reduce

通过关联条件作为key在reduce端进行join

缺点:

1、reduce计算压力大

2、容易数据倾斜

二十一、join on map

map端生命周期函数:setUp初始化小表数据

1、读取数据库

2、distributedCache:将小文件分发到每一个map task上

job.addCacheFile(new URI(“hdfs://hadoop-server01:9000/cachefile/b.txt”));

二十二、groupComparator

自定义分组:将bean中某字段值相同为一组聚合到reduce端,且组内排序根据bean实现的compareTo方法

继承:WritableComparator

重写:compare

二十三、自定义inputFormat

继承: FileInputFormat

重写:createRecord

自定义recordReader

继承:RecordReader

重写:nextKeyValue

二十四、自定义outputFormat

继承:FileOutputFormat

重写:getRecodWriter

自定义RecodWriter

重写:write

二十五、小文件处理

1、在数据采集的时候,就将小文件或小批数据合成大文件再上传HDFS

2、在业务处理之前,在HDFS上使用mapreduce程序对小文件进行合并以文件名为key,以文件内容为value输出sequenceFile中

3、在mapreduce处理时,可采用combineInputFormat提高效率

二十六、计数器

用枚举定义计数字段:enum MyCounter{Col1,Col2}

使用:

context.getCounter(MyCounter.Col1).increment(1)

context.getCounter(MyCounter.Col2).increment(1)

二十七、多job串联

方法:

1、将自己的job作为参数新建一个框架自带的可控job类ControlledJob

2、设置依赖关系

3、加入JobControl队列中

ControlledJob cJob1 = new ControlledJob(job1.getConfiguration());

ControlledJob cJob2 = new ControlledJob(job2.getConfiguration());

ControlledJob cJob3 = new ControlledJob(job3.getConfiguration());

cJob1.setJob(job1);

cJob2.setJob(job2);

cJob3.setJob(job3);

// 设置作业依赖关系

cJob2.addDependingJob(cJob1);

cJob3.addDependingJob(cJob2);

JobControl jobControl = new JobControl(“RecommendationJob”);

jobControl.addJob(cJob1);

jobControl.addJob(cJob2);

jobControl.addJob(cJob3);

// 新建一个线程来运行已加入JobControl中的作业,开始进程并等待结束

Thread jobControlThread = new Thread(jobControl);

jobControlThread.start();

while (!jobControl.allFinished()) {

Thread.sleep(500);

}

jobControl.stop();

二十八、mapreduce参数优化

MapReduce重要配置参数

1、 资源相关参数

//以下参数是在用户自己的mr应用程序中配置就可以生效

(1) mapreduce.map.memory.mb: 一个Map Task可使用的资源上限(单位:MB),默认为1024。如果Map Task实际使用的资源量超过该值,则会被强制杀死。

(2) mapreduce.reduce.memory.mb: 一个Reduce Task可使用的资源上限(单位:MB),默认为1024。如果Reduce Task实际使用的资源量超过该值,则会被强制杀死。

(3) mapreduce.map.cpu.vcores: 每个Map task可使用的最多cpu core数目, 默认值: 1

(4) mapreduce.reduce.cpu.vcores: 每个Reduce task可使用的最多cpu core数目, 默认值: 1

(5) mapreduce.map.java.opts: Map Task的JVM参数,你可以在此配置默认的java heap size等参数, e.g.

“-Xmx1024m -verbose:gc -Xloggc:/tmp/@[email protected]” (@taskid@会被Hadoop框架自动换为相应的taskid), 默认值: “”

(6) mapreduce.reduce.java.opts: Reduce Task的JVM参数,你可以在此配置默认的java heap size等参数, e.g.

“-Xmx1024m -verbose:gc -Xloggc:/tmp/@[email protected]”, 默认值: “”

//应该在yarn启动之前就配置在服务器的配置文件中才能生效

(7) yarn.scheduler.minimum-allocation-mb 1024 给应用程序container分配的最小内存

(8) yarn.scheduler.maximum-allocation-mb 8192 给应用程序container分配的最大内存

(9) yarn.scheduler.minimum-allocation-vcores 1

(10)yarn.scheduler.maximum-allocation-vcores 32

(11)yarn.nodemanager.resource.memory-mb 8192

//shuffle性能优化的关键参数,应在yarn启动之前就配置好

mapreduce.task.io.sort.mb 100 //shuffle的环形缓冲区大小,默认100m

mapreduce.map.sort.spill.percent 0.8 //环形缓冲区溢出的阈值,默认80%

2、 容错相关参数

(1) mapreduce.map.maxattempts: 每个Map Task最大重试次数,一旦重试参数超过该值,则认为Map Task运行失败,默认值:4。

(2) mapreduce.reduce.maxattempts: 每个Reduce Task最大重试次数,一旦重试参数超过该值,则认为Map Task运行失败,默认值:4。

(3) mapreduce.map.failures.maxpercent: 当失败的Map Task失败比例超过该值为,整个作业则失败,默认值为0. 如果你的应用程序允许丢弃部分输入数据,则该该值设为一个大于0的值,比如5,表示如果有低于5%的Map Task失败(如果一个Map Task重试次数超过mapreduce.map.maxattempts,则认为这个Map Task失败,其对应的输入数据将不会产生任何结果),整个作业扔认为成功。

(4) mapreduce.reduce.failures.maxpercent: 当失败的Reduce Task失败比例超过该值为,整个作业则失败,默认值为0.

(5) mapreduce.task.timeout: Task超时时间,经常需要设置的一个参数,该参数表达的意思为:如果一个task在一定时间内没有任何进入,即不会读取新的数据,也没有输出数据,则认为该task处于block状态,可能是卡住了,也许永远会卡主,为了防止因为用户程序永远block住不退出,则强制设置了一个该超时时间(单位毫秒),默认是300000。如果你的程序对每条输入数据的处理时间过长(比如会访问数据库,通过网络拉取数据等),建议将该参数调大,该参数过小常出现的错误提示是“AttemptID:attempt_14267829456721_123456_m_000224_0 Timed out after 300 secsContainer killed by the ApplicationMaster.”。

3、 本地运行mapreduce 作业

设置以下几个参数:

mapreduce.framework.name=local

mapreduce.jobtracker.address=local

fs.defaultFS=local

4、 效率和稳定性相关参数

(1) mapreduce.map.speculative: 是否为Map Task打开推测执行机制,默认为false

(2) mapreduce.reduce.speculative: 是否为Reduce Task打开推测执行机制,默认为false

(3) mapreduce.job.user.classpath.first & mapreduce.task.classpath.user.precedence:当同一个class同时出现在用户jar包和hadoop jar中时,优先使用哪个jar包中的class,默认为false,表示优先使用hadoop jar中的class。

(4) mapreduce.input.fileinputformat.split.minsize: FileInputFormat做切片时的最小切片大小,(5)mapreduce.input.fileinputformat.split.maxsize: FileInputFormat做切片时的最大切片大小

(切片的默认大小就等于blocksize,即 134217728)