Requests 唯一的一个非转基因的 Python HTTP 库,人类可以安全享用。

Requests继承了urllib的所有特性。

Requests支持HTTP连接保持和连接池,支持使用cookie保持会话,支持文件上传,支持自动确定响应内容的编码,支持国际化的 URL 和 POST 数据自动编码。

相对于urlilib的request来说Requests可以说是异常的强大。(话说回来,相同的名字,都是多了一个”s”那个比较牛掰,比如像SKT,KT……………………)

好了回到正题,使用requests最好还是参考官方文档: http://docs.python-requests.org/zh_CN/latest/index.html

Requests是第三方库,需要使用pip install requests 安装。

一:最基本的GET请求可以直接用get方法

import requests

url="http://www.4j4j.cn/"

headers={ "User-Agent": "Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/51.0.2704.103 Safari/537.36"}

response=requests.get(url=url,headers=headers)

#查看响应头部字符编码

print(response.encoding)

#查看url地址

print(response.url)

#查看响应内容,response.content返回的字节流数据,需要decode(),

#如果响应头部字符编码是utf-8编码则decode("gbk"),反之则decode("utf-8")

print(response.content.decode("utf-8"))

#response.text 返回的是Unicode格式的数据

#如果响应头部字符编码是gbk编码或者gb2312需要设置response.encoding="gbk"才能正常显示

#如果响应头部字符编码是utf-8编码则不需要处理

print(response.text)二:添加headers和查询参数

import requests

data={"wd":"美女"}

url="https://www.baidu.com/s?"

headers={ "User-Agent": "Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/51.0.2704.103 Safari/537.36"}

#params 接收一个字典或者字符串的查询参数,字典类型自动转换为url编码,不需要urlencode()

response=requests.get(url,params=data,headers=headers)

print(response.url)运行结果:https://www.baidu.com/s?wd=%E7%BE%8E%E5%A5%B3

三:基本POST请求,传入data参数

import requests

data={

"from":"zh",

"to":"en",

"query":"拿破仑",

"transtype":"realtime",

"simple_means_flag":3

}

url="http://fanyi.baidu.com/v2transapi"

headers={ "User-Agent": "Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/51.0.2704.103 Safari/537.36"}

response=requests.post(url,data=data,headers=headers)

#如果返回的json文件也可以直接像是

print(response.json())四:代理(proxies参数)

import requests

# 根据协议类型,选择不同的代理

proxies = {

"http": "http://183.34.56.79:9527",

"https": "http://183.34.56.79:9527",

}

response = requests.get("http://www.baidu.com", proxies = proxies)

print(response.text)五:私密代理

免费代理速度慢,而且使用的人也多,容易冲突。所以如果想要使用流畅的代理,肯定还是只用花钱买私密代理。

import requests

# 如果代理需要使用HTTP Basic Auth,可以使用下面这种格式:

proxy = { "http": "账号:密码@183.34.56.79:9527" }

response = requests.get("http://www.baidu.com", proxies = proxy)

print(response.text)六:Cookies

import requests

response = requests.get("http://www.baidu.com/")

#返回CookieJar对象:

cookiejar = response.cookies

#将CookieJar转为字典:

cookiedict=requests.utils.dict_from_cookiejar(cookiejar)

print (cookiejar)

print (cookiedict)运行结果:

RequestsCookieJar[Cookie BDORZ=27315 for .baidu.com]

{‘BDORZ’: ‘27315’}

七:session

在 requests 里,session对象是一个非常常用的对象,这个对象代表一次用户会话:从客户端浏览器连接服务器开始,到客户端浏览器与服务器断开。

会话能让我们在跨请求时候保持某些参数,比如在同一个 Session 实例发出的所有请求之间保持 cookie 。

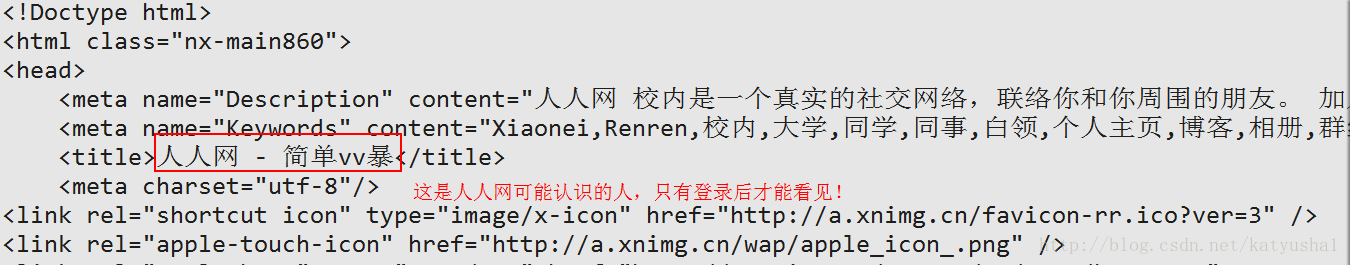

实现人人网登录

import requests

#创建session对象,可以保存Cookie值

ssion = requests.session()

#处理 headers

headers = {"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/54.0.2840.99 Safari/537.36"}

#需要登录的用户名和密码

data = {"email":"人人网账号", "password":"密码"}

#发送附带用户名和密码的请求,并获取登录后的Cookie值,保存在ssion里

ssion.post("http://www.renren.com/PLogin.do", data = data)

#ssion包含用户登录后的Cookie值,可以直接访问那些登录后才可以访问的页面

response = ssion.get("http://www.renren.com/894073113/profile")

#打印响应内容

print (response.text)运行效果: