上一篇笔记记录阿里云上搭建hadoop集群

下一篇笔记记录阿里云上搭建spark集群

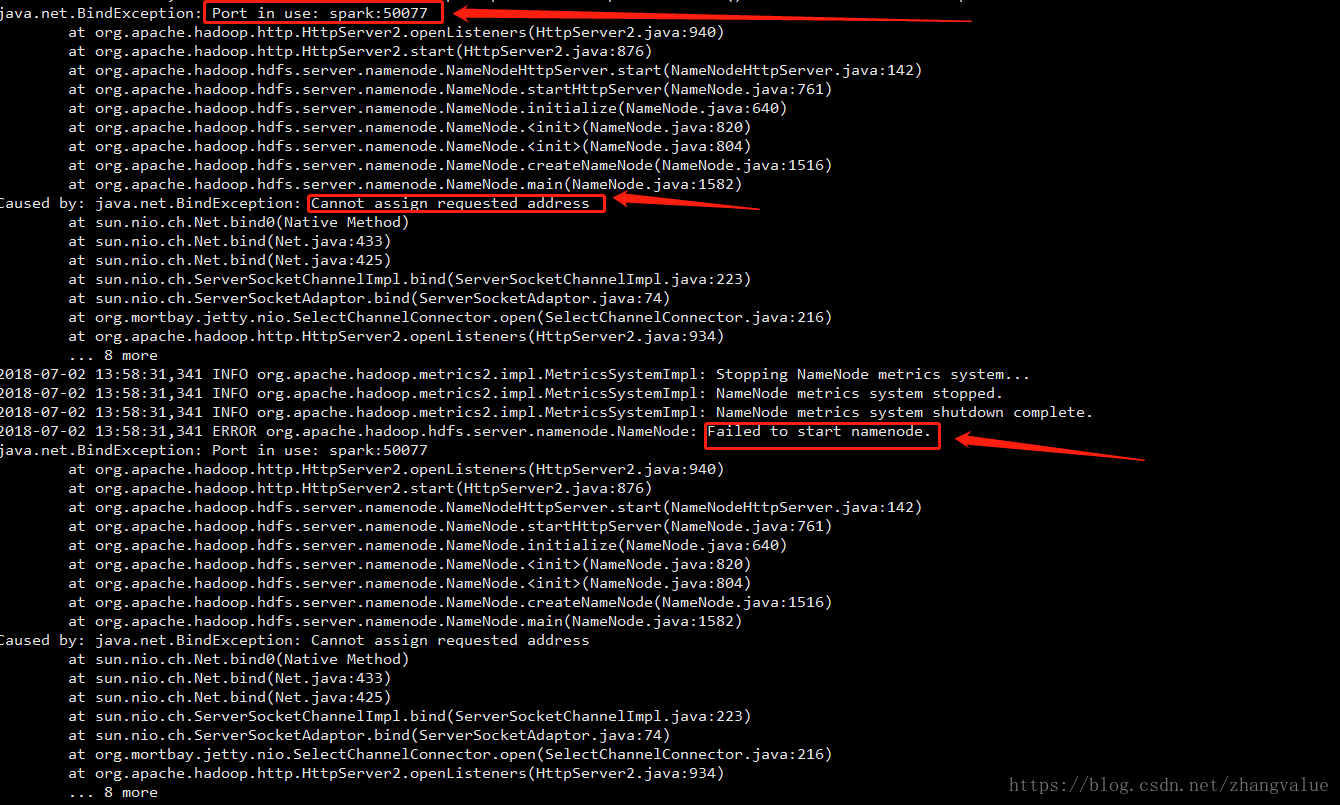

先贴一下错误:

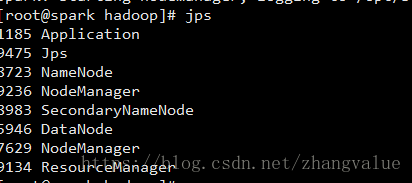

之前在本机上搭建的时候是没问题的,今天发现在阿里云上的两个服务器之上重新走一遍流程,结果发现namenode节点就是没有启动起来,后来查看log发现之前以为是50077端口被占用了

ss -tanlp|grep 50077

结果查看端口根本就没有被占用,重新查看log发现下面的提示

Caused by: java.net.BindException: Cannot assign requested address

最后查询才发现错误在于

阿里云服务器无法绑定公网IP的地址,即在 /etc/hosts 需要这样设置

内网IP地址 你的hostname

公网IP地址 别的hostname

主节点master节点里面的ip写成内网ip

重新启动就ok

在work节点中 启动spark的时候会报错:

java.net.BindException: 无法指定被请求的地址: Service 'sparkDriver' failed after 16 retries!

解决方法就是在work节点中 /etc/hosts 也需要这样设置

内网IP地址 当前work节点的hostname

公网IP地址 主节点master的hostname