ChatGLM3 是智谱AI和清华大学 KEG 实验室联合发布的新一代对话预训练模型。ChatGLM3-6B 是 ChatGLM3 系列中的开源模型,在保留了前两代模型对话流畅、部署门槛低等众多优秀特性的基础上,ChatGLM3-6B 引入了如下特性:

更强大的基础模型: ChatGLM3-6B 的基础模型 ChatGLM3-6B-Base 采用了更多样的训练数据、更充分的训练步数和更合理的训练策略。在语义、数学、推理、代码、知识等不同角度的数据集上测评显示,ChatGLM3-6B-Base 具有在 10B 以下的基础模型中最强的性能。

更完整的功能支持: ChatGLM3-6B 采用了全新设计的 Prompt格式,除正常的多轮对话外。同时原生支持工具调用(Function Call)、代码执行(Code Interpreter)和 Agent 任务等复杂场景。

更全面的开源序列: 除了对话模型 ChatGLM3-6B外,还开源了基础模型 ChatGLM3-6B-Base、长文本对话模型 ChatGLM3-6B-32k。以上所有权重对学术研究完全开放,在填写问卷进行登记后亦允许免费商业使用。

本文介绍了ChatGLM3-6B在多轮对话模型ToolAlpaca 数据集上微调的示例。请确保我完成了【大模型实践】ChatGLM3安装及体验(四)中的环境安装及模型下载部分。

一、准备数据集

为了训练多轮对话模型,首先要按照chatglm-6b的数据格式准备数据,chatglm-6b的微调模型的对话和工具能力数据格式如下:

[

{

"tools": [

// available tools, format is not restricted

],

"conversations": [

{

"role": "system",

"content": "<system prompt text>"

},

{

"role": "user",

"content": "<user prompt text>"

},

{

"role": "assistant",

"content": "<assistant thought to text>"

},

{

"role": "tool",

"name": "<name of the tool to be called",

"parameters": {

"<parameter_name>": "<parameter_value>"

},

"observation": "<observation>"

// don't have to be string

},

{

"role": "assistant",

"content": "<assistant response to observation>"

},

// ... Muti Turn

{

"role": "user",

"content": "<user prompt text>"

},

{

"role": "assistant",

"content": "<assistant response text>"

}

]

}

// ...

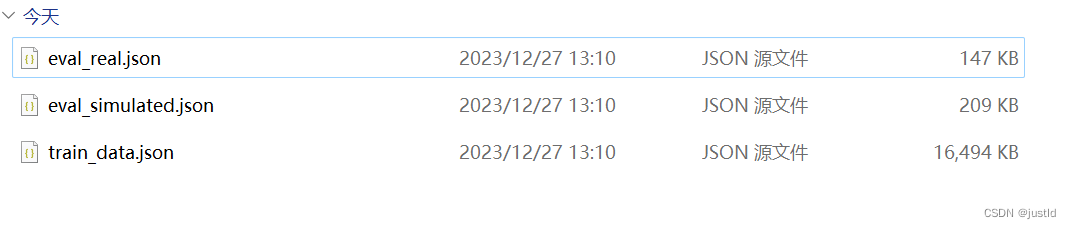

]接下来下载ToolAlpaca 数据集,在data目录下有3个json文件,如下图所示:

进入finetune_chatmodel_demo目录:

cd finetune_chatmodel_demo下面使用chatglm3-6b的数据处理工具将该数据集的格式转换成chatglm3的格式(json文件的路径更换为自己的训练数据路径):

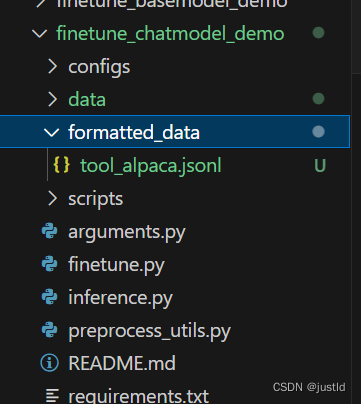

python scripts/format_tool_alpaca.py --path "data/toolalpaca/train_data.json"处理完成后,finetune_chatmodel_demo目录下会出现formatted_data目录,里面有处理好的数据,如下图:

二、P-Tuning v2微调

本教程使用P-Tuning v2微调。将ChatGLM3/finetune_chatmodel_demo/scripts/finetune_pt_multiturn.sh的BASE_MODEL_PATH替换为自己的chatglm-6b的路径):

#! /usr/bin/env bash

set -ex

PRE_SEQ_LEN=128

LR=2e-2

NUM_GPUS=1

MAX_SEQ_LEN=2048

DEV_BATCH_SIZE=1

GRAD_ACCUMULARION_STEPS=16

MAX_STEP=1000

SAVE_INTERVAL=500

DATESTR=`date +%Y%m%d-%H%M%S`

RUN_NAME=tool_alpaca_pt

BASE_MODEL_PATH=chatglm3-6b

DATASET_PATH=formatted_data/tool_alpaca.jsonl

OUTPUT_DIR=output/${RUN_NAME}-${DATESTR}-${PRE_SEQ_LEN}-${LR}

mkdir -p $OUTPUT_DIR

torchrun --standalone --nnodes=1 --nproc_per_node=$NUM_GPUS finetune.py \

--train_format multi-turn \

--train_file $DATASET_PATH \

--max_seq_length $MAX_SEQ_LEN \

--preprocessing_num_workers 1 \

--model_name_or_path $BASE_MODEL_PATH \

--output_dir $OUTPUT_DIR \

--per_device_train_batch_size $DEV_BATCH_SIZE \

--gradient_accumulation_steps $GRAD_ACCUMULARION_STEPS \

--max_steps $MAX_STEP \

--logging_steps 1 \

--save_steps $SAVE_INTERVAL \

--learning_rate $LR \

--pre_seq_len $PRE_SEQ_LEN 2>&1 | tee ${OUTPUT_DIR}/train.log

再微调训练前,再安装一个依赖库(否则训练会报错):

pip install astunparse接下来开启微调训练:

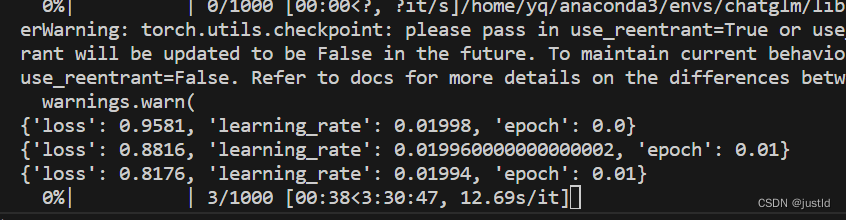

bash scripts/finetune_pt_multiturn.sh可以看到,训练起来了:

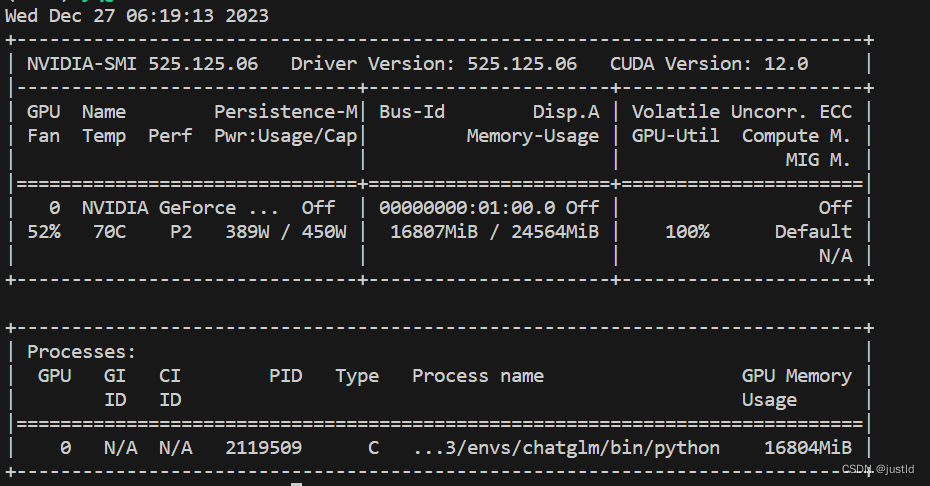

显存消耗接近17GB:

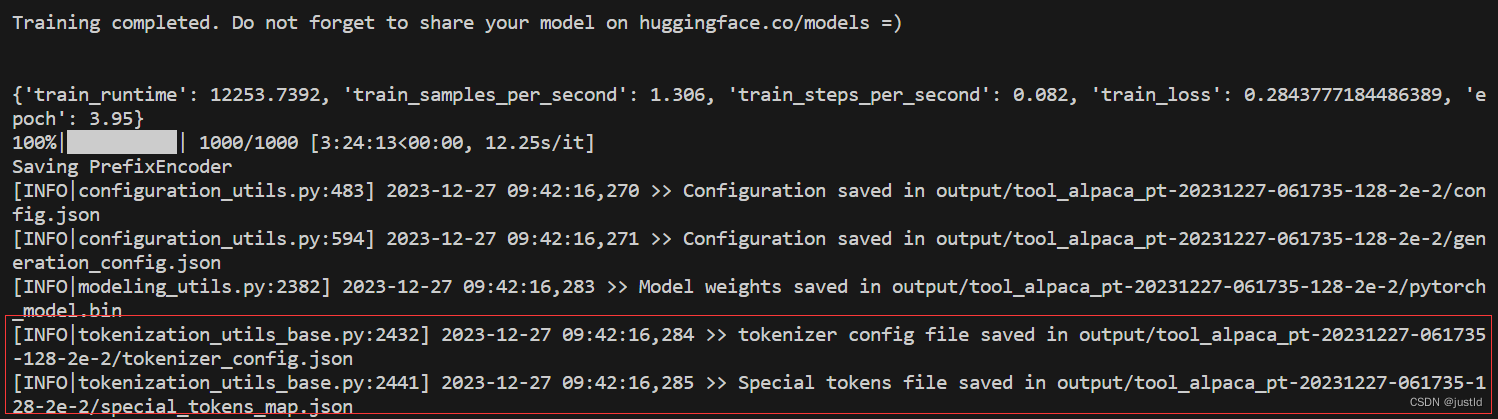

训练结束:

三、部署

获得了微调的模型后,返回composite_demo目录:

cd ../composite_demo可以很简单的部署(MODEL_PATH改为自己的chatglm3-6b的权重路径,PT_PATH指向微调的路径,PT_PATH的路径再训练结束的日志中):

MODEL_PATH="chatglm3-6b" PT_PATH="output/tool_alpaca_pt-20231227-061735-128-2e-2" streamlit run main.py 效果如下: