Sigmoid函数介绍

Sigmoid函数是一种常用的激活函数,全称为Sigmoid函数。它将输入值映射到0和1之间,当输入值趋近于正无穷时,输出值趋近于1;当输入值趋近于负无穷时,输出值趋近于0。Sigmoid函数的表达式为:f(x) = 1 / (1 + e^-x)。

Sigmoid函数的优点是计算简单,可以作为线性回归模型的输出层激活函数。同时,Sigmoid函数的导数也很容易计算,这使得它在深度学习中得到了一定的应用。

Sigmoid函数使用场景

Sigmoid函数使用场景如下:

- 逻辑回归模型中的输出层,因为Sigmoid函数可以将输出值映射到0和1之间,用于表示样本属于某个类别的概率。

- 神经网络中的隐藏层和输出层,因为Sigmoid函数可以解决梯度消失问题,使得神经网络更容易训练。

- 图像处理中的边缘检测算法,因为Sigmoid函数可以将像素值映射到0和1之间,用于表示边缘的强度。

- 文本分类模型中的输出层,因为Sigmoid函数可以将输出值映射到0和1之间,用于表示样本属于某个类别的概率。

Sigmoid函数使用案例

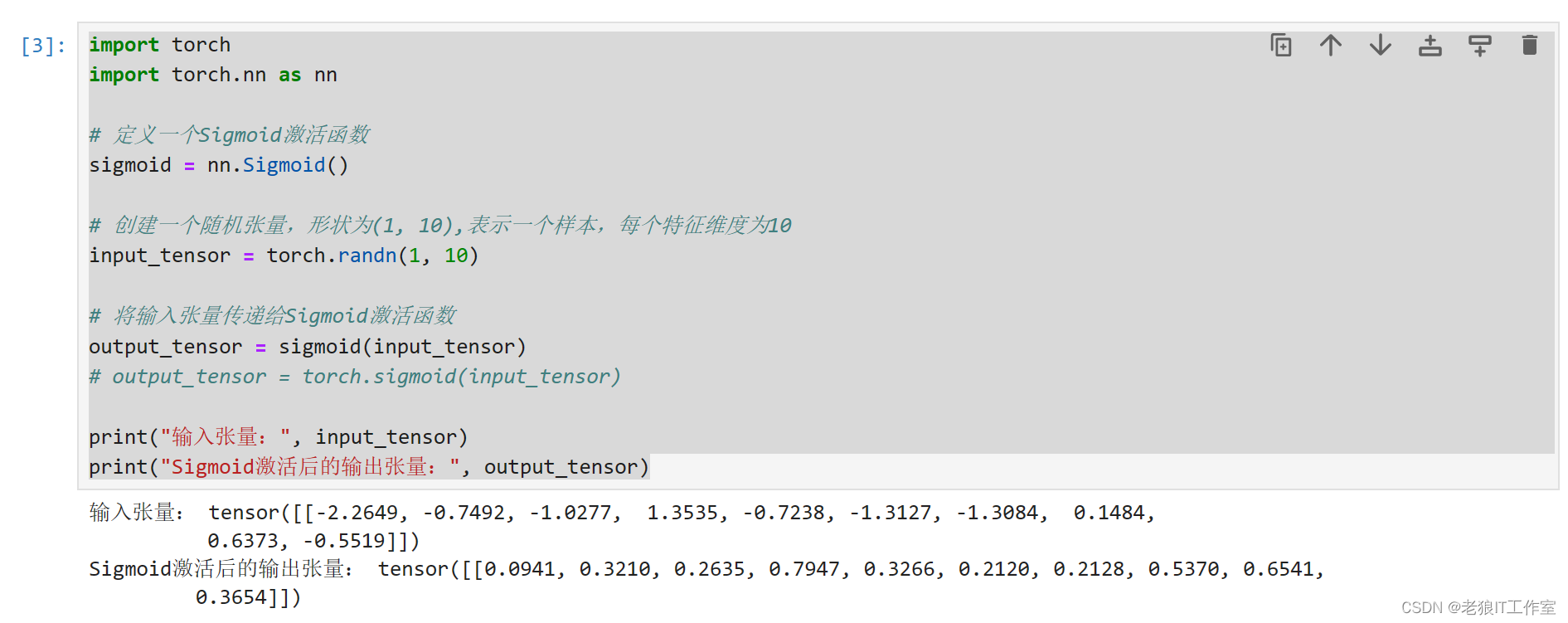

import torch

import torch.nn as nn

# 定义一个Sigmoid激活函数

sigmoid = nn.Sigmoid()

# 创建一个随机张量,形状为(1, 10),表示一个样本,每个特征维度为10

input_tensor = torch.randn(1, 10)

# 将输入张量传递给Sigmoid激活函数

output_tensor = sigmoid(input_tensor)

# output_tensor = torch.sigmoid(input_tensor)

print("输入张量:", input_tensor)

print("Sigmoid激活后的输出张量:", output_tensor)

在这个示例中,我们首先导入了PyTorch库,并定义了一个Sigmoid激活函数。然后,我们创建了一个随机张量作为输入,将其传递给Sigmoid激活函数,得到了输出张量。最后,我们打印了输入张量和Sigmoid激活后的输出张量。