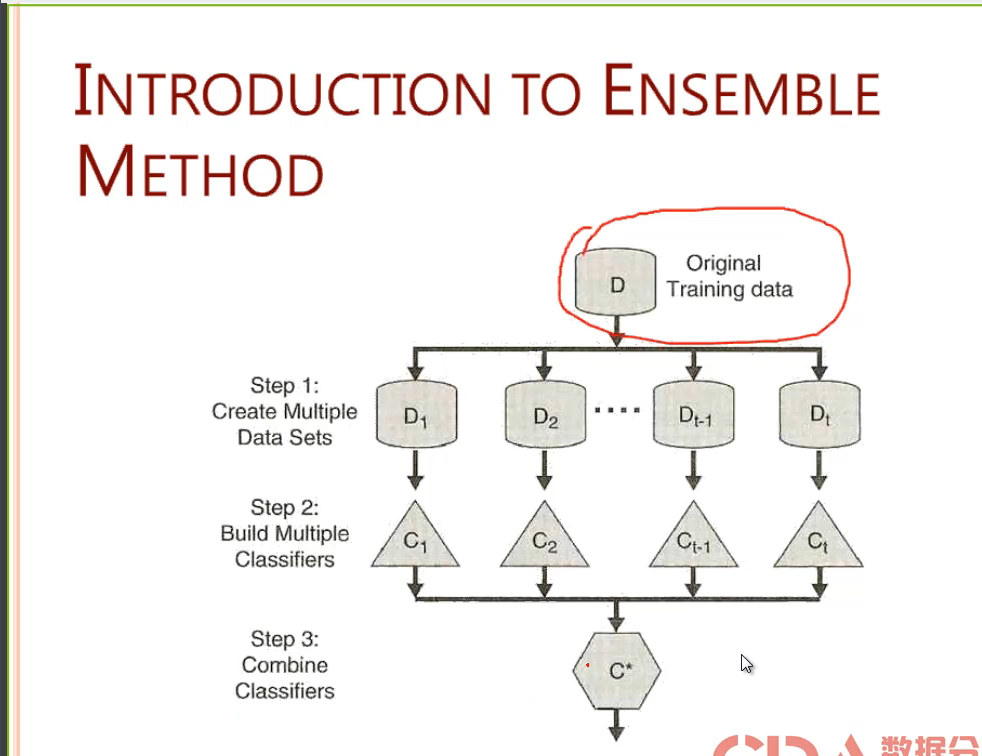

1、集成方法是从训练集构建分类器。通过投票预测。

注意事项:

1、Bagging、Boosting训练数据上做手脚。

2、Random Forest 在输入特征上做手脚。

3、在属性中选择TOPN后,分别建决策树。

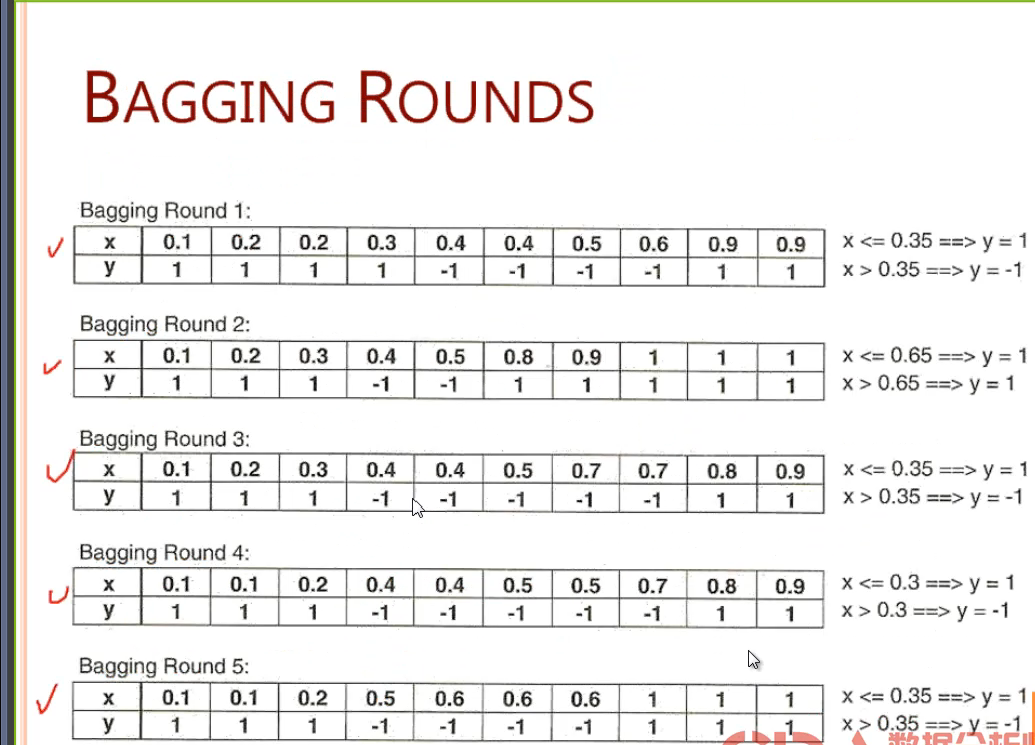

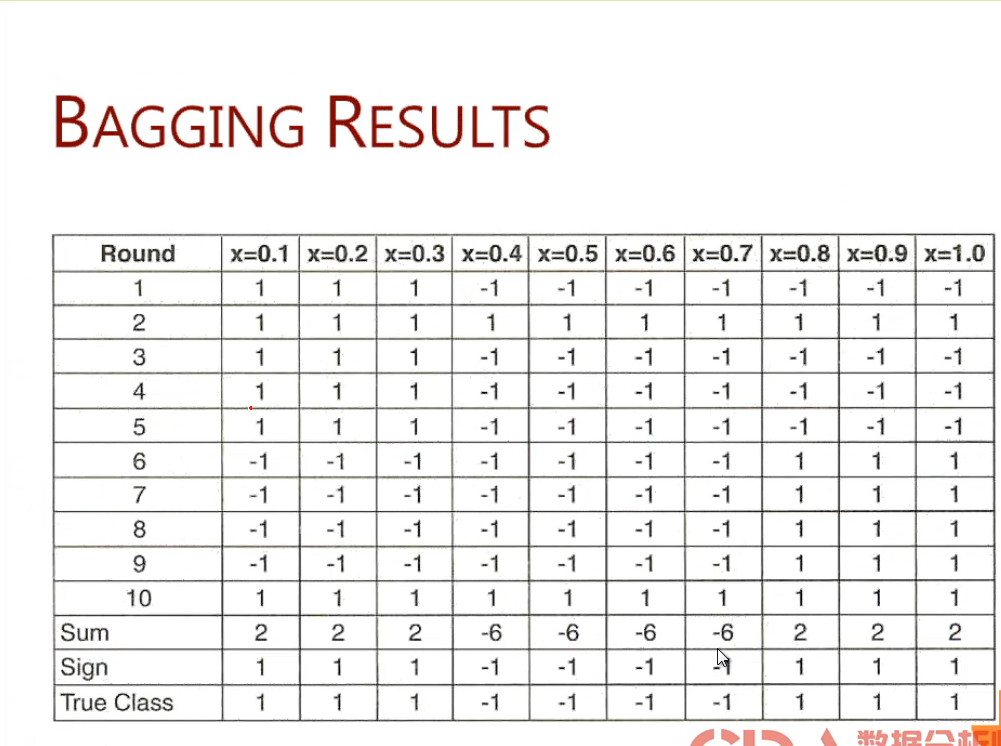

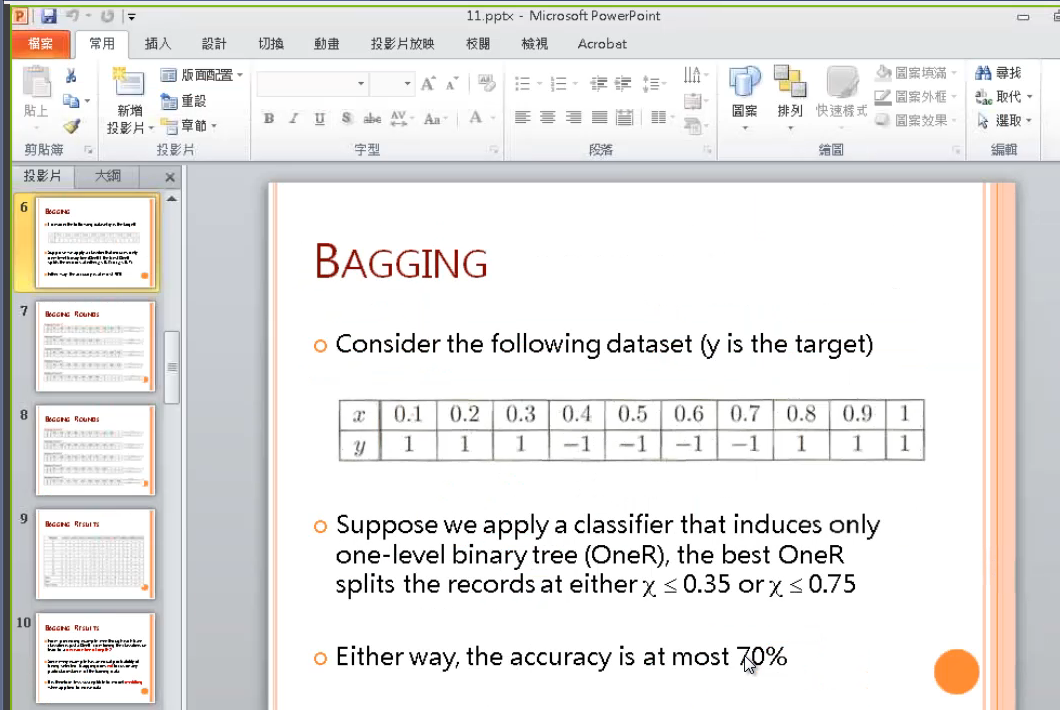

Bagging的特性:

1、是从训练数据做手脚,取回抽样。

2、是一个深度为2的决策树。实质是建立了一个10个决策树。深度为2.

3、它是每个元素都有抽回的概率,概率是均等的。所以它不会在特征的数据上做手脚,没有偏好哪一类的数据做手脚。

4、没有过度拟合的效果。

5、Bagging和 分类器是有关系的。

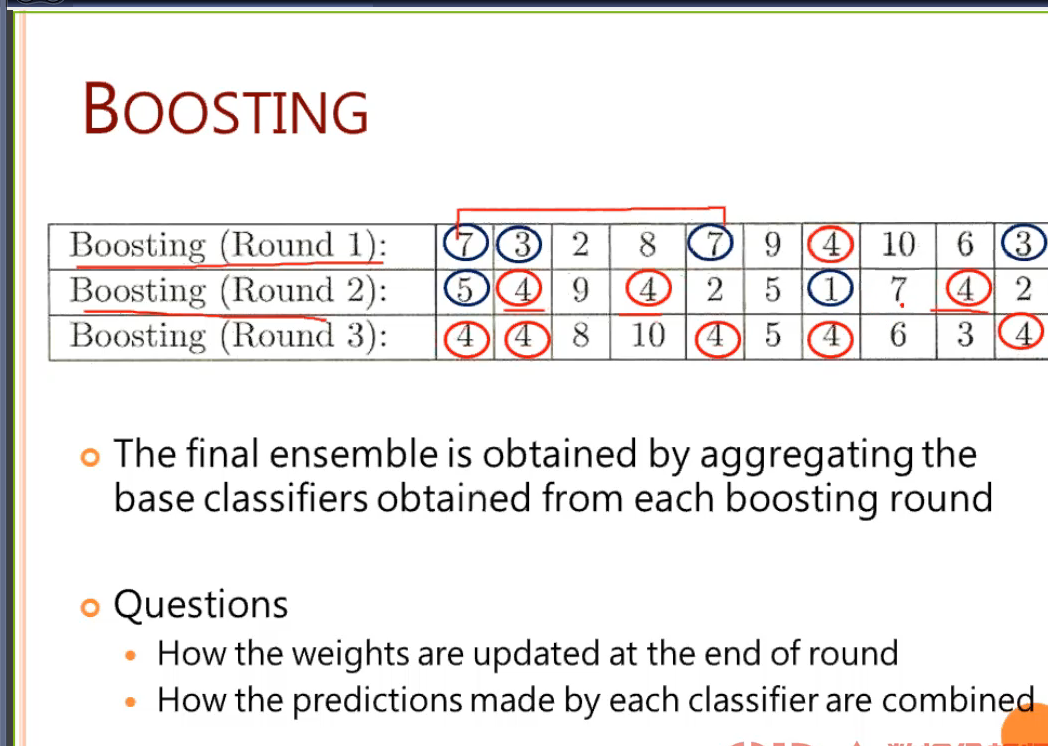

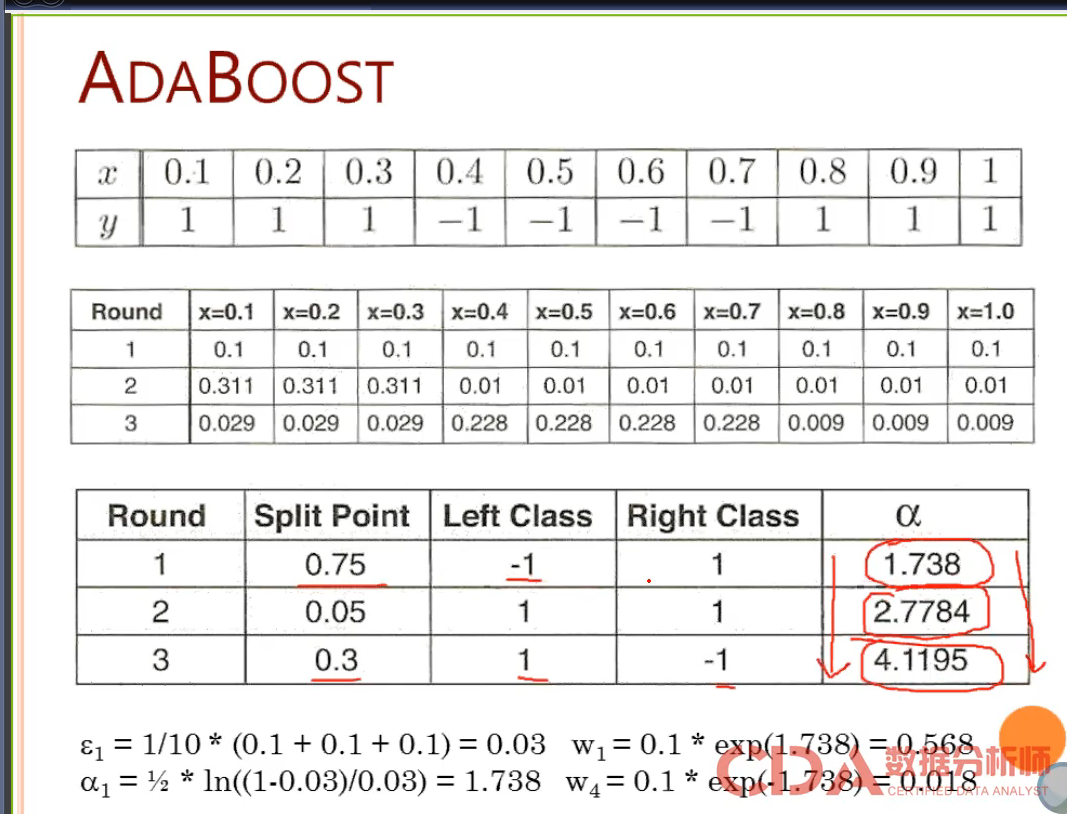

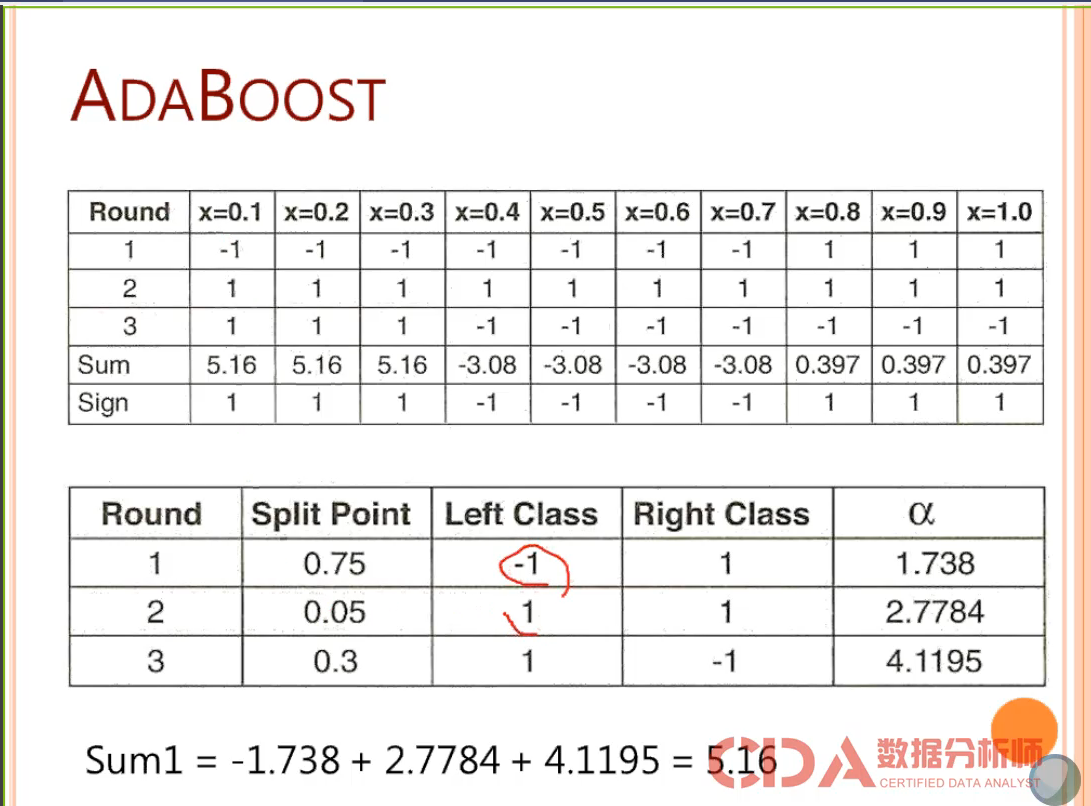

Boosting:

1、针对很难被分正确的数据,提高被抽样的概率

2、Boosting 会给一个权重 1/n

3、分错的数据抽取的概率会一直提升。概率增加分错数据的。

4、会有过度拟合的特性。

5、和分类器有关。

Adboosting的特性

1、不是每个数字取样的值都是相同的

2、越到后面权重越大

Random Forest:

1、为决策树设计的

2、J48决策树在属性的选择上,每次不要选择最好的字段。从K个最好的里面去选择。

3、产生很多的决策树