安装elasticsearch

1.部署单点es

1.1.创建网络

kibana可以帮助我们方便地编写DSL语句,所以还要装kibana

因为我们还需要部署kibana容器,因此需要让es和kibana容器互联。这里先创建一个网络:

docker network create es-net

1.2.加载镜像

这里我们采用elasticsearch的7.12.1版本的镜像,这个镜像体积非常大,接近1G。不建议大家自己pull。

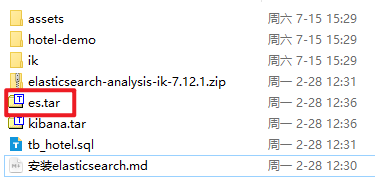

课前资料提供了镜像的tar包:

大家将其上传到虚拟机中,然后运行命令加载即可:

# 导入数据

docker load -i es.tar

同理还有kibana的tar包也需要这样做。

1.3.运行

运行docker命令,部署单点es:

docker run -d \

--name es \

-e "ES_JAVA_OPTS=-Xms512m -Xmx512m" \

-e "discovery.type=single-node" \

-v es-data:/usr/share/elasticsearch/data \

-v es-plugins:/usr/share/elasticsearch/plugins \

--privileged \

--network es-net \

-p 9200:9200 \

-p 9300:9300 \

elasticsearch:7.12.1

命令解释:

-e "cluster.name=es-docker-cluster":设置集群名称-e "http.host=0.0.0.0":监听的地址,可以外网访问-e "ES_JAVA_OPTS=-Xms512m -Xmx512m":(将来运行时)内存大小-e "discovery.type=single-node":非集群模式-v es-data:/usr/share/elasticsearch/data:挂载逻辑卷,绑定es的数据目录-v es-logs:/usr/share/elasticsearch/logs:挂载逻辑卷,绑定es的日志目录-v es-plugins:/usr/share/elasticsearch/plugins:挂载逻辑卷,绑定es的插件目录--privileged:授予逻辑卷访问权--network es-net:加入一个名为es-net的网络中 (kibana也会加入,二者才能互相通信)-p 9200:9200:端口映射配置 (9200端口用户访问 9300端口将来各个节点之间互联的端口,目前用不上)

-v 本地卷:容器目录

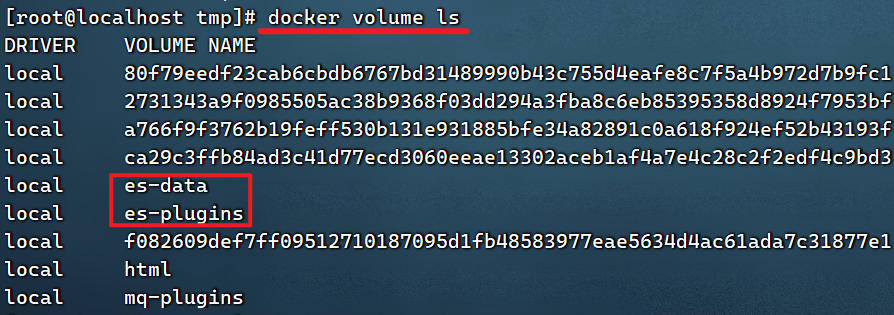

若本地卷没有,应该会帮你创建,通过docker volume inspect 卷名查看卷信息,其中就有本地目录

# 查看所有数据卷

docker volume ls

# 查看数据卷详细信息卷

docker volume inspect html

上述docker run ...命令执行完毕之后,docker ps就可以查看到对应进程了,浏览器端也可以访问到了

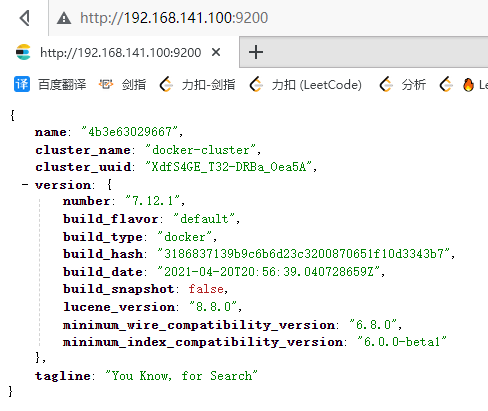

在浏览器中输入:http://192.168.141.100:9200 (注意ip换成自己的) 即可看到elasticsearch的响应结果:

2.部署kibana

kibana可以给我们提供一个elasticsearch的可视化界面,便于我们学习。

2.1.部署

运行docker命令,部署kibana

docker run -d \

--name kibana \

-e ELASTICSEARCH_HOSTS=http://es:9200 \

--network=es-net \

-p 5601:5601 \

kibana:7.12.1

--network es-net:加入一个名为es-net的网络中,与elasticsearch在同一个网络中-e ELASTICSEARCH_HOSTS=http://es:9200":设置elasticsearch的地址,因为kibana已经与elasticsearch在一个网络,因此可以用容器名直接访问elasticsearch-p 5601:5601:端口映射配置

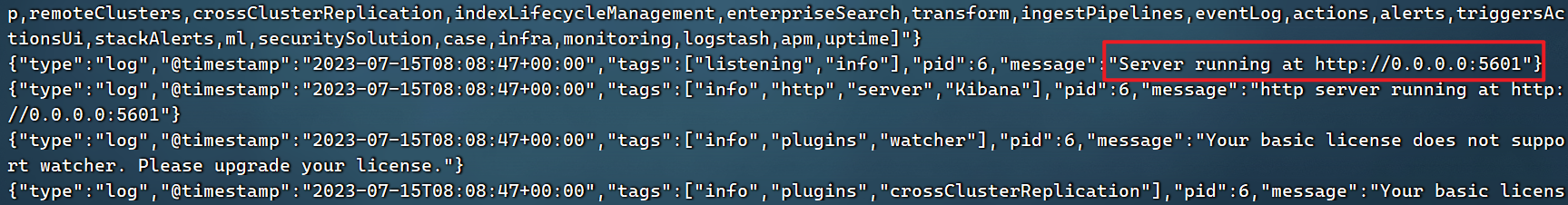

kibana启动一般比较慢,需要多等待一会,可以通过命令:

docker logs -f kibana

查看运行日志,当查看到下面的日志,说明成功:

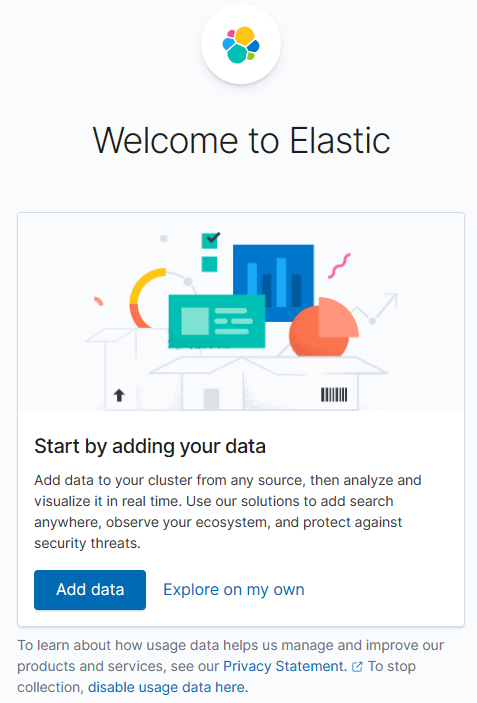

此时,在浏览器输入地址访问:http://192.168.141.100:5601,即可看到结果

看到kibana啦~

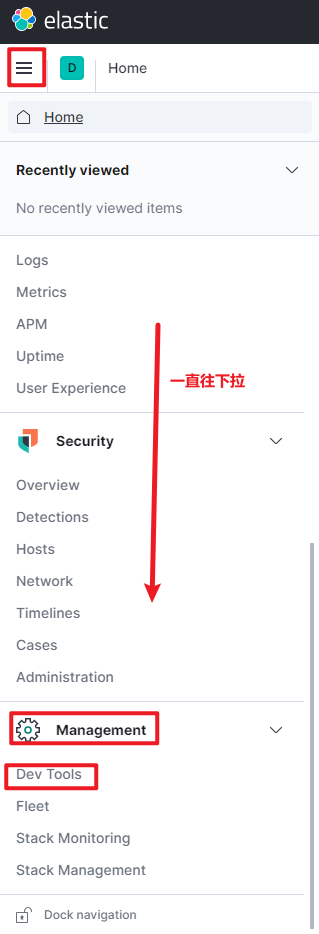

点击Explore on my own,然后

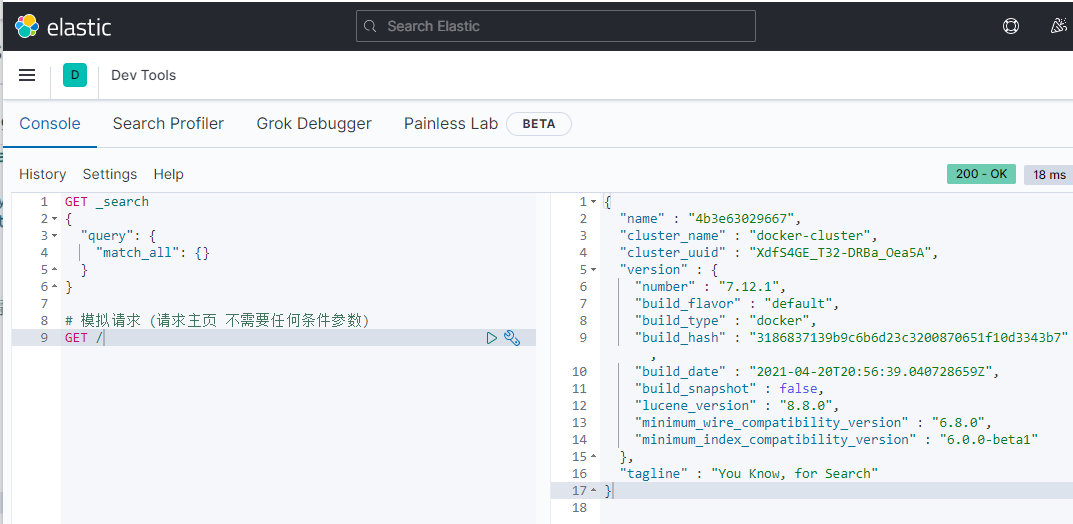

2.2.DevTools

kibana中提供了一个DevTools界面:

这个界面中可以编写DSL来操作elasticsearch。并且对DSL语句有自动补全功能。

左边的json格式语句就是DSL查询语句

本质就是发送一个Restful请求到es中

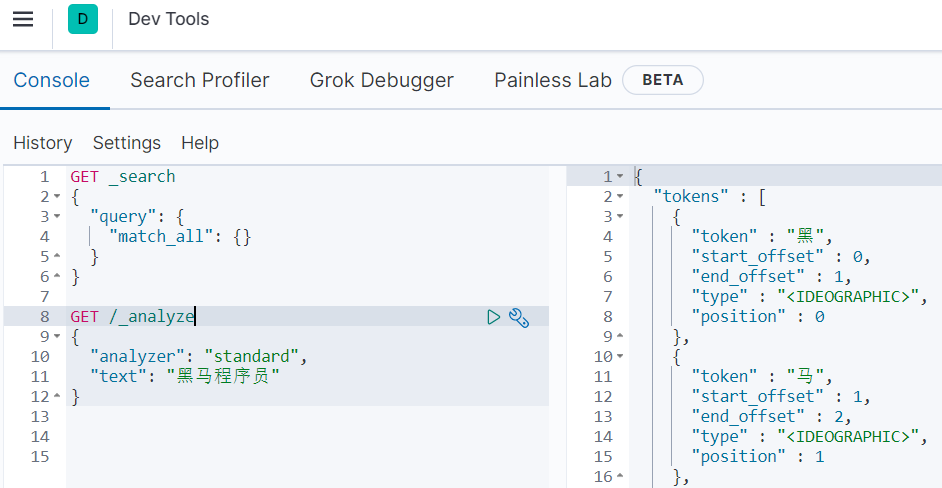

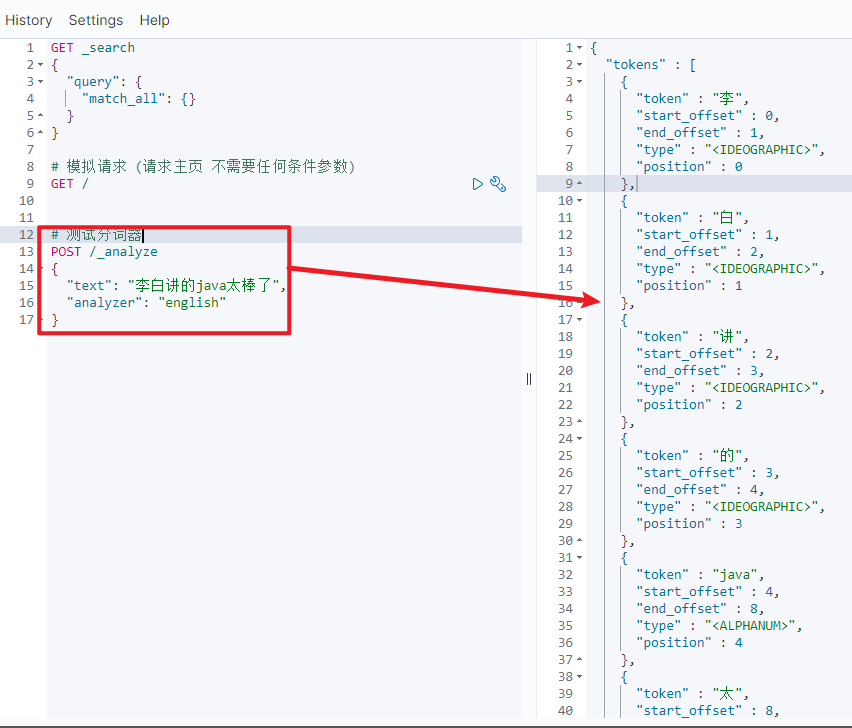

2.3 分词问题(中文不友好)

# 测试分词器

POST /_analyze

{

"text": "李白讲的java太棒了",

"analyzer": "english"

}

{

"tokens" : [

{

"token" : "李",

"start_offset" : 0,

"end_offset" : 1,

"type" : "<IDEOGRAPHIC>",

"position" : 0

},

{

"token" : "白",

"start_offset" : 1,

"end_offset" : 2,

"type" : "<IDEOGRAPHIC>",

"position" : 1

},

{

"token" : "讲",

"start_offset" : 2,

"end_offset" : 3,

"type" : "<IDEOGRAPHIC>",

"position" : 2

},

{

"token" : "的",

"start_offset" : 3,

"end_offset" : 4,

"type" : "<IDEOGRAPHIC>",

"position" : 3

},

{

"token" : "java",

"start_offset" : 4,

"end_offset" : 8,

"type" : "<ALPHANUM>",

"position" : 4

},

{

"token" : "太",

"start_offset" : 8,

"end_offset" : 9,

"type" : "<IDEOGRAPHIC>",

"position" : 5

},

{

"token" : "棒",

"start_offset" : 9,

"end_offset" : 10,

"type" : "<IDEOGRAPHIC>",

"position" : 6

},

{

"token" : "了",

"start_offset" : 10,

"end_offset" : 11,

"type" : "<IDEOGRAPHIC>",

"position" : 7

}

]

}

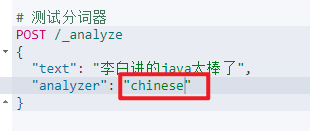

解析器由‘english’改成‘chinese’或者其他‘standard’也还是一样的,运行结果没变

可见:英语分词还是不错的 ‘java’就分成了一个单词。但是中文则是一个字一个字地分地,明显不合适。默认的es无法理解中文含义

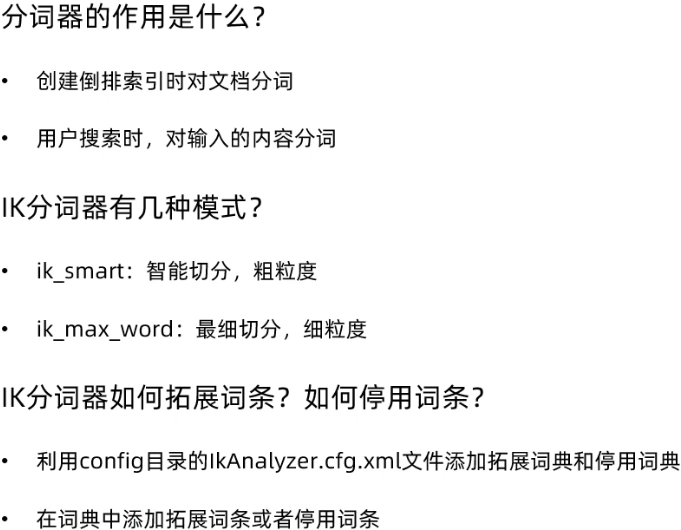

3.安装IK分词器

Git地址: https://github.com/medcl/elasticsearch-analysis-ik

可以看到就是专门给ES使用的

3.1.在线安装ik插件(较慢)

# 进入容器内部

docker exec -it elasticsearch /bin/bash

# 在线下载并安装

./bin/elasticsearch-plugin install https://github.com/medcl/elasticsearch-analysis-ik/releases/download/v7.12.1/elasticsearch-analysis-ik-7.12.1.zip

#退出

exit

#重启容器

docker restart elasticsearch

3.2.离线安装ik插件(推荐)

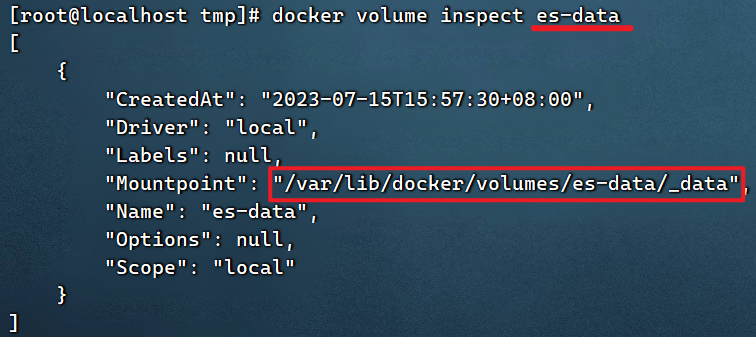

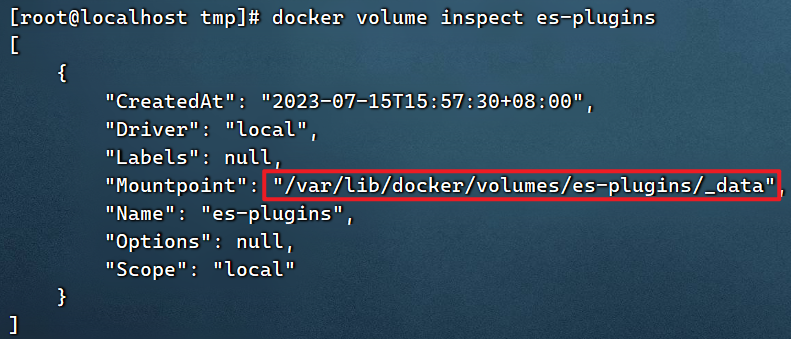

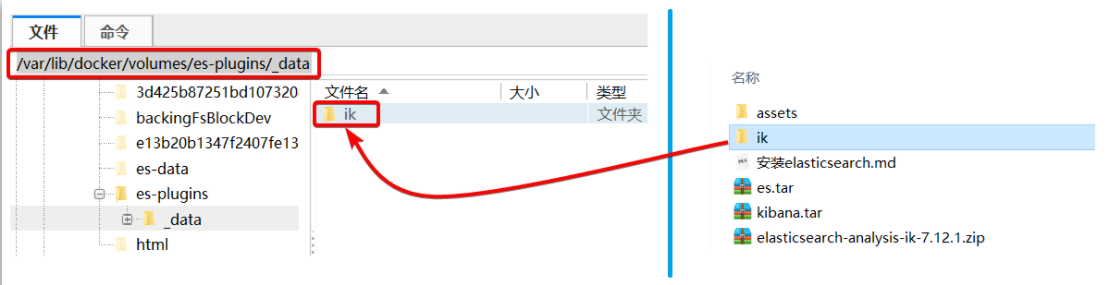

1)查看数据卷目录

安装插件需要知道elasticsearch的plugins目录位置,而我们用了数据卷挂载,因此需要查看elasticsearch的数据卷目录,通过下面命令查看:

docker volume inspect es-plugins

显示结果:

[

{

"CreatedAt": "2023-07-15T15:57:30+08:00",

"Driver": "local",

"Labels": null,

"Mountpoint": "/var/lib/docker/volumes/es-plugins/_data",

"Name": "es-plugins",

"Options": null,

"Scope": "local"

}

]

说明plugins目录被挂载到了:/var/lib/docker/volumes/es-plugins/_data 这个目录中。

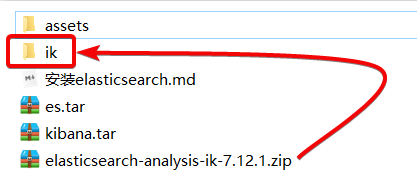

2)解压缩分词器安装包

下面我们需要把课前资料中的ik分词器解压缩,重命名为ik

3)上传到es容器的插件数据卷中

也就是/var/lib/docker/volumes/es-plugins/_data :

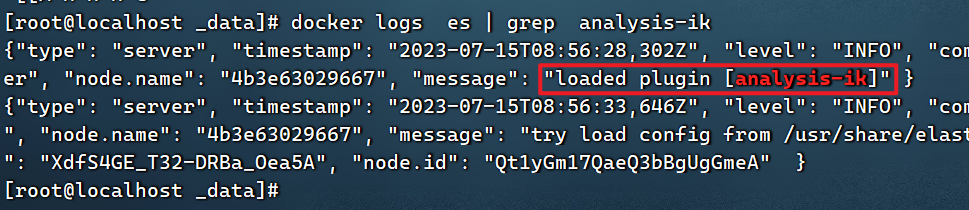

4)重启容器

# 4、重启容器

docker restart es

# 查看es日志

docker logs es | grep analysis-ik

成功加载,分词器安装完毕

5)测试:

IK分词器包含两种模式:

-

ik_smart:最少切分 (尽可能长地组词,然后不再切分) -

ik_max_word:最细切分 (分得更多,是词就分出来,字可以重复使用)

POST /_analyze

{

"text": "胡老师讲的java太棒了",

"analyzer": "ik_max_word"

}

结果:

{

"tokens" : [

{

"token" : "胡",

"start_offset" : 0,

"end_offset" : 1,

"type" : "CN_CHAR",

"position" : 0

},

{

"token" : "老师",

"start_offset" : 1,

"end_offset" : 3,

"type" : "CN_WORD",

"position" : 1

},

{

"token" : "讲",

"start_offset" : 3,

"end_offset" : 4,

"type" : "CN_CHAR",

"position" : 2

},

{

"token" : "的",

"start_offset" : 4,

"end_offset" : 5,

"type" : "CN_CHAR",

"position" : 3

},

{

"token" : "java",

"start_offset" : 5,

"end_offset" : 9,

"type" : "ENGLISH",

"position" : 4

},

{

"token" : "太棒了",

"start_offset" : 9,

"end_offset" : 12,

"type" : "CN_WORD",

"position" : 5

},

{

"token" : "太棒",

"start_offset" : 9,

"end_offset" : 11,

"type" : "CN_WORD",

"position" : 6

},

{

"token" : "了",

"start_offset" : 11,

"end_offset" : 12,

"type" : "CN_CHAR",

"position" : 7

}

]

}

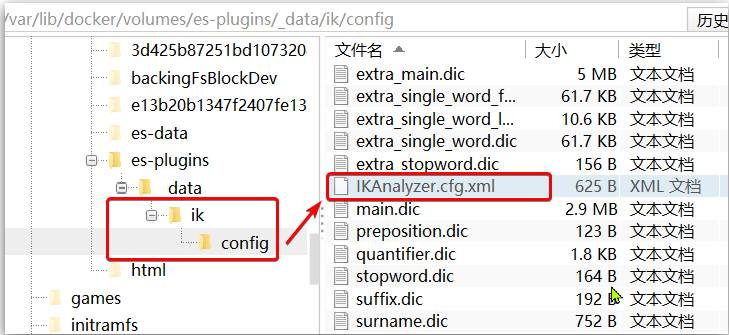

3.3 扩展词词典

随着互联网的发展,“造词运动”也越发的频繁。出现了很多新的词语,在原有的词汇列表中并不存在。比如:“奥力给”,“永远滴神” 等。

所以我们的词汇也需要不断的更新,IK分词器提供了扩展词汇的功能。

1)打开IK分词器config目录:

/var/lib/docker/volumes/es-plugins/_data/ik/config

2)在IKAnalyzer.cfg.xml配置文件内容添加:

配置都已经默认写好了,填个文件名就行了

<?xml version="1.0" encoding="UTF-8"?>

<!DOCTYPE properties SYSTEM "http://java.sun.com/dtd/properties.dtd">

<properties>

<comment>IK Analyzer 扩展配置</comment>

<!--用户可以在这里配置自己的扩展字典 *** 添加扩展词典-->

<entry key="ext_dict">ext.dic</entry>

</properties>

3)新建一个 ext.dic,可以参考config目录下复制一个配置文件进行修改

其实就是一行行列出每个词即可

全红禅

永远滴神

奥力给

4)重启elasticsearch

docker restart es

# 查看 日志

docker logs -f elasticsearch

日志中会显示已经成功加载ext.dic配置文件

或者耐心等一会儿就像,基本都能正常加载

5)测试效果:

POST /_analyze

{

"text": "全红禅永远滴神,我的神,奥力给",

"analyzer": "ik_max_word"

}

注意当前文件的编码必须是 UTF-8 格式,严禁使用Windows记事本编辑

3.4 停用词词典

在互联网项目中,在网络间传输的速度很快,所以很多语言是不允许在网络上传递的,如:关于宗教、政治等敏感词语,那么我们在搜索时也应该忽略当前词汇。

IK分词器也提供了强大的停用词功能,让我们在索引时就直接忽略当前的停用词汇表中的内容。

1)IKAnalyzer.cfg.xml配置文件内容添加:

<?xml version="1.0" encoding="UTF-8"?>

<!DOCTYPE properties SYSTEM "http://java.sun.com/dtd/properties.dtd">

<properties>

<comment>IK Analyzer 扩展配置</comment>

<!--用户可以在这里配置自己的扩展字典-->

<entry key="ext_dict">ext.dic</entry>

<!--用户可以在这里配置自己的扩展停止词字典 *** 添加停用词词典-->

<entry key="ext_stopwords">stopword.dic</entry>

</properties>

其实都配置好了,只是默认两个字典的名称为空

3)在 stopword.dic 添加停用词

该文件默认已经有了,直接在里面添加即可

的

地

了

哦

啊

嘤

4)重启elasticsearch

# 重启服务

docker restart elasticsearch

docker restart kibana

# 查看 日志

docker logs -f elasticsearch

日志中已经成功加载stopword.dic配置文件

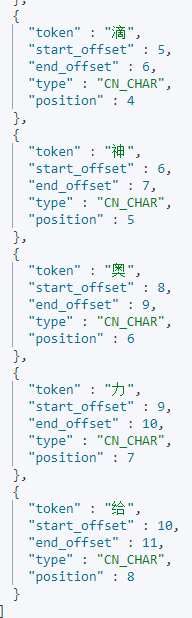

5)测试效果:

POST /_analyze

{

"text": "全红禅永远滴神,我的神,奥力给",

"analyzer": "ik_max_word"

}

注意当前文件的编码必须是 UTF-8 格式,严禁使用Windows记事本编辑

{

"tokens" : [

{

"token" : "全红禅",

"start_offset" : 0,

"end_offset" : 3,

"type" : "CN_WORD",

"position" : 0

},

{

"token" : "永远滴神",

"start_offset" : 3,

"end_offset" : 7,

"type" : "CN_WORD",

"position" : 1

},

{

"token" : "永远",

"start_offset" : 3,

"end_offset" : 5,

"type" : "CN_WORD",

"position" : 2

},

{

"token" : "滴",

"start_offset" : 5,

"end_offset" : 6,

"type" : "CN_CHAR",

"position" : 3

},

{

"token" : "神",

"start_offset" : 6,

"end_offset" : 7,

"type" : "CN_CHAR",

"position" : 4

},

{

"token" : "我",

"start_offset" : 8,

"end_offset" : 9,

"type" : "CN_CHAR",

"position" : 5

},

{

"token" : "神",

"start_offset" : 10,

"end_offset" : 11,

"type" : "CN_CHAR",

"position" : 6

},

{

"token" : "奥力给",

"start_offset" : 12,

"end_offset" : 15,

"type" : "CN_WORD",

"position" : 7

}

]

}

全红禅、永远滴神、奥利给。 都能识别为成语了

的。不会成为分词了

- 小结

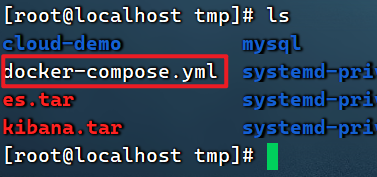

4.部署es集群

部署es集群可以直接使用docker-compose来完成,不过要求你的Linux虚拟机至少有4G的内存空间(不够就重新分配增加一下)

4.1.创建es集群

首先编写一个docker-compose文件,内容如下:

docker-compose.yml

version: '2.2'

services:

es01:

image: elasticsearch:7.12.1

container_name: es01

environment:

- node.name=es01

- cluster.name=es-docker-cluster

- discovery.seed_hosts=es02,es03

- cluster.initial_master_nodes=es01,es02,es03

- "ES_JAVA_OPTS=-Xms512m -Xmx512m"

volumes:

- data01:/usr/share/elasticsearch/data

ports:

- 9200:9200

networks:

- elastic

es02:

image: elasticsearch:7.12.1

container_name: es02

environment:

- node.name=es02

- cluster.name=es-docker-cluster

- discovery.seed_hosts=es01,es03

- cluster.initial_master_nodes=es01,es02,es03

- "ES_JAVA_OPTS=-Xms512m -Xmx512m"

volumes:

- data02:/usr/share/elasticsearch/data

ports:

- 9201:9200

networks:

- elastic

es03:

image: elasticsearch:7.12.1

container_name: es03

environment:

- node.name=es03

- cluster.name=es-docker-cluster

- discovery.seed_hosts=es01,es02

- cluster.initial_master_nodes=es01,es02,es03

- "ES_JAVA_OPTS=-Xms512m -Xmx512m"

volumes:

- data03:/usr/share/elasticsearch/data

networks:

- elastic

ports:

- 9202:9200

volumes:

data01:

driver: local

data02:

driver: local

data03:

driver: local

networks:

elastic:

driver: bridge

从yml文件中可以看到:

es01端口9200

es02端口9201

es03端口9202

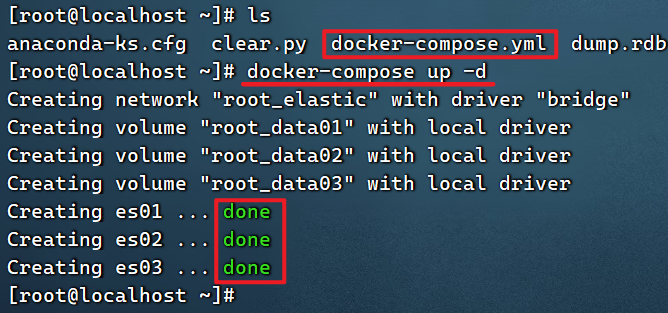

将上传到linux

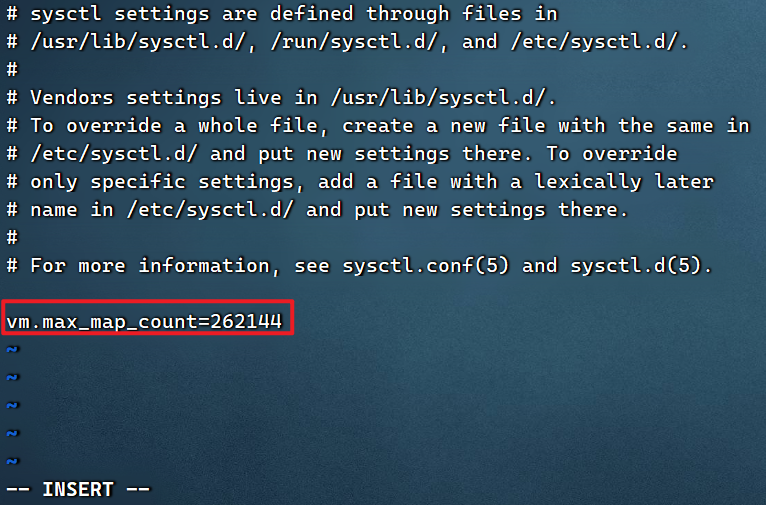

es运行需要修改一些linux系统权限,修改/etc/sysctl.conf文件

vi /etc/sysctl.conf

添加下面的内容:

vm.max_map_count=262144

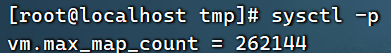

然后执行命令,让配置生效:

sysctl -p

若重启了虚拟机,还得先启动下docker

systemctl start docker

Run docker-compose to bring up the cluster:

docker-compose up -d

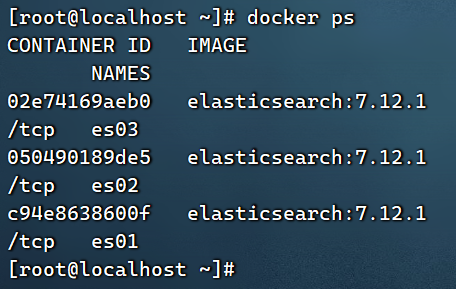

查看每个节点的日志

docker logs -f es01

docker logs -f es02

docker logs -f es03

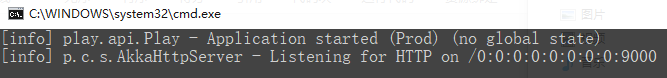

4.2.集群状态监控

kibana可以监控es集群,不过新版本需要依赖es的x-pack 功能,配置比较复杂。

这里推荐使用cerebro来监控es集群状态,官方网址:https://github.com/lmenezes/cerebro

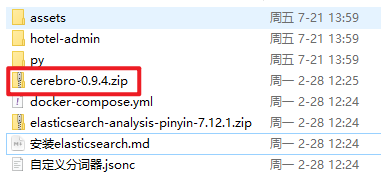

课前资料已经提供了安装包:

链接:https://pan.baidu.com/s/1zrji4O8niH_UmQNKBhNIPg

提取码:hzan

解压即可使用,非常方便。

解压好的目录如下:

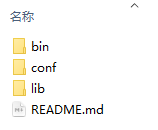

进入对应的bin目录:

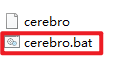

双击其中的cerebro.bat文件即可启动服务。

jdk17等高版本启动,会报错:

Caused by: java.lang.IllegalStateException: Unable to load cache item

将环境变量里的java改成jdk8的环境变量即可

也就是使用jdk8

访问http://localhost:9000 即可进入管理界面:

http://192.168.141.100:9200/

输入你的elasticsearch的任意节点的地址和端口,点击connect即可:

绿色的条,代表集群处于绿色(健康状态)。

4.3.创建索引库

1)利用kibana的DevTools创建索引库

在DevTools中输入指令:

多个节点就是为了分片存储索引库,然后相互备份

如何分片,几个副本呢?创建索引库时配置好

PUT /itcast

{

"settings": {

"number_of_shards": 3, // 分片数量

"number_of_replicas": 1 // 副本数量

},

"mappings": {

"properties": {

// mapping映射定义 ...

}

}

}

kibana已经停掉了,其实也可以利用cerebro创建索引库

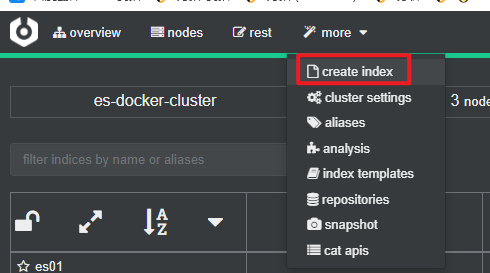

2)利用cerebro创建索引库

利用cerebro还可以创建索引库:

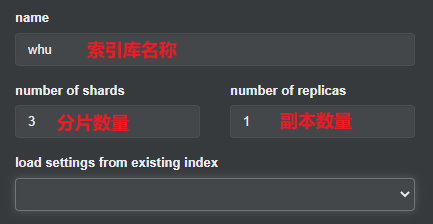

填写索引库信息:

点击右下角的create按钮:

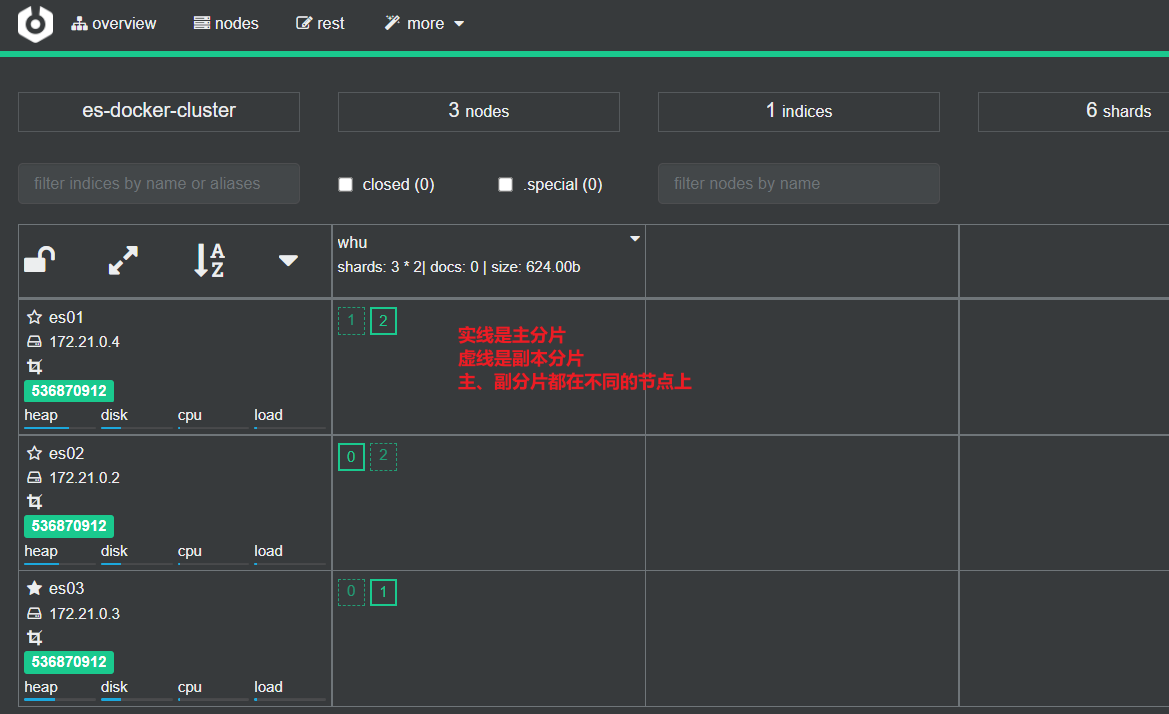

4.4.查看分片效果

回到首页,即可查看索引库分片效果:

和案例图中画的一摸一样

这些发现了一个误区,上图不是有3个索引库,而是一个索引库被分成了3片存储,每片存储在不同的es实例上,3个实例之间的分片互为备份