20 世纪 90 年代初,英特尔是 CPU 市场的主导力量,以其可靠的高性能微处理器吸引了科技爱好者和企业。然而,这些技术的价格很高,这使得许多潜在用户(包括我自己)在经济上无法获得该技术。

AMD 通过提供价格实惠的 CPU 打破了这种垄断,这些 CPU 在性能方面可以与英特尔相媲美。通过迎合对“足够好”性能感到满意的“过度服务”市场用户,AMD 充分利用了英特尔无意中留下的市场空白。这一转变成为克莱顿·克里斯滕森颠覆性创新理论的教科书案例。克里斯滕森在他的众多书籍和演讲中经常提到他与英特尔首席执行官安迪·格罗夫的互动。在某种程度上,AMD 的出现促使英特尔推出更便宜的奔腾 CPU 变体,并以赛扬变体进行销售。赛扬虽然仍由英特尔生产,但具有较低的缓存和较慢的时钟速度,专为那些正在寻找足够好的 CPU 来运行计算机的人(包括我自己)而设计。

快进到今天,人工智能 (AI) 领域正在发生类似的转变。Meta 开源其先进的 Llama2 语言模型的动机可能是多种多样的,但其中最重要的是大型语言模型 (LLM) 的民主化,它迎合了服务不足和服务过度的细分市场。

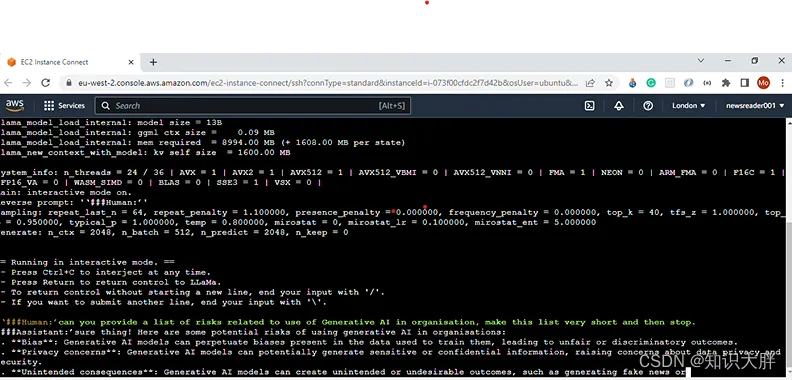

通过免费提供最先进的语言模型,Meta 正在打开以前被认为难以接近的大门。结合量化等技术,显着降低 CPU 资源需求,有时甚至完全消除对 GPU 的需求,Meta 正在为新的、包容性的 AI 生态系统铺平道路。

这一战略举措旨在让人工智能技术普及。直到最近,这种先进模型的使用仍然是为那些有能力买得起的人保留的。现在,借助量化,甚至 CPU 也可以承载这些模型,