2022年11月,OpenAI公司发布了ChatGPT,这是迄今为止人工智能在现实世界中最重要的应用之一。

当前,互联网搜索引擎中出现了越来越多的人工智能(AI)聊天机器人,例如谷歌的Bard和微软的Bing,看起来也将越来越多地改变科学搜索。

■ 2023年3月,《J Med Internet Res》(IF=7.4)在线发表了一项关于ChatGPT的文章,题为Artificial Intelligence Can Generate Fraudulent but Authentic-Looking Scientific Medical Articles: Pandora’s Box Has Been Opened。研究者利用ChatGPT生成了一篇完整的神经外科论文,在用词、句子表述、论文结构方面都与真正的医学论文非常相似,包含1992个词和17篇参考文献,整个文章创建过程大约花了1个小时。

■ 还有不久前,美国田纳西大学健康科学中心的放射科医生Som Biswas,在4个月内使用ChatGPT写了16篇论文,并在4个不同的期刊上发表了其中5篇。

■ 2023年7月7日,Nature新闻栏目发表了一篇讨论性文章,题为《Scientists used ChatGPT to generate an entire paper from scratch — but is it any good?》文中介绍道:两位科学家借助人工智能工具ChatGPT,在不到一个小时的时间内撰写了一篇研究论文。这篇文章流畅、富有洞察力,并按照科学论文的预期结构呈现。

不得不说,随着ChatGPT的入局,AIGC(人工智能生成内容)数量井喷,尤其是在学界,ChatGPT更是成为科研人员的得力助手。

为此,7月4日,牛津、剑桥、布里斯托、爱丁堡等24所罗素大学成员集体松口,宣布解除ChatGPT使用禁令,并推出了详细的使用原则,以帮助学生和研究人员更好地使用生成式AI,抓住生成式AI带来的全新教育和发展机遇。

Elsevier推出AI工具

据《nature》最新报道,8月1日,荷兰出版巨头Elsevier为其Scopus数据库的部分用户发布了一个基于ChatGPT的AI界面。当天,英国公司Digital Science也宣布为其Dimensions数据库的AI大语言模型(LLM)进行封闭试验。与此同时,美国科睿唯安(Clarivate)公司表示,它也在努力将LLM纳入其Web of Science数据库。

用于科学搜索的LLM并不是什么新鲜事物,Elicit、Scite 和 Consensus等初创公司已经拥有此类人工智能系统,这些系统依靠免费的科学数据库或(在Scite的情况下)通过与出版商的合作访问付费研究文章,来帮助总结某个领域的研究进展或识别热门研究。

而现在,拥有大型科学摘要和参考文献专有数据库的公司也加入了人工智能热潮。

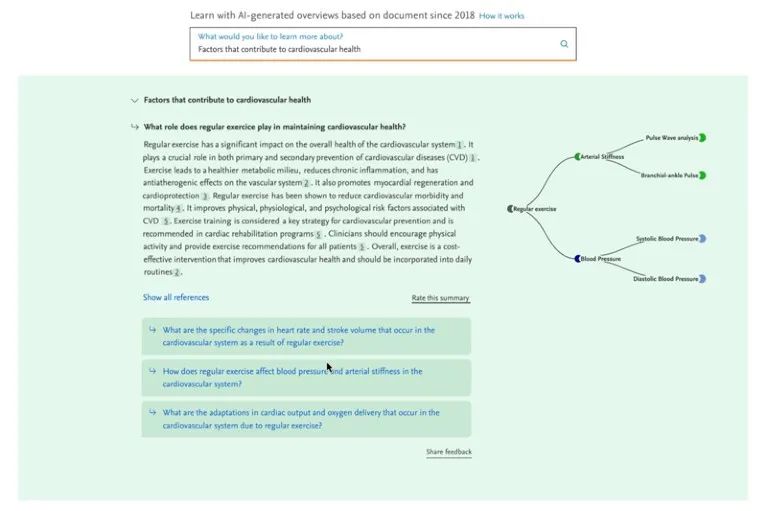

负责该工具开发的爱思唯尔(Elsevier)驻伦敦高管Maxim Khan表示,爱思唯尔的聊天机器人名为Scopus AI,作为试点推出,旨在作为一种轻便、有趣的工具,旨在帮助研究人员快速获得他们不熟悉的研究主题的摘要。

为了回答自然语言问题,机器人使用LLM GPT-3.5版本可以获得一段关于该研究主题的流畅总结、引用的参考文献和有待进一步探索的问题。

对于搜索(尤其是科学搜索)的LLM,学者的一个担忧是它们不可靠。

LLM无法理解他们生成的文本;他们的工作方式很简单,就是输出文本上看似合理的词语。正如学者们很快发现的那样,他们的内容可能包含事实错误和偏见,甚至还会编造出不存在的参考文献。

因此,Scopus AI受到限制:它只能通过参考5-10份研究摘要来生成答案。

人工智能本身不会找到这些摘要:相反,在用户输入查询后,传统搜索引擎会返回与问题相关的摘要,Khan解释道。

关注人工智能搜索工具的新加坡管理大学图书馆员Aaron Tay指出,许多其他人工智能搜索引擎系统也采用了类似的策略。这有时被称为检索增强生成,因为LLM仅限于总结另一个搜索引擎检索的相关信息。

“LLM仍然偶尔会产生幻觉或编造故事,”Tay说道,他指的是使用类似技术的互联网搜索人工智能聊天机器人(例如 Bing 和 Perplexity)的研究。

爱思唯尔还将其人工智能产品限制为仅搜索2018年以来发表的文章,以获取最近的论文,并指示其聊天机器人在回复中适当引用返回的摘要,以避免不安全或恶意的查询,并说明是否有它收到的摘要中没有相关信息。

这虽然不能避免错误,但可以最大限度地减少错误。

爱思唯尔还通过为机器人的“温度”选择较低的设置来降低其人工智能的不可预测性(“温度”是一种衡量机器人在响应中选择偏离最合理词语的频率的指标)。

那么,用户是否可以简单地将机器人的段落复制并粘贴到自己的论文中,从而有效地抄袭该工具?

Khan说,这是有可能的。到目前为止,爱思唯尔已经通过“指导意见”来解决这个问题,要求研究人员负责任地使用这些摘要。

Khan指出,资助者和出版商也发布了类似的指导意见,要求透明披露LLM是否用于代写论文或进行同行评审,或者在某些情况下声明根本不应该使用LLM。

目前,该工具仅向大约15,000名用户(Scopus 订阅者的一部分)推出。该公司表示预计将于2024年初全面推出。

同样在8月1日,Digital Science宣布为其大型Dimensions科学数据库推出人工智能助手,目前仅适用于选定的Beta测试人员。(Digital Science 隶属于 Holtzbrinck 出版集团,该集团是《nature》杂志出版商 Springer Nature 的大股东)。

与Scopus AI 不同,用户输入问题后,搜索引擎首先检索相关文章,然后Open AI GPT模型围绕已检索到的排名靠前的摘要生成摘要段落。

Dimensions还利用LLM提供有关相关论文的更多详细信息,包括其研究结果的简短改写摘要。

该公司首席产品官Christian Herzog表示,该公司希望在今年年底之前更广泛地发布其工具,但目前正在与科学家、资助者和其他使用Dimensions的人合作,以测试LLM可能在哪些方面有用——这还有待观察。

Tay表示,他期待能够在论文全文(而不仅仅是摘要)上使用LLM的工具。他指出,Elicit等网站已经允许用户使用LLM来回答有关论文全文的详细问题。

与此同时,Clarivate的“学术和政府部门”总裁Bar Veinstein表示,该公司“正在努力在Web of Science中添加由LLM支持的搜索引擎。然而,Veinstein没有给出基于LLM的 Web of Science工具的发布时间表。