IDR: Self-Supervised Image Denoising via Iterative Data Refinement

2022 CVPR

目录

IDR: Self-Supervised Image Denoising via Iterative Data Refinement

背景:

虽然现有的无监督方法能够学习图像去噪,而无需真实的干净图像,但它们要么表现出较差的性能,要么在不切实际的设置下工作(如成对的噪声图、只针对加性噪声)。

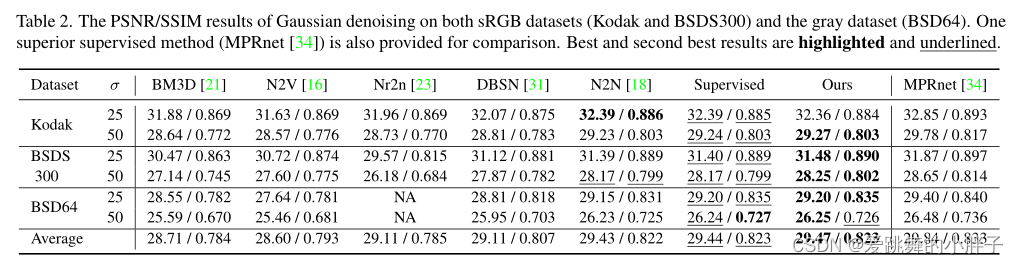

本文提出只需要单个噪声图像和噪声模型,就可以实现较好的去噪效果,对真实噪声、合成和相关噪声的实验表明,提出的无监督去噪方法比现有的无监督方法具有更好的性能,并且与有监督方法具有竞争性。

方法框架:

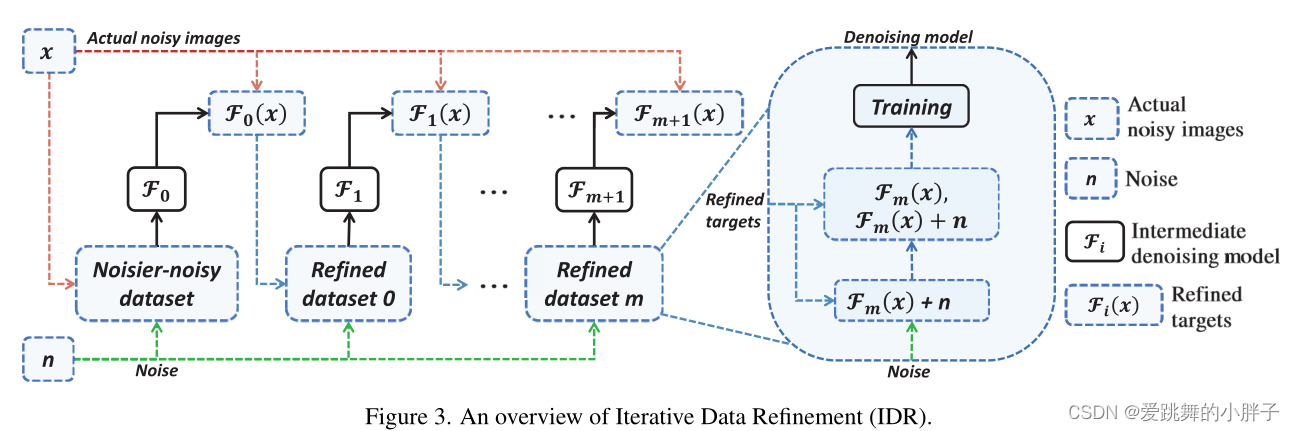

提出了一种自监督图像去噪方案——迭代数据细化(IDR),它在更实际的设置下工作,只需要单个噪声图像和噪声模型。

实验:

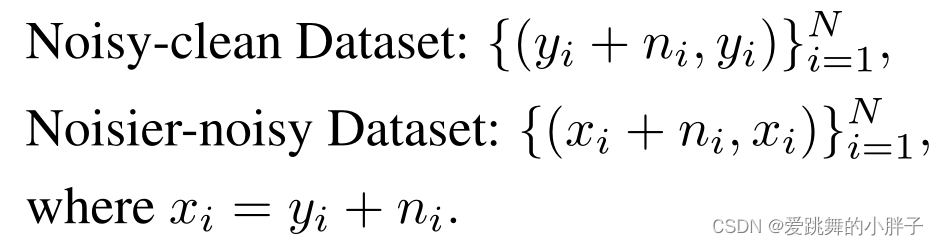

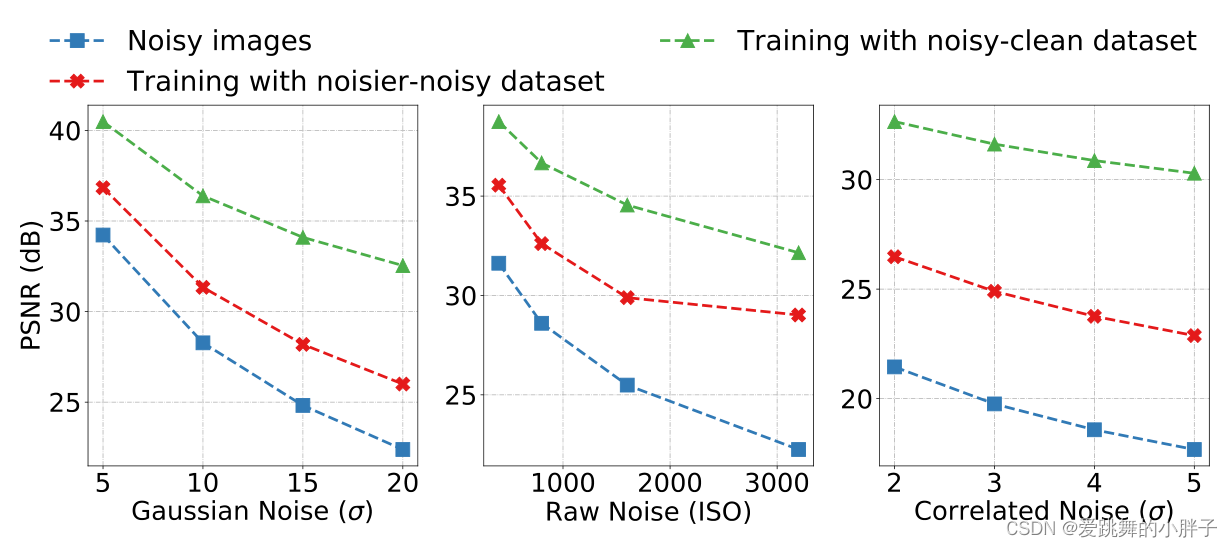

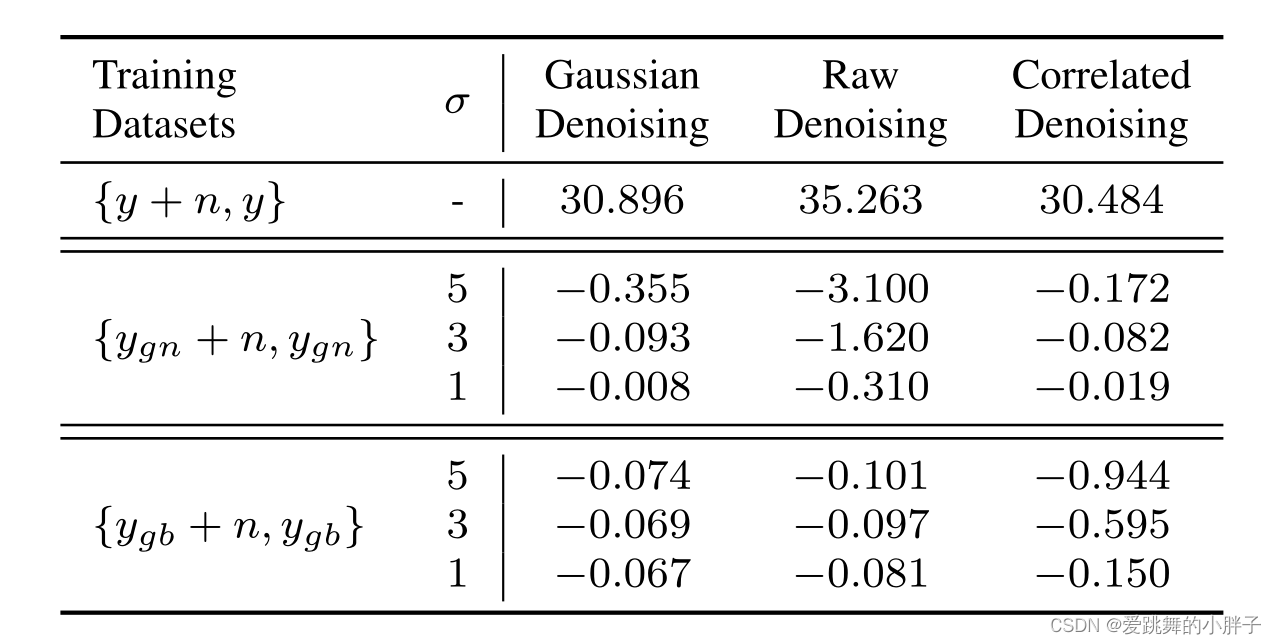

实证验证两个发现:(1)在噪声更大数据集上训练的去噪模型具有去除真实噪声图像的泛化能力;(2) 减少添加噪声的噪声水平,可以减少Noiser-noisy Dataset和Noisy-clean Dataset之间的数据偏差,让 Noiser-noisy Dataset和Noisy-clean Dataset训练结果更接近。

用噪声更大的数据集训练的去噪网络可以用相同的噪声模型对实际的噪声图像进行去噪。

在相同的噪声模型下,在朝向理想噪声干净数据集的较少偏差数据集上进行训练有助于去噪网络实现更好的性能。

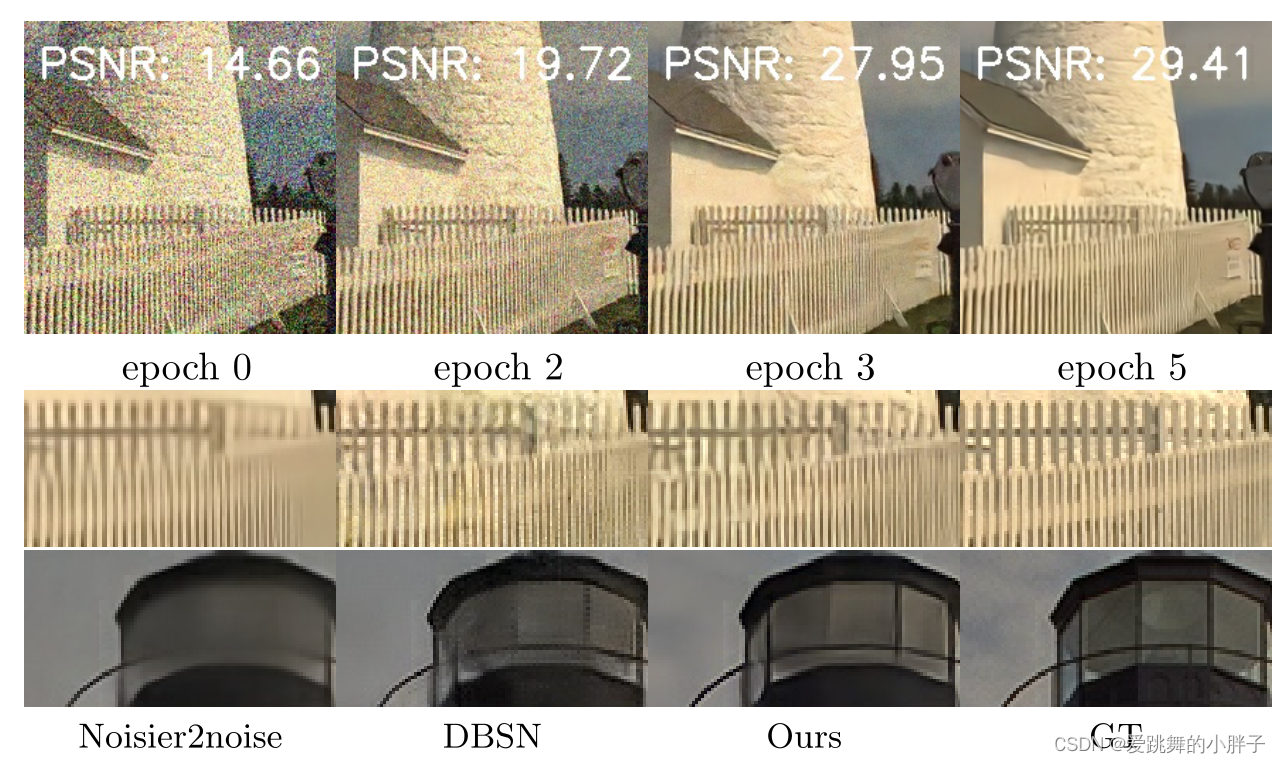

快速迭代算法:

- 每个数据集只训练一个epoch,我们牺牲了完整模型优化所需的时间,但增加了数据优化的迭代次数。它的成本不到总训练时间的5%。因此,总训练时间减少到与仅训练一轮去噪模型的时间几乎相同。

- 当在每个时期对新数据集进行训练时,我们的模型由上一时期的模型初始化,这种累积训练策略有助于去噪网络通过所提出的快速数据细化方案更快地收敛,并确保在整个训练过程中不断优化最终的去噪模型。

去除了训练目标上的噪声,并逐步恢复了更多纹理,此方法在恢复了更多的纹理和颜色,同时保持了高质量的去噪结果

不足之处:

- 颜色恢复还是有偏差;

- 耗时且不易收敛;

- 缺乏理论支撑。

总结:提出了一种实用的迭代去噪方法(IDR),该方法优于现有的无监督去噪方法。虽然缺乏理论支持,但对三种合成噪声、真实世界原始图像噪声甚至空间相关噪声的实验证明了方法的一致鲁棒性和有效性