萧箫 发自 凹非寺

量子位 | 公众号 QbitAI

可生成1024×576高清分辨率视频的大模型,开源了!

无论是在海草间游动的小鱼:

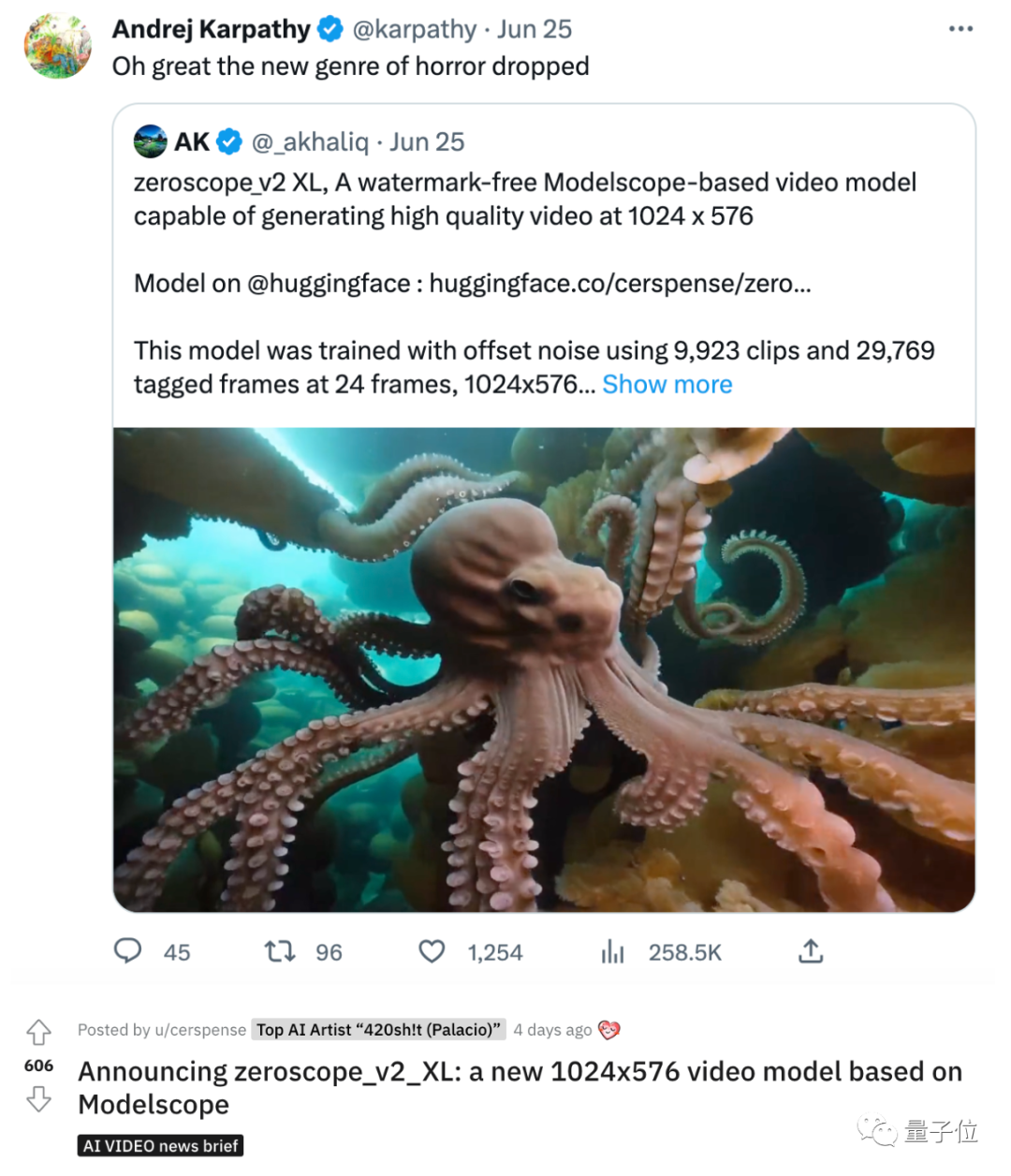

还是精细到眼珠子的神秘克苏鲁图像:

全部以前所未有的清晰感呈现出来,让网友直呼“san值狂掉”。

这个视频生成模型开源即爆火,不仅在推特和Reddit上收获一众热度,就连前特斯拉AI总监Andrej Karpathy也来围观了一波:

现在,Hugging Face工程师已经搞出了试玩demo,不少网友直接线上开炫,例如生成《星球大战》达斯·维德在水上冲浪的珍贵影像:

效果看起来也不错,所以它究竟是怎么训练的?

基于17亿参数大模型改造

Zeroscope的“原型”,是达摩院ModelScope(魔搭)社区开源的17亿参数文生视频大模型。

这一版大模型由文本特征提取、文本特征到视频隐空间扩散模型、视频隐空间到视频视觉空间3个子网络组成。

其中,扩散模型采用Unet3D结构,通过从纯高斯噪声视频中迭代去噪过程,最终实现视频生成。

不过在ModelScope社区中开源的这版大模型,生成视频的效果还不能说是高清:

为此,ZeroScope设计了两个阶段,先通过文生视频、再通过视频生视频提升分辨率,最终生成1024×576分辨率的视频:

第一步,文生视频,基于ZeroScope_v2_576w来生成576×320分辨率的视频;

第二步,视频生视频,基于ZeroScope_v2_XL来生成1024×576分辨率的视频片段。

训练上,ZeroScope采用了9923个1024×576分辨率的视频片段,每个片段包含24帧画面,其中有3帧被打上标记,加起来一个是29769个标记帧(tagged frames)。

不过,生成高清视频,需要的硬件要求也会更高一些。

要想生成576×320分辨率、帧率30的视频,至少需要7.9GB的VRam(显存的一种);如果要生成1024×576分辨率、帧率30的视频,则至少需要15.3GB的VRam。

有网友感到高兴:

又一个足以与Gen-2竞争的文生视频模型出现了!

甚至有网友认为,这个模型的出现已经说明,人们没必要为了Runway搞出来的Gen-2付钱了,毕竟后者效果也没有那么好。

无论如何,文生视频AI领域的“新搅局者”都已经出现。

在线试玩Demo已出

模型一开源,Hugging Face上就已经出现了试玩Demo。

这里我们试着生成“和爱因斯坦打高尔夫球”。

效果还不错,虽然不知道为什么爱因斯坦打着打着蹲下了(手动狗头)

从提示词类型来看,不仅可以输入比较精细的描述:

例如“一个男人在行驶的火车上睡觉,窗外物体飞速移动”(A man is sleeping in his seat, inside a train running, background behind the window is moving fast)

也可以只输入简单的一句话,像是“巨型皮卡丘大战哥斯拉”(Giant Pikachu versus Godzilla fight)

除此之外,也有不少网友分享了自己的作品。

例如这是“爱因斯坦大笑着开星球大战里的飞梭赛车”:

还有网友@Callimiya生成了“达斯维德在课室跳舞”的神奇视频,似乎还有小孩子在陪他一起跳:

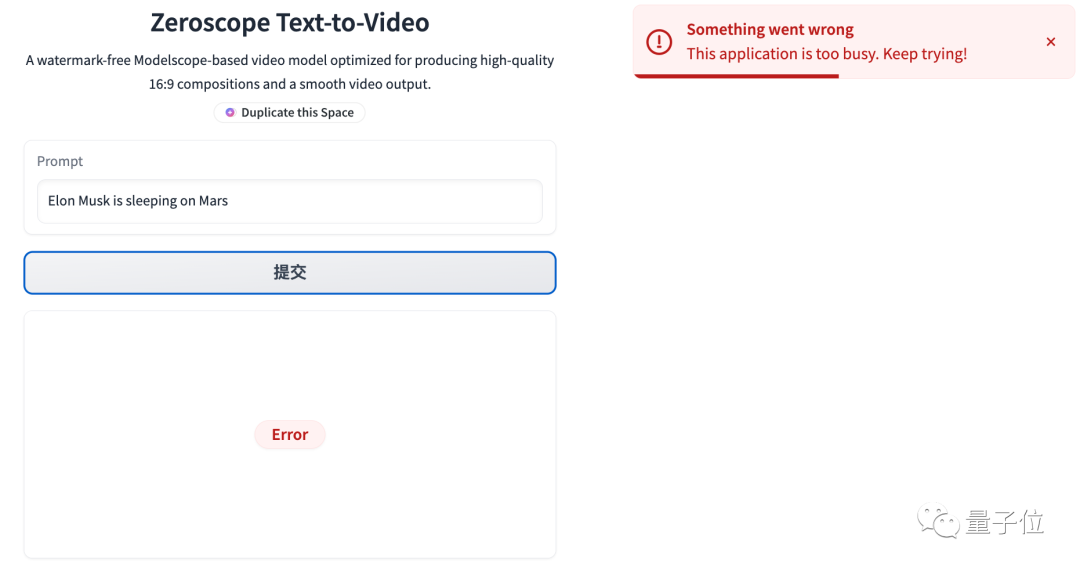

不过,由于试玩人数比较多,导致它有时会出bug。这时候只要不停地提交,还是可以冲进队列中的。

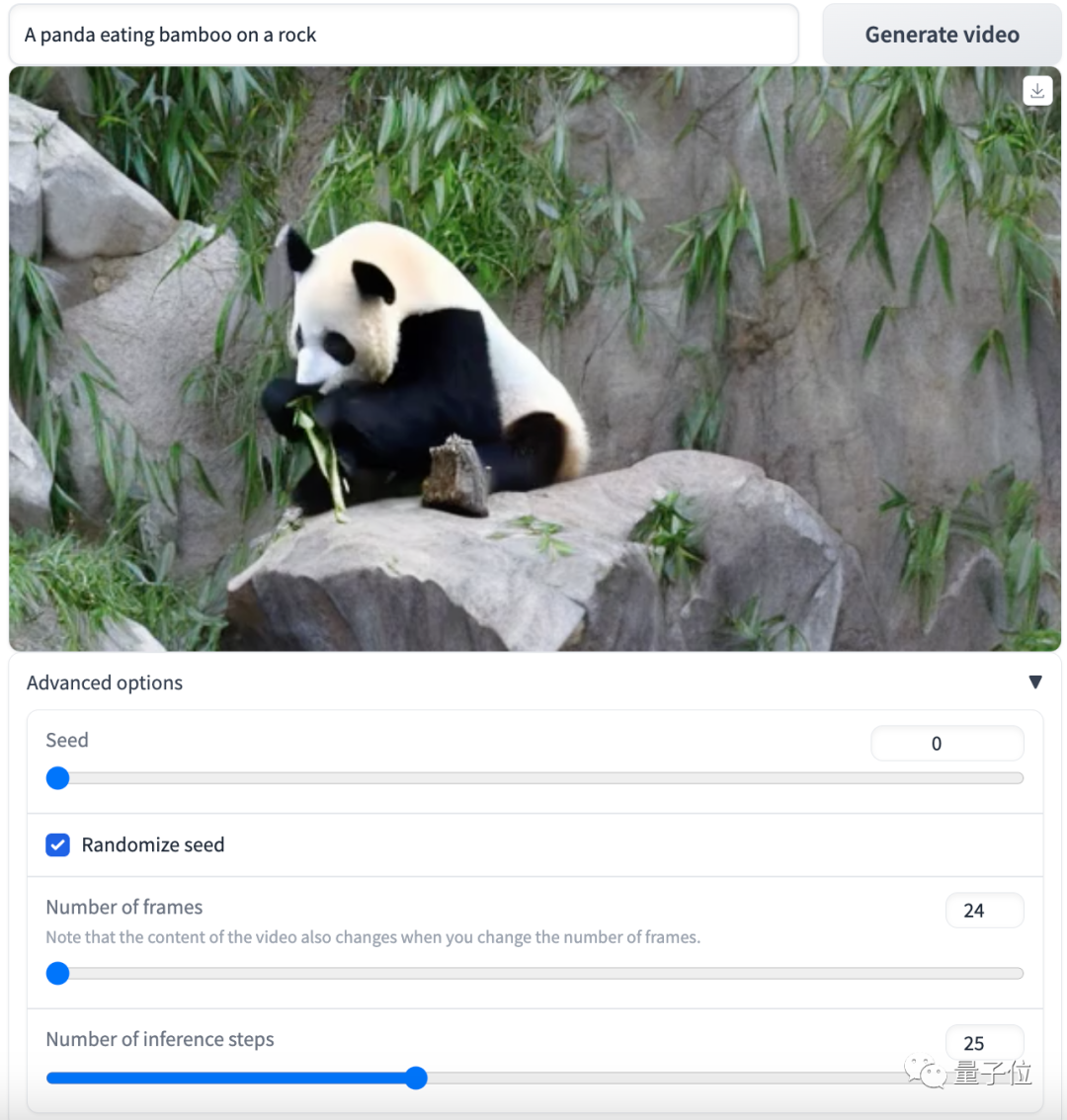

当然,如果你觉得这一版的Demo可控性不够好,还可以尝试另一版,无论是seed (便于生成相似内容)还是推理次数都可手动调整:

怎么样,想好用它生成什么新视频了吗?

简单版试玩:

https://huggingface.co/spaces/fffiloni/zeroscope

可控版进阶试玩:

https://huggingface.co/spaces/hysts/zeroscope-v2

参考链接:

[1]https://twitter.com/_akhaliq/status/1672650155743408133

[2]https://www.reddit.com/r/aivideo/comments/14hbiql/announcing_zeroscope_v2_xl_a_new_1024x576_video/

[3]https://twitter.com/fffiloni/status/1673644193967747072