近日,深度学习之父LeCun强烈推荐了一篇关于使用大型语言模型(LLM)工具GPT-4进行科研的经验分享。该篇分享详细阐述了如何高效地利用LLM工具,值得一读。

此外,分享中也提到了一些使用LLM工具时需要注意的陷阱,其中包括:

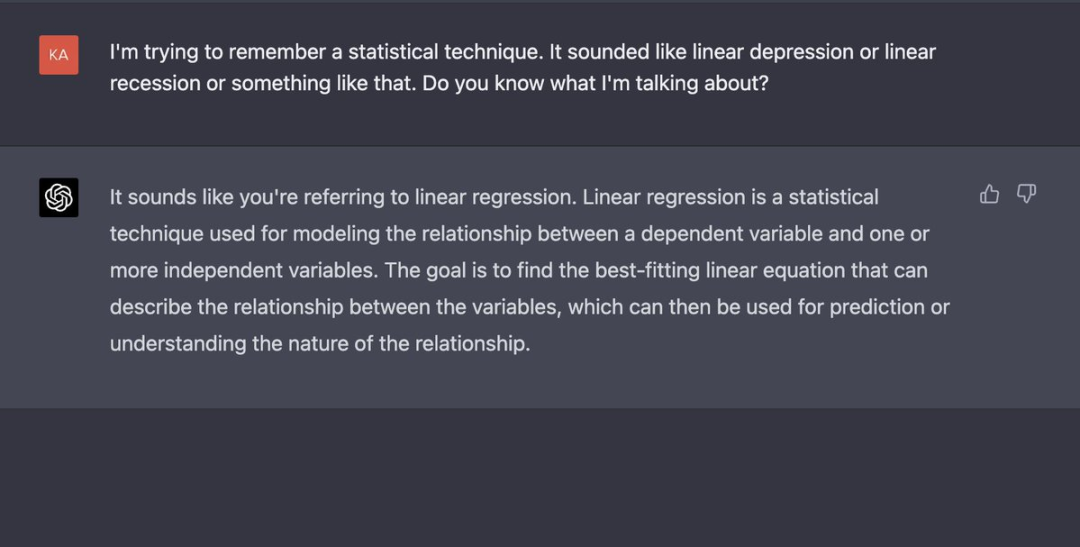

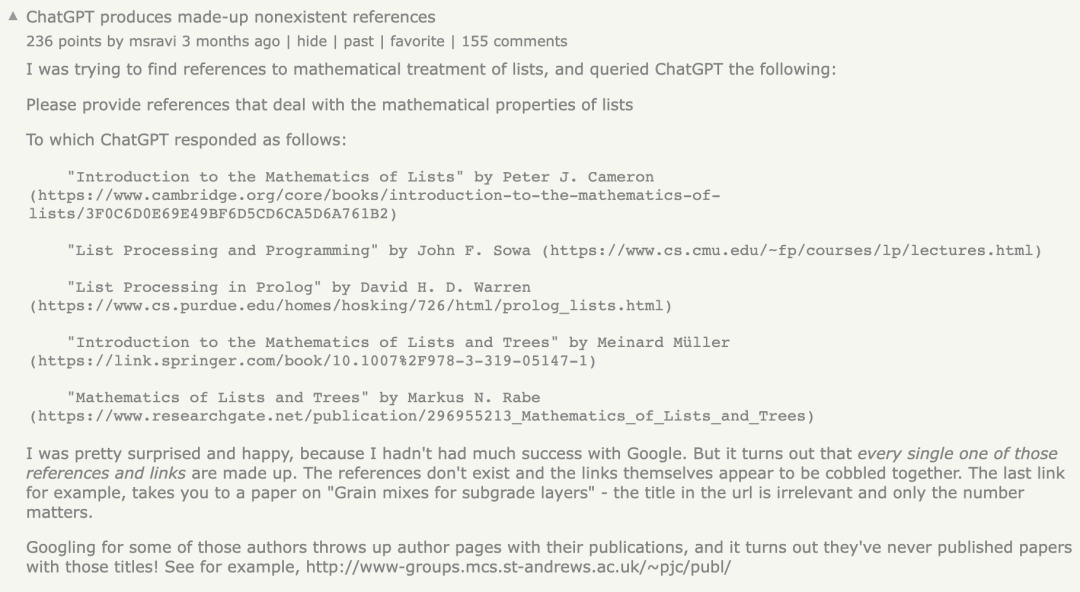

不要询问LLM你无法自行验证的信息或任务,唯一的例外是一些关键任务。比如询问公寓装饰的想法是可以的,但对于需要验证的信息,则需要使用文献综述的最佳实践,比如请求顶级评论文章的清单,这样可以验证来源和可靠性。

设置上下文以及使用术语和符号可以让LLM倾向于正确的上下文信息。此外,明确告诉LLM应该使用什么信息,比如使用Cauchy-Schwarz定理来解决不等式等。

定义输出格式,比如代码、数学公式、文章等,也可以要求提供生成特定内容的代码、表格、绘图、图表等。

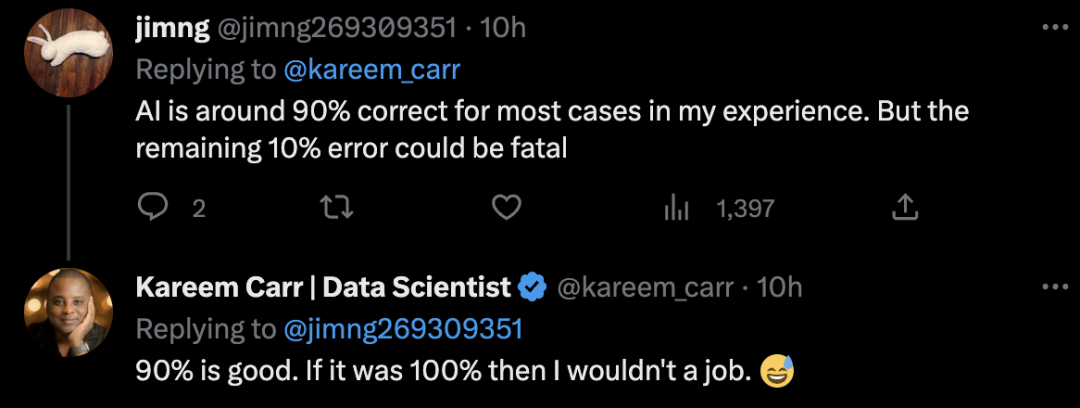

最后,需要对输出内容进行验证,包括发现不一致之处、通过谷歌检索工具输出内容的术语获取可支撑的信源以及在可能的情况下编写代码进行测试。这是因为LLM经常会犯一些与其看似专业水平不一致的错误。

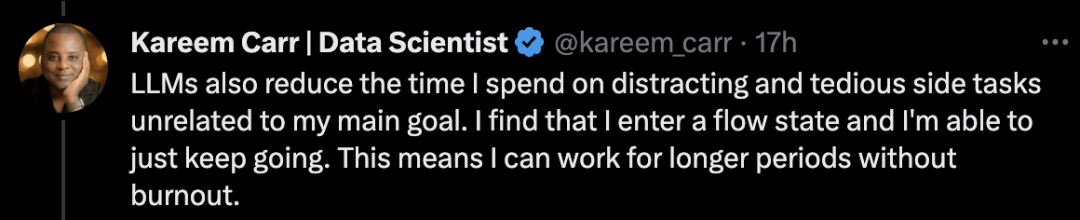

综上,高效地利用LLM工具可以为科研工作带来极大的帮助,但是需要谨慎使用和验证输出内容的可靠性。