经过长时间的技术研发、测试,终于推出可以商用的机器人视觉感知云服务,像科大讯飞的语音识别、语义理解、语音合成一样,商家或个人在开发机器人等智能硬件产品时,随时可以接入视觉感知云服务接口,轻松方便让您的智能设备拥有视觉智能。下面就先来看看视觉感知云服务的使用手册吧。

目录

-

第一章 提供哪些服务

-

第二章 发展之路线图

-

第三章 接口调用说明

-

第四章 接口调用体验

-------------------------------

第一章 提供哪些服务

基于栅格地图下的二维与三维环境及物体识别(是猫是人还是汽车、是方桌还是圆柱等),包括不同环境及物体间的相互关系(旋转不变性、镜像对称性、缩放不变性、平移不变性),以及实时环境下的自主运动规划(这是不同与A*、D*算法,也有别与SLAM)。

第二章 发展之路线图

当前已经上线服务的是AI 1.0版。

第三章 接口调用说明

-

接口名称:二维与三维视觉感知与自主运动规划

-

接口版本:1.0

-

接口地址:http://aiethan.com/user/robotvision.htm

-

请求参数:PCL格式的点云数据

-

响应参数:扩展PCL格式的点云数据

详细说明可以参考网站aiethan.com

第四章 接口调用体验

这里仅以二维环境示意,三维情况下依然是可以提供服务的。

首先,如下图所示,分别输入栅格点的行数与列数,点击按钮即可生成栅格地图

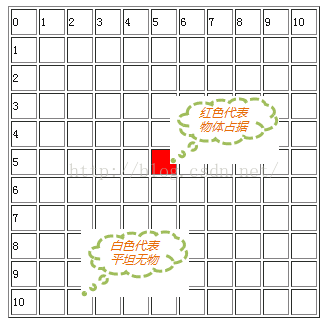

其次,如下图所示,编辑栅格地图:空白栅格点击后会变成红色,再次点击红色又变回白色,红色代表其位置上有物体占据,白色代表其位置上是空的。

最后,如下图所示,点击按钮,获取结果

上图中,栅格内的数字,是用双精度浮点0~1之间的小数(可以保留十几或几十位),代表了环境及物体的特征谱,唯一表征环境及物体,通过其可识别出猫或人或汽车等;栅格内的背景色,在不引起歧义的情况下,可以视为环境势场,机器人的自主运动规划的关键就在这里,本质上类同,光的自主传播,空间内的天体可引起光线弯折,空间内的介质可引起光线的折射,但空间已定的情况下,光自会按照最“省力”的路线规划行进。