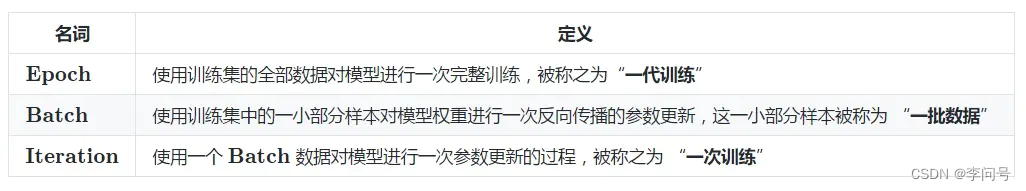

基本概念

- Epoch(时期):所有训练样本在神经网络中都 进行了一次正向传播 和一次反向传播

当一个Epoch的样本(也就是所有的训练样本)数量可能太过庞大(对于计算机而言),就需要把它分成多个小块,也就是就是分成多个Batch 来进行训练

-

Batch(批 / 一批样本):将整个训练样本分成若干个Batch。

-

Batch_Size(批大小):每批样本的大小。

-

Iteration(一次迭代):训练一个Batch就是一次Iteration(这个概念跟程序语言中的迭代器相似)。

-

为什么要使用多于一个epoch?

在神经网络中传递完整的数据集一次是不够的,而且我们需要将完整的数据集在同样的神经网络中传递多次。但请记住,我们使用的是有限的数据集,并且我们使用一个迭代过程即梯度下降来优化学习过程。随着epoch数量增加,神经网络中的权重的更新次数也在增加,曲线从欠拟合变得过拟合。

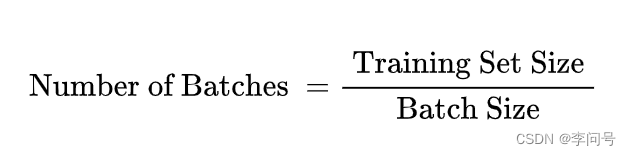

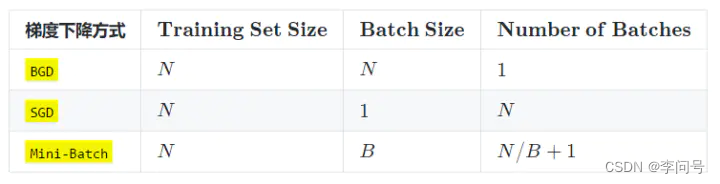

换算公式

举例说明

mnist 数据集有30000张图片作为训练数据,10000张图片作为测试数据。假设现在选择 Batch_Size = 100对模型进行训练。迭代15000次。

- 每个 Epoch 要训练的图片数量:30000(训练集上的所有图像)

- 训练集具有的 Batch 个数: 30000/100=300

- 每个 Epoch 需要完成的 Batch 个数:300

- 每个 Epoch 具有的 Iteration 个数:300(完成一个Batch训练,相当于参数迭代一次)

- 每个 Epoch 中发生模型权重更新的次数:300

- 训练 10 个Epoch后,模型权重更新的次数: 300*10=3000

不同Epoch的训练,其实用的是同一个训练集的数据。第1个Epoch和第10个Epoch虽然用的都是训练集的30000图片,但是对模型的权重更新值却是完全不同的。因为不同Epoch的模型处于代价函数空间上的不同位置,模型的训练代越靠后,越接近谷底,其代价越小。

- 总共完成15000次迭代,相当于完成了15000/300=50个Epoch