本文首发于微信公众号 CVHub,不得以任何形式转载到其它平台,仅供学习交流,违者必究!

Title: FlexiViT: One Model for All Patch Sizes

Author: Lucas Beyer et al. (Google Research)

Paper: https://arxiv.org/pdf/2212.08013v1.pdf

Github: https://github.com/google-research/big_vision

太长不看版,果然还是延续谷歌的风格,创新不够,实验来凑。

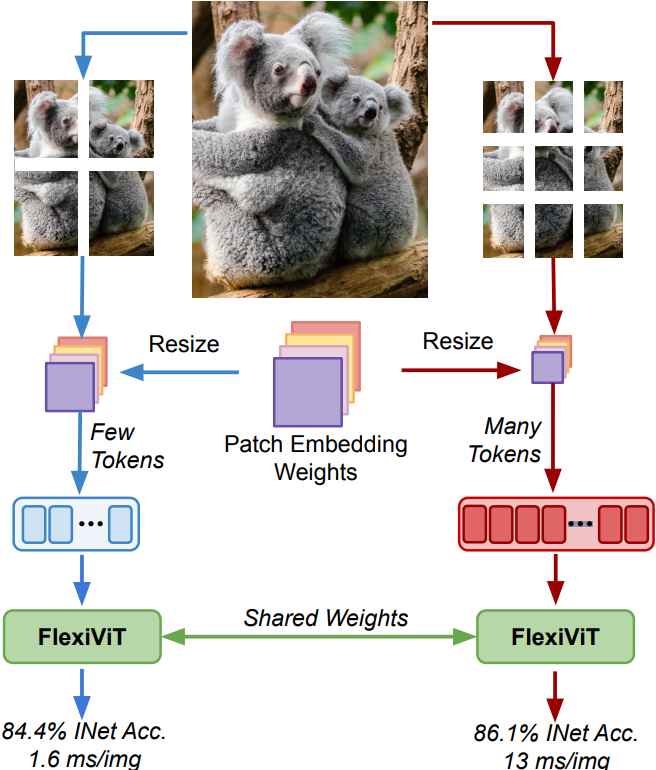

废话不多说,直接上图,一图胜千言:

顾名思义,FlexiViT,翻译过来不就是灵活的 ViT 嘛?

Ooo,那怎么体现灵活?我们先回顾下 Vision Transformers 的工作流程。

一句话总结就是,ViT 是一种通过将图像切割成一个个小方块(patch)将图像转换为序列从而输入到Transformer网络进行训练和推理的一种神经网络架构。

本文的重点便是在研究这些小块块对性能的最终影响。通常来说:

- 方块切的越小,精度会越高,但速度就变慢了;

- 方块切的越大,精度会降低,但速度就上来了;

So,我们究竟是要做大做强,还是做小做精致?不用急,来自谷歌大脑的研究人员为你揭晓答案:成年人才做选择,老子大小通吃。

正经点,让我们切回来,古哥通过燃烧了数不尽的卡路里向我们证明了,在训练期间随机改变方块的大小可以得到一组在广泛的方块大小范围内表现良好的权重(泛化性能好)。

这结论有什么用?那便是使得在部署时大家可以根据不同的计算预算来调整模型。

通过在以下五大版图进行广泛的投资,可以清晰的发现收益率远超沪深300:

- 图像分类

- 图像-文本检索

- 开放世界检测

- 全景分割

- 语义分割

为了照顾下你们这些散(韭)户(菜),古哥说你们可以将它任意添加到大多数依赖ViT骨干架构的模型来实现计算自由,即模型可以根据不同的计算资源调整自己的工作方式,从而获得更好的性能和效率。

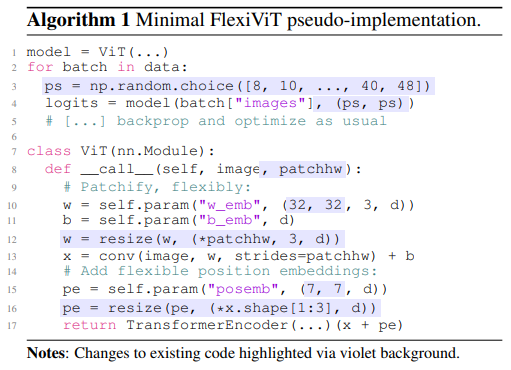

说了这么多,怎么做?直接把代号都发给你了,明天早盘直接梭哈即可:

看到看到这里了,总不能白嫖吧?点个赞再友情转发下再走咯~~~

写在最后

如果您也对人工智能和计算机视觉全栈领域感兴趣,强烈推荐您关注有料、有趣、有爱的公众号『CVHub』,每日为大家带来精品原创、多领域、有深度的前沿科技论文解读及工业成熟解决方案!欢迎添加小编微信号:cv_huber,一起探讨更多有趣的话题!