一、深度学习

深度学习:顾名思义学习特征

从原始数据中提取模式的能力。机器学习就是让计算机模型学习到这些分类模型。深度学习面临的挑战是:图像的底层视觉特性和高层语义概念之间的鸿沟。例如人和狗是不一样的图像,但如果他们背景颜色都一样,视觉特征很像,但语义不同。

总的流程为:建立模型——损失函数——参数学习

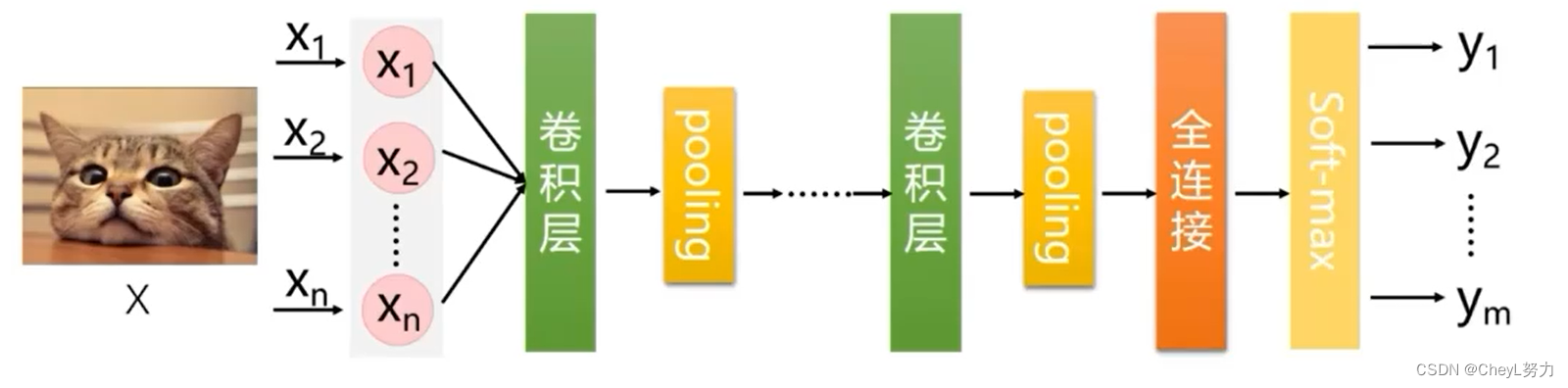

step1:建立模型

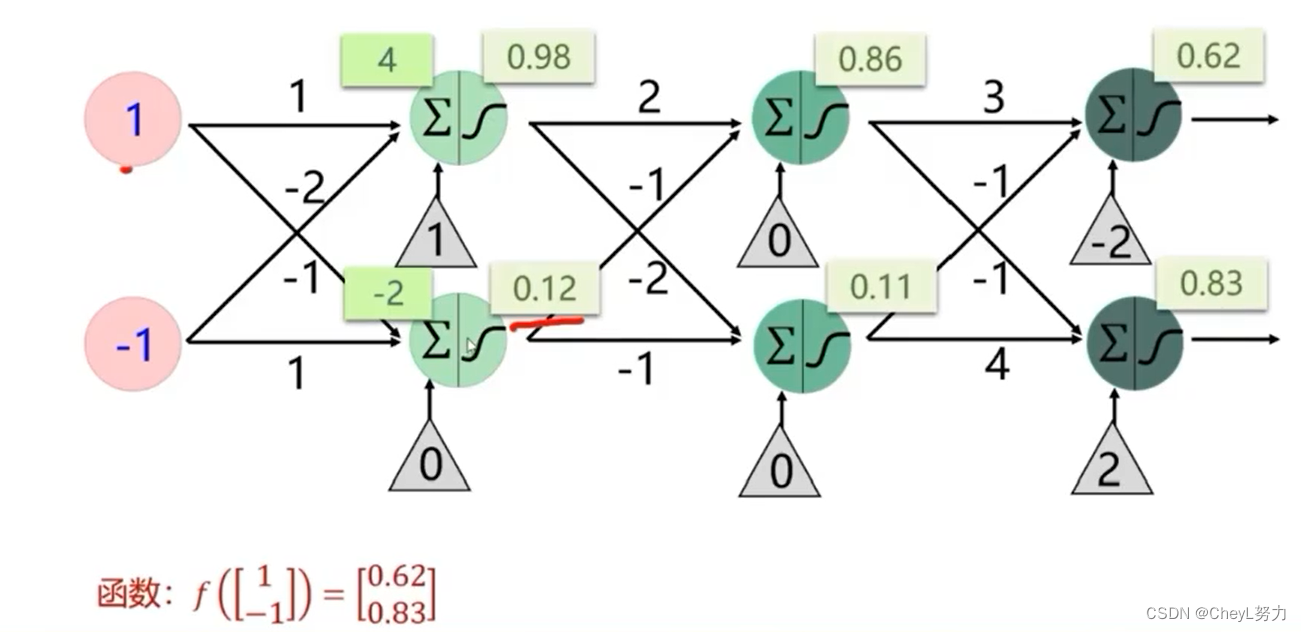

前馈神经网络:可以将数据进行处理。

最后用函数来表达就是输入了特征 ( 1 − 1 ) (1) \left( \begin{matrix} 1 \\ -1 \\ \end{matrix} \right) \tag{1} (1−1)(1)

经过前馈神经网络,计算出了结果。

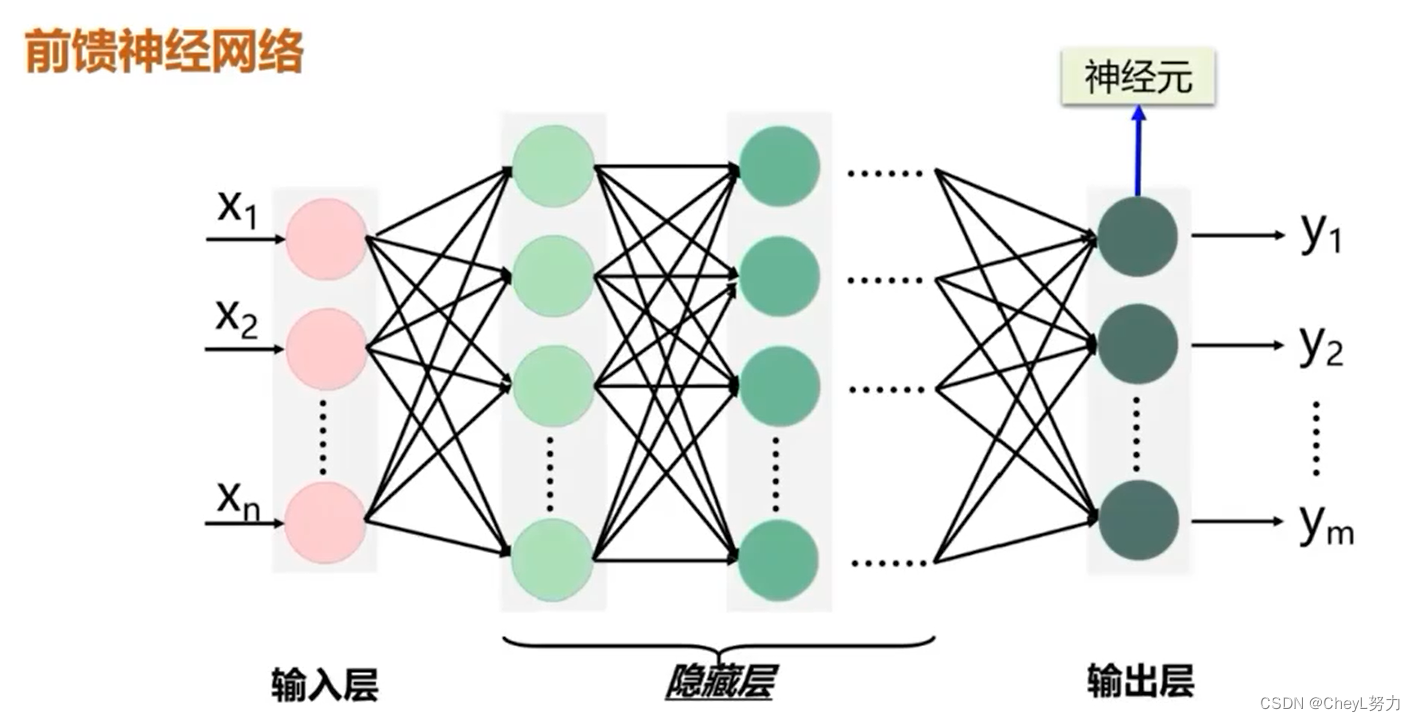

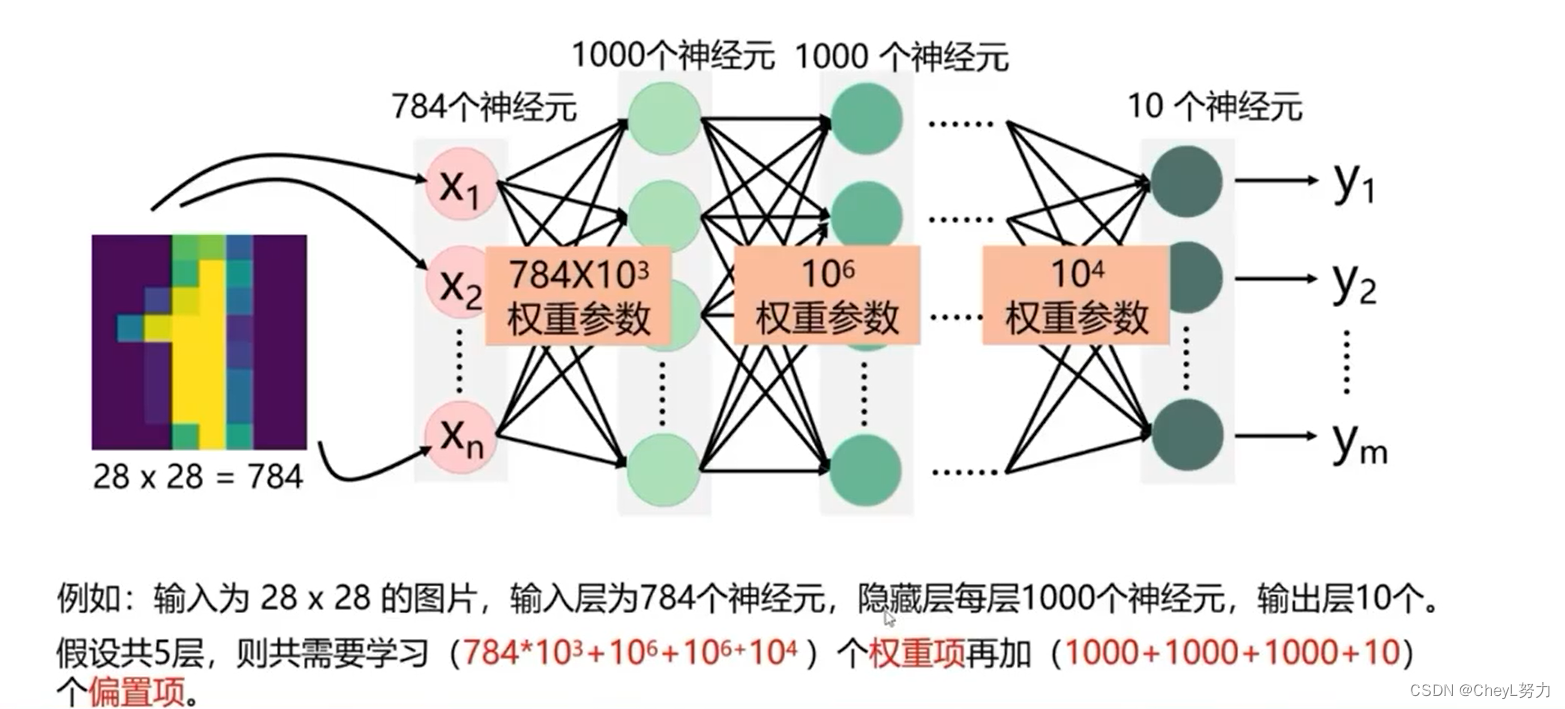

对于全连接的神经网络,有几个结构输入层、隐藏层、输出层。

层数越多,网络越深,错误率可以下降。

层数越多,网络越深,错误率可以下降。

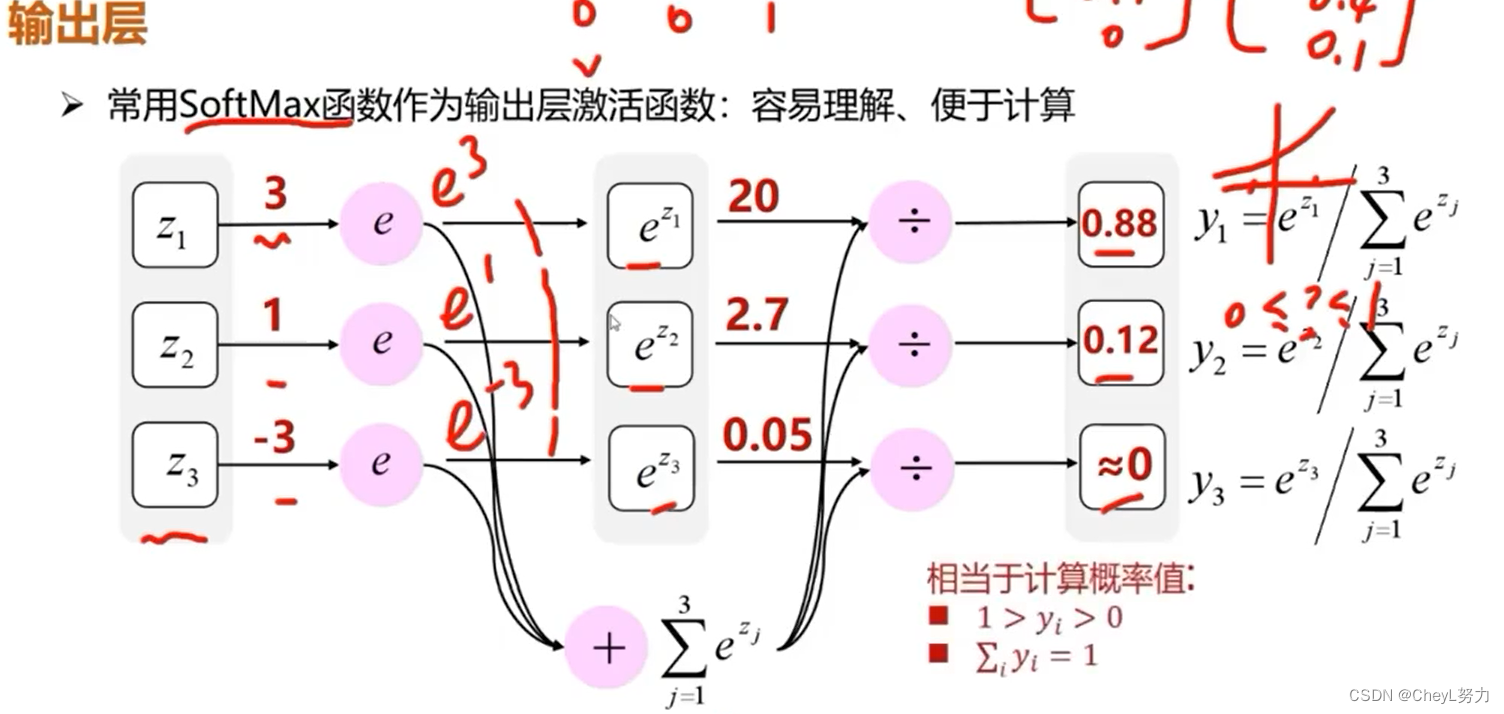

最后计算出一个概率值,说明属于哪个类。

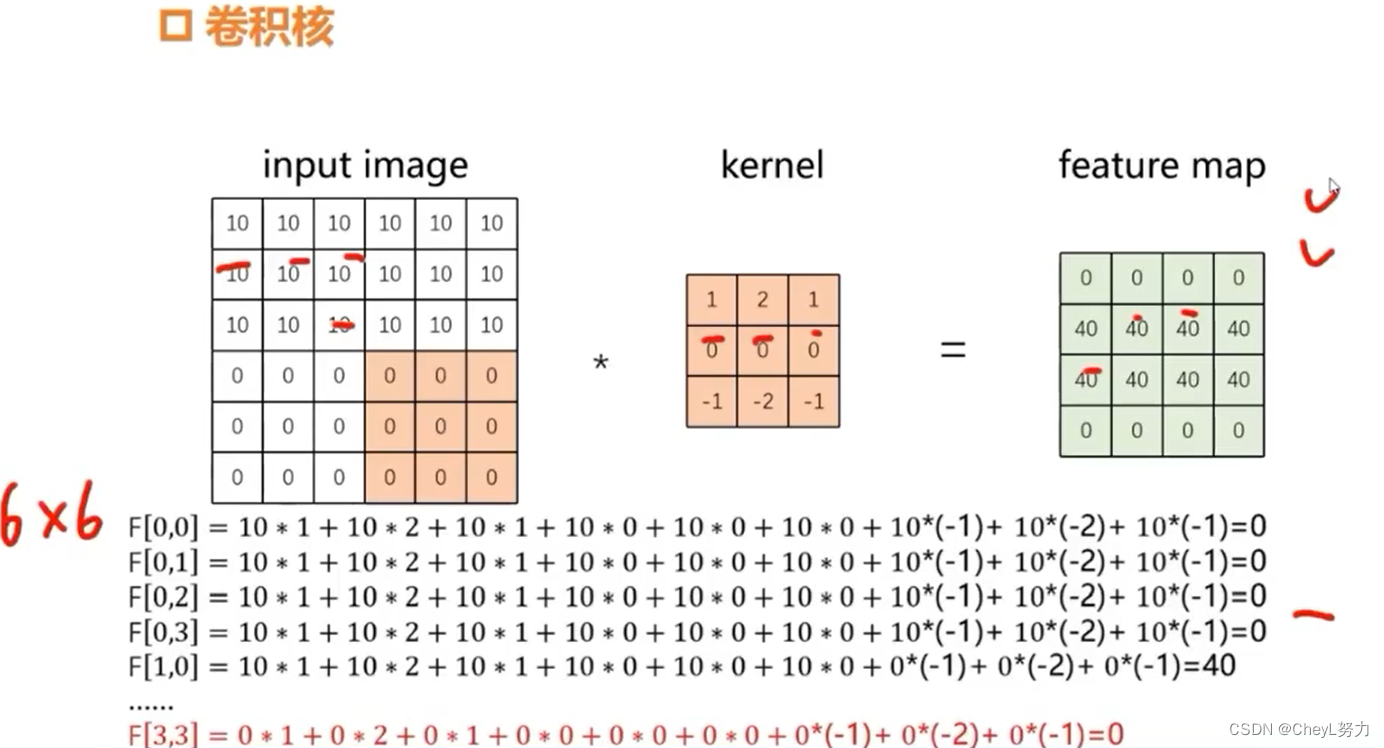

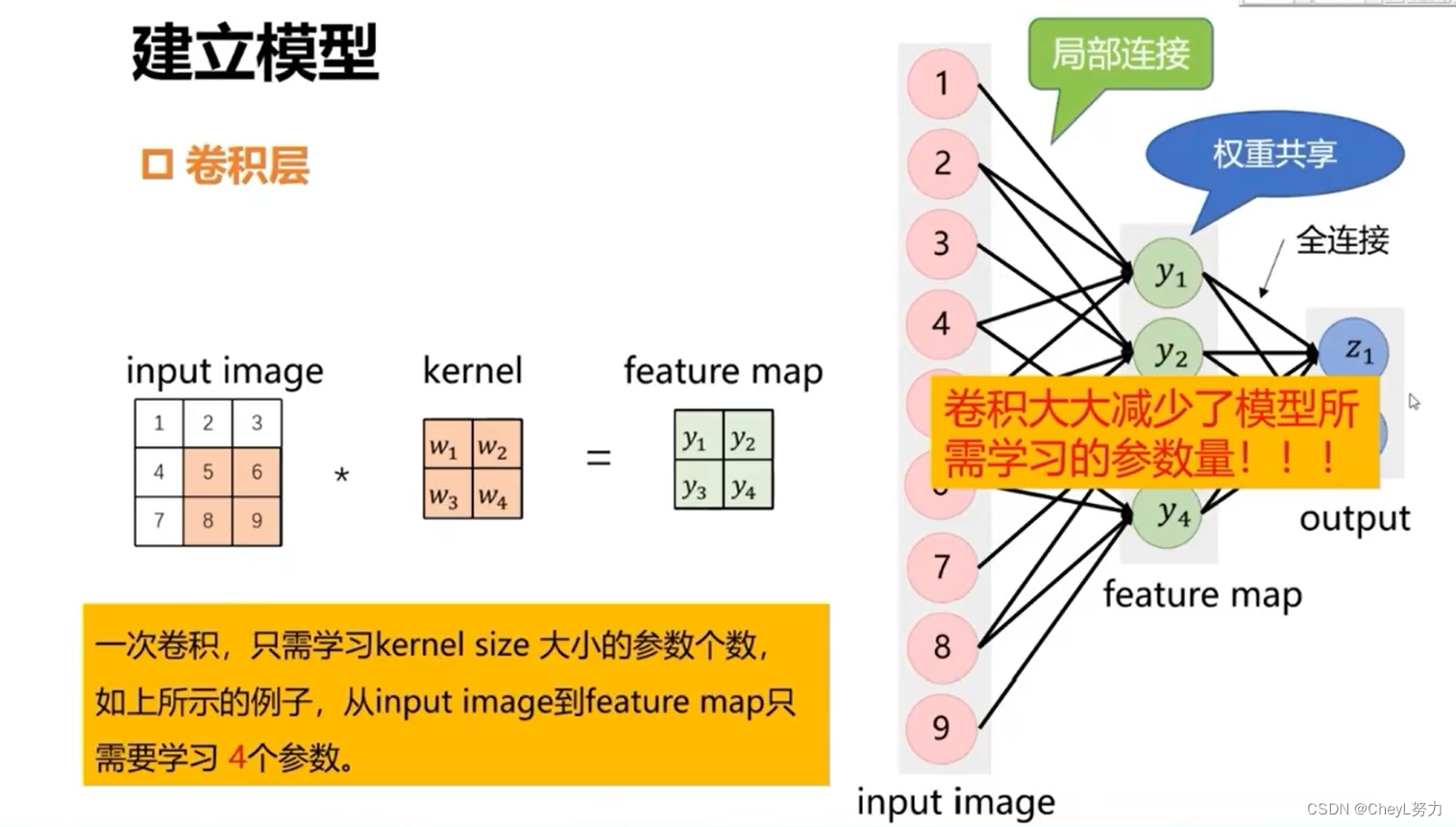

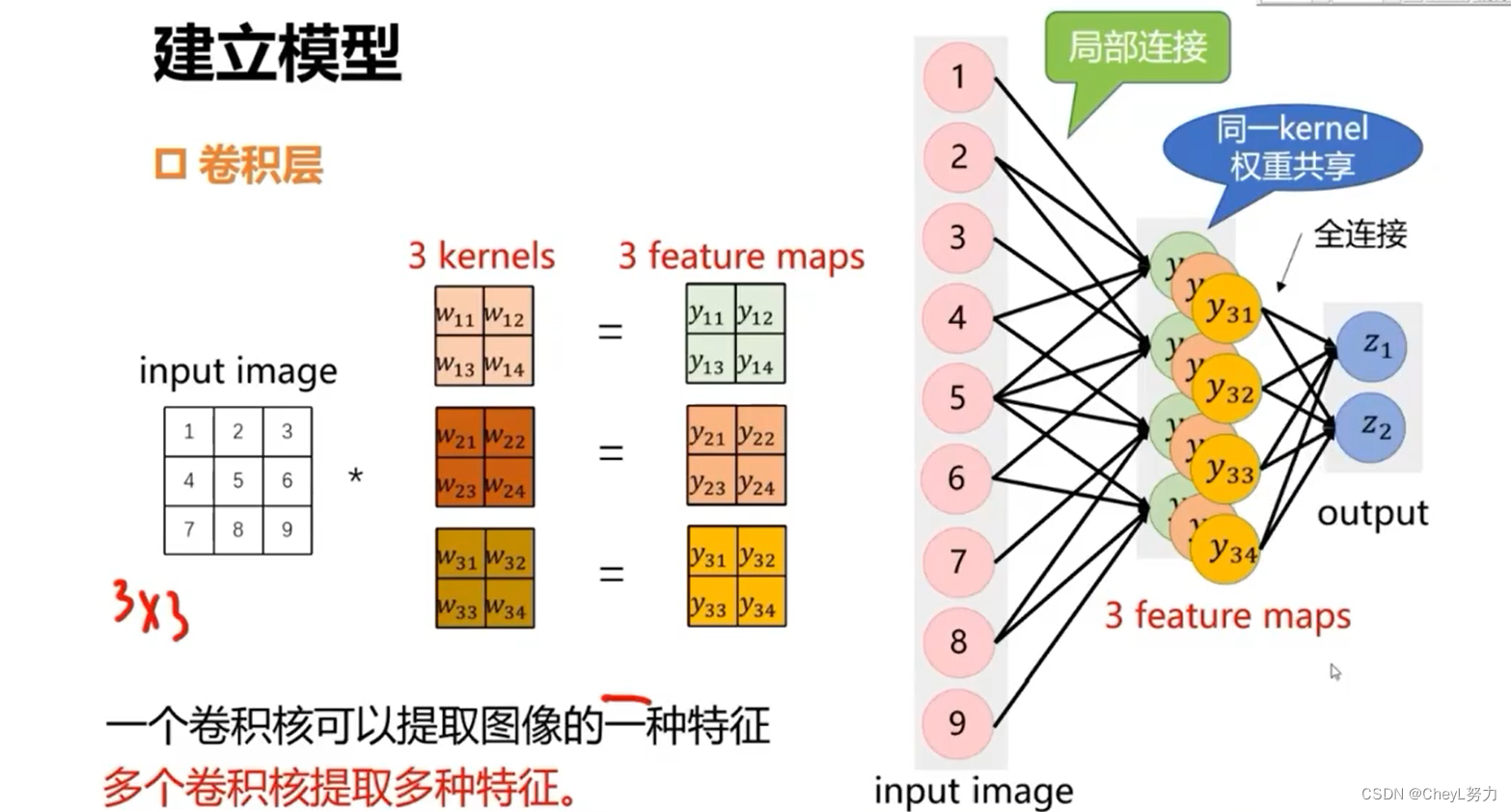

卷积核:输入图像*卷积核=特征映射层(feature map)对应的相乘

一个卷积核可以提取图像的一种特征,多个卷积核可以提取多个特征。

多通道卷积:输出为对应通道在滑动窗口内的卷积的和。

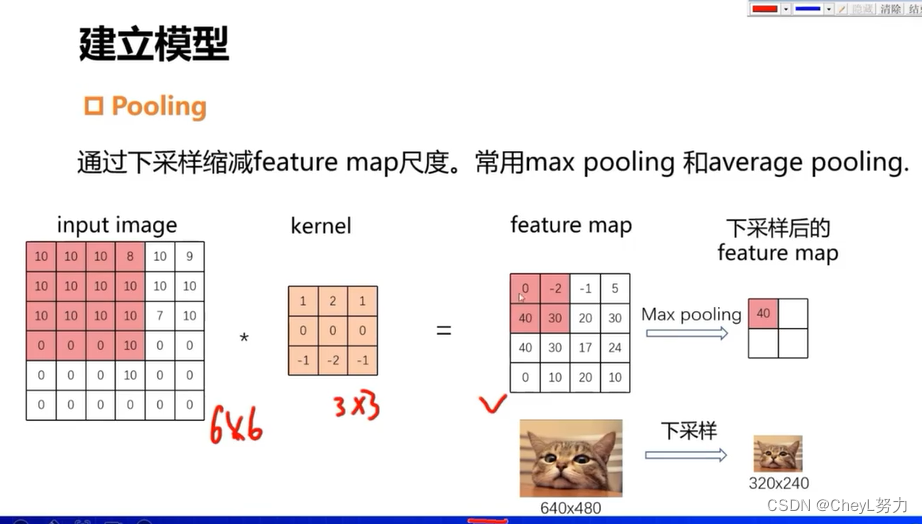

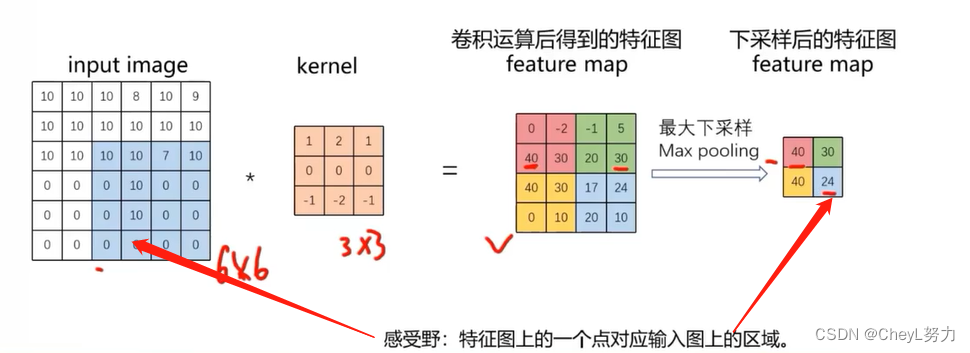

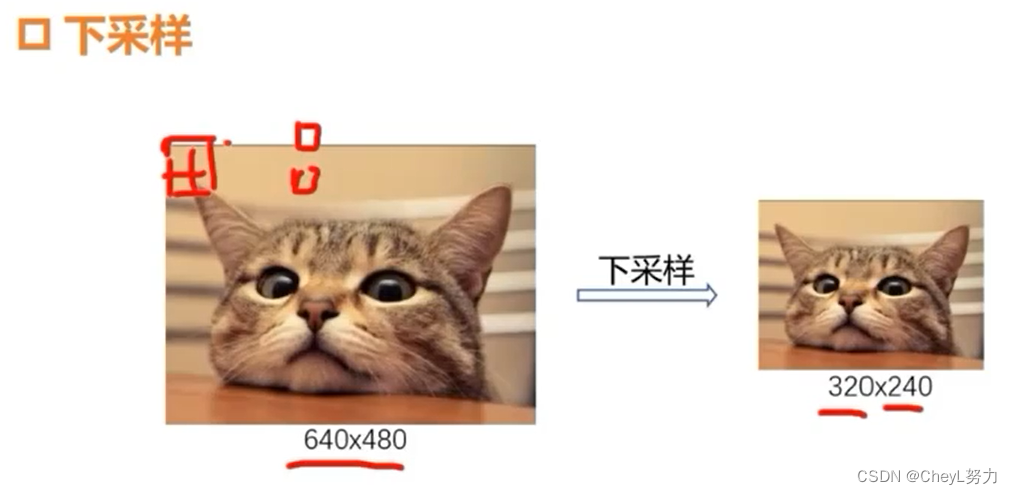

池化层:pooling

通过下采样缩减feature map尺度。常用 max pooling 和average pooling (每个feature map取最大或者平均)

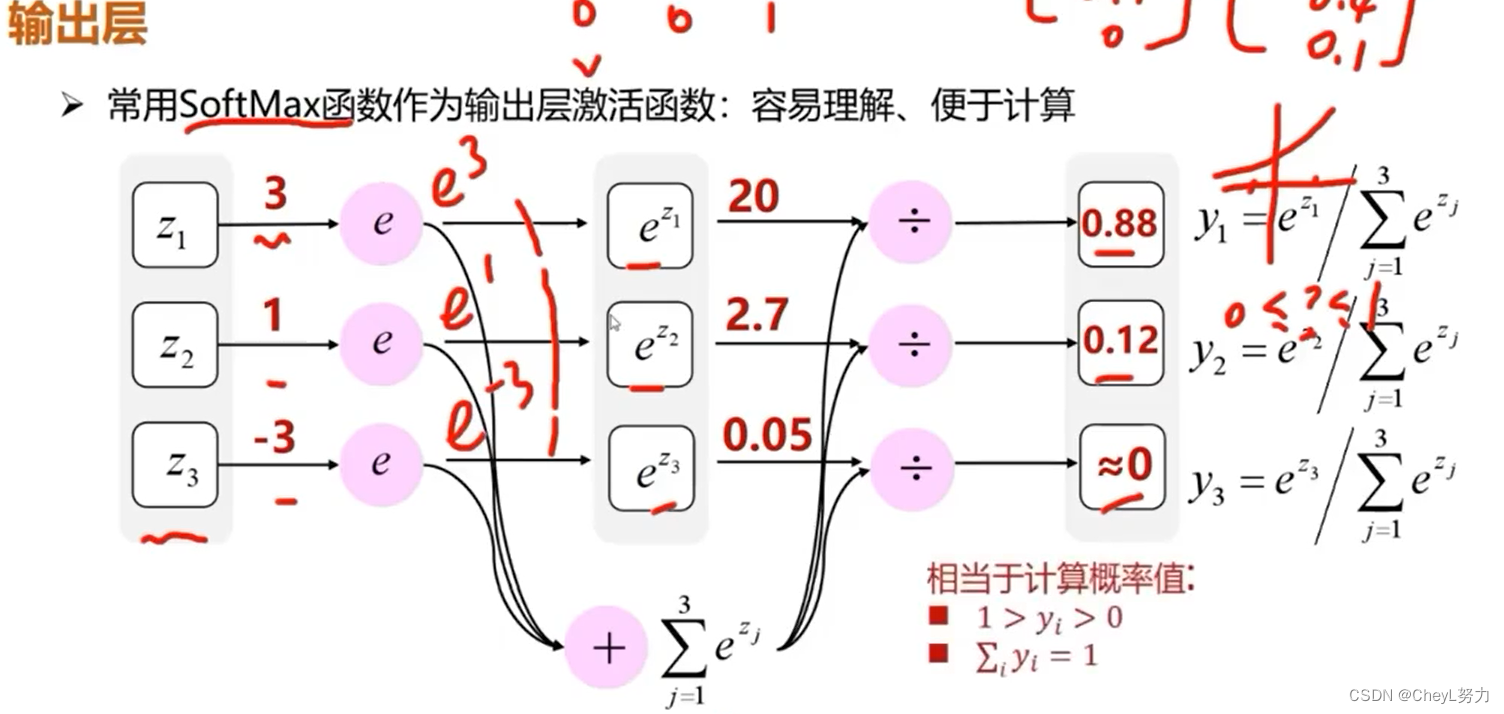

输出层:常用SoftMax函数作为输出层激活函数,容易理解、便于计算

最后计算出一个概率值,说明属于哪个类。

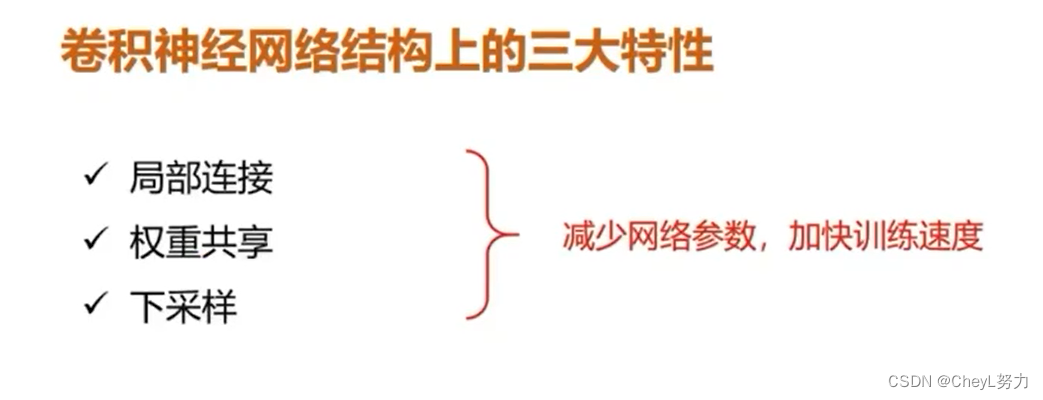

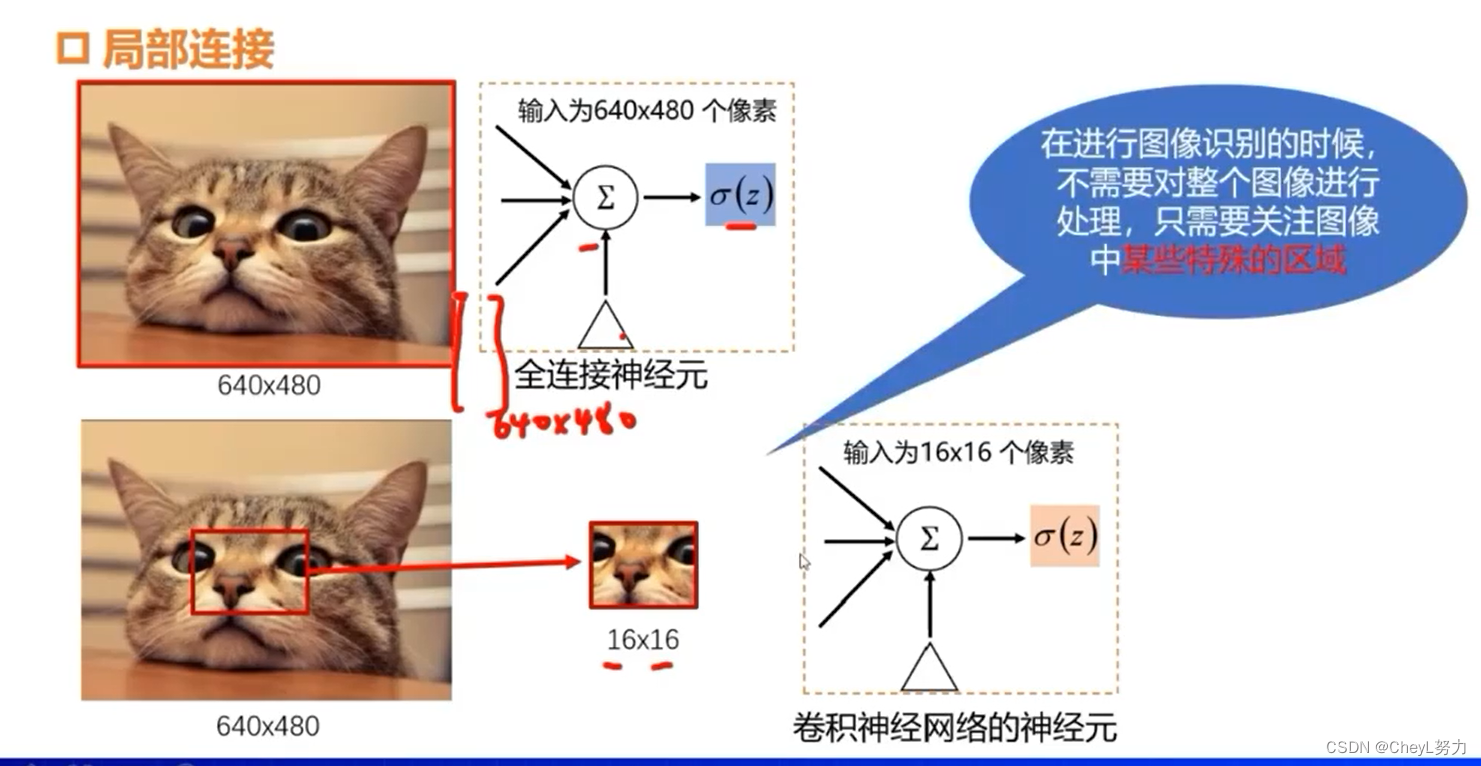

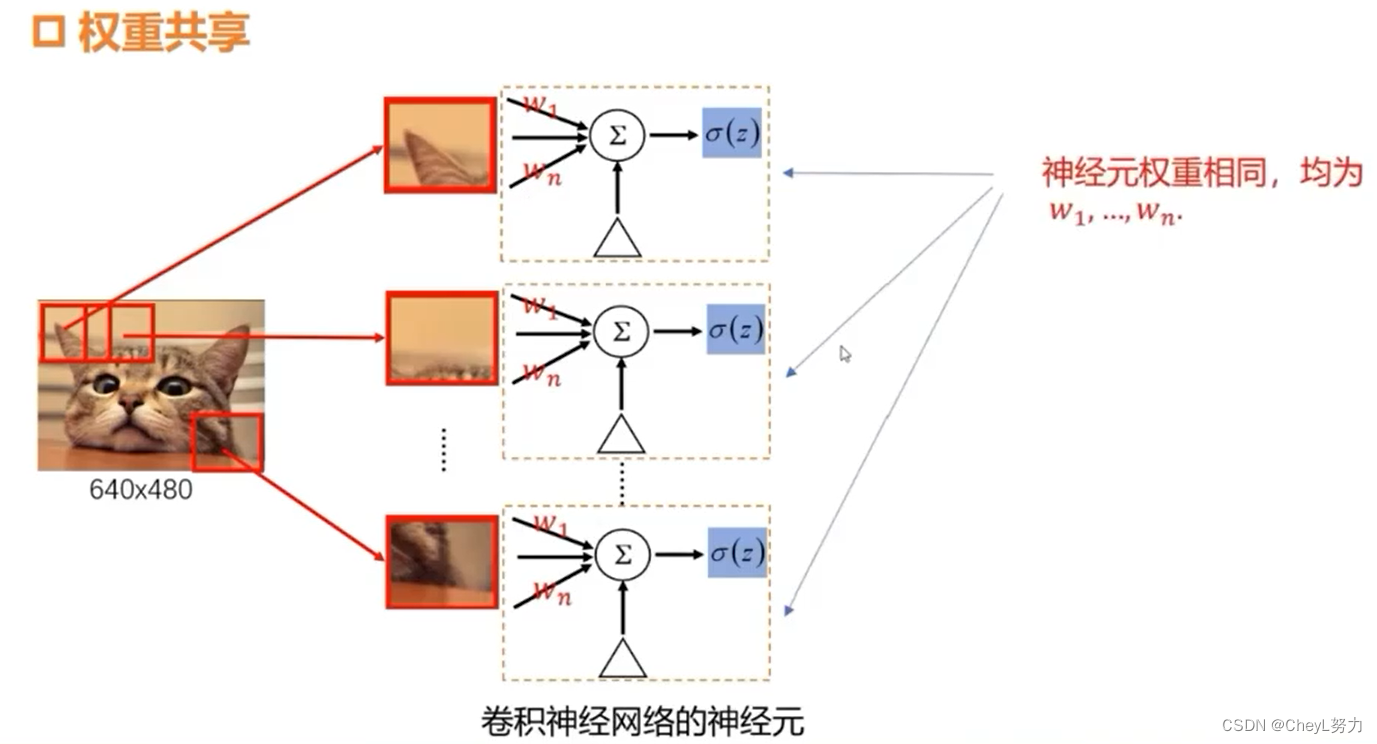

卷积神经网络结构的三大特性:

卷积神经网络结构:

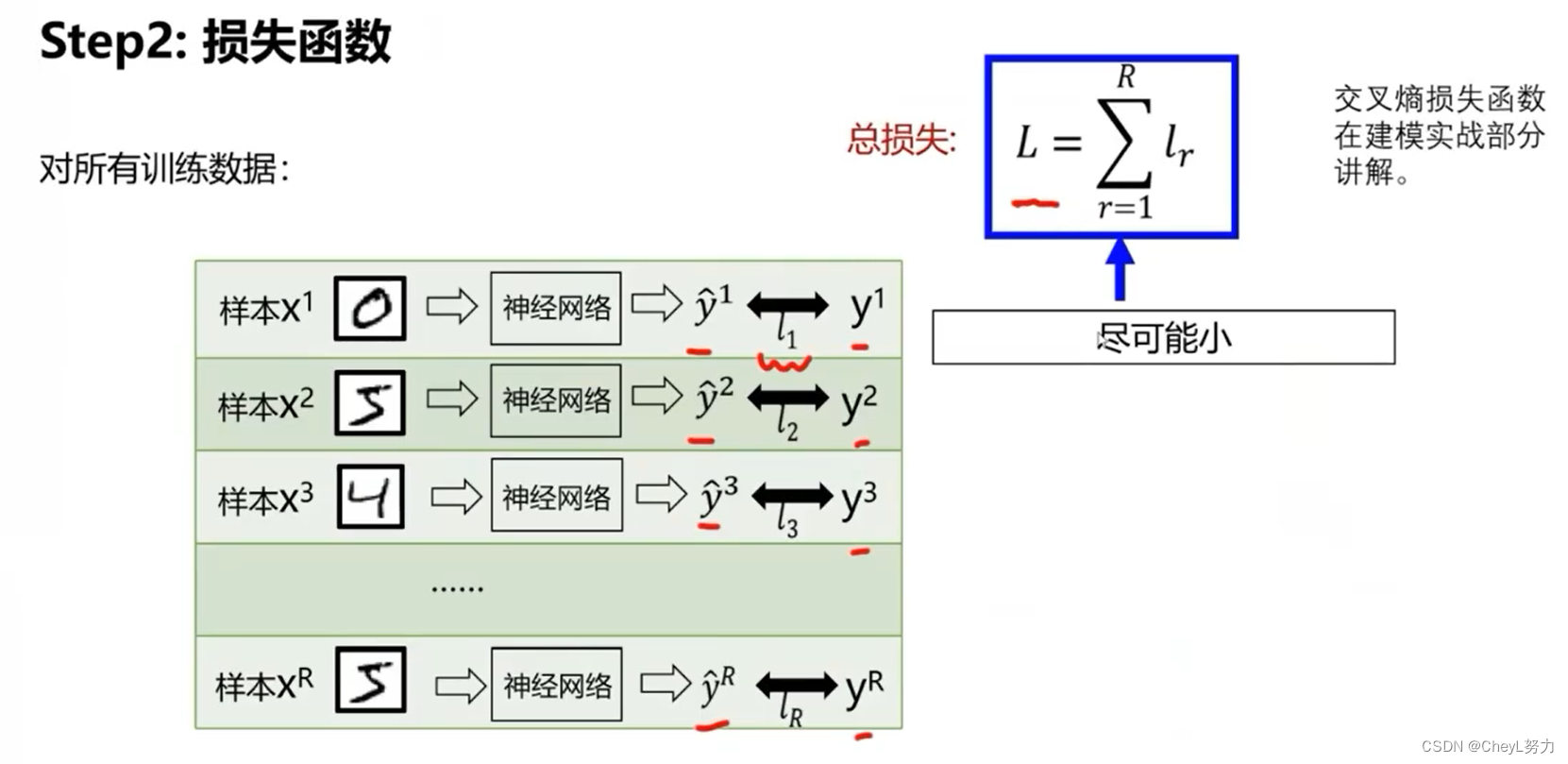

step2:损失函数

让总损失尽可能的小,预测值与真实值之间的差距。

交叉熵损失函数:预测值与真实值越接近,损失函数越小。

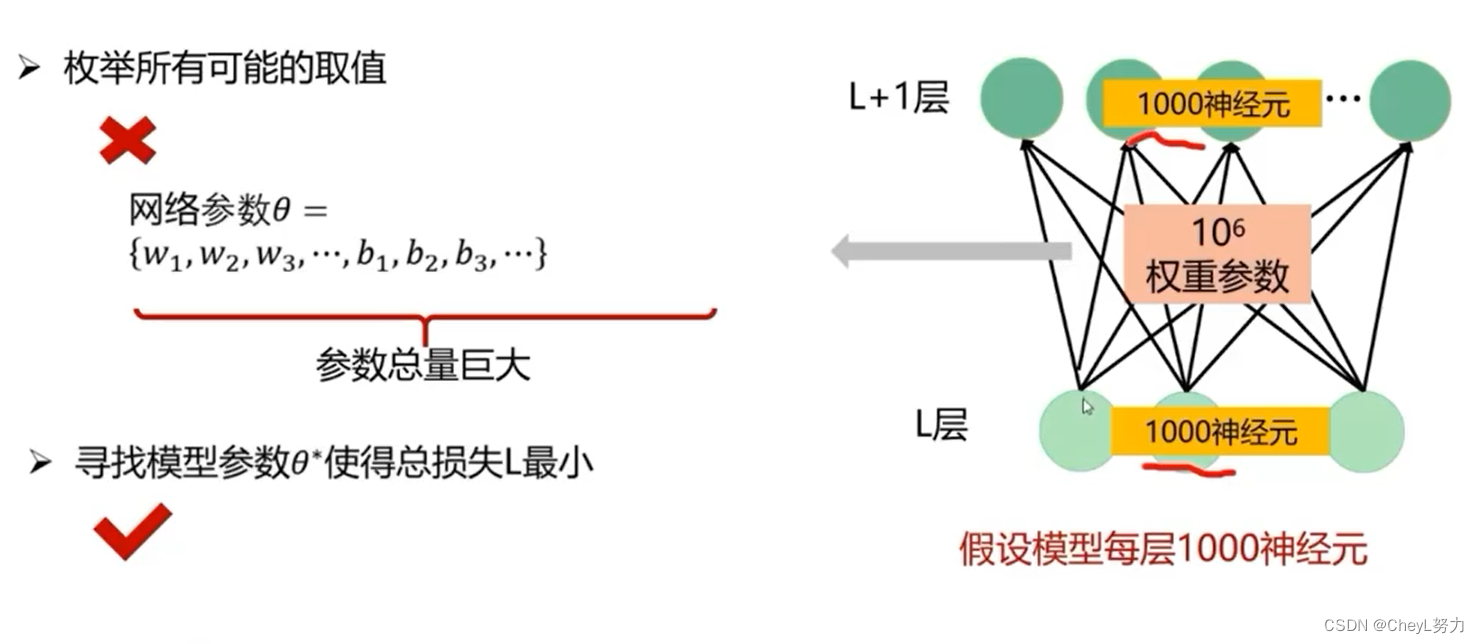

step3:参数学习

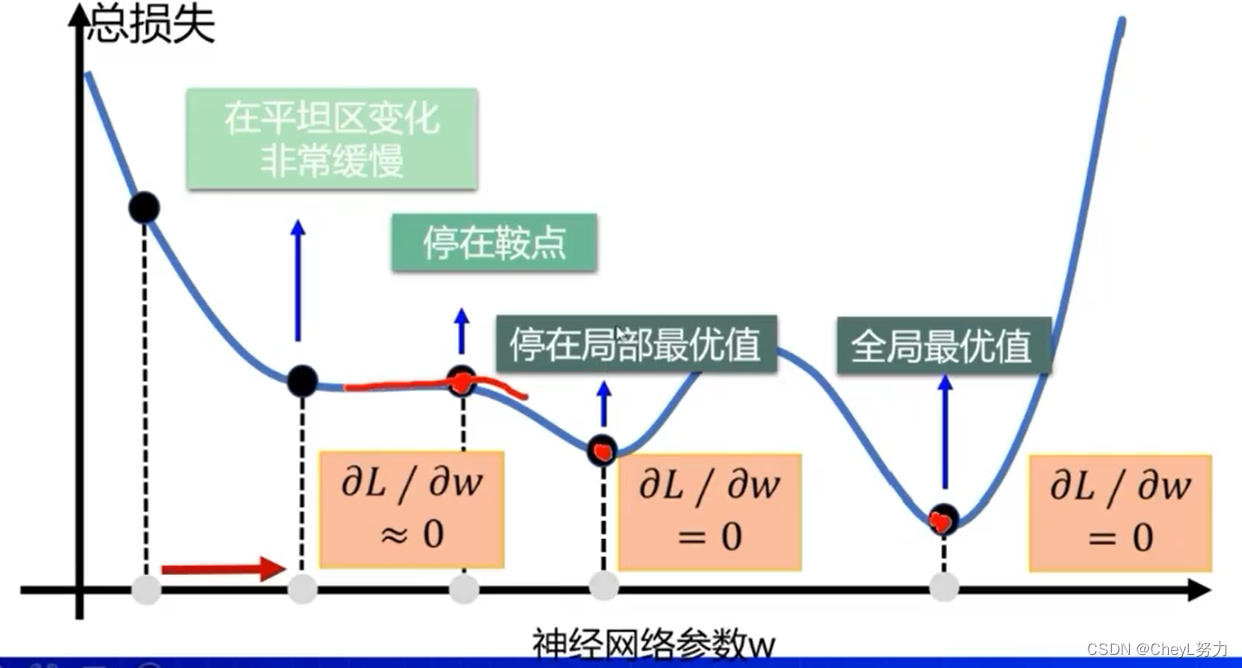

寻找模型参数使得总损失最小。

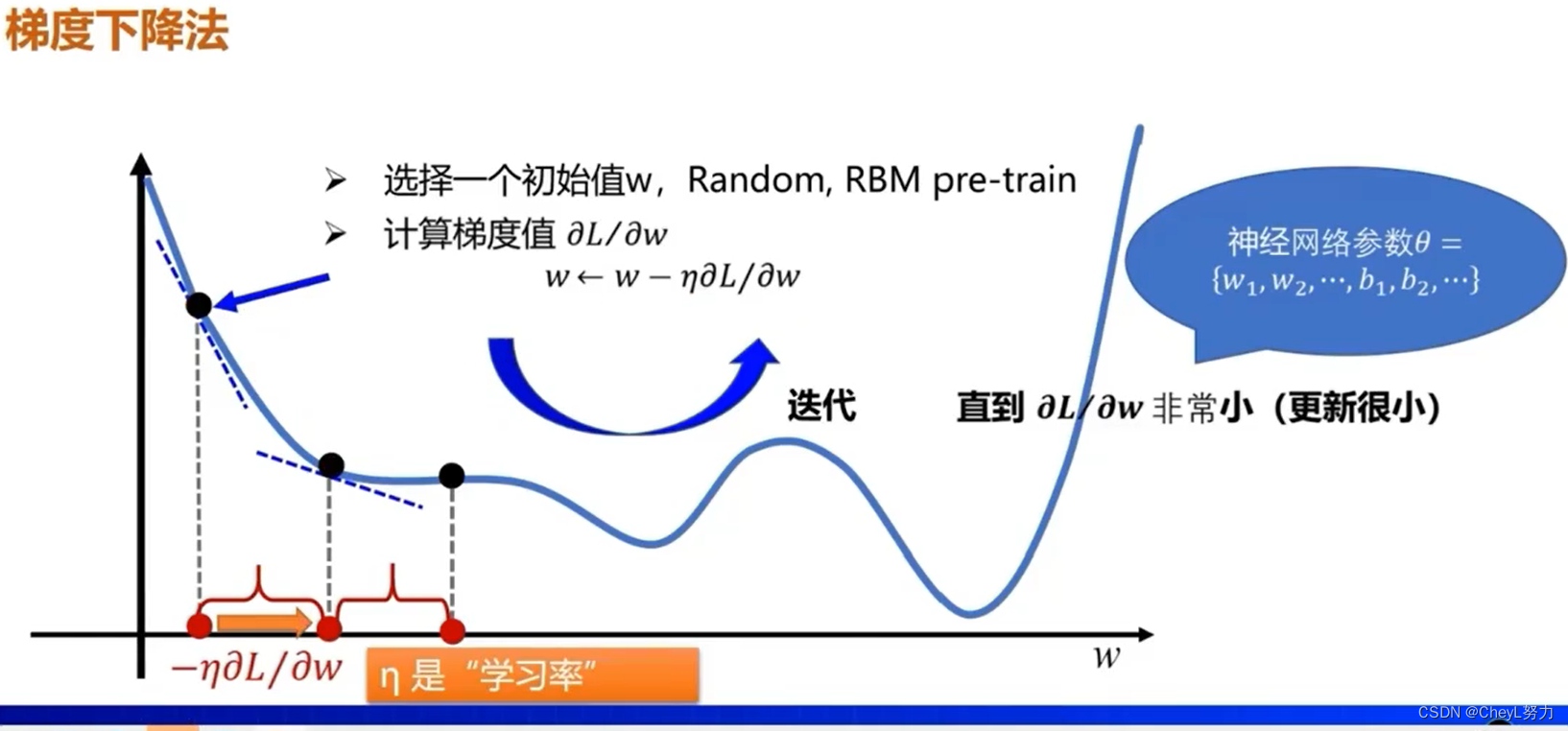

1、梯度下降法

初始值也会影响。

深度全连接模型的不足之处:模型参数太多。

二、模型实战

1、线性回归

交叉熵主要用来衡量估计值和真实值之间的差距。值越小,预测结果越好。

2、多层感知机模型

用激活函数进行非线性转化

3、卷积网络模型LeNet-5

以上内容根据《飞桨特训营第二期训练营》学习的内容进行总结梳理。