1 Kafka 概述

1.1 定义

Kafka 是一个分布式的基于发布/订阅模式的消息队列(Message Queue),主要应用于大数据实时处理领域。

1.2 消息队列

1.2.1 传统消息队列的应用场景

使用消息队列的好处

(1)解耦

允许你独立的扩展或修改两边的处理过程,只要确保它们遵守同样的接口约束。

(2)可恢复性

系统的一部分组件失效时,不会影响到整个系统。消息队列降低了进程间的耦合度,所以即使一个处理消息的进程挂掉,加入队列中的消息仍然可以在系统恢复后被处理。

(3)缓冲

有助于控制和优化数据流经过系统的速度解决生产消息和消费消息的处理速度不一致的情况。

(4)灵活性 & 峰值处理能力

在访问量剧增的情况下,应用仍然需要继续发挥作用,但是这样的突发流量并不常见。如果为以能处理这类峰值访问为标准来投入资源随时待命无疑是巨大的浪费。使用消息队列能够使关键组件顶住突发的访问压力,而不会因为突发的超负荷的请求而完全崩溃。

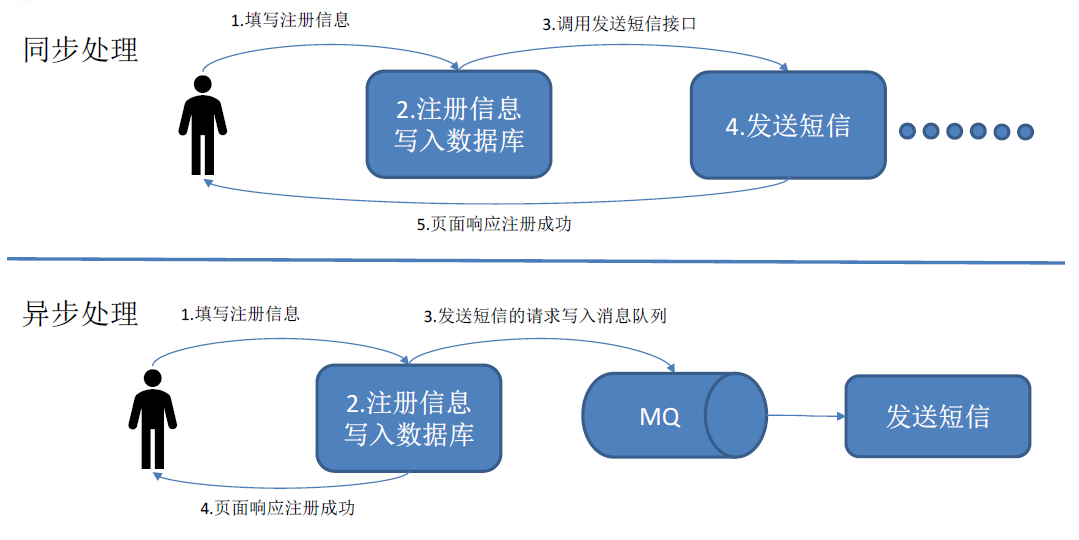

(5)异步通信

很多时候,用户不想也不需要立即处理消息。消息队列提供了异步处理机制,允许用户把一个消息放入队列,但并不立即处理它。想向队列中放入多少消息就放多少,然后在需要的时候再去处理它们。

1.2.2 消息队列的两种模式

1. 点对点模式(一对一,消费者主动拉取数据,消息收到后消息清除)

消息生产者生产消息发送到 Queue 中 然后消息消费者从 Queue 中取出并且消费消息。消息被消费以后,Queue 中不再有存储,所以消息消费者不可能消费到已经被消费的消息。Queue 支持存在多个消费者,但是对一个消息而言,只会有一个消费者可以消费。

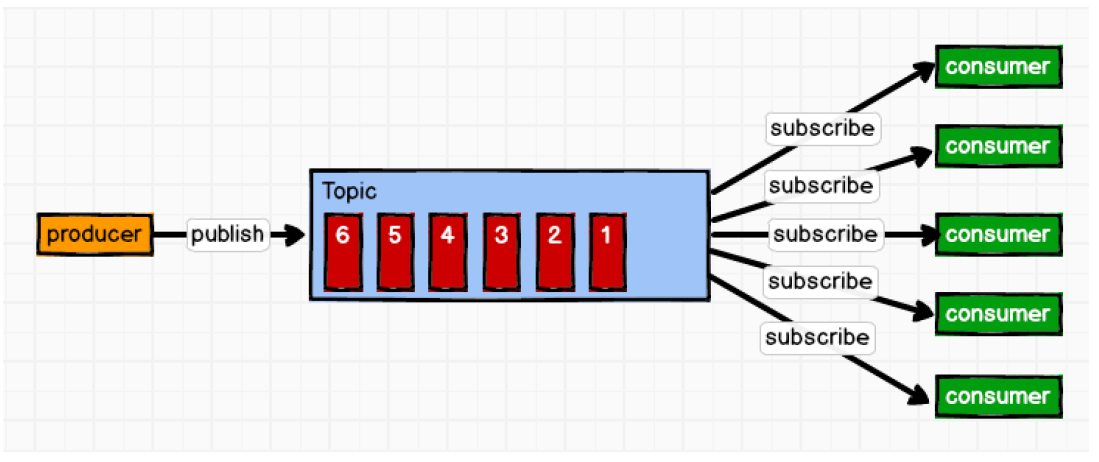

2. 发布/订阅模式(一对多 ,消费者消费数据之后不会清除消息)

消息生产者(发布)将消息发布到 topic 中,同时有多个消息消费者(订阅)消费该消息。和点对点方式不同,发布到 topic 的消息会被所有订阅者消费。

1.3 Kafka 基础架构

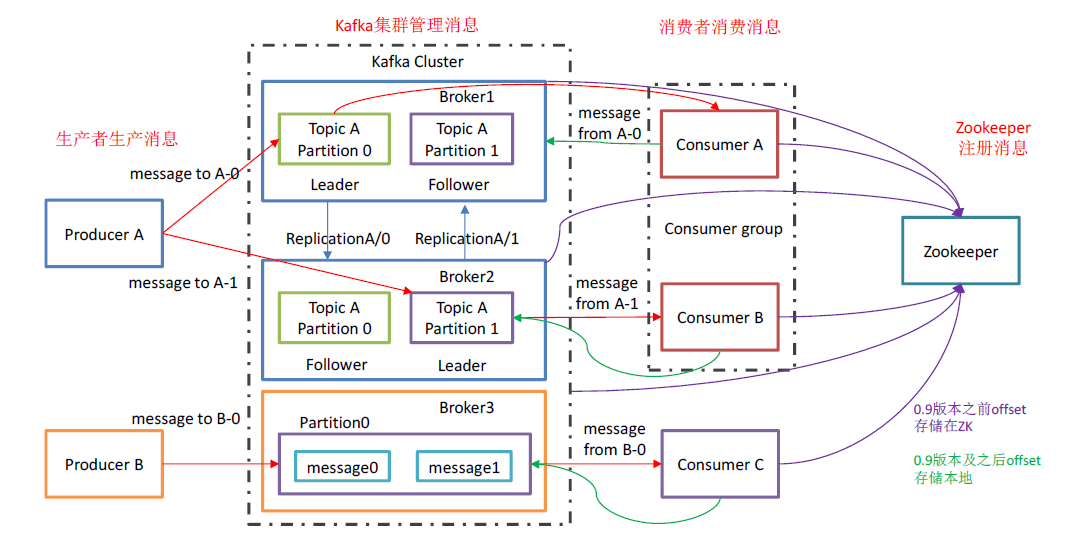

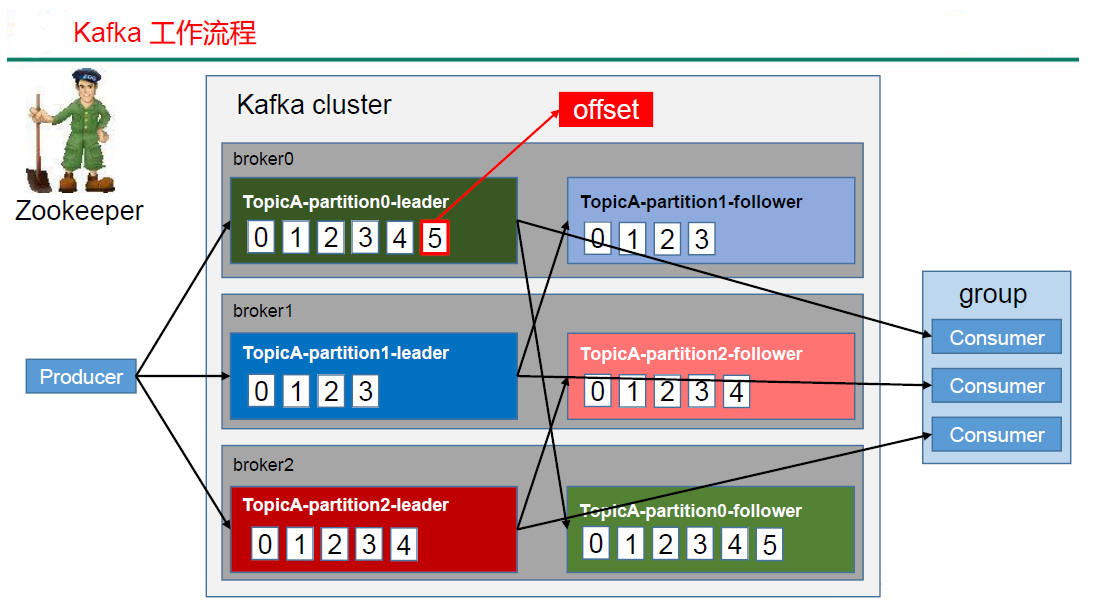

(1)Producer :消息生产者,就是向kafka broker 发消息的客户端;

(2)Consumer:消息消费者,向kafka broker 取消息的客户端;

(3)Consumer Group (CG):消费者组,由多个 consumer 组成。消费者组内每个消费者负责消费不同分区的数据,一个分区只能由一个组内消费者消费;消费者组之间互不影响。所有的消费者都属于某个消费者组,即消费者组是逻辑上的一个订阅者。

(4)Broker :一台 kafka 服务器就是一个 broker。一个集群由多个 broker 组成。一个 broker 可以容纳多个 topic。

(5)Topic :可以理解为一个队列,生产者和消费者面向的都是一个topic;

(6)Partition:为了实现扩展性,一个非常大的 topic 可以分布到多个 broker(即服务器)上,一个 topic 可以分为多个 partition,每个 partition 是一个有序的队列;

(7)Replication:副本,为保证集群中的某个节点发生故障时,该节点上的 partition 数据不丢失,且 kafka 仍然能够继续工作,kafka提供了副本机制,一个 topic 的每个分区都有若干个副本,一个 leader 和若干个 follower。

(8)Leader:每个分区多个副本的“主”,生产者发送数据的对象,以及消费者消费数据的对象都是leader。

(9)Follower:每个分区多个副本中的“从”,实时从 leader 中同步数据,保持和 leader 数据的同步。 leader 发生故障时,某个 follower 会成为新的 leader。

2 Kafka 快速入门

2.1 安装部署

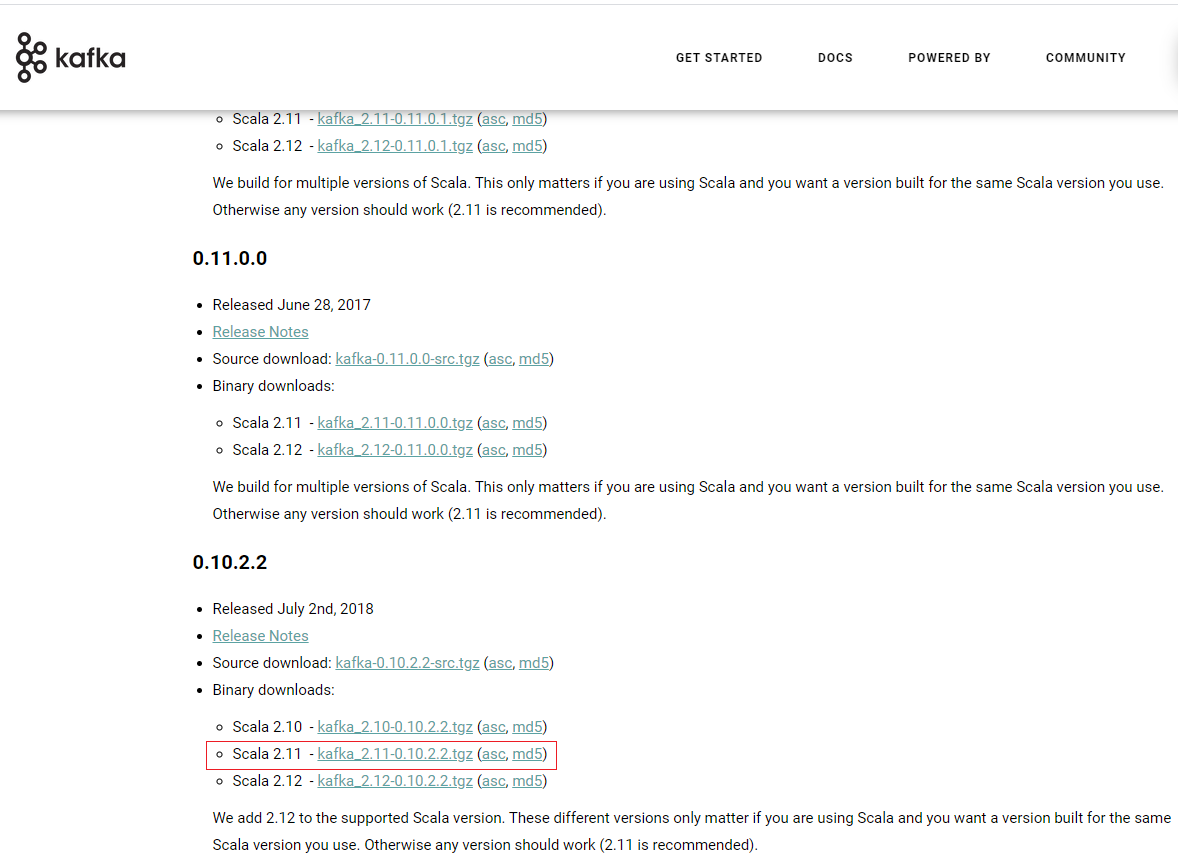

1. jar 包下载地址

http://kafka.apache.org/downloads.html

2. 集群部署

(1)解压安装包

[Tom@hadoop102 software]$ tar -zxvf kafka_2.11-0.11.0.0.tgz -C /opt/module

(2)修改解压后的文件名称

[Tom@hadoop102 module]$ mv kafka_2.11-0.11.0.0/ kafka-0.11

(3)在/opt/module/kafka-0.11目录下创建 logs 文件夹

[Tom@hadoop102 kafka-0.11]$ mkdir logs

(4)修改配置文件

[Tom@hadoop102 kafka-0.11]$ cd config/

[Tom@hadoop102 config]$ vim server.properties

输入以下内容:

# The id of the broker. This must be set to a unique integer for each broker.

broker.id=0

# Switch to enable topic deletion or not, default value is false

delete.topic.enable=true

# The number of threads that the server uses for receiving requests from the network and sending responses to the network

num.network.threads=3

# The number of threads that the server uses for processing requests, which may include disk I/O

num.io.threads=8

# The send buffer (SO_SNDBUF) used by the socket server

socket.send.buffer.bytes=102400

# The receive buffer (SO_RCVBUF) used by the socket server

socket.receive.buffer.bytes=102400

# The maximum size of a request that the socket server will accept (protection against OOM)

socket.request.max.bytes=104857600

# A comma seperated list of directories under which to store log files

log.dirs=/opt/module/kafka-0.11/data

# The default number of log partitions per topic. More partitions allow greater

# parallelism for consumption, but this will also result in more files across

# the brokers.

num.partitions=1

# The number of threads per data directory to be used for log recovery at startup and flushing at shutdown.

# This value is recommended to be increased for installations with data dirs located in RAID array.

num.recovery.threads.per.data.dir=1

# The minimum age of a log file to be eligible for deletion due to age

log.retention.hours=168

# root directory for all kafka znodes.

zookeeper.connect=hadoop102:2181,hadoop103:2181,hadoop104:2181

(5)配置环境变量

[Tom@hadoop102 profile.d]$ sudo vim /etc/profile.d/my_env.sh

#KAFKA_HOME

export KAFKA_HOME=/opt/module/kafka-0.11

export PATH=$PATH:$KAFKA_HOME/bin

[Tom@hadoop102 profile.d]$ source /etc/profile.d/my_env.sh

(6)分发安装包

[Tom@hadoop102 module]$ xsync kafka-0.11/

注意:分发之后记得配置其他机器的环境变量

(7)分别在 hadoop103 和 hadoop104 上修改配置文件 /opt/module/kafka-0.11/config/server.properties中的 broker.id=1、 broker.id=2(broker.id不得重复)

(8)启动集群

依次在 hadoop102、 hadoop103、 hadoop104节点上启动 kafka

[Tom@hadoop102 kafka-0.11]$ bin/kafka-server-start.sh -daemon /config/server.properties

[Tom@hadoop103 kafka-0.11]$ bin/kafka-server-start.sh -daemon /config/server.properties

[Tom@hadoop104 kafka-0.11]$ bin/kafka-server-start.sh -daemon /config/server.properties

(9)关闭集群

[Tom@hadoop102 kafka-0.11]$ bin/kafka-server-stop.sh stop

[Tom@hadoop103 kafka-0.11]$ bin/kafka-server-stop.sh stop

[Tom@hadoop104 kafka-0.11]$ bin/kafka-server-stop.sh stop

(10)kafka 群起脚本

#!/bin/bash

case $1 in

"start"){

for i in hadoop102 hadoop103 hadoop104

do

echo "===========$i=========="

ssh $i "/opt/module/kafka-0.11/bin/kafka-server-start.sh -daemon /opt/module/kafka-0.11/config/server.properties"

done

};;

"stop"){

for i in hadoop102 hadoop103 hadoop104

do

echo "==========$i=========="

ssh $i "/opt/module/kafka-0.11/bin/kafka-server-stop.sh"

done

};;

esac

2.2 Kafka 命令行操作

(1)查看当前服务器中的所有 topic

[Tom@hadoop102 kafka-0.11]$ bin/kafka-topics.sh --list --zookeeper hadoop102:2181

提示:输出的本地目录必须是已经存在的目录,如果该目录不存在,并不会创建新的目录。

(2)创建 topic

[Tom@hadoop102 kafka-0.11]$ bin/kafka-topics.sh --zookeeper hadoop102:2181 --create --replication-factor 3 --partitions 1 --topic first

选项说明:

--topic 定义 topic 名

--replication-factor 定义副本数

--partitions 定义分区数

(3)删除 topic

[Tom@hadoop102 kafka-0.11]$ bin/kafka-topics.sh --zookeeper hadoop102:2181 --delete --topic first

需要server.properties中设置 delete.topic.enable=true,否则只是标记删除。

(4)发送消息

[Tom@hadoop102 kafka-0.11]$ bin/kafka-console-producer.sh --broker-list hadoop102:9092 --topic first

>hello world!

>hello HUST!

(5)消费消息

[Tom@hadoop102 kafka-0.11]$ bin/kafka-console-consumer.sh --zookeeper hadoop102:2181 --topic first

Using the ConsoleConsumer with old consumer is deprecated and will be removed in a future major release. Consider using the new consumer by passing [bootstrap-server] instead of [zookeeper].

hello world!

hello HUST!

[Tom@hadoop102 kafka-0.11]$ bin/kafka-console-consumer.sh --bootstrap-server hadoop102:9092 --topic first

hello world!

hello HUST!

[huxili@hadoop102 kafka-0.11]$ bin/kafka-console-consumer.sh --bootstrap-server hadoop102:9092 --from-beginning --topic first

hello world!

hello HUST!

hello world!

hello HUST!

--from-beginning:会把主题中以往所有的数据都读取出来。

(6)查看某个 Topic 的详情

[Tom@hadoop102 kafka-0.11]$ bin/kafka-topics.sh --zookeeper hadoop102:2181 --describe --topic first

Topic:first PartitionCount:1 ReplicationFactor:3 Configs:

Topic: first Partition: 0 Leader: 0 Replicas: 0,1,2 Isr: 0,1,2

(7)修改分区数

[Tom@hadoop102 kafka-0.11]$ bin/kafka-topics.sh --zookeeper hadoop102:2181 --alter --topic first --partitions 6

WARNING: If partitions are increased for a topic that has a key, the partition logic or ordering of the messages will be affected

Adding partitions succeeded!

[Tom@hadoop102 kafka-0.11]$ bin/kafka-topics.sh --zookeeper hadoop102:2181 --describe --topic first

Topic:first PartitionCount:6 ReplicationFactor:3 Configs:

Topic: first Partition: 0 Leader: 0 Replicas: 0,1,2 Isr: 0,1,2

Topic: first Partition: 1 Leader: 1 Replicas: 1,2,0 Isr: 1,2,0

Topic: first Partition: 2 Leader: 2 Replicas: 2,0,1 Isr: 2,0,1

Topic: first Partition: 3 Leader: 0 Replicas: 0,2,1 Isr: 0,2,1

Topic: first Partition: 4 Leader: 1 Replicas: 1,0,2 Isr: 1,0,2

Topic: first Partition: 5 Leader: 2 Replicas: 2,1,0 Isr: 2,1,0

3 Kafka 架构深入

3.1 Kafka 工作流程及文件存储机制

Kafka 中消息是以topic进行分类的,生产者生产消息,消费者消费消息,都是面向 topic 的。

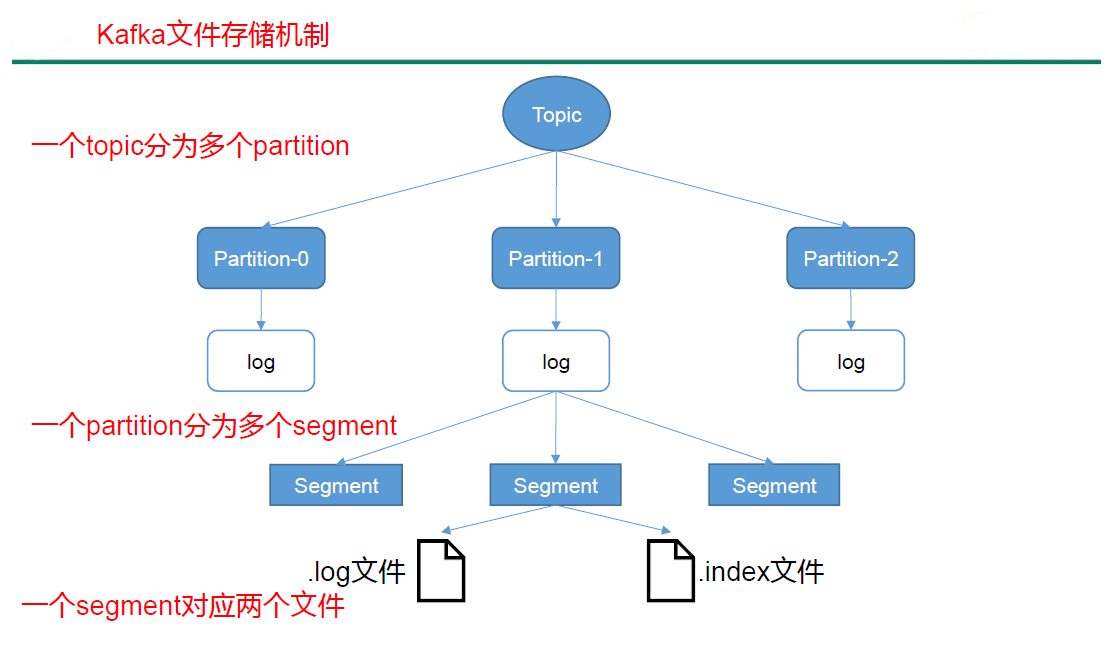

topic 是逻辑上的概念,而 partition 是物理上的概念,每个 partition 对应于一个 log 文件,该 log 文件中存储的就是 producer 生产的数据。producer 生产的数据会被不断追加到该 log 文件末端,且每条数据都有自己的 offset。消费者组中的每个消费者,都会实时记录自己消费到了哪个 offset,以便出错恢复时,从上次的位置继续消费。

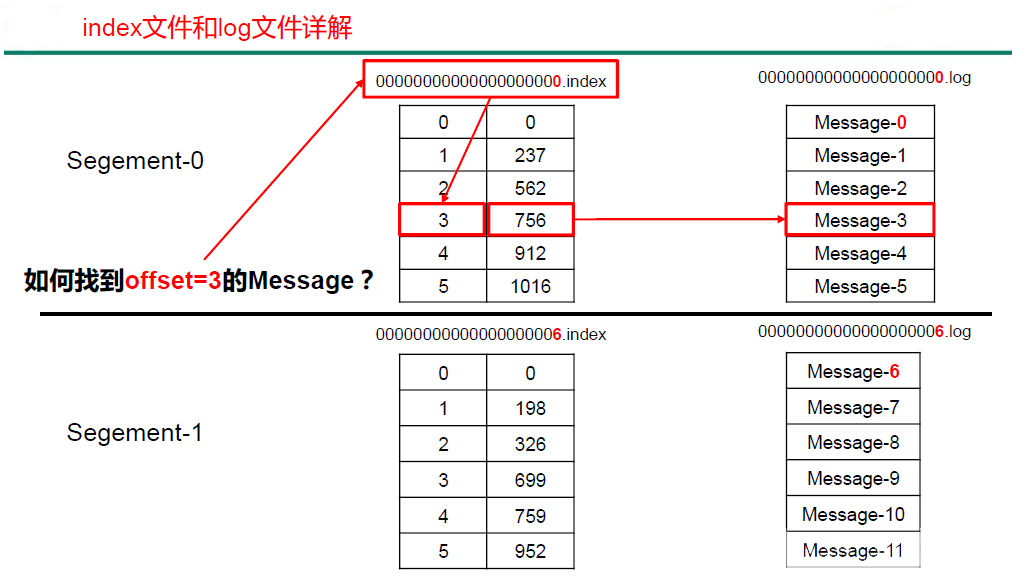

由于生产者生产的消息会不断追加到 log 文件末尾,为防止 log 文件过大导致数据定位效率低下,Kafka 采取了分片和索引机制,将每个 partition 分为多个 segment。每个 segment对应两个文件——.index文件和.log文件。这些文件位于一个文件夹下,该文件夹的命名规则为:topic 名称+分区序号。例如,first 这个topic 有三个分区,则其对应的文件夹为first-0,first-1,first-2。

00000000000000000000.index

00000000000000000000.log

00000000000000170410.index

00000000000000170410.log

00000000000000239430.index

00000000000000239430.log

index 和 log 文件以当前 segment 的第一条消息的 offset 命名。下图为 index 文件和 log 文件的结构示意图。

.index文件存储大量的索引信息 ,.log文件存储大量的数据 ,索引文件中的元数据指向对应数据文件中 message 的物理偏移地址 。

3.2 Kafka 生产者

3.2.1 分区策略

1. 分区的原因

(1) 方便在集群中扩展 ,每个 partition 可以通过调整以适应它所在的机器,而一个 topic 又可以由多个 partition 组成,因此整个集群就可以适应任意大小的数据了;

(2)可以提高并发 ,因为可以以 partition 为单位读写了。

2. 分区的原则

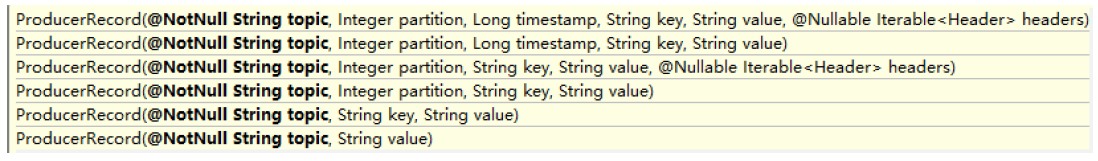

<font color= size=3 > 我们需要将 producer 发送的数据封装成一个 ProducerRecord 对象 。

(1)指明 partition 的情况下,直接将指明的值直接作为 partiton 值;

(2) 没有指明 partition 值但有 key 的情况下,将 key 的 hash 值与 topic 的 partition 数进行取余得到 partition 值;

(3) 既没有 partition 值又没有 key 值的情况下,第一次调用时随机生成一个整数(后面每次调用在这个整数上自增),将这个值与 topic 可用的 partition 总数取余得到 partition 值,也就是常说的 round-robin 算法。

3.2.2 数据可靠性保证

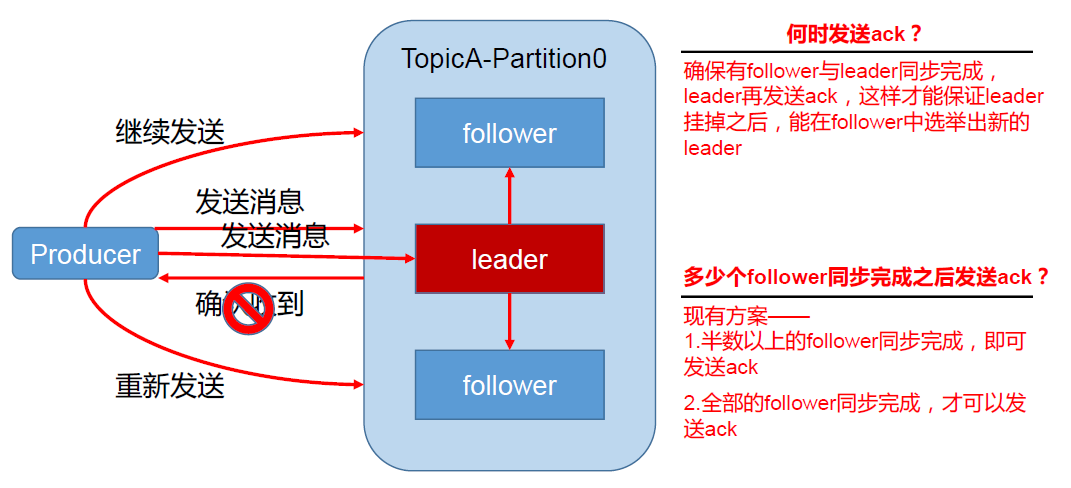

为保证 producer 发送的数据,能可靠的发送到指定的 topic,topic 的每个 partition 收到 producer 发送的数据后, 都需要向 producer 发送 ack (acknowledgement 确认收到 ),如果 producer 收到 ack 就会进行下一轮的发送,否则重新发送数据。

1. 副本数据同步策略

Kafka 选择了第二种方案,原因如下:

1.同样为了容忍 n 台节点的故障,第一种方案需要 2n+1 个副本,而第二种方案只需要 n+1 个副本,而Kafka 的每个分区都有大量的数据,第一种方案会造成大量数据的冗余。

2.虽然第二种方案的网络延迟会比较高,但网络延迟对 Kafka 的影响较小。

2. ISR

采用第二种方案之后,设想以下情景:leader 收到数据,所有 follower 都开始同步数据,但有一个 follower,因为某种故障,迟迟不能与 leader 进行同步,那leader 就要一直等下去,直到它完成同步,才能发送 ack。这个问题怎么解决呢?

Leader 维护了一个动态的 in-sync replica set (ISR),意为和 leader 保持同步的follower 集合。当 ISR 中的 follower 完成数据的同步之后,broker 就会给 producer 发送 ack。如果 follower长时间未向 leader 同步数据, 则该 follower 将被踢出 ISR , 该时间阈值由 replica.lag.time.max.ms 参数设定。Leader 发生故障之后,就会从 ISR 中选举新的 leader。

3. ack 应答机制

对于某些不太重要的数据,对数据的可靠性要求不是很高,能够容忍数据的少量丢失,所以没必要等 ISR 中的 follower 全部接收成功。所以 Kafka 为用户提供了三种可靠性级别,用户根据对可靠性和延迟的要求进行权衡,选择以下的配置。

acks:

0:producer 不等待 broker 的 ack,这一操作提供了一个最低的延迟,broker 一接收到还没有写入磁盘就已经返回,当 broker 故障时有可能丢失数据;

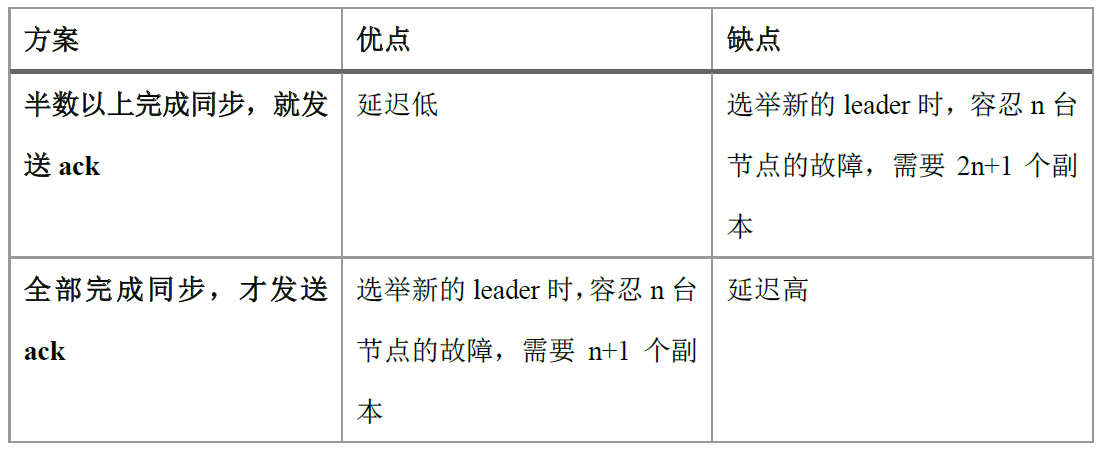

1:producer 等待 broker 的 ack,partition 的 leader 落盘成功后返回 ack,如果在 follower 同步成功之前 leader 故障,那么将会丢失数据;

acks = 1 数据丢失案例:

-1(all):producer 等待 broker 的 ack,partition 的 leader 和 follower 全部落盘成功后才返回 ack。但是如果在 follower 同步完成后,broker 发送 ack 之前,leader 发生故障,那么会造成数据重复。

acks = -1 数据重复案例:

4. 故障处理细节

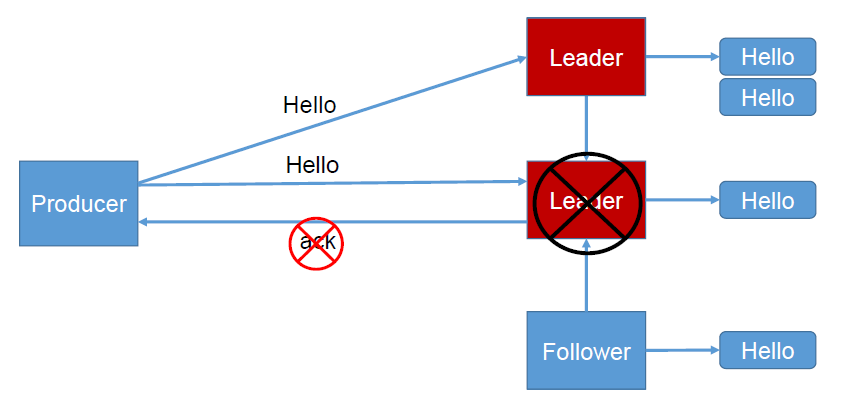

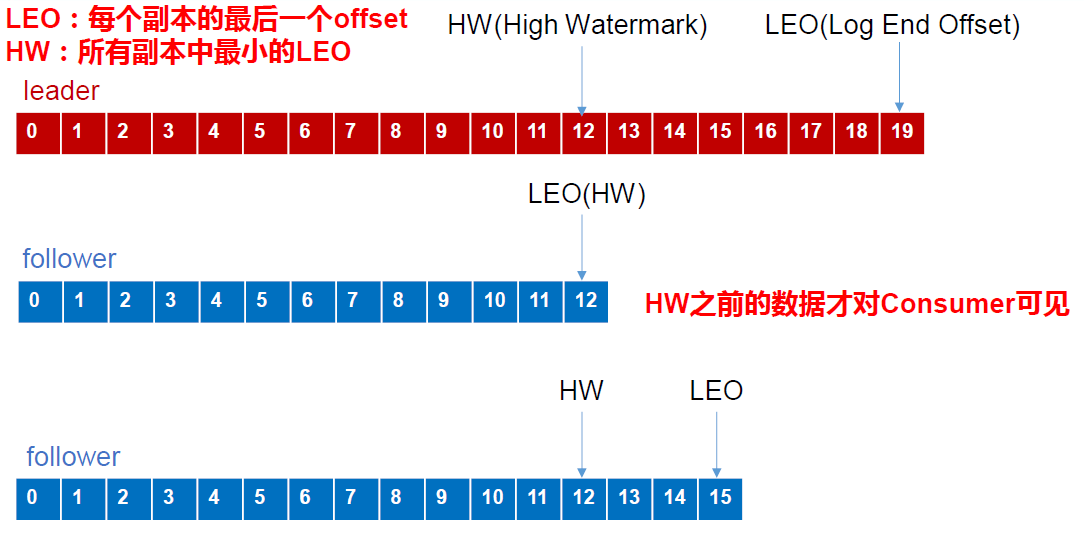

LEO:指的是每个副本最大的offset;

HW:指的是消费者能见到的最大的offset,ISR 队列中最小的LEO。

(1)follower 故障

follower 发生故障后会被临时踢出 ISR,待该 follower 恢复后,follower 会读取本地磁盘记录的上次的HW,并将 log 文件高于HW 的部分截取掉,从HW 开始向 leader 进行同步。等该 follower 的 LEO 大于等于该 Partition 的 HW,即 follower 追上leader 之后,就可以重新加入 ISR 了。

(2)leader 故障

leader 发生故障之后,会从 ISR 中选出一个新的 leader,之后,为保证多个副本之间的数据一致性,

其余的 follower 会先将各自的 log 文件高于 HW 的部分截掉 ,然后从新的 leader 同步数据。

注意:这只能保证副本之间的数据一致性,并不能保证数据不丢失或者不重复。

3.2.3 Exactly Once 语义

将服务器的 ACK 级别设置为 -1,可以保证 Producer到 Server之间不会丢失数据,即At Least Once语义 。相对的,将服务器 ACK 级别设置为 0,可以保证生产者每条消息只会被发送一次,即 At Most Once语义。

At Least Once可以保证数据不丢失,但是不能保证数据不重复;相对的, At Least Once可以保证数据不重复,但是不能保证数据不丢失。 但是,对于一些非常重要的信息,比如说交易数据,下游数据消费者要求数据既不重复也不丢失,即 Exactly Once语义。 在 0.11版本以前的 Kafka,对此是无能为力的,只能保证数据不丢失,再在下游消费者对数据做全局去重。对于多个下游应用的情况,每个都需要单独做全局去重,这就对性能造成了很大影响。

0.11版本的 Kafka,引入了一项重大特性:幂等性。所谓的幂等性就是指 Producer 不论向 Server 发送多少次重复数据, Server 端都只会持久化一条。幂等性结合At Least Once语义,就构成了 Kafka 的 Exactly Once语义。即:

At Least Once + 幂等性 = Exactly Once

要启用幂等性,只需要将 Producer 的参数中 enable.idompotence 设置为 true 即可。 Kafka 的幂等性实现其实就是将原来下游需要做的去重放在了数据上游。开启幂等性的 Producer 在初始化的时候会被分配一个 PID,发往同一 Partition 的消息会附带 Sequence Number。而Broker 端会对 <PID, Partition, SeqNumber>做缓存,当具有相同主键的消息提交时, Broker 只会持久化一条。

但是 PID 重启就会变化,同时不同的 Partition 也具有不同主键,所以幂等性无法保证跨分区跨会话的 Exactly Once。

3.3 Kafka 消费者

3.3.1 消费方式

consumer 采用 pull(拉)模式从 broker 中读取数据。

push(推)模式很难适应消费速率不同的消费者,因为消息发送速率是由 broker决定的。它的目标是尽可能以最快速度传递消息,但是这样很容易造成 consumer 来不及处理消息,典型的表现就是拒绝服务以及网络拥塞。而 pull 模式则可以根据 consumer 的消费能力以适当的速率消费消息。

pull 模式不足之处是,如果 kafka 没有数据,消费者可能会陷入循环中,一直返回空数据。针对这一点,Kafka 的消费者在消费数据时会传入一个时长参数 timeout,如果当前没有数据可供消费,consumer 会等待一段时间之后再返回,这段时长即为 timeout。

3.3.2 分区分配策略

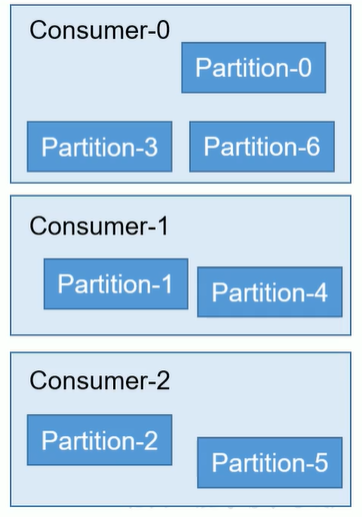

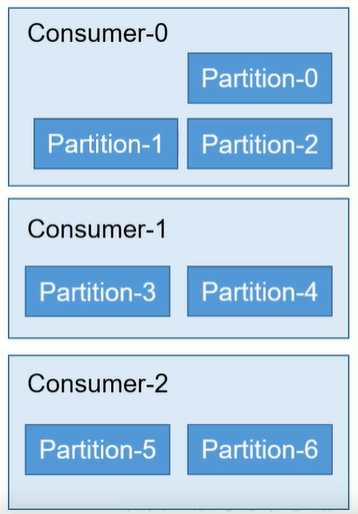

一个 consumer group 中有多个 consumer,一个 topic 有多个 partition,所以必然会涉及到 partition 的分配问题,即确定那个 partition 由哪个 consumer 来消费。

Kafka 有两种分配策略,一是RoundRobin,按组划分,一是Range,按主题划分。

1. RoundRobin

2. Range

3.3.3 offset 的维护

由于 consumer 在消费过程中可能会出现断电宕机等故障,consumer 恢复后,需要从故障前的位置的继续消费,所以 consumer 需要实时记录自己消费到了哪个offset,以便故障恢

复后继续消费。

Kafka 0.9 版本之前,consumer 默认将 offset 保存在 Zookeeper 中,从0.9 版本开始,consumer 默认将 offset 保存在 Kafka 一个内置的 topic 中,该 topic 为 __consumer_offsets。

(1)修改配置文件 consumer.properties

exclude.internal.topics=false

(2)读取 offset

[Tom@hadoop102 kafka-0.11]$ kafka-console-consumer.sh --topic __consumer_offsets --bootstrap-server hadoop102:9092 --formatter "kafka.coordinator.group.GroupMetadataManager\$OffsetsMessageFormatter" --consumer.config config/consumer.properties --from-beginning

3.3.4 消费者组案例

(1)需求:测试同一个消费者组中的消费者, 同一时刻只能有一个消费者消费。

(2)案例实操

1.在 hadoop102、 hadoop103 上 修改/opt/module/kafka-0.11/config/consumer.properties配置文件中的 group.id 属性为任意组名。

[Tom@hadoop102 kafka-0.11]$ vim config/consumer.properties

#consumer group id

group.id=Tom

(2)在 hadoop102、 hadoop103 上分别启动消费者

[Tom@hadoop102 kafka-0.11]$ bin/kafka-console-consumer.sh --zookeeper hadoop102:2181 --topic first --consumer.config config/consumer.properties

[Tom@hadoop103 kafka-0.11]$ bin/kafka-console-consumer.sh --bootstrap-server hadoop102:9092 --topic first --consumer.config config/consumer.properties

(3)在 hadoop104上启动生产者

[Tom@hadoop104 kafka-0.11]$ bin/kafka-console-producer.sh --broker-list hadoop102:9092 --topic first

>hello

>hust

(4)查看 hadoop102 和 hadoop103 的接收者 。同一时刻只有一个消费者接收到消息。

3.4 Kafka 高效读写数据

1. 顺序写磁盘

Kafka 的 producer 生产数据,要写入到 log 文件中,写的过程是一直追加到文件末端,为顺序写 。 官网有数据表明,同样的磁盘,顺序写能到 600M/s,而随机写只有 100K/s。这与磁盘的机械机构有关,顺序写之所以快,是因为其省去了大量磁头寻址的时间 。

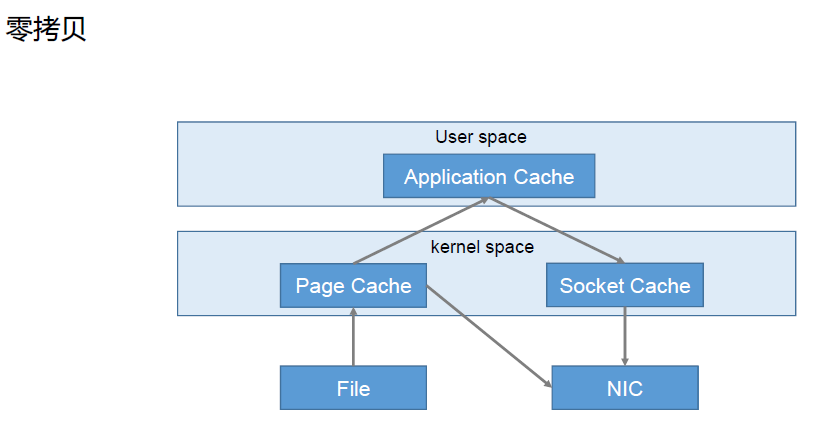

2. 零复制技术

3.5 Zookeeper 在 Kafka 中的作用

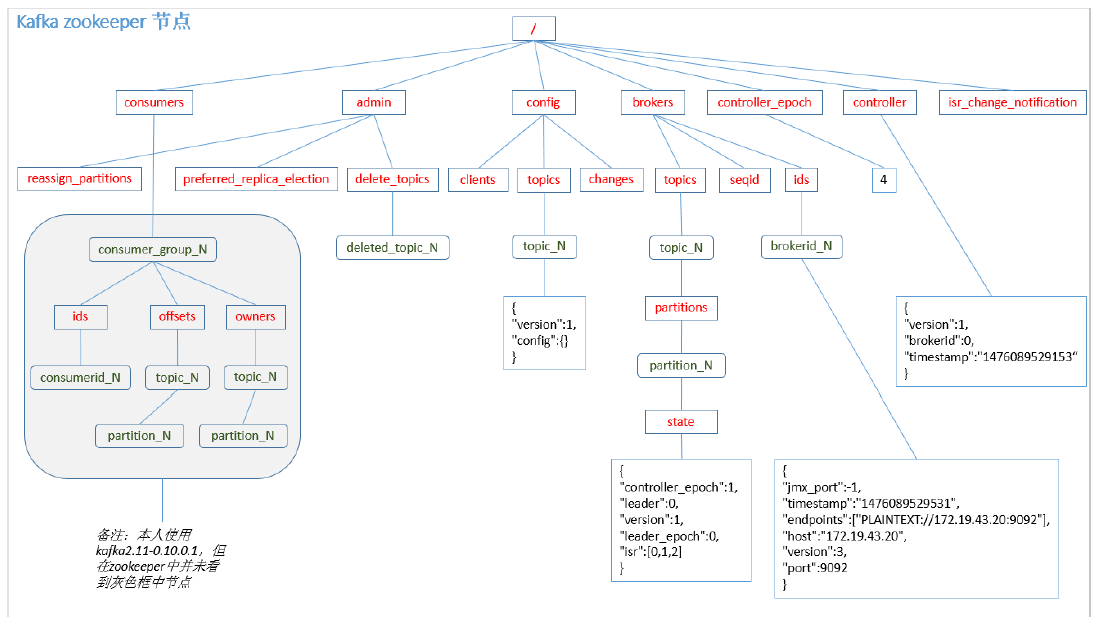

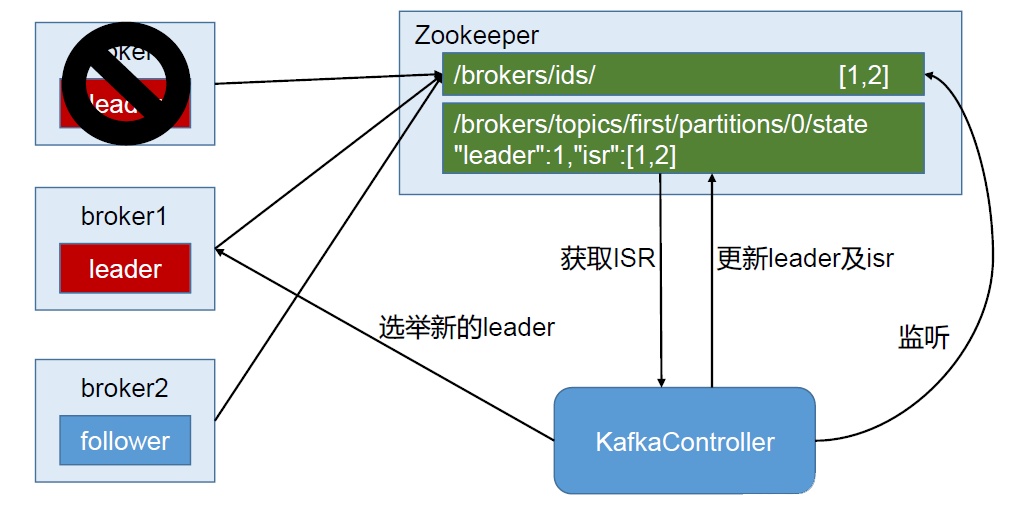

Kafka 集群中有一个 broker 会被选举为 Controller,负责管理集群 broker 的上下线,所有 topic 的分区副本分配和 leader 选举等工作。Controller 的管理工作都是依赖于 Zookeeper 的。以下为 partition 的 leader 选举过程:

3.6 Kafka 事务

Kafka 从 0.11 版本开始引入了事务支持。事务可以保证 Kafka 在 Exactly Once 语义的基础上,生产和消费可以跨分区和会话,要么全部成功,要么全部失败。

3.6.1 Producer 事务

为了实现跨分区跨会话的事务,需要引入一个全局唯一的 Transaction ID,并将 Producer 获得的 PID 和 Transaction ID绑定。这样当 Producer 重启后就可以通过正在进行的 Transaction ID获得原来的 PID。

为了管理 Transaction,Kafka 引入了一个新的组件 Transaction Coordinator。 Producer 就是通过和 Transaction Coordinator 交互获得 Transaction ID 对应的任务状态。 Transaction Coordinator 还负责将事务所有写入 Kafka 的一个内部 Topic,这样即使整个服务重启,由于事务状态得到保存,进行中的事务状态可以得到恢复,从而继续进行。

3.6.2 Consumer 事务

上述事务机制主要是从 Producer 方面考虑,对于 Consumer 而言,事务的保证就会相对较弱,尤其时无法保证 Commit 的信息被精确消费。这是由于 Consumer 可以通过 offset 访问任意信息,而且不同的 Segment File 生命周期不同,同一事务的消息可能会出现重启后被删除的情况。