摘要:近日,昇腾AI联合浦江实验室,正式实现OpenMMLab算法仓库在昇腾的异构计算架构CANN上的推理部署,目前相关代码已推入MMDeploy 0.10.0版本,并在GitHub正式发布。

本文分享自华为云社区《昇腾携手OpenMMLab,支持海量算法仓库的昇腾AI推理部署》,作者:昇腾CANN 。

近日,昇腾AI联合浦江实验室,正式实现OpenMMLab算法仓库在昇腾的异构计算架构CANN上的推理部署,目前相关代码已推入MMDeploy 0.10.0版本,并在GitHub正式发布。

CANN是专门面向AI场景的异构计算架构,同时作为昇腾AI基础软硬件平台的核心组成部分之一,搭起了从上层深度学习框架到底层AI硬件的桥梁,全面支持昇思MindSpore、飞桨(PaddlePaddle)、PyTorch、TensorFlow、Caffe、计图(Jittor)等主流AI框架,提供900多种优选模型,能够覆盖众多典型场景应用,兼容多种底层硬件设备,提供强大异构计算能力。

OpenMMLab是深度学习时代全球领域最全面、最具影响力的视觉算法开源项目之一,为学术和产业界提供一个可跨方向、结构精良、易复现的统一算法工具库。OpenMMLab 已经累计开源了超过 30 个算法库,涵盖分类、检测、分割、视频理解等众多研究领域,拥有超过 300 种算法、2,400 多个预训练模型。在 GitHub 上获得超过 70,000 个标星,同时吸引了超过 1,500 名社区开发者参与项目贡献,用户遍及超过 110 个国家和地区,覆盖全国全球顶尖高校、研究机构和企业。

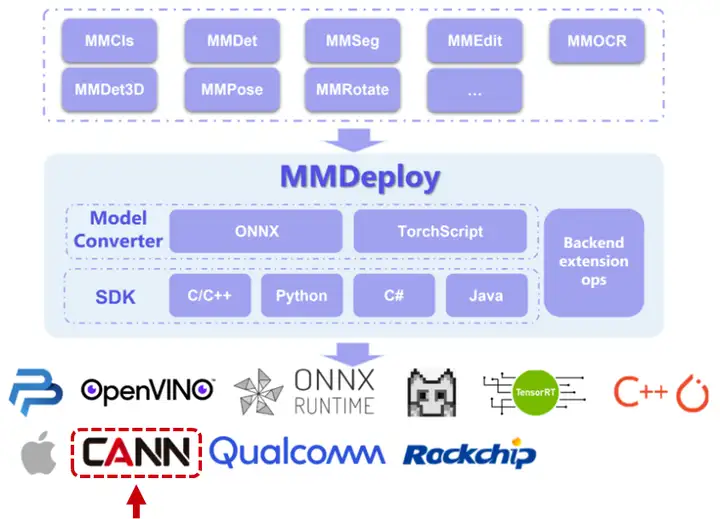

MMDeploy作为OpenMMLab旗下的推理部署工具,可将OpenMMLab算法在各种后端硬件上运行,并提供了简单易用的调用接口,在各高校拥有一批年轻的开发者。

CANN具备灵活的框架适配度,也是昇腾高算力硬件的使能引擎,因此很自然地和MMDeploy走到了一起。CANN不但扩充了OpenMMLab算法推理后端,使能开发者基于MMDeploy和CANN快速构建AI应用和业务,还能充分发挥昇腾AI硬件澎湃算力,加速推理业务的执行。

通过此次合作,将赋能开发者基于MMDeploy和CANN进行人工智能推理应用的高效开发、部署,也为双方后续的持续合作打下坚实的基础,促进更多业务场景的技术创新和生态共赢。

图片来源:MMDeploy GitHub开源社区

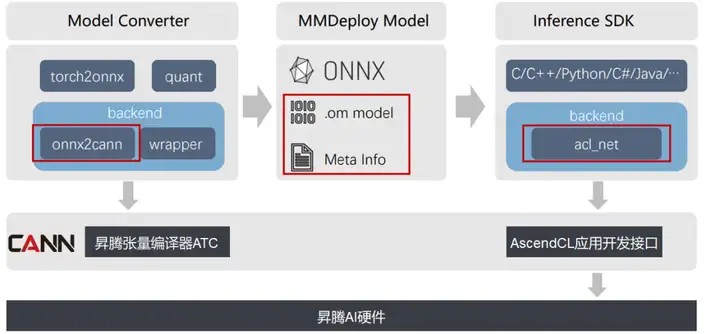

我们可以从下图清晰地看到基于MMDeploy和CANN的推理部署框架。Model Converter作为MMDeploy的模型转换模块,通过onnx2cann将前端模型转换为昇腾AI硬件支持的模型格式,然后送入MMDeploy的Inference SDK模块,调用CANN的AscendCL应用开发接口完成推理任务在昇腾AI硬件上的执行。

基于MMDeploy+CANN的推理部署框架

通过MMDeploy和CANN的对接适配,目前已验证包含OpenMMLab 4个算法库在内的18个流行的视觉算法可以直接在昇腾AI硬件上运行。

未来,随着MMDeploy和CANN合作的不断深入,双方将会从丰富算法库和高效推理层面持续创新和优化,促进昇腾AI和OpenMMLab的共同繁荣。同时,也欢迎大家在昇腾和MMDeploy的开源社区一起交流、探索和改进,以更完善的模型满足度、更高效的推理部署方式,使能更多人工智能场景,共同推进计算产业发展和生态构建!