更换骨干网

MobileNet V2

MobileNet V2可以作为一些深度学习网络应用的骨干网使用。

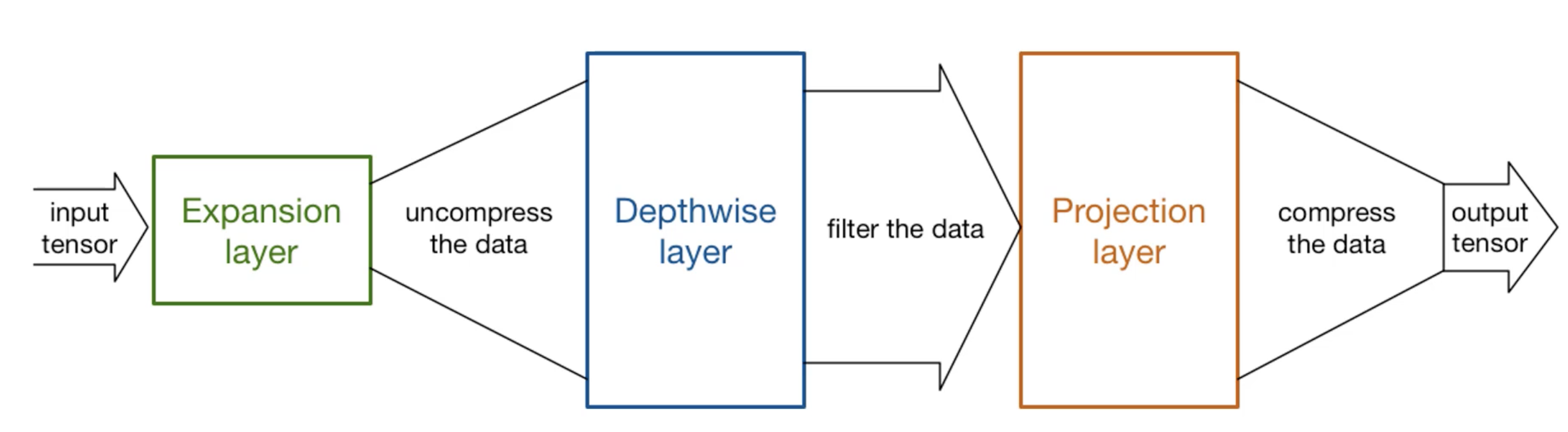

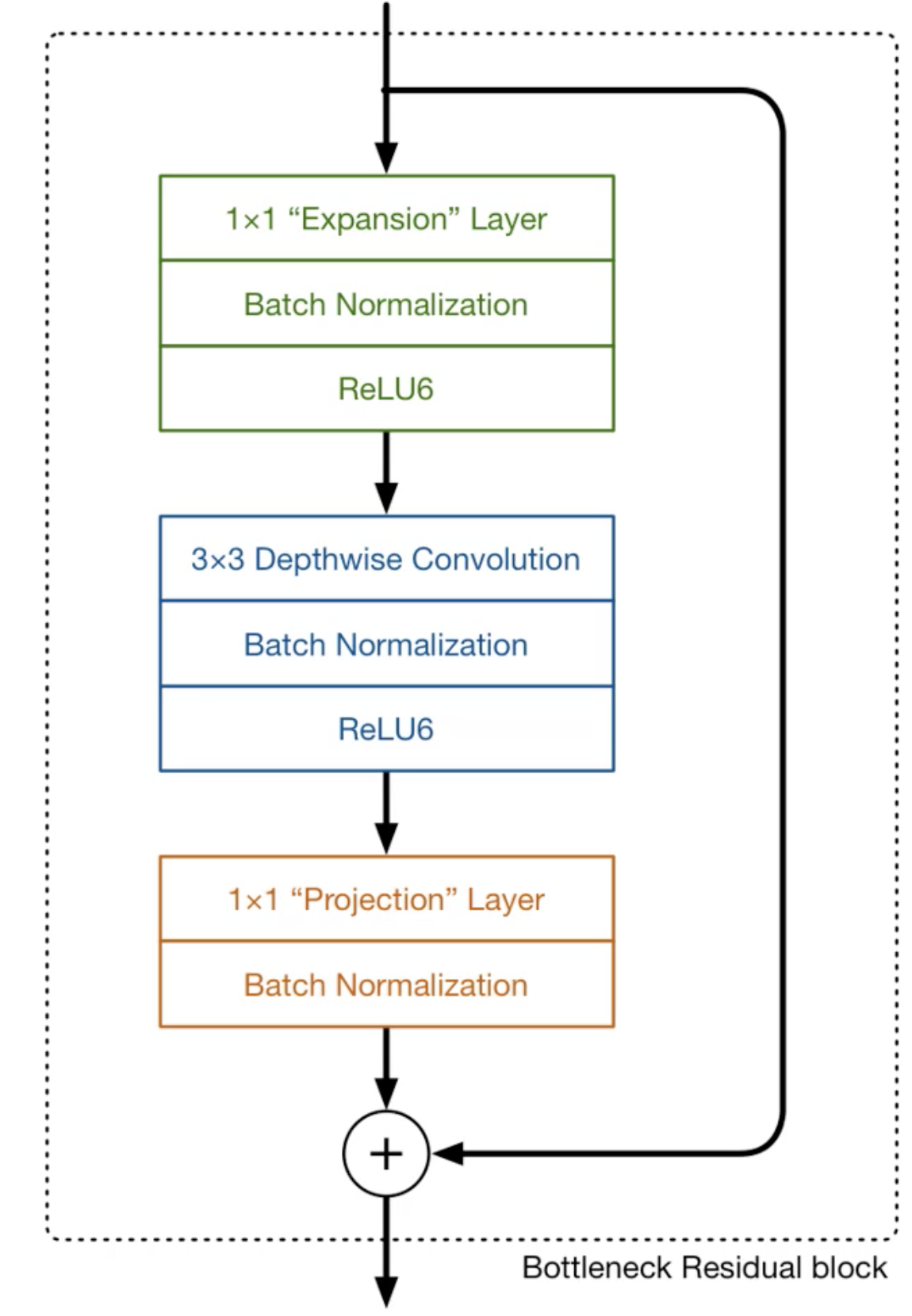

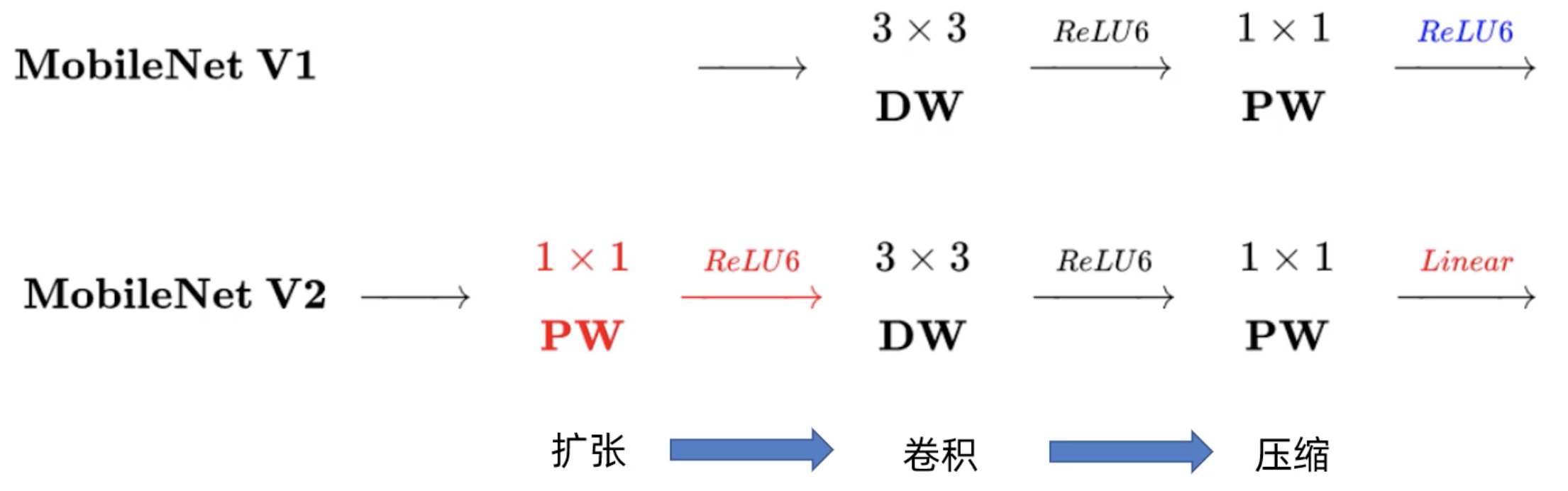

MobileNet V2的主要贡献是一个新颖的层模块:具有线性瓶颈的倒残差(inverted residual):该模块将低维压缩表示作为输入,首先将其扩展为高维度并使用轻量级深度可分离卷积(depthwise convolution)进行滤波。然后通过线性卷积将特征投射回低维表示。

通过上图,我们可以看到输入经过一个1*1的扩展卷积层,对输入进行升维。中间部分跟MobileNet V1是一样的,使用的是3*3的深度可分离卷积来进行特征提取。最后经过一个1*1的卷积层将深刻可分离卷积提取的特征还原回输入的形状(降维)进行输出,这里跟MobileNet V1不同的是它没有再使用Relu激活函数。另外它还有一个直接的连接,将输入与输出进行相加。

基本构建块是一个深度可分离卷积与残差连接。块的输入和输出是低维张量,而块内发生的滤波步骤是在高维张量上完成。如上图中,输入是一个56*56*24的feature map,经过1*1卷积核的扩展变成56*56*144的状态,它的扩展因子为6。再经过深度可分离卷积进行特征提取之后(这里形状未发生变化)经过1*1卷积变回56*56*24的形状,再经过一个残差连接,将输入、输出进行相加。

{{o.name}}

{{m.name}}