非常期待YOLOv6(YOLOv4/v5已发布一年了),白嫖真香!

其中YOLOX-L版本以 68.9 FPS 的速度在 COCO 上实现了 50.0% AP,比 YOLOv5-L 高出 1.8% AP!还提供了支持 ONNX、TensorRT、NCNN 和 Openvino 的部署版本。代码刚刚开源!

YOLOX

YOLOX: Exceeding YOLO Series in 2021

- 作者单位:旷视科技

- 代码:https://github.com/Megvii-BaseDetection/YOLOX

- 论文:https://arxiv.org/abs/2107.08430

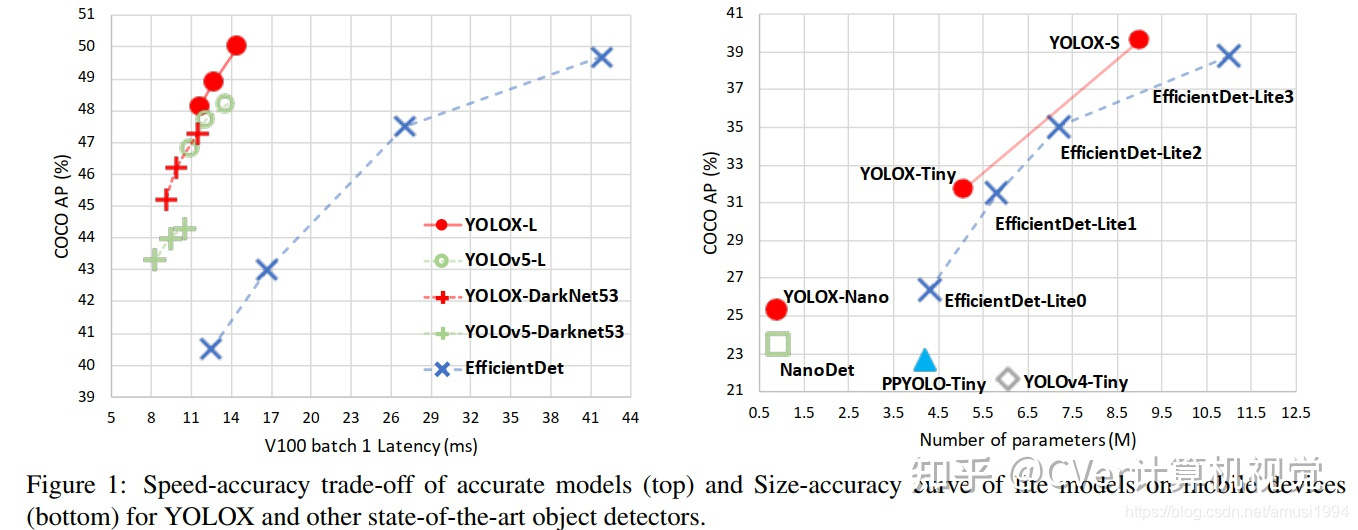

在本报告中,我们介绍了YOLO系列的一些经验改进,形成了一个新的高性能检测器——YOLOX。我们将 YOLO 检测器切换为anchor-free并进行其他先进的检测技术,即decoupled head 和领先的标签分配策略 SimOTA,以在大量模型中实现最先进的结果。

对于 YOLO -Nano 仅 0.91M 参数和 1.08G FLOPs,我们在 COCO 上获得 25.3% AP,超过 NanoDet 1.8% AP;

对于业界应用最广泛的检测器之一 YOLOv3,我们在 COCO 上将其提升至 47.3% AP,比当前最佳高 3.0% AP;

对于参数量与 YOLOv4-CSP、YOLOv5-L 大致相同的 YOLOX-L,我们在 Tesla V100 上以 68.9 FPS 的速度在 COCO 上实现了 50.0% AP,比 YOLOv5-L 高出 1.8% AP。

此外,我们使用单个 YOLOX-L 模型赢得了Streaming Perception挑战(CVPR 2021 自动驾驶Worksho)的第一名。我们希望这份报告能够在实际场景中为开发者和研究人员提供有用的经验,我们也提供了支持 ONNX、TensorRT、NCNN 和 Openvino 的部署版本。

CVer-目标检测交流群

建了CVer-目标检测交流群!想要进目标检测学习交流群的同学,可以直接加微信号:CVer9999。加的时候备注一下:目标检测+学校/公司+昵称,即可。然后就可以拉你进群了。

强烈推荐大家关注CVer知乎账号和CVer微信公众号,可以快速了解到最新优质的CV论文。