SMP2021大模型技术论坛——部分PPT

CCL2021:

http://www.cips-cl.org/static/CCL2021/index.html

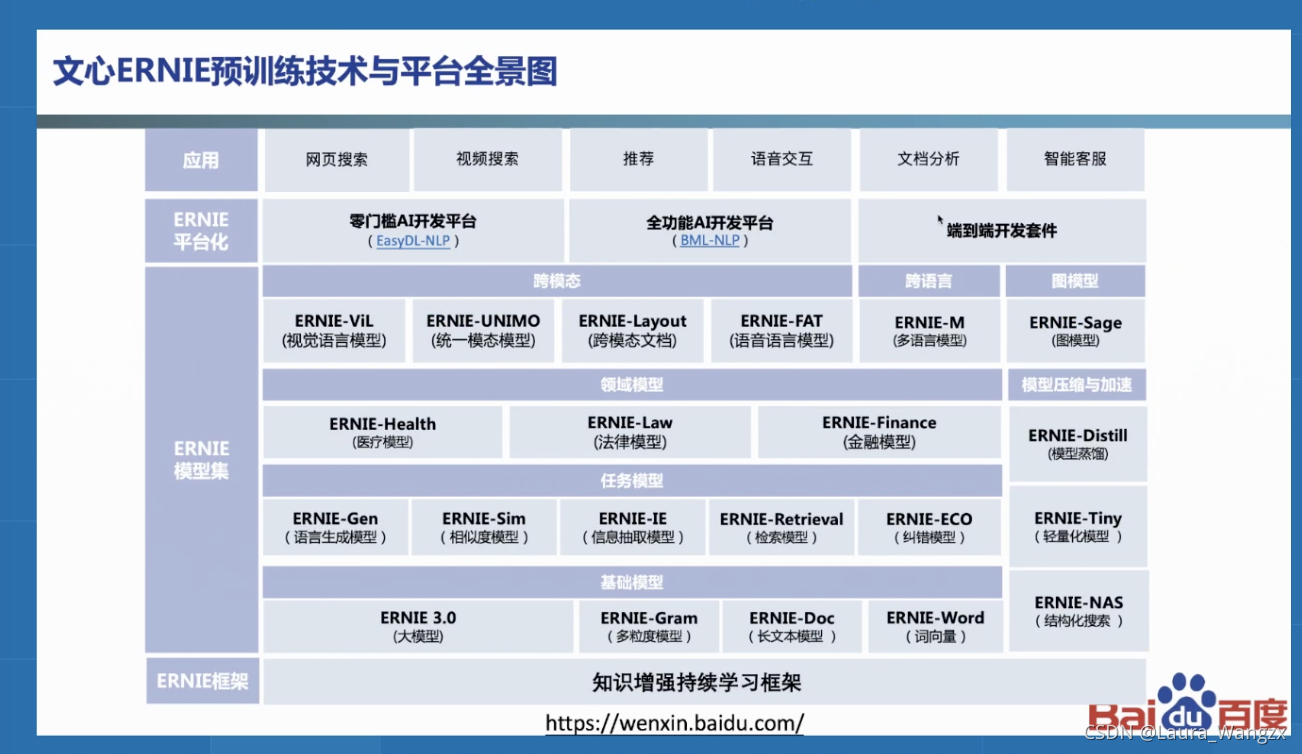

ERNIE系列语言模型——孙宇

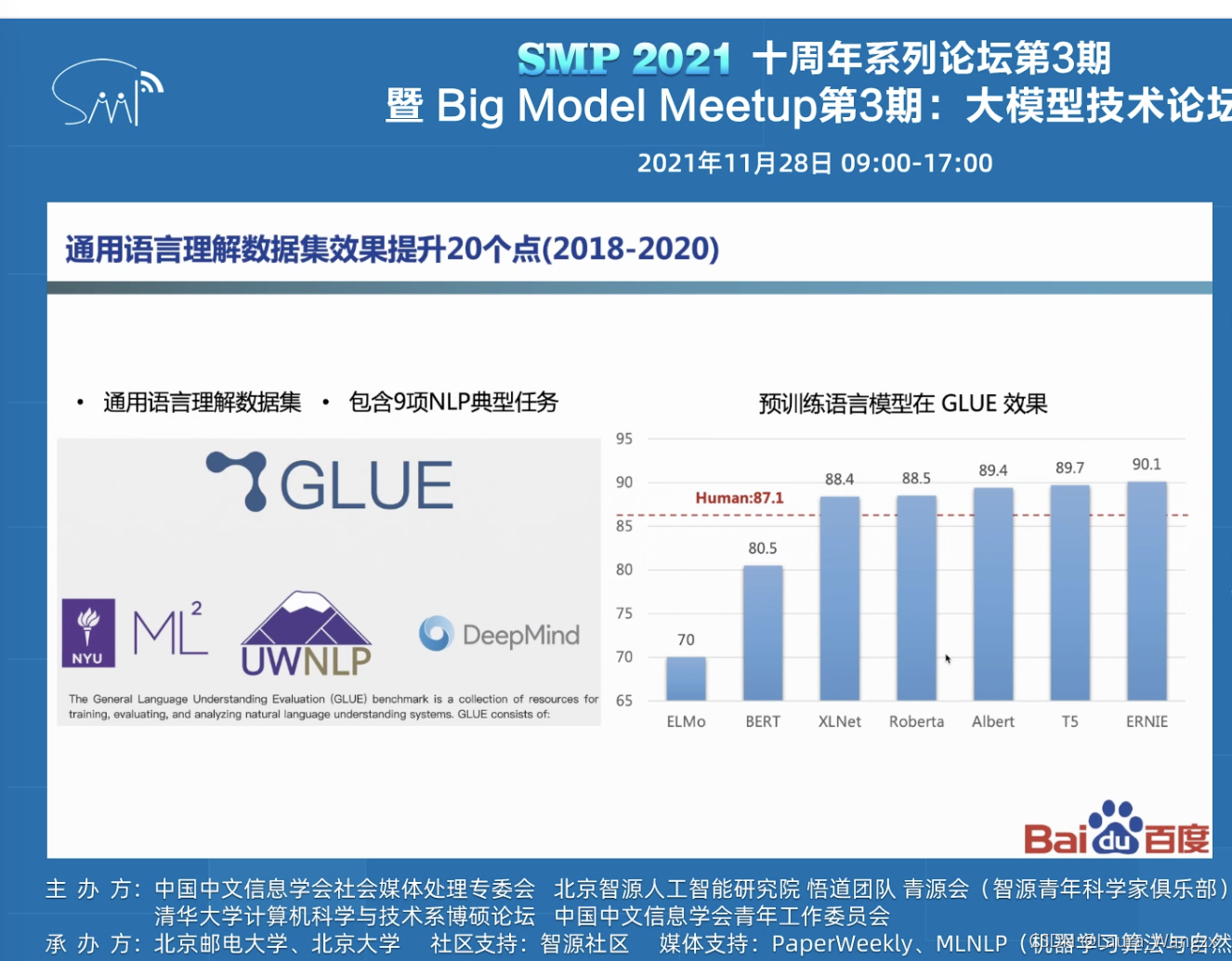

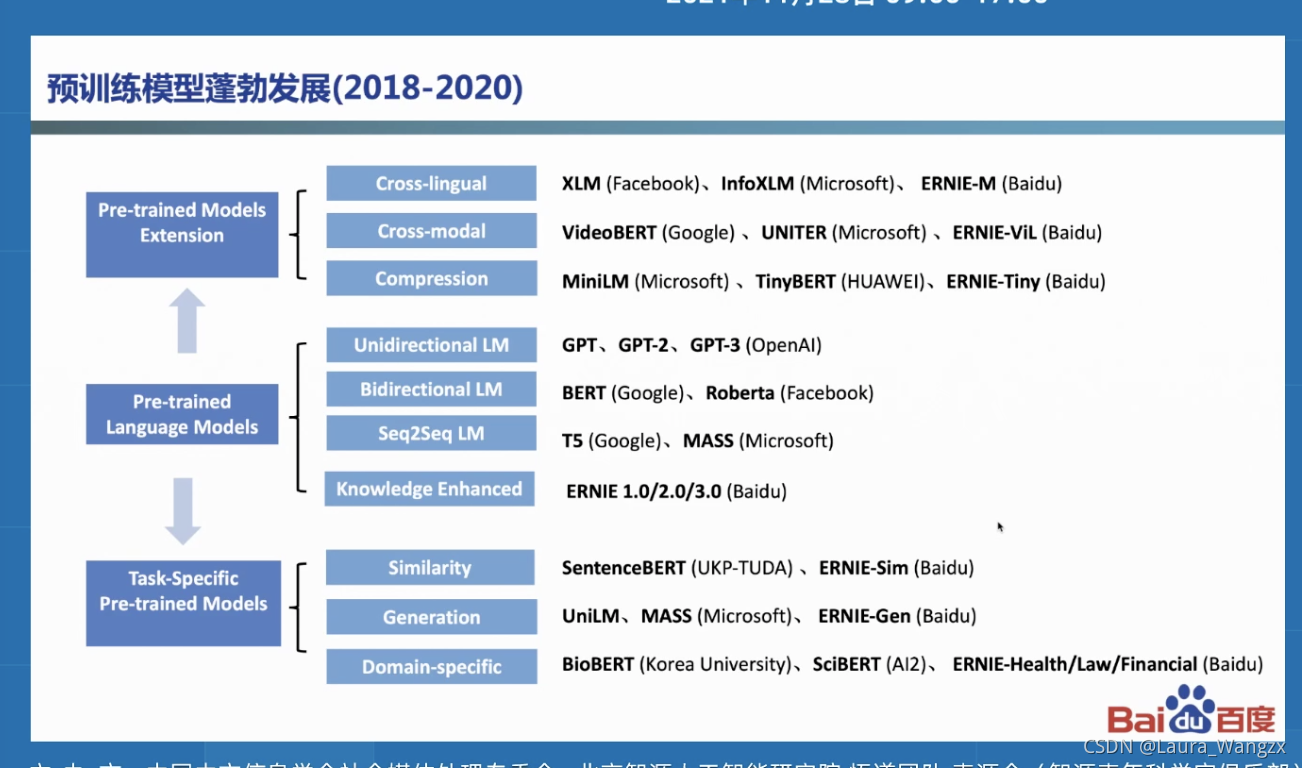

NLP理解任务 单向/双向/Seq2Seq…

单向/双向/Seq2Seq…

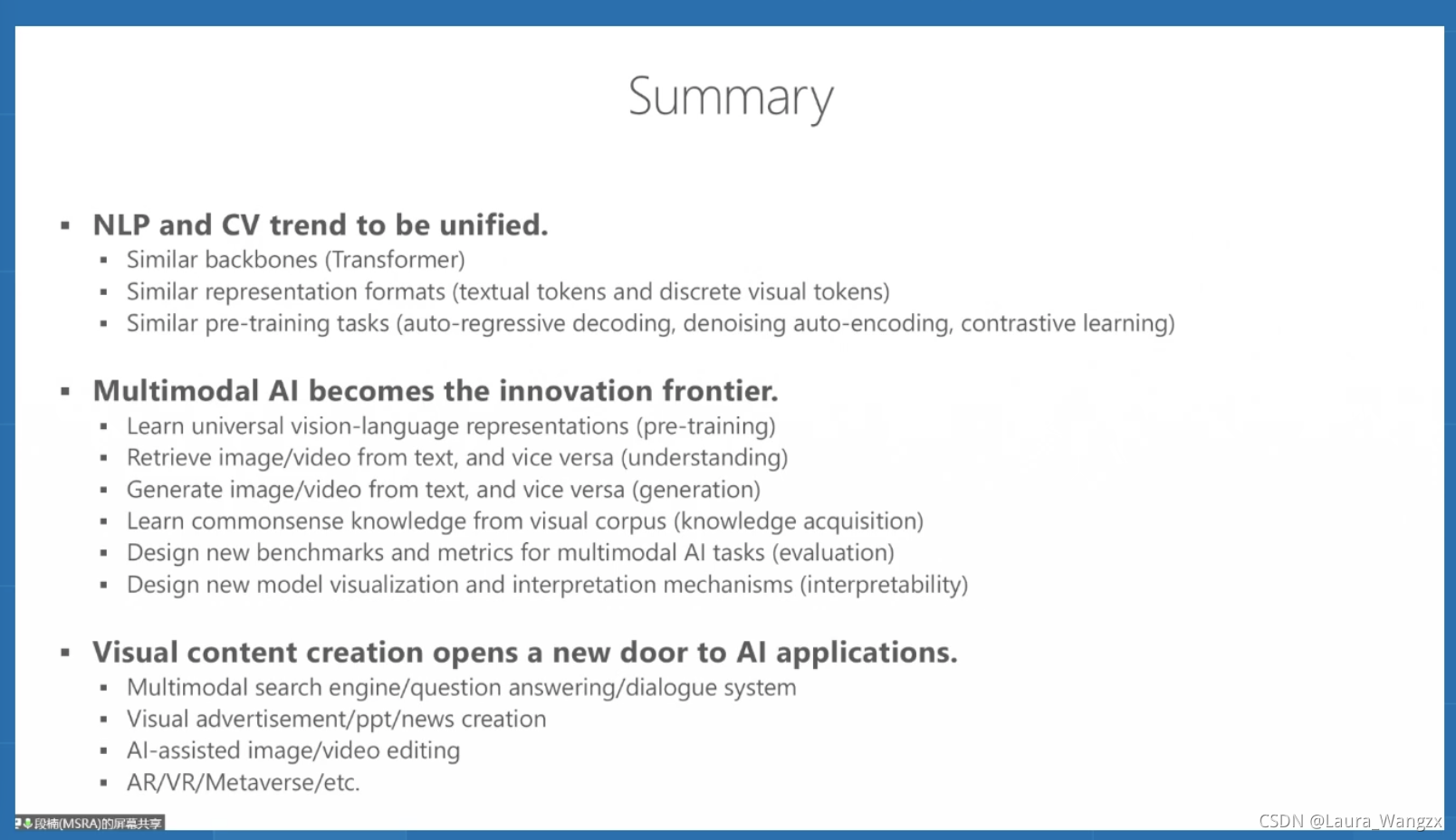

自然语言处理NLP——计算机视觉CV——跨模态预训练

语言可以映射到一个语义空间学习

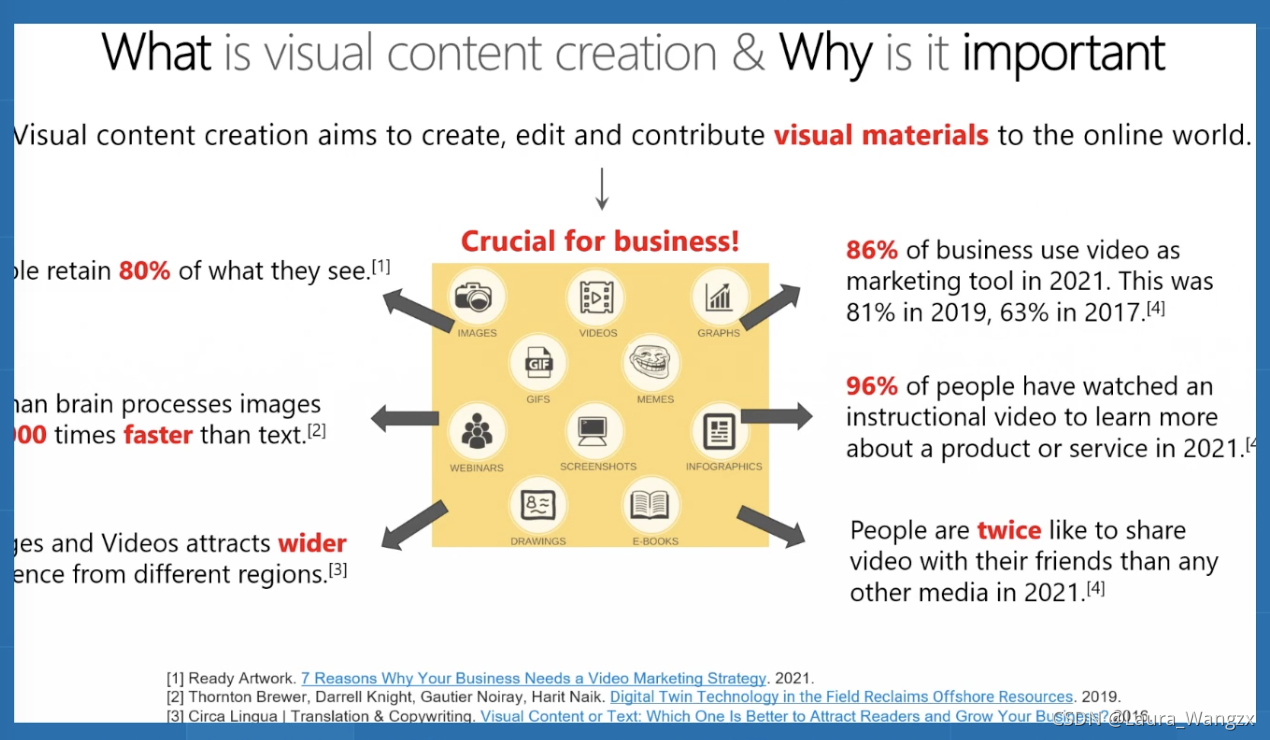

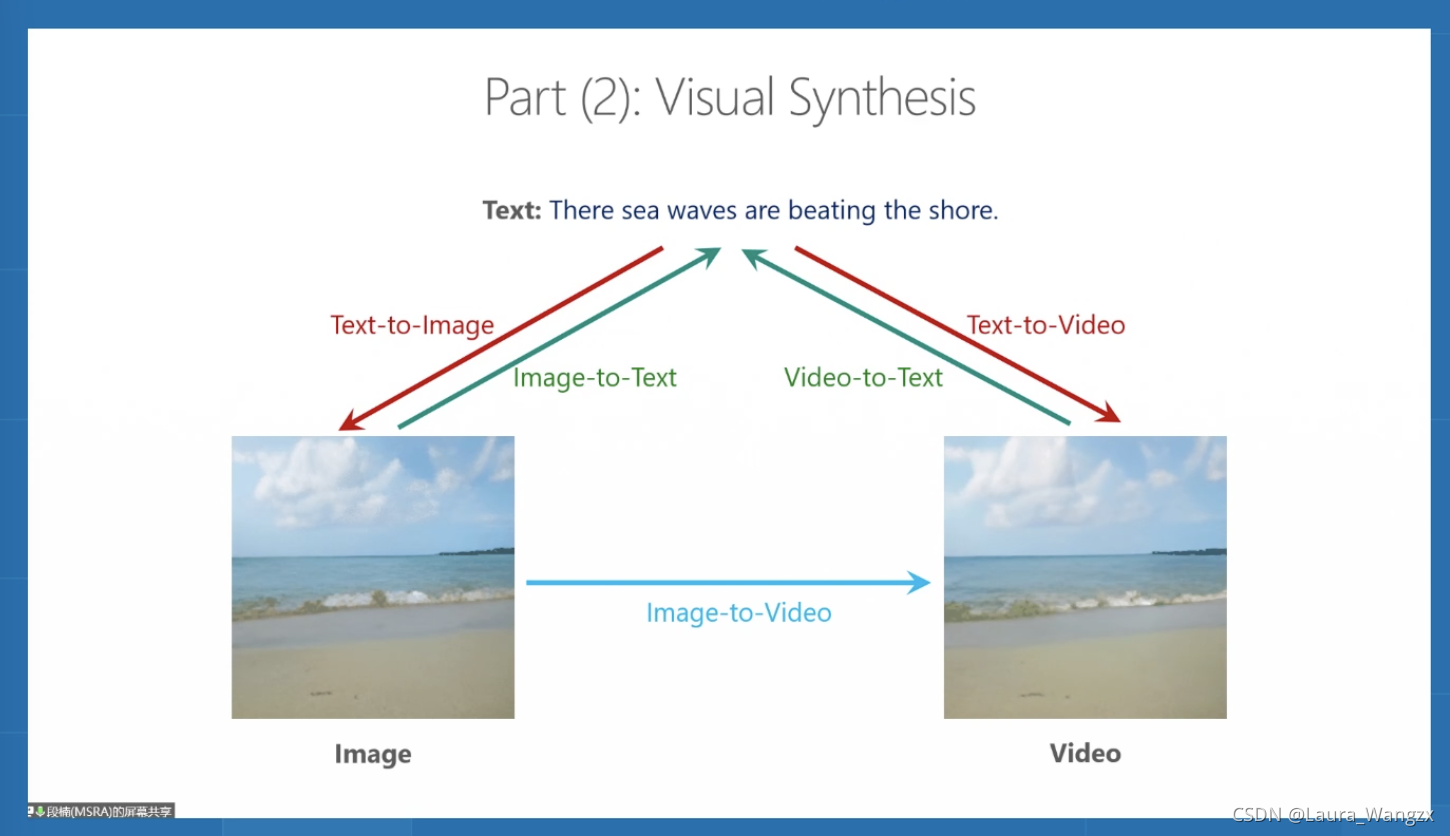

语义驱动可视化内容创造——段楠

视觉内容上的生成与创造。

生成一些没有见到的内容

spatial attention

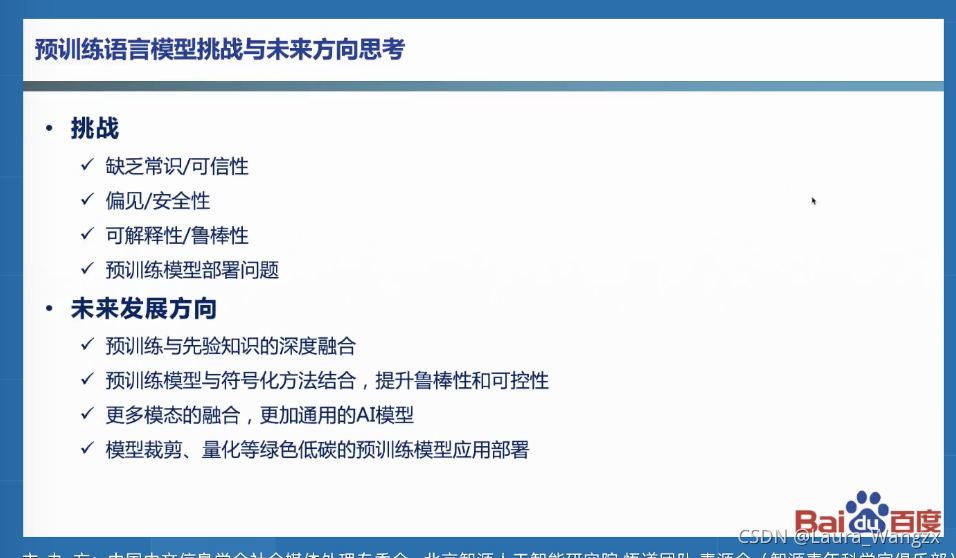

预训练数据不平衡//生成的视频/图片质量与输入文本相关性怎么克服//多模态人工智能(预训练模型、理解生成、可视化数据学习常识知识、可视化内容生成…)

Transformer引入到多模态领域,VQVAE//VQGAN改进,针对视觉的预训练模型。MAE

CogView-悟道文汇文图生成模型——丁铭

以文本生成图片

VQVAE——图像变离散字典上Token

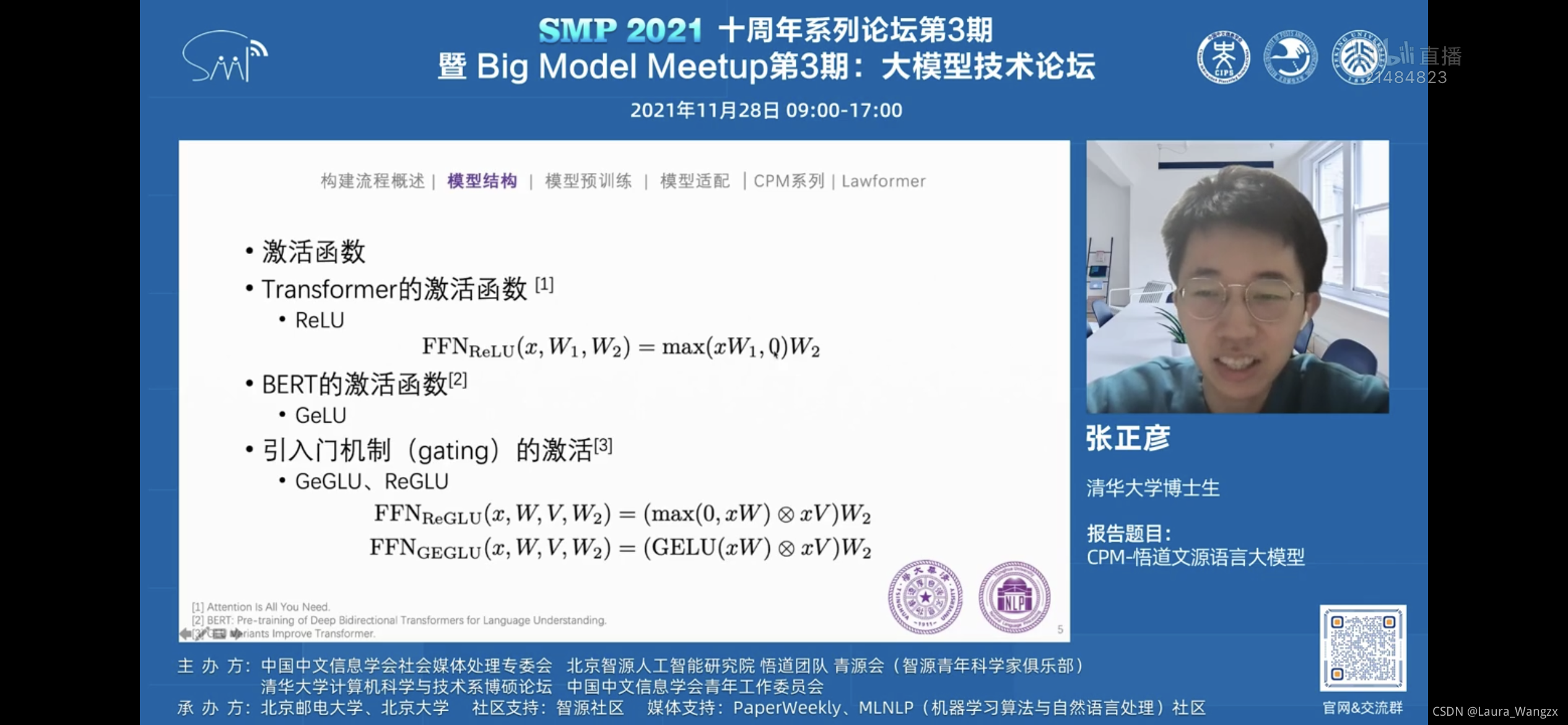

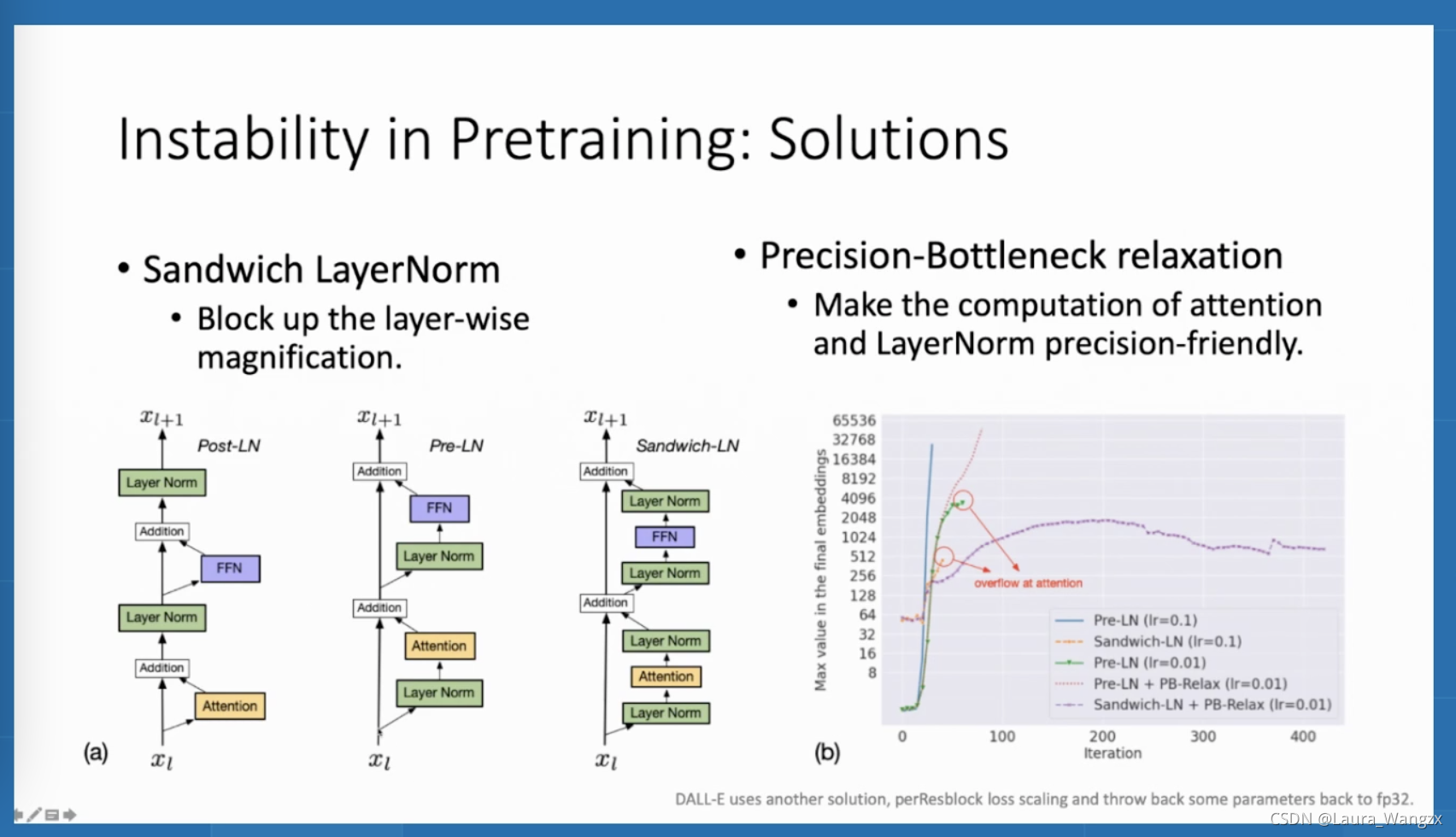

PreNorm——Sandwitch-LN

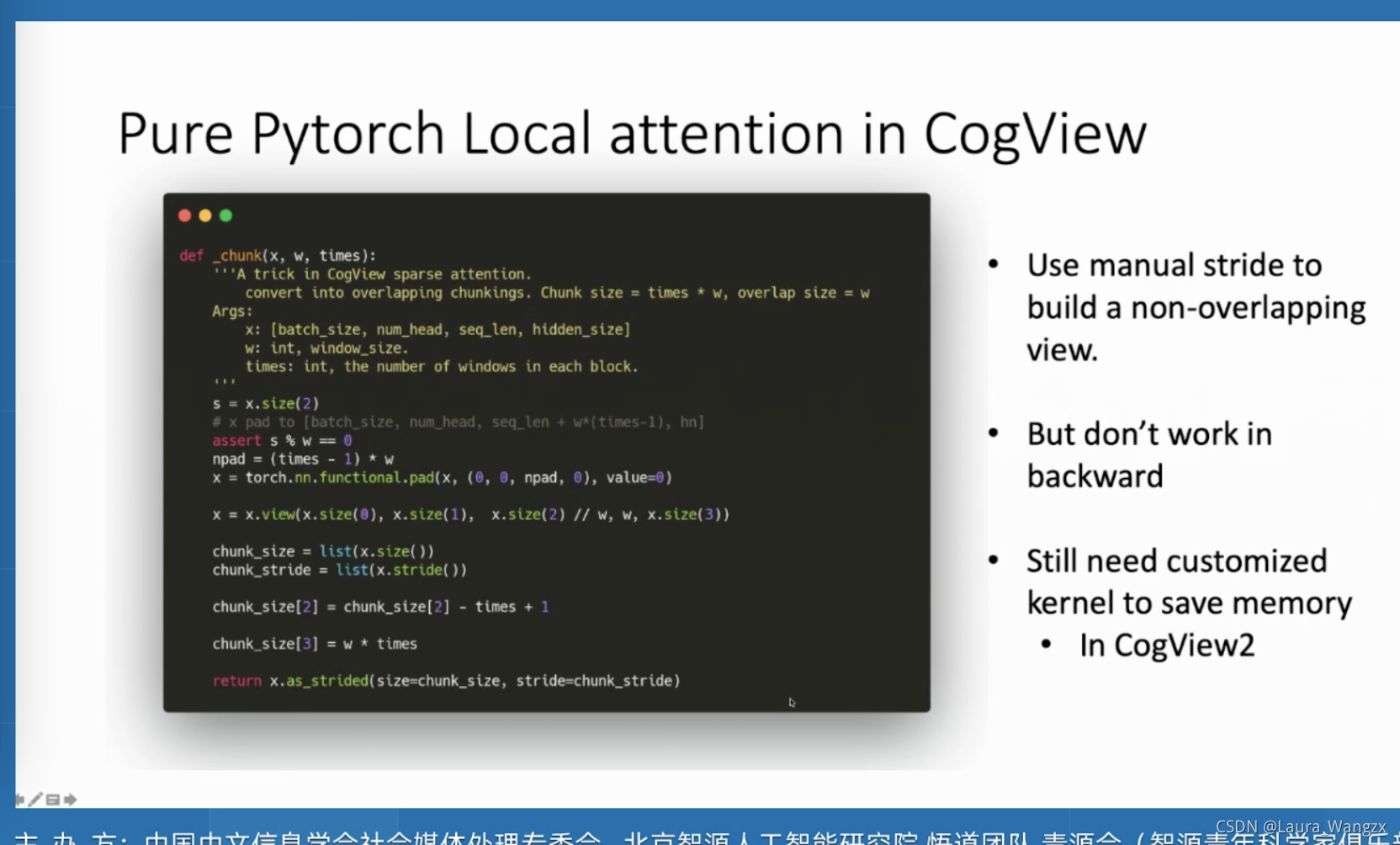

有重叠部分的Token

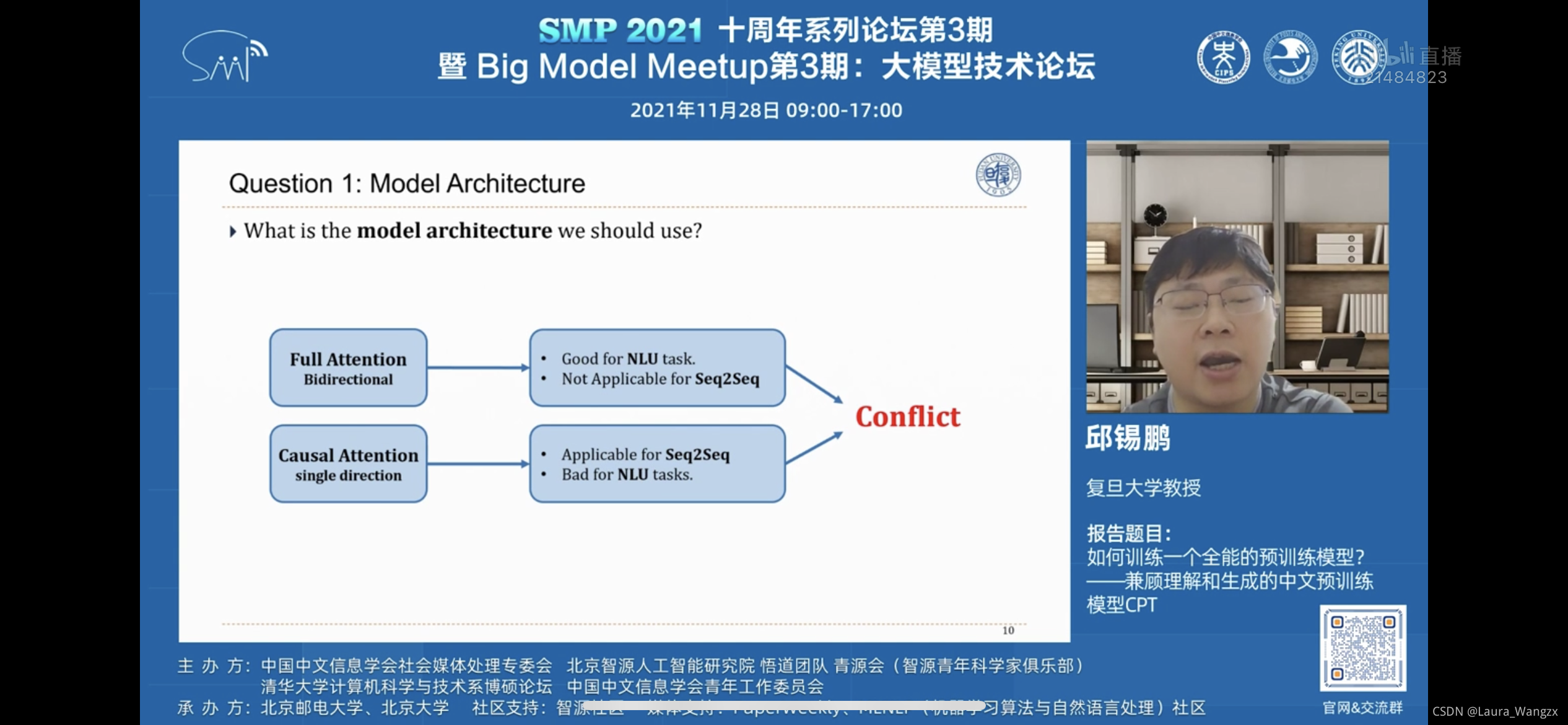

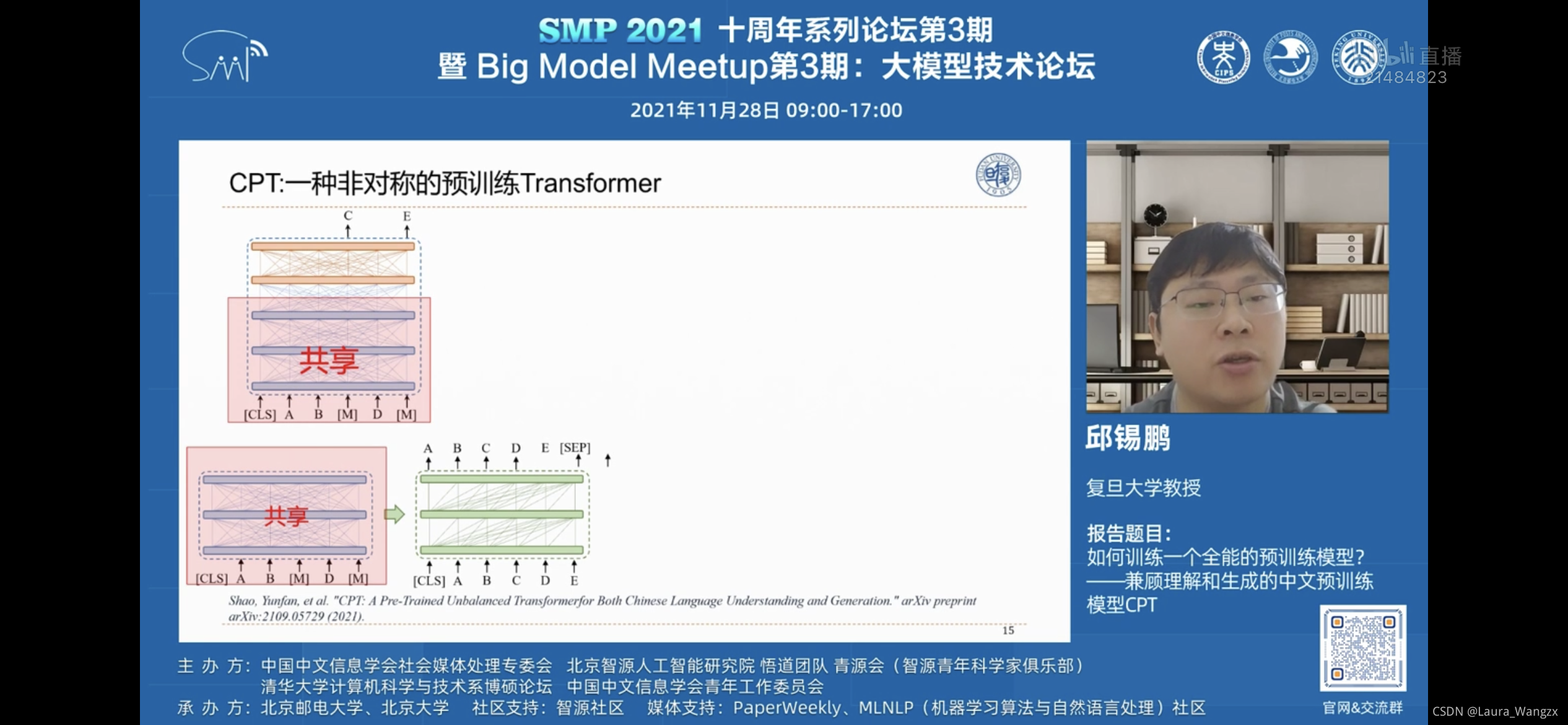

如何训练一个全能的预训练模型?兼顾理解和生成的中文预训练模型CPT——邱锡鹏

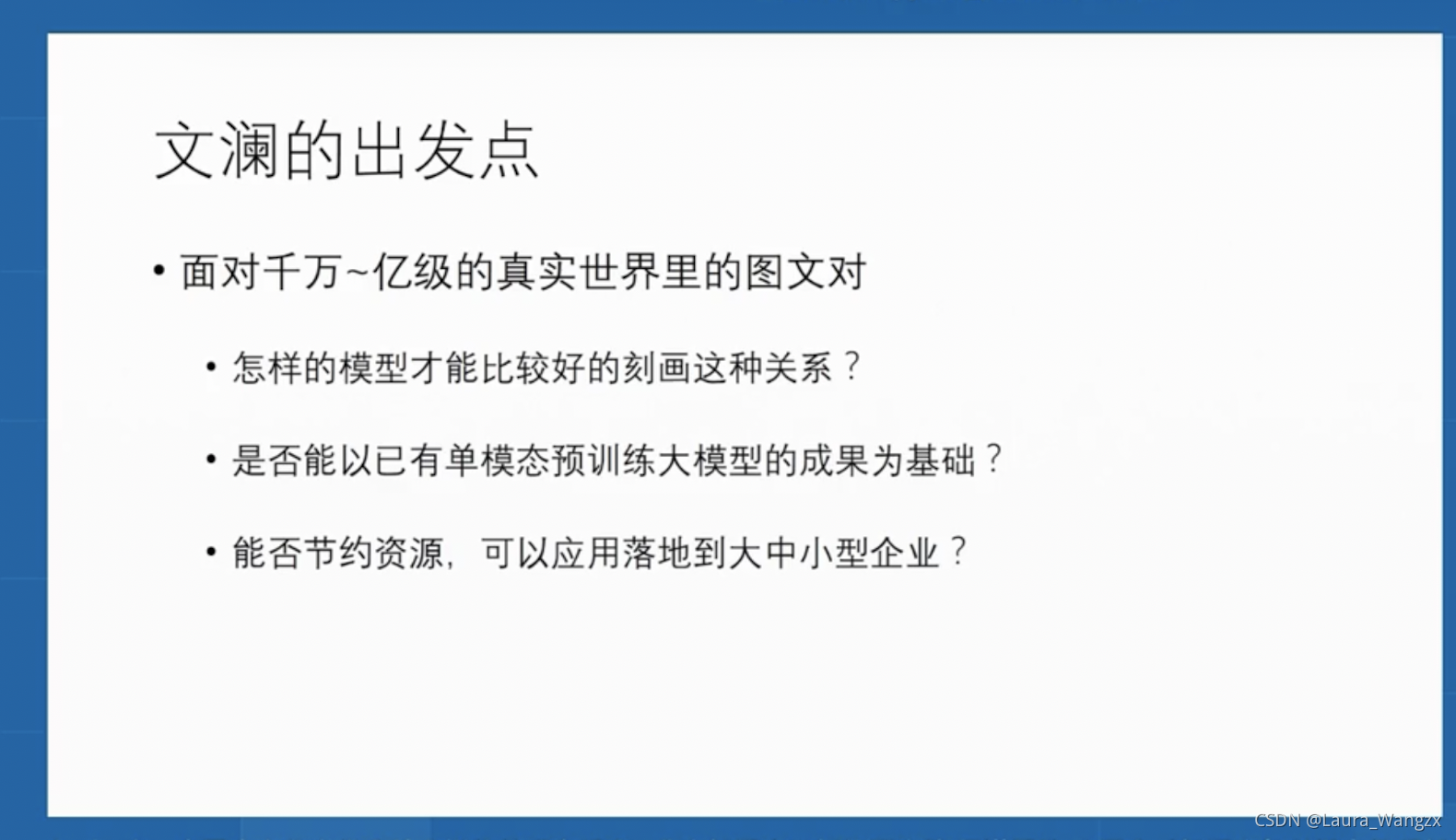

悟道文澜图文多模态大模型