Spark的Local模式及案例

基本概念

Spark的Local 模式,就是不需要其他任何节点资源就可以在本地执行Spark 代码的环境,一般用于教学,调试,演示等。

Local模式搭建

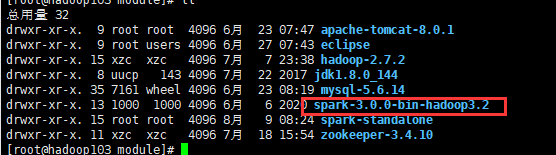

1. 解压缩文件

将 spark-3.0.0-bin-hadoop3.2.tgz 文件上传到Linux 并解压缩,放置在指定位置(路径中

不要包含中文或空格)

spark-3.0.0-bin-hadoop3.2.tgz 免费下载

解压文件

[root@hadoop103 software]# tar -zxvf spark-3.0.0-bin-hadoop3.2.tgz -C /opt/module/

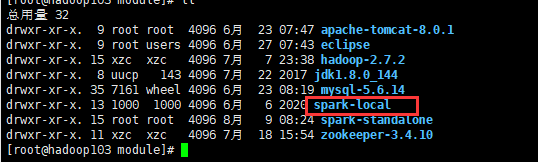

2.修改文件名

修改文件名为spark-local

[root@hadoop103 module]# mv spark-3.0.0-bin-hadoop3.2 spark-local

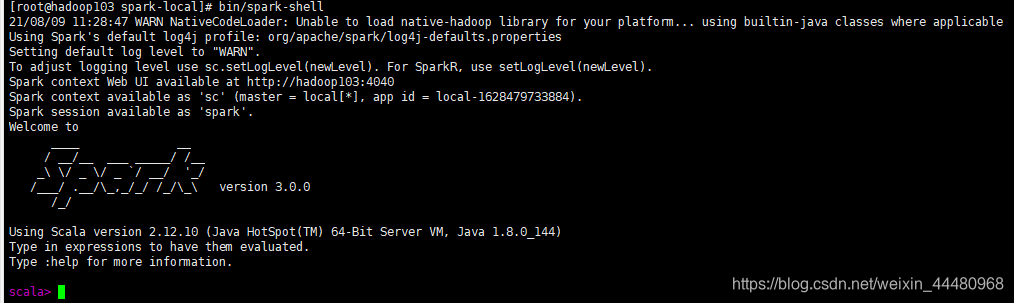

启动 Local 环境

1.进入解压缩后的路径,执行如下指令

[root@hadoop103 spark-local]# bin/spark-shell

成功截图

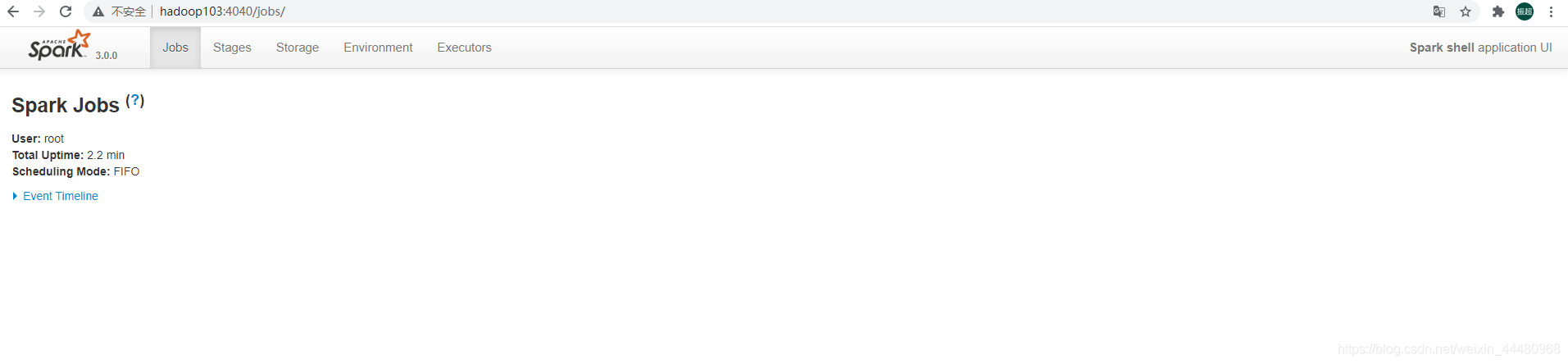

2. 启动成功后,可以输入网址进行 Web UI 监控页面访问

http://虚拟机地址:4040

扫描二维码关注公众号,回复:

13339359 查看本文章

WordCount案例

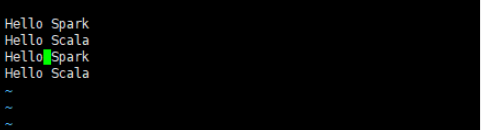

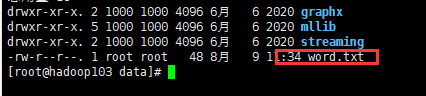

1.添加文件

在解压缩文件夹下的data 目录中,添加word.txt 文件

[root@hadoop103 data]# vim word.txt

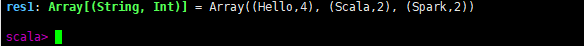

2.执行命令

命令行工具中执行如下代码指令

sc.textFile("data/word.txt").flatMap(_.split(" ")).map((_,1)).reduceByKey(_+_).collect

3.结果截图

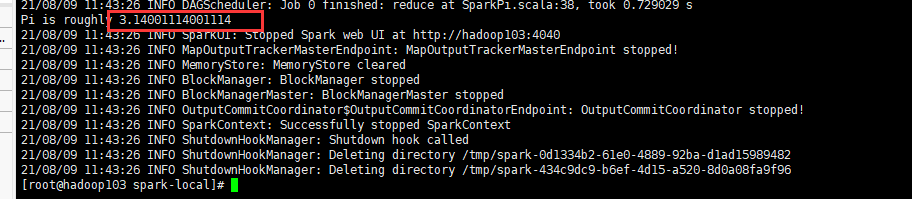

测试Spark中examples案例

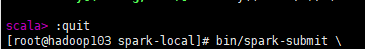

1.退出本地模式

按键Ctrl+C 或输入 Scala 指令

:quit

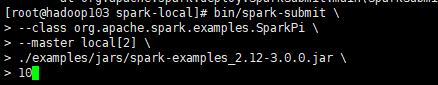

2.提交应用

bin/spark-submit \

--class org.apache.spark.examples.SparkPi \

--master local[2] \

./examples/jars/spark-examples_2.12-3.0.0.jar \

10

其中

(1) --class 表示要执行程序的主类,此处可以更换为咱们自己写的应用程序

(2) --master local[2] 部署模式,默认为本地模式,数字表示分配的虚拟CPU 核数量

(3) spark-examples_2.12-3.0.0.jar 运行的应用类所在的 jar 包

(4) 数字 10 表示程序的入口参数,用于设定当前应用的任务数量

3.结果截图