一、Cgroup简介

-

Cgroup 是Control Groups的缩写,是Linux 内核提供的一种可以限制、记录、隔离进程组所使用的物理资源(如CPU、 内存、磁盘IO等等)的机制,被LXC、docker等很多项目用于实现进程资源控制。

-

Cgroups提供了以下功能:

1、限制进程组可以使用的资源数量(Resource limiting )。比如:memory子系统可以为进程组设定一个memory使用上限,一旦进程组使用的内存达到限额再申请内存,就会触发OOM(out of memory)。

2、进程组的优先级控制(Prioritization )。比如:可以使用cpu子系统为某个进程组分配特定cpu share。

3、记录进程组使用的资源数量(Accounting )。比如:可以使用cpuacct子系统记录某个进程组使用的cpu时间

4、进程组隔离(Isolation)。比如:使用ns子系统可以使不同的进程组使用不同的namespace,以达到隔离的目的,不同的进程组有各自的进程、网络、文件系统挂载空间。

5、进程组控制(Control)。比如:使用freezer子系统可以将进程组挂起和恢复。

[root@master tls]# cat /proc/cgroups

#subsys_name hierarchy num_cgroups enabled

cpuset 4 1 1

cpu 6 85 1

cpuacct 6 85 1

memory 7 85 1

devices 10 85 1

freezer 9 1 1

net_cls 5 1 1

blkio 3 85 1

perf_event 8 1 1

hugetlb 11 1 1

pids 2 1 1

net_prio 5 1 1

cpuset:如果是多核心的CPU, 这个子系统会为cgroup 任务分配单独的CPU和内存。

CPU:使用调度程序为cgroup任务提供CPU的访问。

cpuacct:产生cgroup, 任务的CPU资源报告

memory: 设置每个cgroup 的内存限制以及产生内存资源报告。

devices:允许或拒绝cgroup任务对设备的访问。

freezer:暂停和恢复cgroup任务。

net_cls: 标记每个网络包以供cgroup 方便使用。

blkio:设置限制每个块设备的输入输出控制。例如:磁盘,光盘以及usb 等等。

ns:命名空间子系统。

perf_event: 增加了对每个group 的监测跟踪的能力,可以监测属于某个特定的group 的所有线程以及运行在特定CPU上的线程。

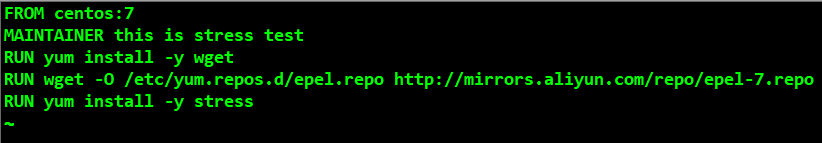

二、基于Dockerfile创建安装stress镜像

stress是用来测试cpu内存的负载,通过在两个容器分别执行stress -c 1,这将会给系统一个随机负载,产生一个进程,这个进程会反复不停地计算由rand()产生地随机数的平方根,直到资源耗尽。

首先使用Dockerfile创建一个基于centos的stress的工具镜像

[root@master tls]# mkdir /stress

[root@master tls]# cd /stress/

[root@master stress]# vi Dockerfile #文件内容在下图中

//安装镜像

[root@master stress]# docker build -t centos:stress .

[root@master stress]# docker images

REPOSITORY TAG IMAGE ID CREATED SIZE

centos stress d5b03b3a7589 2 minutes ago 466MB

nginx latest 602e111c06b6 2 days ago 127MB

centos 7 5e35e350aded 5 months ago 203MB

三、创建容器的CPU权重控制

-

默认情况下,每个docker容器的cpu份额都是1024,单独一个容器的份额是没有意义的,只有在同时运行多个容器时,容器cpu的加权效果才能体现出现。

-

例如,两个容器A、B的cpu份额分别为1000和500,在cpu进行时间片分配的时候,容器A比容器B多一倍的机会获得cpu的时间片,但是分配的结果取决于当时主机和其他容器的运行状态,实际上也无法保证容器A一定能够获得cpu的时间片。比如容器A的进程一直是空闲的,那么容器B是可以获取比容器A更多的cpu时间片的,极端情况下,例如主机上只运行的一个容器,即使它的cpu份额只有50,它也可以独占整个主机的cpu资源

-

cgroups只在容器分配的资源紧缺时,即需要对容器使用的资源进行限制时,才会生效。因此,无法单纯的根据某个容器的份额的cpu份额来确定有多少cpu资源分配给它,可以通过cpu share参数可以设置容器使用cpu的优先级,比如启动了两个容器及运行查看cpu的cpu的使用百分比

-

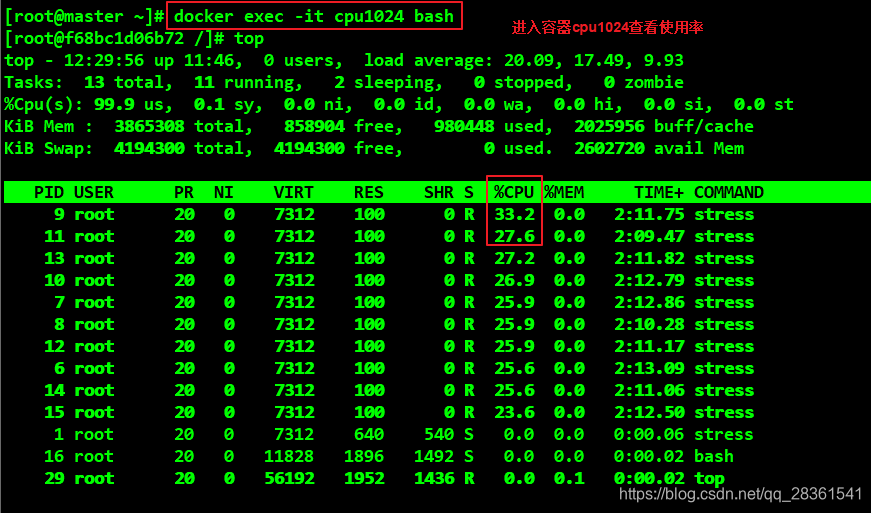

创建两个容器,分别制定不同的权重比

// --cpu-shares 指定使用cpu的权重

// stress -c 指定产生子进程的个数

[root@master ~]# docker run -itd --name cpu512 --cpu-shares 512 centos:stress stress -c 10

[root@master ~]# docker run -itd --name cpu1024 --cpu-shares 1024 centos:stress stress -c 10

[root@master ~]# docker ps -a #查看容器

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

f68bc1d06b72 centos:stress "stress -c 10" 10 seconds ago Up 8 seconds cpu1024

ab0e0020144b centos:stress "stress -c 10" 6 minutes ago Up 6 minutes cpu512

##进入容器使用top命令查看cpu的使用率

[root@master ~]# docker exec -it cpu512 bash

[root@ab0e0020144b /]# top

[root@master ~]# docker exec -it cpu1024 bash

[root@f68bc1d06b72 /]# top

分别进入cpu512和cpu1024之后可以看到,%cpu的比例差不多是1:2,符合我们设置的–cpu-shares参数。

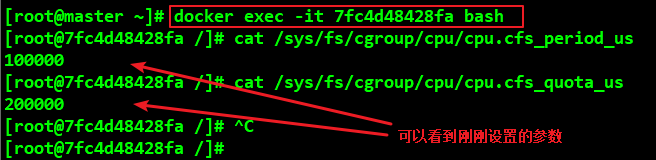

四、cpu周期限制

- Docker提供了 --cpu-period、–cpu-quota两个参数控制容器可以分配到cpu的时钟周期。

// --cpu-period是用来指定容器对于cpu的使用要在多长时间内重新分配一次

// --cpu-quota是用来指定在这个周期内,最多可以有多少时间跑这个容器,

与--cpu-shares(权重)不同的是,这种配置指定一个绝对值,容器对cpu资源使用绝对不会超过配置的值。

- cpu-peiod和cpu-quota参数一般联合使用。

- 例如:容器进程需要每一秒钟使用单个cpu的0.2时间,可以将 --cpu-period设置为1000000(1秒),–cpu-quota设置为200000(0.2秒)。

当然,在多核情况下,如果允许容器进程完全占用两个cpu,则可以将cpu-period设置为100000(0.1秒),cpu-quota设置为200000(0.2秒)

//设置 --cpu-period为0.1秒,--cpu-quota为0.2秒

[root@master ~]# docker run -itd --cpu-period 100000 --cpu-quota 200000 centos:stress

7fc4d48428fa3fc7527e7ece2f504307f13d83414e3714aa187d86356ba596d2

[root@master ~]# docker ps -a #查看容器ID号

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

7fc4d48428fa centos:stress "/bin/bash" 12 seconds ago Up 11 seconds priceless_bell

f68bc1d06b72 centos:stress "stress -c 10" 28 minutes ago Exited (137) 18 minutes ago cpu1024

ab0e0020144b centos:stress "stress -c 10" 35 minutes ago Exited (137) 18 minutes ago cpu512

[root@master ~]# docker exec -it 7fc4d48428fa bash #使用ID号进入容器

//查看容器cgroup参数

[root@7fc4d48428fa /]# cat /sys/fs/cgroup/cpu/cpu.cfs_period_us

100000

[root@7fc4d48428fa /]# cat /sys/fs/cgroup/cpu/cpu.cfs_quota_us

200000

五、cpu core控制

- 对于多核cpu的服务器,docker还可以控制容器运行使用那些cpu内核,以及使用–cpuset-cpus参数,这对于具有多cpu服务器尤其有用,可以对需要高性能计算的容器进行性能最优的配置。

//执行以下命令需要宿主机为双核,表示创建的容器只能使用0、1两个内核,最终生成cgroup的cpu内核配置如下:

[root@master ~]# docker run -itd --name cpu1 --cpuset-cpus 0-1 centos:stress

1c2e16cd9d63cf4e429b91cb41a357a91b03287234b9e123966e3871113d5ce2

[root@master ~]# docker ps -a

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

1c2e16cd9d63 centos:stress "/bin/bash" 9 seconds ago Up 9 seconds cpu1

[root@master ~]# docker exec -it cpu1 bash

[root@1c2e16cd9d63 /]# cat /sys/fs/cgroup/cpuset/cpuset.cpus

0-1

//通过下列指令可以看到容器中进程与cpu内核的绑定关系,达到绑定cpu内核的目的

[root@master ~]# docker exec -it 1c2e16cd9d63 taskset -c -p 1 #容器内部的第一个进程号pid为1,被绑定到指定到的cpu上运行

pid 1's current affinity list: 0,1

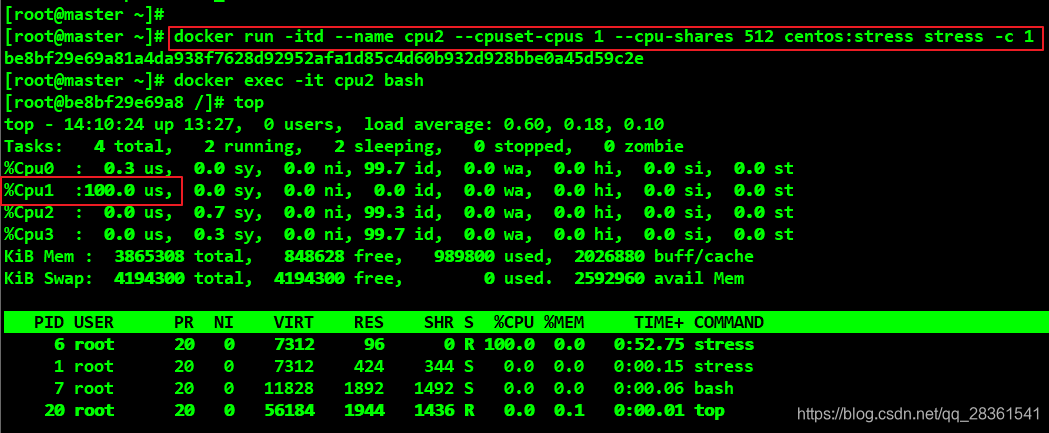

六、cpu配额控制参数的混合使用

- 通过cpuset-cpus参数指定容器A使用cpu内核0,容器B使用cpu内核1。

在主机上只有这个两个容器使用对应的cpu内核情况,它们各自占用全部的内核资源,cpu-shares没有明显的效果。 - cpuset-cpus、cpuset-mems参数只在多核、内存节点上服务器有效,并且必须与实际的物理配置匹配,否则也无法达到资源控制的目的。

- 在系统具有多个cpu内核的情况下,需要通过cpuset-cpus参数为设置容器cpu内核才能方便进行测试

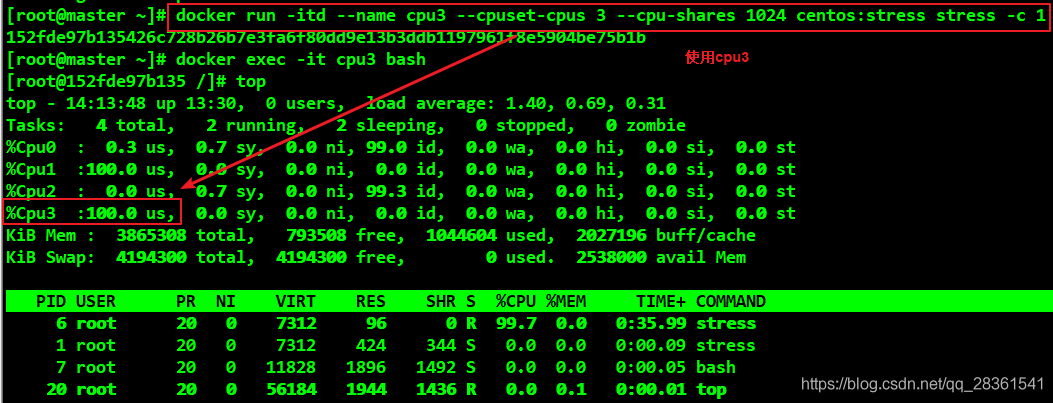

//宿主机系统修改为4核心

[root@master ~]# docker run -itd --name cpu2 --cpuset-cpus 1 --cpu-shares 512 centos:stress stress -c 1

[root@master ~]# docker run -itd --name cpu3 --cpuset-cpus 3 --cpu-shares 1024 centos:stress stress -c 1

##分别进入cpu2和cpu3查看cpu使用率,有下面数据可知,cpu1和3使用率达到了100%,权重对它们没有影响

[root@master ~]# docker exec -it cpu2 bash

[root@be8bf29e69a8 /]# top

[root@master ~]# docker exec -it cpu3 bash

[root@152fde97b135 /]# top

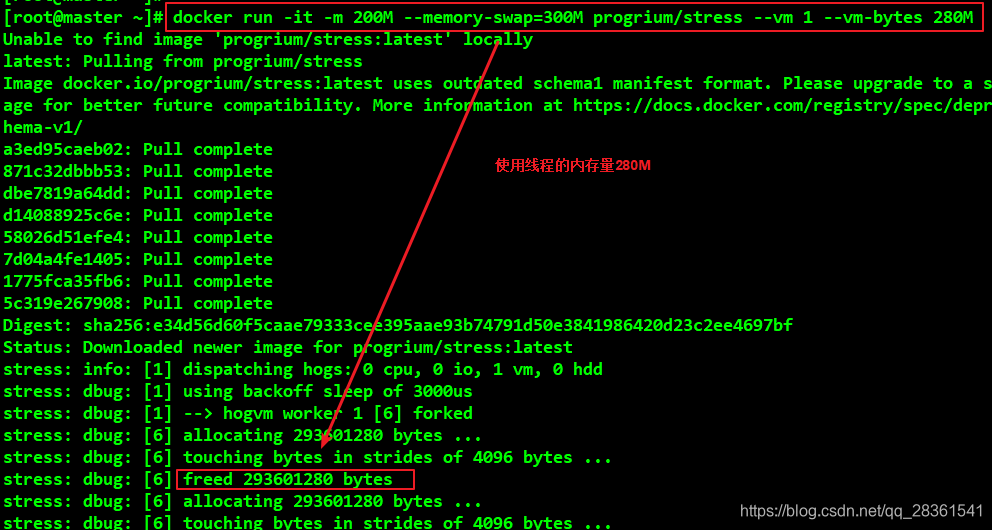

七、内存限制

-

与操作系统类似,容器可使用的内存包括两部分:物理内存和swap

容器通过 -m或–memory设置内存的使用限额,例如:-m 300M;通过–memory-swap设置内存+swap的使用限额 -

实例如下,允许容器最多使用200M的内存和300M的swap

[root@master ~]# docker run -it -m 200M --memory-swap=300M progrium/stress --vm 1 --vm-bytes 280M

// --vm 1 ,代表启动一个内存工作线程

// --vm-bytes 280 M ,代表每个线程可以分配280M内存

- 默认情况下,容器可以使用主机上的所有空闲内存。

上述配置与cpu的cgroup的配置类似,Docker会自动为容器目录/sys/fs/cgroup/memory/docker/<容器ID> 中创建相应的cgroup的配置文件

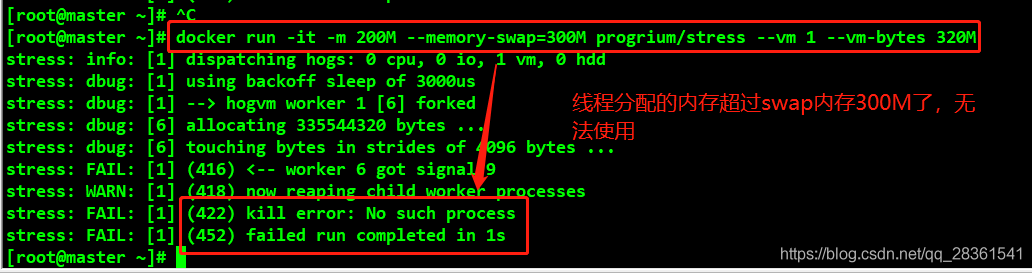

注:如果分配的内存超过限额,stress线程就会报错,容器会自动退出

八、Block IO的限制

默认情况下,所有容器能平等地读写磁盘,可以通过设置–blkio-weight参数来改变容器block IO的优先级。

//--blkio-weight 与--cpu-shares 类似,设置的是相对权重值,默认为500。

[root@master ~]# docker run -it --name container_A --blkio-weight 600 centos:stress #指定权重600

[root@c21c48529aed /]# cat /sys/fs/cgroup/blkio/blkio.weight

600

[root@c21c48529aed /]# exit

exit

[root@master ~]# docker run -it --name container_B --blkio-weight 300 centos:stress #指定权重值300

[root@a2a8cb6ddecc /]# cat /sys/fs/cgroup/blkio/blkio.weight

300

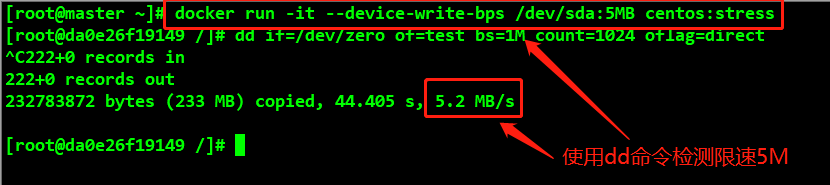

九、bps和iops 的限制

bps是byte per second,每秒读写的数据量。iops是io per second, 每秒IO的次数。

可通过以下参数控制容器的bps和iops:

--device-read-bps:限制读某个设备的bps.

--device-write-bps:限制写某个设备的bps.

--device-read-iops:限制读某个设备的iops.

--device-write-iops:限制写某个设备的iops。

下面的示例是限制容器写/dev/sda 的速率为5 MB/s

[root@master ~]# docker run -it --device-write-bps /dev/sda:5MB centos:stress

[root@da0e26f19149 /]# dd if=/dev/zero of=test bs=1M count=1024 oflag=direct

//按ctrl+c中断查看

通过dd命令测试在容器中写磁盘的速度。因为容器的文件系统是在host /dev/sda 上的,

在容器中写文件相当于对host /dev/sda进行写操作。另外,oflag=direct 指定用direct IO方式写文件,

这样–device-write-bps 才能生效。

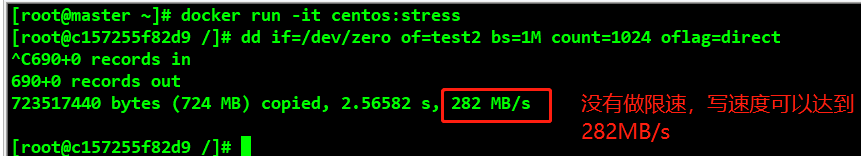

结果表明限速5MB/s 左右。作为对比测试,创建一个普通容器,没有做限速,查看其写速度。

[root@master ~]# docker run -it centos:stress

[root@c157255f82d9 /]# dd if=/dev/zero of=test2 bs=1M count=1024 oflag=direct

在多个容器运行时,必须使用上述的参数设置优化,不能把所有的资源给其中一个容器,会造成资源浪费,容器不稳定。