前言: 具体的命令和代码可以参照下面的网站,这里只写一些自己遇到的问题和学习完的总结。

具体命令和代码

一、Shell命令进行交互

-

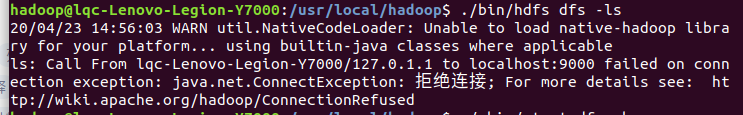

千万不要忘记打开的hadoop,不然就会出现这样的报错。打开命令:./sbin/start-dfs.sh

-

对目录进行操作:通过shell命令创建目录、查看目录、删除目录与hdfs进行交互。

-

对文件进行操作:两种操作,从本地传到HDFS文件和从HDFS下载到本地。

二、利用Web界面管理HDFS

**点击此链接http://localhost:50070/dfshealth.html#tab-overview** 注意:不同版本的hadoop端口号不同,我的是hadoop2.7.1,为50070,可以自行百度搜索。

三、利用Java API进行交互

- 导入jre包时,一定要返回最初的根目录的usr,不然在hadoop下的usr是没有local文件夹的。

- 编写一个程序并运行,判断文件是否存在的程序,过程中没有遇到什么问题,需要注意的就行代码的规范性。

- 应用程序部署,shell命令创建一个文件夹,export将写好的程序导出。