源码资料:

链接:https://pan.baidu.com/s/1D5TVoozk9Wen4gkng6nZ5g

提取码:wv6s

1. shell command调度

1.1 直接写命令

创建job描述文件

vi command.job

#command.job

type=command

command=echo 'hello'

将job资源文件打包成zip文件

zip command.job

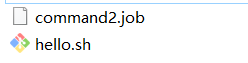

1.2 将shell脚本单独抽出来

command2.job:

#command.job

type=command

command=sh hello.sh

hellow.sh:

#!/bin/bash

date > /root/hello.txt

2. job依赖调度

创建有依赖关系的多个job描述

第一个job:foo.job

# foo.job

type=command

command=echo foo

第二个job:bar.job依赖foo.job

# bar.job

type=command

dependencies=foo

command=echo bar

这里的依赖关键字就是 :dependencies

将所有job资源文件打到一个zip包中,上传执行!!

3. HDFS任务调度

创建job描述文件

# fs.job

# fs.job

type=command

command=hdfs dfs -mkdir /azaz2

打为zip包,上传:

执行结果:

4. MAPREDUCE任务调度

mr任务依然可以使用command的job类型来执行

创建job描述文件,及mr程序jar包(示例中直接使用hadoop自带的example jar)

# mrwc.job

type=command

command=/export/servers/hadoop-2.7.5/bin/hadoop jar hadoop-mapreduce-examples-2.6.1.jar wordcount /wordcount/input /wordcount/azout

将所有job资源文件打到一个zip包中

5. HIVE脚本任务调度

创建job描述文件和hive脚本

Hive脚本: test.sql

use default;

drop table aztest;

create table aztest(id int,name string) row format delimited fields terminated by ',';

load data inpath '/aztest/hiveinput' into table aztest;

create table azres as select * from aztest;

insert overwrite directory '/aztest/hiveoutput' select count(1) from aztest;

Job描述文件:hivef.job

# hivef.job

type=command

command=/home/hadoop/apps/hive/bin/hive -f 'test.sql'

将所有job资源文件打到一个zip包中创建工程并上传zip包,启动job

6. 定时任务调度

除了手动立即执行工作流任务外,azkaban也支持配置定时任务调度。开启方式如下:

首页选择待处理的project