数据挖掘学习|task3 特征工程

其他

2020-04-04 16:15:33

阅读次数: 0

- 特征工程概述

“数据决定数据挖掘的上限,而算法只是尽可能逼近这个上限”,这里的数据就是指经过特征工程后得到的数据。那么,什么是特征工程呢?特征工程指的是把原始数据转变为后续模型需要的训练数据的过程,目的是获取更好的训练数据特征,使得机器学习模型更可能地逼近这个上限。可见,特征工程在数据挖掘中的重要性不言而喻,能使得模型的性能得到提升,有时甚至在简单的模型上也能取得不错的效果。

- 特征工程的内容

- 异常处理:通过箱线图(或 3-Sigma)分析、删除异常值;

BOX-COX 转换(处理有偏分布);长尾截断;

- 特征归一化/标准化:

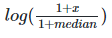

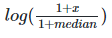

Z-Score标准化(转换为标准正态分布);min-max标准化(转换到 [0,1] 区间);针对幂律分布,可以采用公式:

- 数据分桶:包括等频分桶;等距分桶;Best-KS 分桶(类似利用基尼指数进行二分类);卡方分桶;

- 缺失值处理:不处理(针对类似 XGBoost 等树模型);删除(缺失数据太多);插值补全,包括均值/中位数/众数/建模预测/多重插补/压缩感知补全/矩阵补全等;分箱,缺失值一个箱;

- 特征构造:构造统计量特征,报告计数、求和、比例、标准差等;时间特征,包括相对时间和绝对时间,节假日,双休日等;地理信息,包括分箱,分布编码等方法;非线性变换,包括 log/ 平方/ 根号等;特征组合,特征交叉。

- 特征筛选

1.过滤式(filter):先对数据进行特征选择,然后在训练学习器,常见的方法有 Relief/方差选择发/相关系数法/卡方检验法/互信息法;

2.包裹式(wrapper):直接把最终将要使用的学习器的性能作为特征子集的评价准则,常见方法有 LVM(Las Vegas Wrapper) ;

3.嵌入式(embedding):结合过滤式和包裹式,学习器训练过程中自动进行了特征选择,常见的有 lasso 回归;

- 降维:PCA/ LDA/ ICA;特征选择也是一种降维。

发布了5 篇原创文章 ·

获赞 1 ·

访问量 56

转载自blog.csdn.net/weixin_39294199/article/details/105147330