Capítulo III: hadoop3.1.2 instalação win10

1, o ambiente de instalação

win10 64位

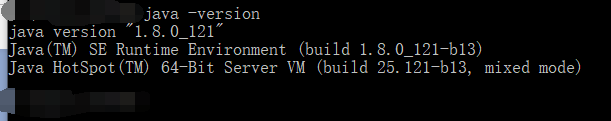

jdk1.8

hadoop3.1.2

2, a jdk1.8 instalação, e configurar as variáveis de ambiente

3, a configuração da instalação hadoop

3.1 Baixar

Hadoop O Hadoop para o site oficial para baixar a última versão do pacote de compressão, endereço de download: Hadoop3.1.2 , depois de diretório de descompressão da seguinte forma:

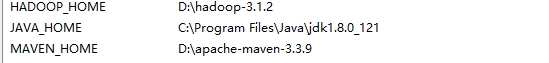

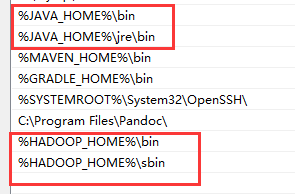

3,2, variável e descompactação ambiente configuração

Novas variáveis de ambiente HADOOP_HOME uma variável, o valor do caminho onde o arquivo está compactado para extrato hadoop

adicionado à variável PATH do sistema variável PATH HADOOP_HOME e no \ bin, a configuração é a seguinte:

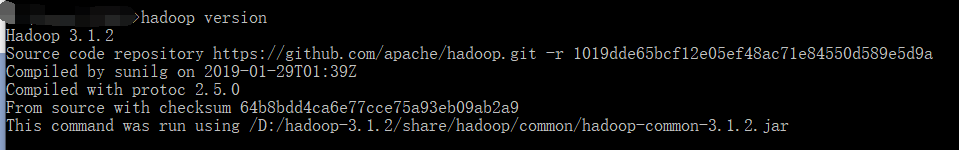

3.3, consulte a versão Hadoop

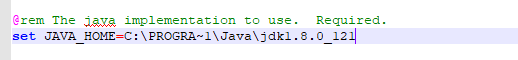

Use o bloco de notas para abrir etc \ hadoop \ hadoop-env.cmd, localize definir% linha JAVA_HOME =% JAVA_HOME, defina seu valor para o diretório jdk. Porque há um espaço em Arquivos de Programas, você precisa usar em vez de PROGRA ~ 1 Arquivos de programas, isto é, ler C: \ PROGRA ~ 1 \ Java \ jdk1.8.0_121

ver a versão Hadoop:

3.4, modificar o arquivo de configuração

No arquivo core-site.xml, adicione:

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://localhost:9000</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/D:/hadoop-3.1.2/data/tmp</value>

</property>

<property>

<name>fs.trash.interval</name>

<value>1440</value>

</property>

</configuration>

No arquivo-site.xml mapred, acrescentar:

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>

No arquivo de fio-site.xml, adicione:

<configuration>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.nodemanager.aux-services.mapreduce.shuffle.class</name>

<value>org.apache.hahoop.mapred.ShuffleHandler</value>

</property>

</configuration>

No arquivo hdfs-site.xml para acrescentar:

First in D: Criar uma pasta de dados sob /hadoop-3.1.2/ e criar namenode e DataNode duas subpastas na dados e, em seguida, modificar o arquivo hdfs-site.xml:

<configuration>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.permissions.enabled</name>

<value>false</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>/D:/hadoop-3.1.2/data/namenode</value>

</property>

<property>

<name>fs.checkpoint.dir</name>

<value>/D:/hadoop-3.1.2/data/snn</value>

</property>

<property>

<name>fs.checkpoint.edits.dir</name>

<value>/D:/hadoop-3.1.2/data/snn</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>/D:/hadoop-3.1.2/data/datanode</value>

</property>

</configuration>

3.5, substituir os arquivos no diretório bin

O padrão de download não Hadoop não suporta sistema Windows, você precisa substituir os arquivos no diretório bin facilmente executado em Windows. Encontrar a versão 3.1.0 winutils, um substituto direto depois de baixar arquivos fora do diretório bin pode Hadoop:

não winutils3.0 acima sussurro I

formato 3,6 namenode

Comando: hdfs namenode -format

Nota: Antes de iniciar pela primeira vez são realizadas apenas uma vez.

DESCRIÇÃO formatado com sucesso quando há a seguir:

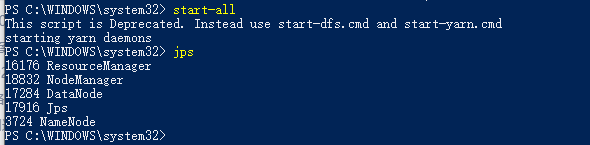

3.7, iniciar Hadoop (super administrador para executar cmd)

A D: \ hadoop-3.1.2 \ share \ \ fio \ timelineservice copiar esta pasta Hadoop O Hadoop-fio-server-timelineservice-3.1.2.jar este pacote para o caminho D: \ hadoop-3.1.2 \ share \ \ fio pode ser resolvido Hadoop.

3.8, consulte Gerenciamento de página

http: // localhost: 8088 / cluster

http: // localhost: 9870 / dfshealth.html # tab-overview