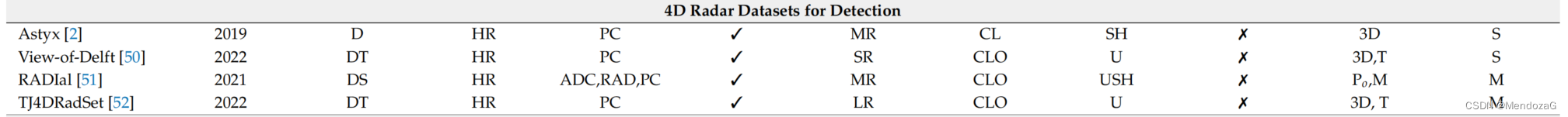

前回の記事では、Oculii 4D レーダーに関する 2 つのレポートを共有しました。データ セットは非常に重要な研究ツールです。4D レーダー分野では、研究の最前線にあります。公開されているデータ セットはほとんどありません。現在利用可能なデータ セットは次のとおりです:

これらの記事に掲載されているデータセットは多くのブロガーによって執筆されていますが、著者の原文を翻訳したものである場合が多く、実際の入手や利用については基本的に触れておりません。本記事ではこれらのデータセットについてより深く具体的に解説し、 give 入手方法、使い方、注意事項など。

目次

4. TJ4DRadSet (2022) は現在オープンソースではありません

更新ログ:

Tj4D データセットはすでに入手可能であり、相手方から取得するには機密保持契約に署名してメールボックスに送信する必要があります (処理は 2 月 7 日以降に開始されます)。-----2023.0207

1. Astyx データセット: 2019 年時点

翻訳:深層学習ベースの 3D 物体検出用の自動車レーダー データセット

記事には取得方法がwww.astyx.netと書いてあります(開いてみてもデータセットのエントリが見つかりませんでした)

現在の取得方法: https: //github.com/under-the-radar/radar_dataset_astyx

データセットは比較的小さいため、直接取得できます。

次に、このデータセットを簡単に紹介します。

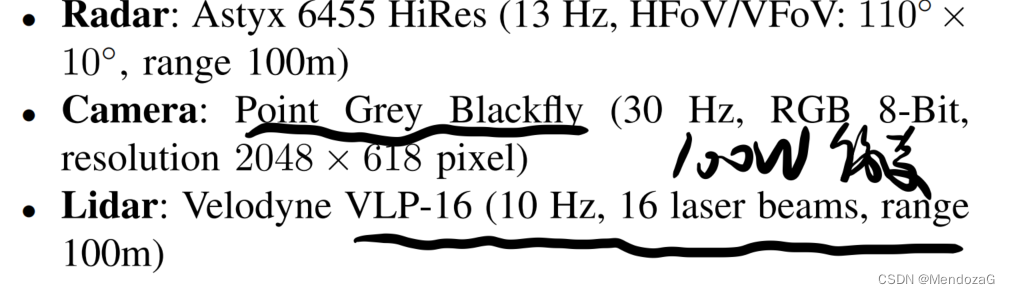

このデータセットを確立する著者の目的は、研究コミュニティに高解像度のレーダー データを提供し、レーダー センサー データを利用したアルゴリズムの研究を促進および促進することです。レーダーに注目するデータ セットはほとんどないため、現時点でレーダー データを含む自動操縦データ セットは nuScense データ セットのみですが、その中のレーダー データは 2D で非常にまばら (約 100) であり、点群はこのデータ セットは約 1000 ポイントに達します。このデータ セットの収集に使用される機器は次のとおりです。

現在、レーダーの性能は平均的で、測距範囲は 100 メートル、視野は 110*10 で、ライダーは Velodyne 16 ラインを使用し、カメラは 8 ビット 120W ピクセルのグレー ポイント カメラを使用します。

校正には古典的なチェッカーボードとコーナー反転方式が採用されており、内部パラメータの校正はオフラインで実行されます。外部パラメータの校正はペアで実行されます。

GT ボックスのラベリングでは、実際の物理座標を反映するライダーの精度が最も高く、カメラが非常に重要ですが、著者はここでレーザーの微調整、レーダーの微調整として捉えています。角解像度と LIDAR の検出 距離の制限により、遠距離のターゲットはセンサーの「共通表示エリア」に表示されない場合があります (これは、キティのドントケアに似ています)。カメラは共通ビューを見ることができ、それらは とマークされます。以下に示すように:

同時に、目に見えないものにもラベルが付けられます。これは、それらの物理的オブジェクトには LIDAR やカメラの測定値がないものの、レーダー データでは明確に表示され (たとえば、他の車の下を伝播するマルチパス反射を通じて)、関連付けることができることを意味します。時間参照による Up - データロギング中の前後に表示されます。(これは、存在するがカメラや LIDAR では捕捉できないが、いくつかの方法によりレーダーで発見できるオブジェクトにもマークが付けられることを意味します)。

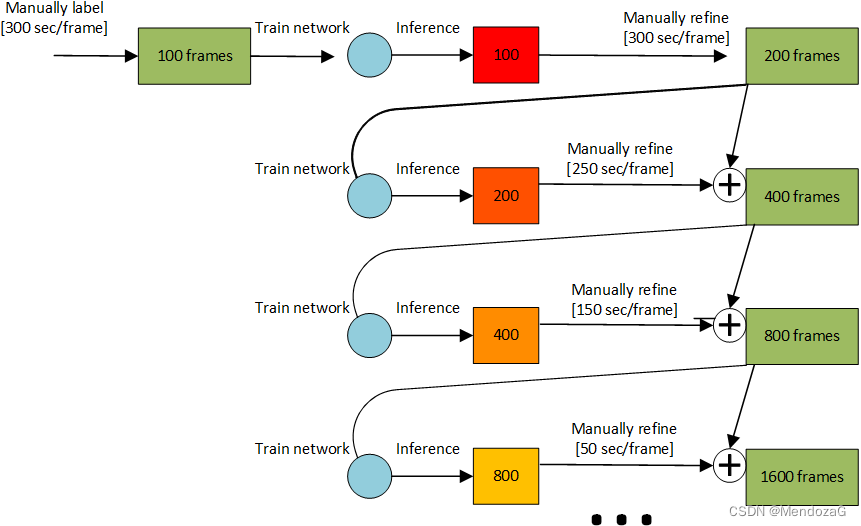

著者らは、自動的に事前にラベル付けされた N フレームのデータから、ネットワークの意思決定に関して最も不確実なデータを抽出し、これらのデータを手動の微調整によって修正して、次のトレーニング ラウンドでのネットワークの情報利得を最大化します。そしてプレラベルラウンド。(自動ラベル付け + 手動)

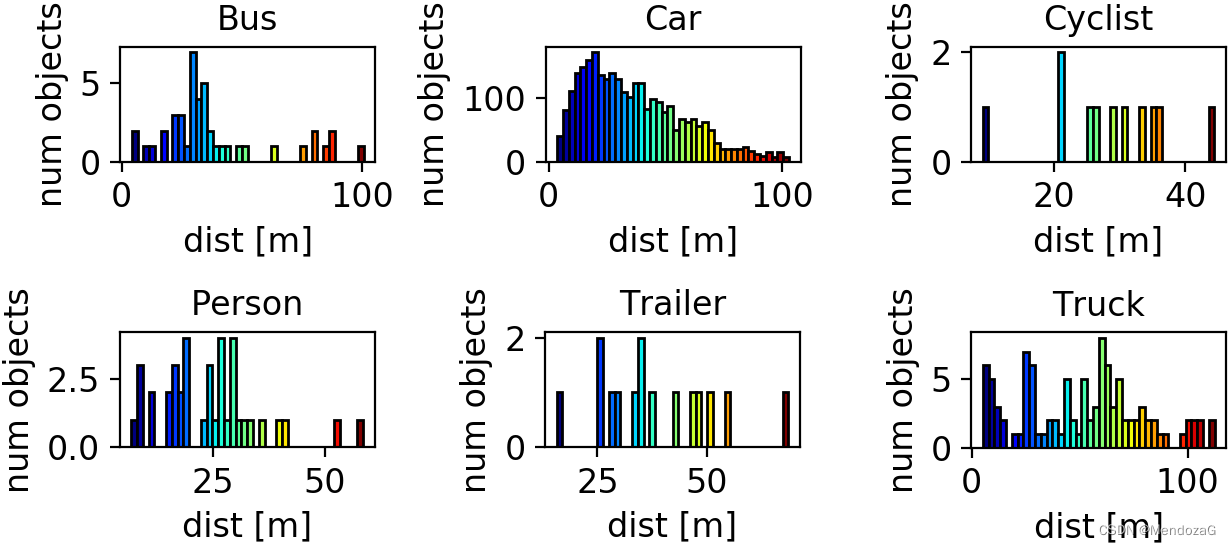

このデータセットは、バス、車、自転車、オートバイ、人物、トレーラー、トラックの 合計 7 つのカテゴリを提供します。

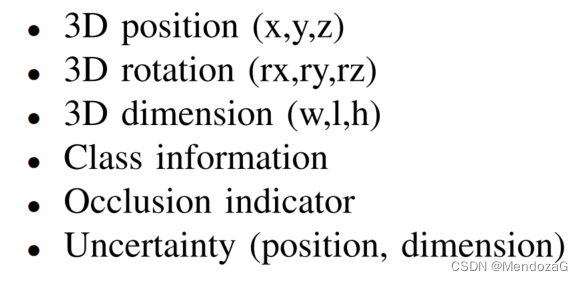

注釈が付けられたターゲット属性は次のとおりです。

アノテーションの保存形式はtxtです。

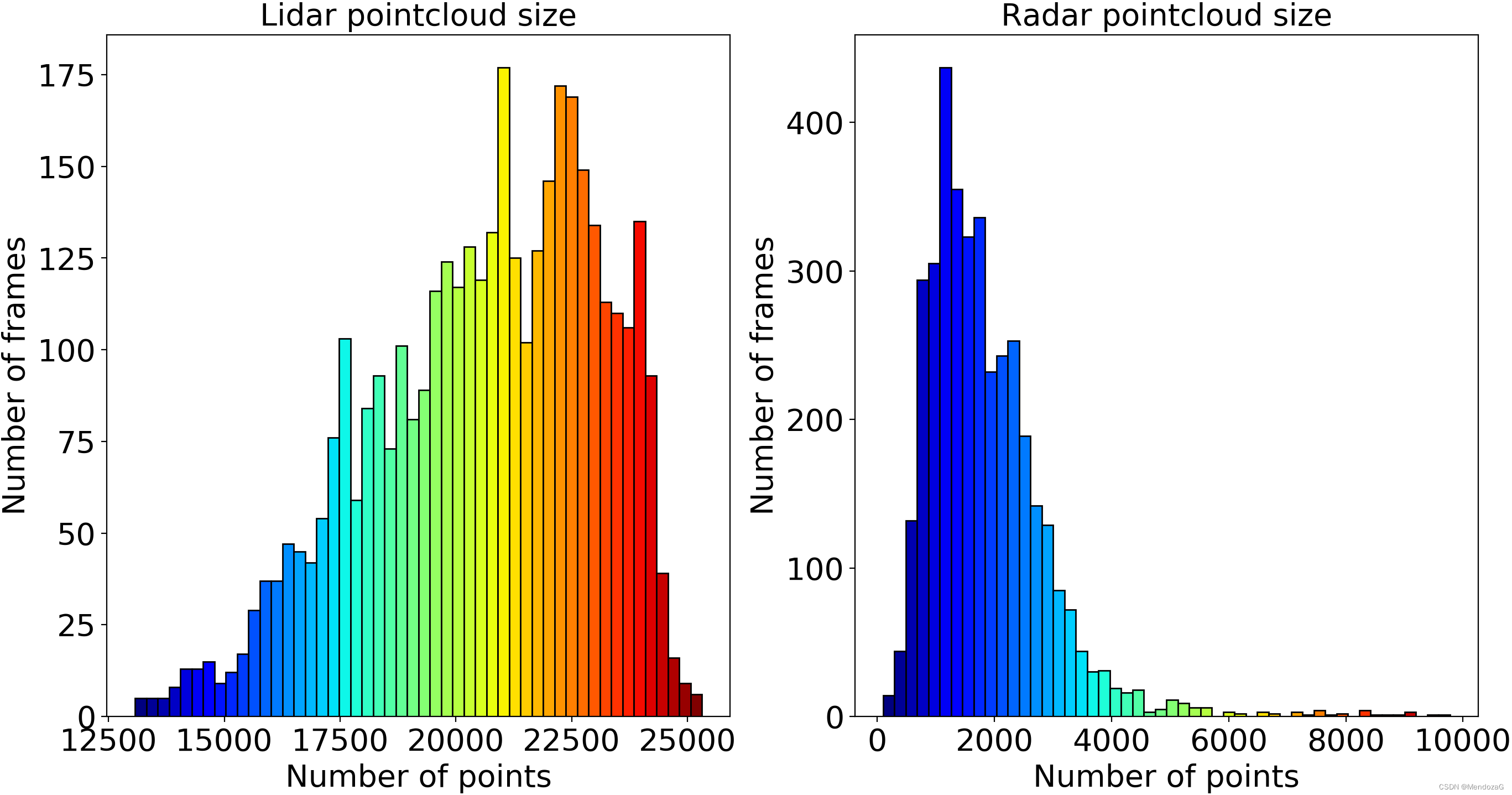

ターゲットの LIDAR とレーダーのポイント分布: (複数のターゲットとサイズに異なるフレームが対応します)

データ配布:

右の写真を見ると、3 台の車のフレームが最も大きいことがわかります。シーンも比較的シンプルです。

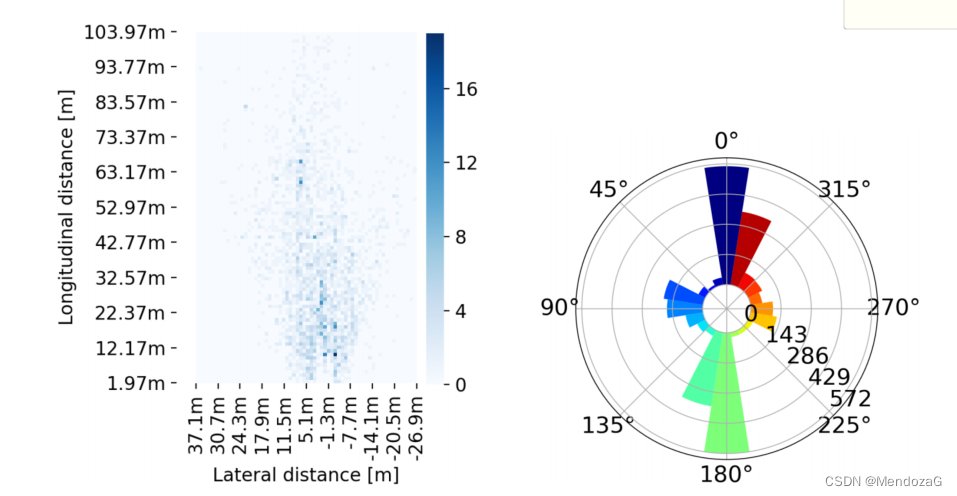

車の方向分布:

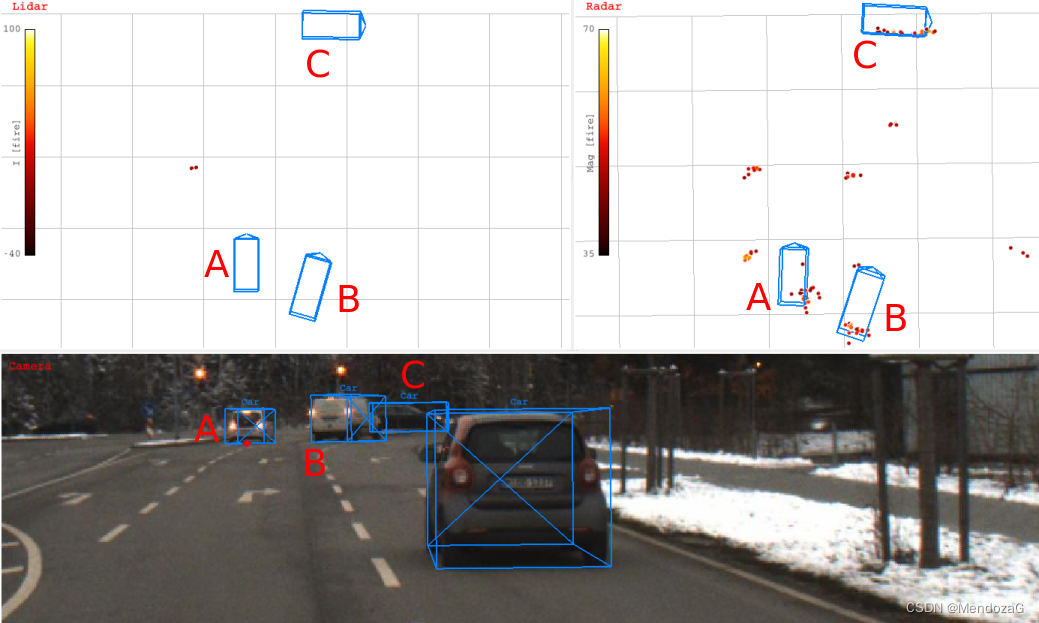

下の図からわかるように、AB 車両と AB 車両には LIDAR が見えなくなり、画像とレーダー点群によると、方向によって LIDAR が区別されます。

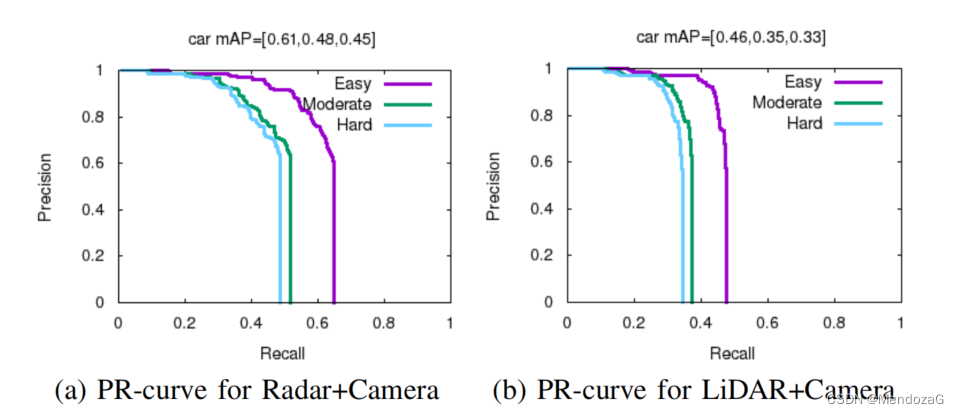

評価 (どのネットワークが使用されるかについては言及なし): 4:1 の比率を使用してデータセットをトレーニング データとテスト データにランダムに分割し、2 つのネットワーク (レーダー カメラとライダー カメラ) を 22,000 回の反復でトレーニングし、16 のミニバッチと分類、位置特定、結果の位置特定精度は、IoU しきい値 0.5 を使用して評価されます。

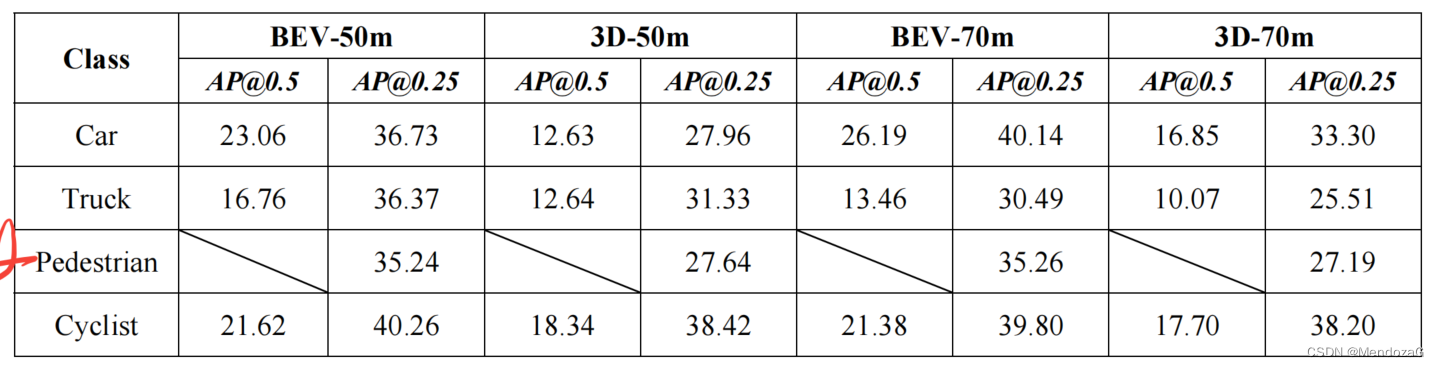

評価結果:

自動車の場合、レーダー + カメラの結果は、ライダー + カメラの結果よりもさらに優れています。

データセットを見ると、データセットが非常に小さく、短いクリップの注釈付きフレームが 546 個しかなく、各クリップに含まれるフレームが 10 未満であることがわかります。

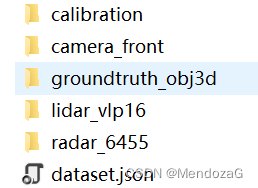

全体的な構造は次のとおりです。

カメラのデータ形式はjpg、ライダーのデータ形式はtxtで、6次元の情報(xyz、反射率、レーザーヘッドとタイムスタンプ)が含まれ、レーダーデータもtxtで与えられ、5次元の情報が含まれます。 (xyz、speed、mag (強度である必要があります)) さらに、各フレームを変換するためのキャリブレーション情報が json 形式で与えられます。GT アノテーションも json 形式を使用します。コンテンツの例は次のとおりです。

{

"frame_flag": "",

"frame_index": 0,

"header": "Astyx Version_01_00",

"objects": [

{

"center3d": [

15.28,

4.24,

-0.46

],

"classname": "Car",

"created_by": "g.kuschk",

"dimension3d": [

3.66,

1.8,

1.45

],

"label_certainty": 2,

"measured_by": {

"Camera": 1,

"Lidar": 1,

"Radar": 1

},

"object_id": -1,

"occlusion": 1,

"orientation_quat": [

0.7020386802113796,

-0.03287019905010674,

0.005682565197980395,

0.711357118439284

],

"score": -1.0

},

{

"center3d": [

57.75593697820277,

-8.95030337350099,

1.7819997024076009

],

"classname": "Car",

"created_by": "g.kuschk",

"dimension3d": [

4.34,

1.81,

1.5098232605535091

],

"label_certainty": 0,

"measured_by": {

"Camera": 1,

"Lidar": 1,

"Radar": 1

},

"object_id": -1,

"occlusion": 0,

"orientation_quat": [

0.7194398517786975,

-0.03301020608906757,

0.0048577576720212606,

0.6937528581252859

],

"score": -1.0

},

{

"center3d": [

11.73,

4.59,

-0.64

],

"classname": "Car",

"created_by": "g.kuschk",

"dimension3d": [

4.15,

1.8,

1.45

],

"label_certainty": 2,

"measured_by": {

"Camera": 1,

"Lidar": 1,

"Radar": 1

},

"object_id": -1,

"occlusion": 1,

"orientation_quat": [

0.7058035625491359,

-0.03289943574160317,

0.005508833819764444,

0.7076217993891781

],

"score": -1.0

},

{

"center3d": [

9.145197640200534,

5.274276650959328,

-0.7580683445170724

],

"classname": "Car",

"created_by": "g.kuschk",

"dimension3d": [

3.77,

1.8,

1.45

],

"label_certainty": 1,

"measured_by": {

"Camera": 1,

"Lidar": 1,

"Radar": 1

},

"object_id": -1,

"occlusion": 1,

"orientation_quat": [

0.7199364568101033,

-0.03300232389003559,

0.004846831272768512,

0.6932379483266801

],

"score": -1.0

},

{

"center3d": [

6.479817221419508,

5.247589043270934,

-0.9141820375574657

],

"classname": "Car",

"created_by": "g.kuschk",

"dimension3d": [

4.48395807023072,

1.8,

1.45

],

"label_certainty": 1,

"measured_by": {

"Camera": 1,

"Lidar": 1,

"Radar": 1

},

"object_id": -1,

"occlusion": 1,

"orientation_quat": [

0.6898415239772513,

-0.004692602780714069,

-0.033023180724797714,

-0.72319162108718

],

"score": -1.0

},

{

"center3d": [

9.994624230481369,

-6.017542527527623,

-0.1464149366341636

],

"classname": "Car",

"created_by": "g.kuschk",

"dimension3d": [

3.77,

1.8,

1.3121440590076265

],

"label_certainty": 1,

"measured_by": {

"Camera": 1,

"Lidar": 1,

"Radar": 1

},

"object_id": -1,

"occlusion": 1,

"orientation_quat": [

0.7130302072899429,

-0.03295292607233075,

0.005173472708666147,

0.7003393915348938

],

"score": -1.0

},

{

"center3d": [

13.167237991660787,

-6.162813630332312,

-0.04708915908300637

],

"classname": "Car",

"created_by": "g.kuschk",

"dimension3d": [

3.9561293466010117,

1.8,

1.3121440590076265

],

"label_certainty": 1,

"measured_by": {

"Camera": 1,

"Lidar": 1,

"Radar": 1

},

"object_id": -1,

"occlusion": 1,

"orientation_quat": [

0.6950121632719635,

-0.004933161718357779,

-0.03298636965611393,

-0.7182239596646692

],

"score": -1.0

},

{

"center3d": [

18.42,

-6.81,

0.14

],

"classname": "Car",

"created_by": "g.kuschk",

"dimension3d": [

3.96,

1.8,

1.31

],

"label_certainty": 2,

"measured_by": {

"Camera": 1,

"Lidar": 1,

"Radar": 1

},

"object_id": -1,

"occlusion": 1,

"orientation_quat": [

0.7151992798301935,

-0.03296572963883116,

0.005076129151335868,

0.6981242609396919

],

"score": -1.0

},

{

"center3d": [

20.97984695193026,

-6.536436330155294,

0.23764169100863264

],

"classname": "Car",

"created_by": "g.kuschk",

"dimension3d": [

3.96,

1.8,

1.37

],

"label_certainty": 2,

"measured_by": {

"Camera": 1,

"Lidar": 1,

"Radar": 1

},

"object_id": -1,

"occlusion": 1,

"orientation_quat": [

0.7151992798301935,

-0.032965729638831244,

0.005076129151335691,

0.6981242609396919

],

"score": -1.0

},

{

"center3d": [

25.99999984503129,

-6.413659054009911,

0.3289432028830479

],

"classname": "Car",

"created_by": "g.kuschk",

"dimension3d": [

3.96,

1.8,

1.37

],

"label_certainty": 2,

"measured_by": {

"Camera": 1,

"Lidar": 1,

"Radar": 1

},

"object_id": -1,

"occlusion": 1,

"orientation_quat": [

-0.7068649813345358,

0.03289508407018742,

-0.005475805274628736,

-0.7065619768736047

],

"score": -1.0

},

{

"center3d": [

28.57,

-6.72,

0.47

],

"classname": "Car",

"created_by": "g.kuschk",

"dimension3d": [

3.96,

1.8,

1.41

],

"label_certainty": 2,

"measured_by": {

"Camera": 1,

"Lidar": 1,

"Radar": 1

},

"object_id": -1,

"occlusion": 1,

"orientation_quat": [

-0.7071073056108934,

0.005505677989137722,

0.03288670936708505,

0.7063196232645582

],

"score": -1.0

},

{

"center3d": [

17.9417990603285,

4.047919592487037,

-0.4298381193087091

],

"classname": "Car",

"created_by": "g.kuschk",

"dimension3d": [

3.66,

1.8,

1.4034827588118874

],

"label_certainty": 2,

"measured_by": {

"Camera": 1,

"Lidar": 1,

"Radar": 1

},

"object_id": -1,

"occlusion": 1,

"orientation_quat": [

0.7061942370819255,

-0.005447702826512753,

-0.03290636115848807,

-0.7072320647718813

],

"score": -1.0

},

{

"center3d": [

20.45,

4.51,

-0.31

],

"classname": "Car",

"created_by": "g.kuschk",

"dimension3d": [

4.18,

2.0,

1.5

],

"label_certainty": 2,

"measured_by": {

"Camera": 1,

"Lidar": 1,

"Radar": 1

},

"object_id": -1,

"occlusion": 1,

"orientation_quat": [

0.7072691145493584,

-0.032907514186323296,

0.005445972583162032,

0.706157090523962

],

"score": -1.0

},

{

"center3d": [

24.182930691745177,

3.957377988250483,

-0.21057144426054156

],

"classname": "Car",

"created_by": "g.kuschk",

"dimension3d": [

3.9935178142256045,

1.8765534659735825,

1.3706025545077207

],

"label_certainty": 2,

"measured_by": {

"Camera": 1,

"Lidar": 1,

"Radar": 1

},

"object_id": -1,

"occlusion": 1,

"orientation_quat": [

0.7072691145493584,

-0.032907514186323296,

0.005445972583162032,

0.706157090523962

],

"score": -1.0

},

{

"center3d": [

26.56403718760992,

3.4141810443770053,

-0.07728835626150013

],

"classname": "Car",

"created_by": "g.kuschk",

"dimension3d": [

3.99,

1.88,

1.37

],

"label_certainty": 2,

"measured_by": {

"Camera": 1,

"Lidar": 1,

"Radar": 1

},

"object_id": -1,

"occlusion": 1,

"orientation_quat": [

0.7072691145493584,

-0.032907514186323296,

0.005445972583162032,

0.706157090523962

],

"score": -1.0

},

{

"center3d": [

28.9087287526382,

2.7749496885068696,

0.061472400426277635

],

"classname": "Car",

"created_by": "g.kuschk",

"dimension3d": [

3.99,

1.88,

1.37

],

"label_certainty": 2,

"measured_by": {

"Camera": 1,

"Lidar": 1,

"Radar": 1

},

"object_id": -1,

"occlusion": 1,

"orientation_quat": [

0.7072691145493584,

-0.032907514186323296,

0.005445972583162032,

0.706157090523962

],

"score": -1.0

},

{

"center3d": [

31.80376110462618,

2.413184128432301,

0.20248894322203623

],

"classname": "Car",

"created_by": "g.kuschk",

"dimension3d": [

4.025175213620685,

1.9424920472975067,

1.37

],

"label_certainty": 2,

"measured_by": {

"Camera": 1,

"Lidar": 1,

"Radar": 1

},

"object_id": -1,

"occlusion": 1,

"orientation_quat": [

0.7072691145493584,

-0.032907514186323296,

0.005445972583162032,

0.706157090523962

],

"score": -1.0

},

{

"center3d": [

69.01,

0.68,

1.73

],

"classname": "Car",

"created_by": "g.kuschk",

"dimension3d": [

4.39,

1.83,

1.62

],

"label_certainty": 2,

"measured_by": {

"Camera": 1,

"Lidar": 1,

"Radar": 1

},

"object_id": -1,

"occlusion": 1,

"orientation_quat": [

-0.7174576529992662,

0.03299615793779559,

-0.0049519706657062896,

-0.695802592479113

],

"score": -1.0

},

{

"center3d": [

42.98202899707613,

-7.929520596676596,

0.993298589588324

],

"classname": "Car",

"created_by": "g.kuschk",

"dimension3d": [

3.7507295994605845,

1.8,

1.4635864010778035

],

"label_certainty": 2,

"measured_by": {

"Camera": 1,

"Lidar": 1,

"Radar": 1

},

"object_id": -1,

"occlusion": 1,

"orientation_quat": [

-0.7071073056108926,

0.005505677989137767,

0.032886709367085126,

0.706319623264559

],

"score": -1.0

}

]

}https://github.com/wzan0001/Astyx-radar-dataset-convert-to-kitti-formatを通じて使用できます。

データセットを kitti 形式に変換して使用します。このメソッドはレーダー用の変換を実現します。

補足: 著者がこのデータセットを使用して、AVOD ネットワークを使用してカメラとレーダーを次のように融合していることは注目に値します。

自動車レーダーおよびカメラ向けのディープラーニング ベースの 3D オブジェクト検出。

2. VoD データセット 2022

翻訳:デルフト展望データセットにおける 3+1D レーダーによるマルチクラス道路利用者の検出

現在のアクセス方法: https://docs.google.com/forms/d/e/1FAIpQLSdKvkuKbzmJTn8raJBAWgekAJCpaQLS_ED63sUS89Ezo61RCQ/viewform

申請フォームに記入します。科学研究を目的とした学生の電子メール アドレスが必要です。要件を満たす著者は、ダウンロード用にデータセットのリンクを電子メールに送信します。現在入手可能な比較的優れたデータセットと言えますが、公式サイトThe View of Delft dataset | Documentation and Development kitで非常に詳しく紹介されています。

次世代レーダー(4D)が自動運転分野で大きな意味を持つことを説明し、アブレーション研究では、ドップラーセンサーだけでなく、多段階の道路利用者検知における追加の高さ情報(標高)についても議論しました。レーダー断面積、時間蓄積の利点。また、LIDAR とレーダーの点群形式も比較します。

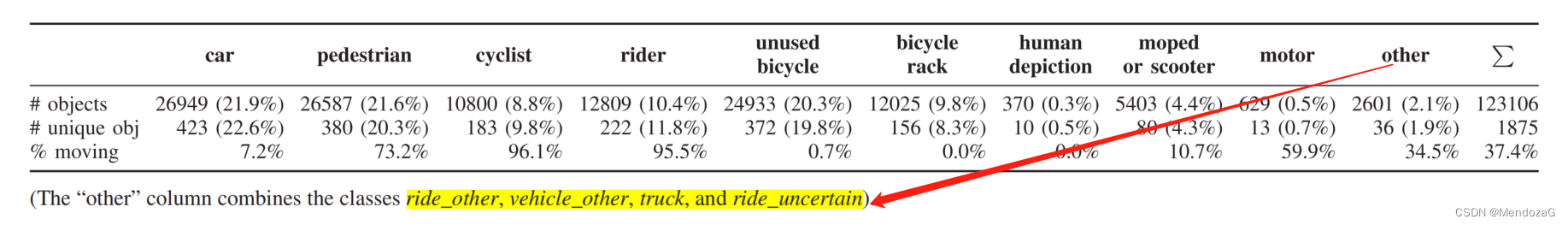

このデータセットには、複雑な都市交通で取得された 8,693 個のフレーム同期およびキャリブレーション済みの 64 ライン LIDAR、双眼カメラ、および 3+1D レーダー データが含まれています。これは、26,587 個の歩行者、10,800 個の自転車、26,949 個の自動車ラベルを含む、移動オブジェクトと静的オブジェクトの 123,106 個の 3D バウンディング ボックス アノテーションで構成されています。結果は、64 ラインの LIDAR データでの物体検出は 3+1D レーダー データよりも依然として優れていることを示していますが、標高情報の追加と連続レーダー スキャンの統合により、このギャップを埋めるのに役立ちます。

ドップラー情報のアプリケーションについては、ドップラー チャネルが PointNet++ に追加されると、一定の改善が見られます。

ドップラー次元は、次の 2 つの方法で 3D オブジェクト検出に利益をもたらします。

1) クラス分け。クラスには異なる速度パターンがある可能性があるため。

2) 方向推定では、物体の一般的な速度 (移動方向) がその方向と高い相関関係にあります。

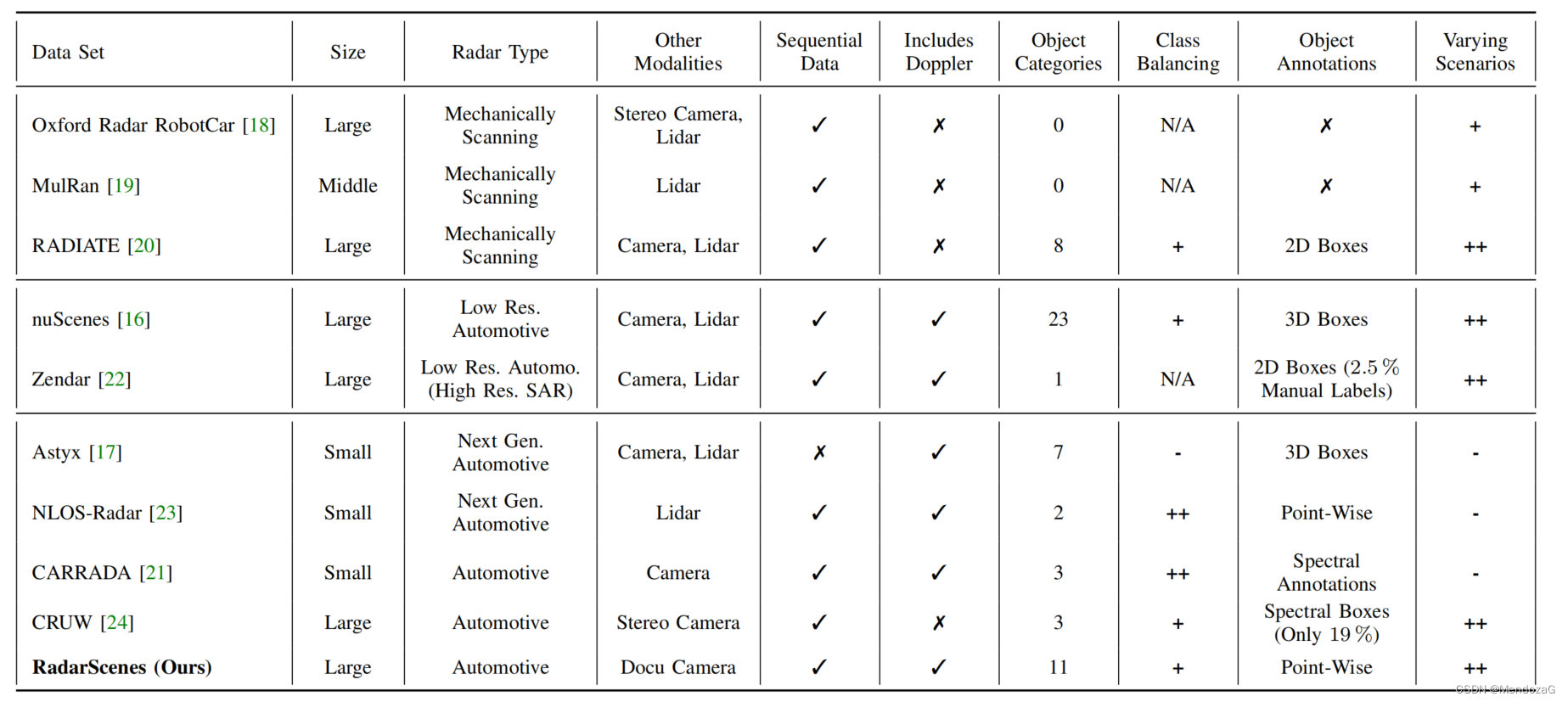

データセットの比較:

この論文の 3 つの貢献:

1. 著者はまた、PointPillars をベースラインとして使用し、レーダー ドップラー ディメンション、RCS、およびピッチ角ディメンションを追加した場合の結果への影響をテストします。

2. 目標検出における LIDAR とレーダーの性能を比較すると、LIDAR の方がまだ優れているという結果が示されていますが、将来的にはレーダー検出が依然として大きな可能性を秘めていることが予測され、速度次元の検出にはレーダーが唯一のものです。

3. VoD データセットを提案します。

次にデータセットの説明です。

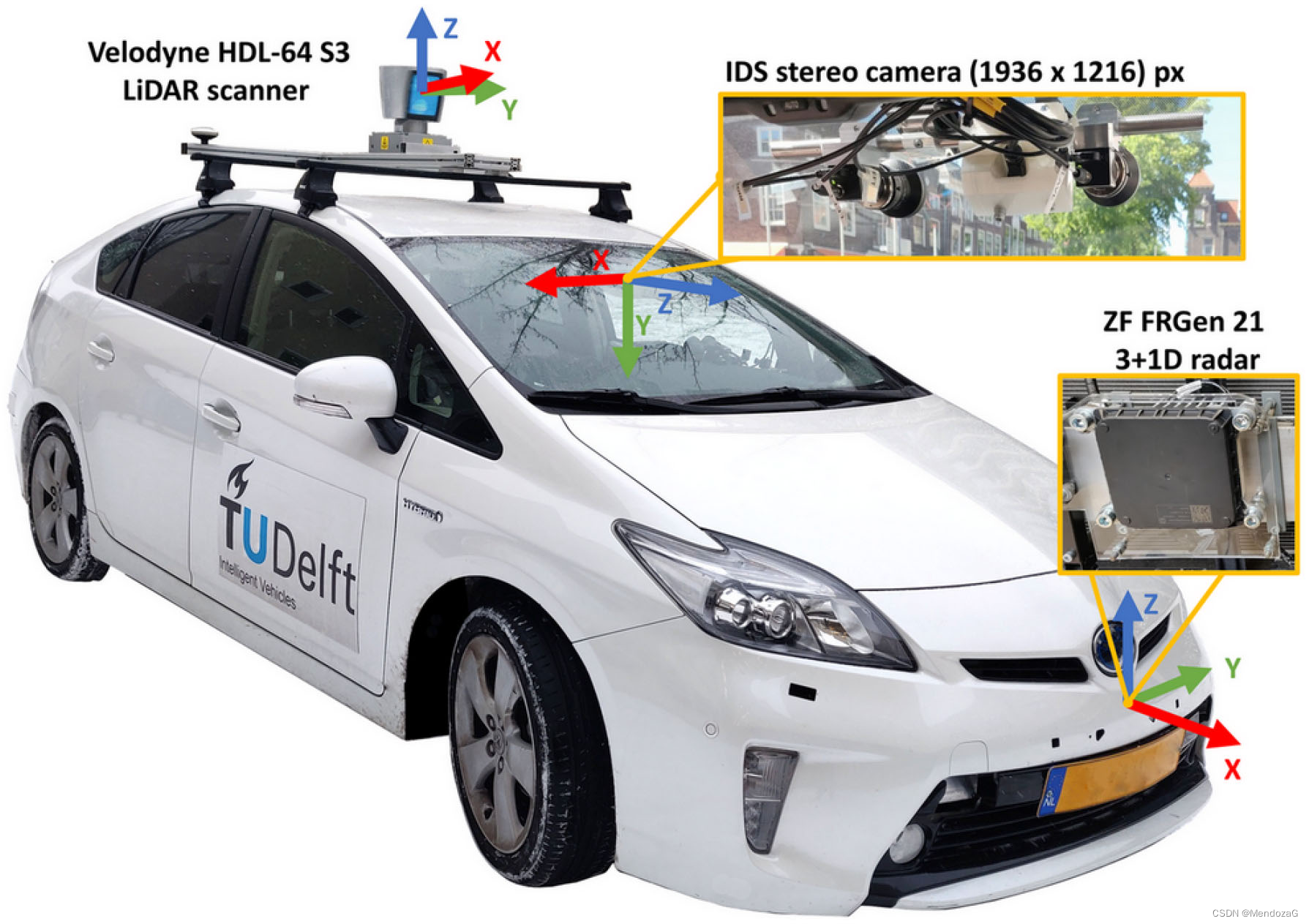

これには主に、Velodyne の 64 ライン LIDAR、IDS 双眼カメラ (230W ピクセル)、ZF の 4D レーダーが含まれており、IMU、GPS、RTK サービス、車輪速度が含まれます。

Kitti と同じ同期がフレーム形式で提供されます: Lidar 点群、修正されたモノラル画像、レーダー点群、変換情報。LIDAR タイムスタンプをリード (メイン) として選択します。選択原則は最近傍タイムスタンプで、最大許容誤差は 50 ミリ秒です (誤差は小さくありません)。フレームは (同期後) 10 Hz で時間的に順序付けされ、平均長が約 40 秒のセグメントに編成されます。LIDAR は動き補償されており、座標系の定義やファイルの構成など、システムの定義も Kitti を参照しています。この同期バージョンのデータセットに加えて、13 Hz でのすべてのレーダー スキャンと、左右のカメラから取得された 30 Hz での補正されたカメラ画像を含む、非同期記録された「生」(生) データが提供されます。これは、検出、追跡、予測、またはその他のタスクのために、より豊富な時間データを探している研究者に利益をもたらす可能性があります。

ラベル付けルール: LIDAR センサーから 50 メートル以内、カメラの視野の一部またはすべて (水平視野: ±32°、垂直視野: ±22°) が 6 自由度 (6 自由度) でマークされます。自由) 3D バウンディング ボックス。カテゴリは 13 個あり、オブジェクトごとに 2 種類のオクルージョン (「空間」と「ライティング」) とアクティビティ属性 (「停止」、「移動」、「パーク」、「押す」、「座る」) が提供されています。 ”)オクルージョンレベル。

(9+4カテゴリー)

アノテーションは 、DSpace の子会社である https://interest.ai によって行われます。

PointPillars をベースラインとして使用します。ポイントのエンコードには、p = [ x, y, z, v rel , RCS ]を使用します。ここで、速度は補正された絶対速度です。標準として LIDAR を使用して点群を結合し、最後のフレームに結合 (マージ) します。また、従来のデータ拡張が適用できない可能性も提案されており、例えば、RCS や速度次元は空間位置と一定の関係があり、任意に拡張することはできません。

このデータセットのパフォーマンス テストでは、作成者は自動車、歩行者、自転車の 3 つのカテゴリのみを選択しました。データセットを 59%/15%/26% の比率でトレーニング、検証、テスト セットに分割し、同じクリップのフレームが 1 つのクリップにのみ表示されるようにします (異なるクリップに応じて適切に分割されます)。

評価指標は kitti と同じ 2 つの AP と AOS (1 つの評価分類と 1 つの評価角度) を使用し、自動車の大きなターゲット IoU は 50% を使用し、歩行者と自転車は 0.25 IoU を使用します。結果は、1) 注釈付きエリア全体 (カメラの視野 50 m)、および 2) 地面正面の長方形として定義される、「運転通路」と呼ばれるより安全に関連したエリア [−4m<x<+4m、z <25m] カメラ座標。

一般に、寸法がいっぱいの場合に最良の結果が得られ、5 回のスキャンを累積すると結果が向上することがわかります。著者は 3 回と 5 回のスキャンのみを実行しましたが、さらに多くのセットを実行できます。ベースラインは LIDAR の PP であり、LIDAR の効果がより優れていることがわかります。全体のAPは距離とともに低下します。

サイクリストにとって、RCS のすべての特性が最大限に発揮され、ホイールとペダルの円運動と中央付近の高反射金属フレームの組み合わせにより、レーダーがより確実に検出できる明確で特徴的な反射パターンが生成されます。

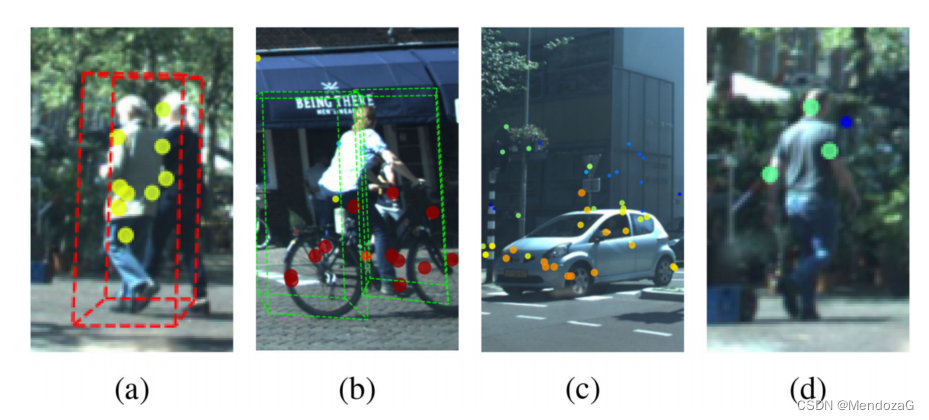

誤検出の例: (a) 小さな物体を結合する (2 人の歩行者を 1 人の自転車に見立てる)、(b) 大きな物体を小さな物体に分割する (1 人の自転車に 2 人の歩行者)、(c) 強い反射と近くの乱雑物 (金属の極端な制限と上限) )および(d)遠くの物体(遠くの歩行者)からの反射が少なすぎる。

データセット:

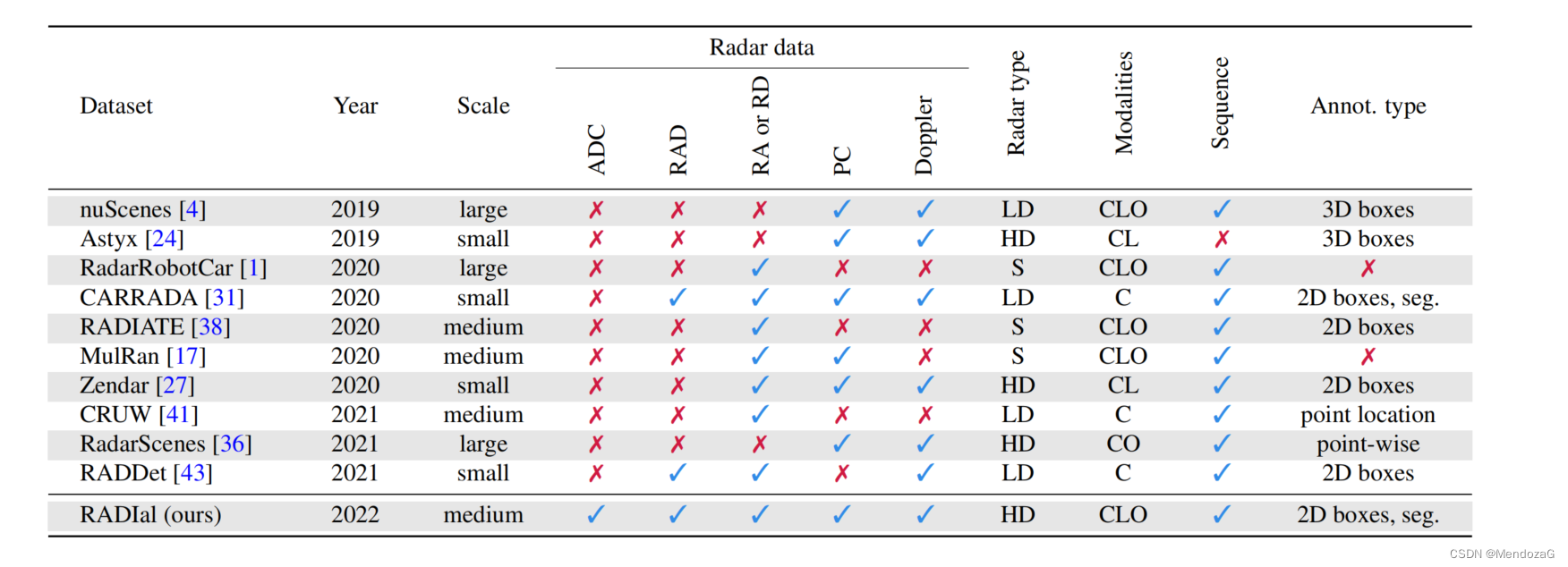

3. RADIal データセット

翻訳:マルチタスク学習用の生の高精細レーダー

データセット取得方法:GitHub - valeoai/RADIal

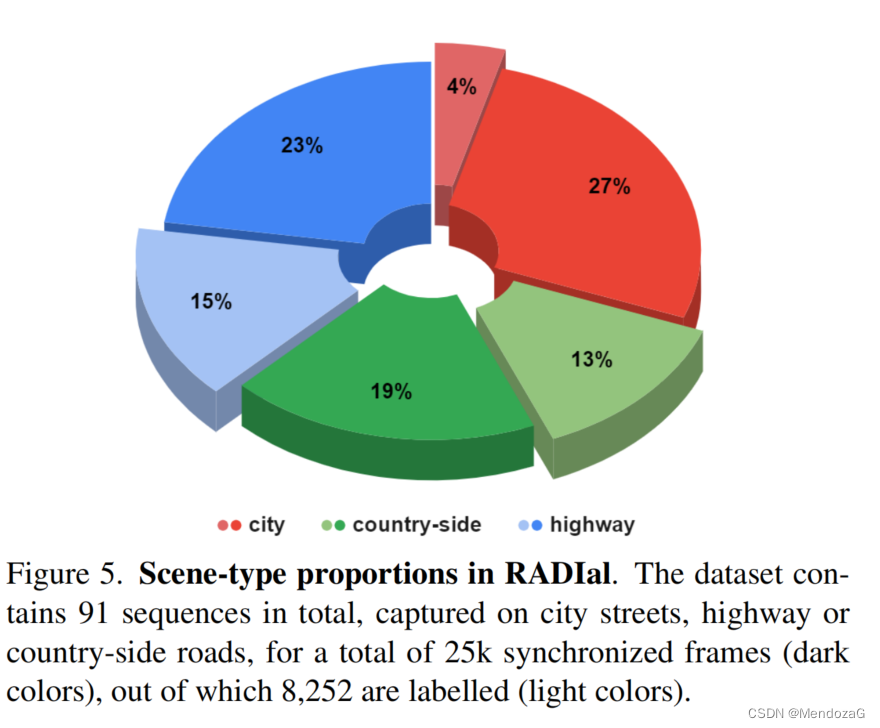

ダウンロード方法は Google ドライブです: (注意: この大規模なデータ セットには、長さが 1 ~ 4 分の 91 個のクリップが含まれており、合計 2 時間になります。) https://drive.google.com/drive/folders/1vCis5mvO5qg7QlM69MqJ3Ni-gFunm5uz ?usp = 共有

このデータ セットは Valeo によって作成されました (WoodScape データ セットも作成しました)。

モデル FFT-RadNet が、「レーダー、LiDARなど」の 2 時間のオリジナル データセット (生、カメラ、レーザー、HD レーダー) RADIalとともに提案されています。

このデータセットの特徴は、元のデータが保持され、さまざまな処理方法の結果が利用できることであることがわかります。.RADIal は、カメラ、ライダー、オドメトリを組み合わせた高解像度レーダーを提供し、検出タスクと自由空間セグメンテーション タスクの両方を提案する唯一のデータセットです。

データセットの分類:

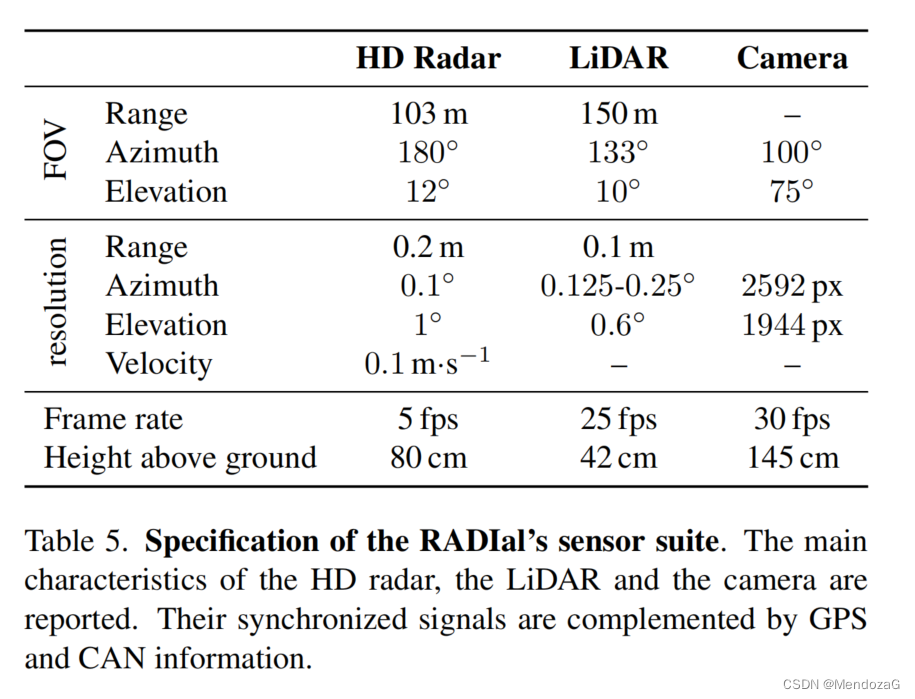

デバイス情報:

4. TJ4DRadSet (2022) は現在オープンソースではありません

オリジナル: TJ4DRadSet: 自動運転用 4D レーダー データセット

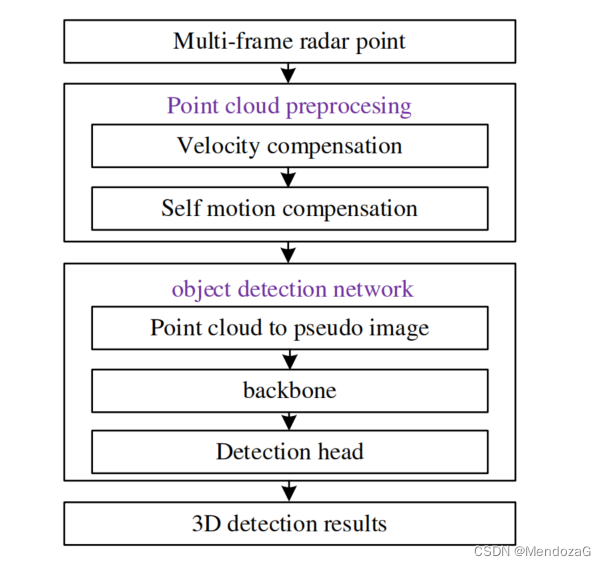

この記事と関連の深い記事(合わせて読むことをお勧めします):マルチフレーム4D車載ミリ波レーダー点群のための3D物体検出

(アップデート --- がリリースされました。機密保持契約に署名する必要があります) リンクを取得します: GitHub - TJRadarLab/TJ4DRadSet: TJ4DRadSet: A 4D Radar Dataset for Autonomous Driving

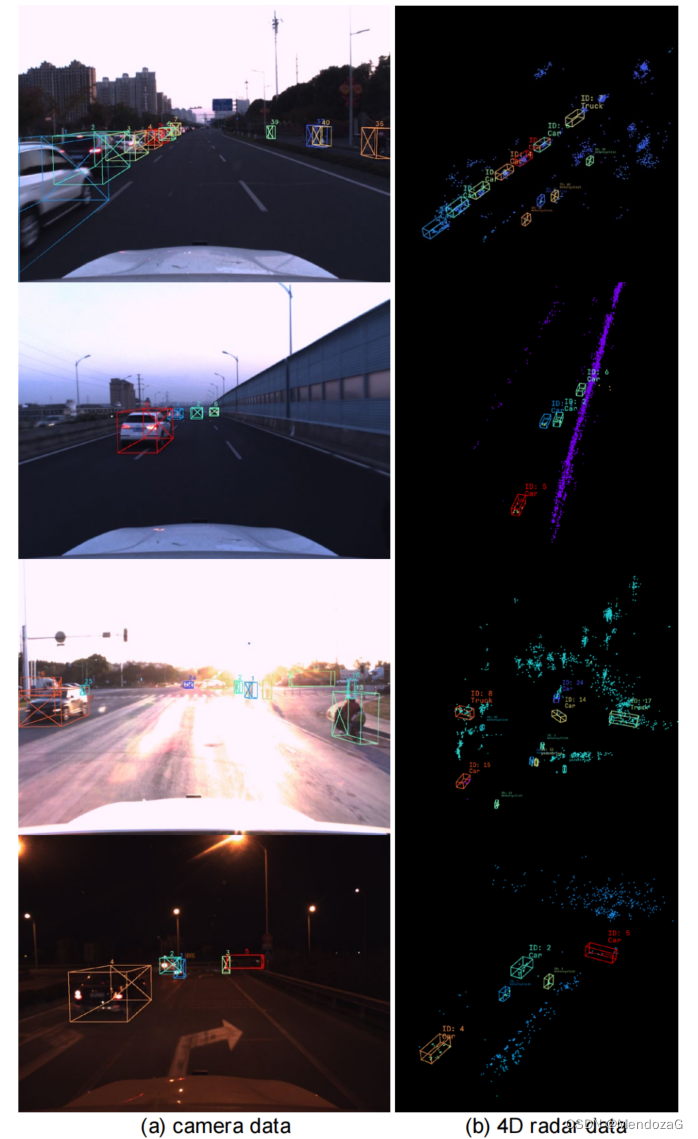

この論文の主な作業は、Oculii の 4D レーダーを使用してデータセットを作成することであり、他の論文から、研究グループがこのデータセットに基づいていくつかの拡張論文を発表していることがわかります。

TJ4DRadSet には合計 40K フレームの同期データが含まれており、そのうち 7757 フレーム、44 シーケンスには高品質の注釈付き 3D バウンディング ボックスとトラッキング ID が含まれています。3D ラベル付けシステムは、共同マルチセンサー ラベル付けと複数回の手動検査ラベル付けを使用します。

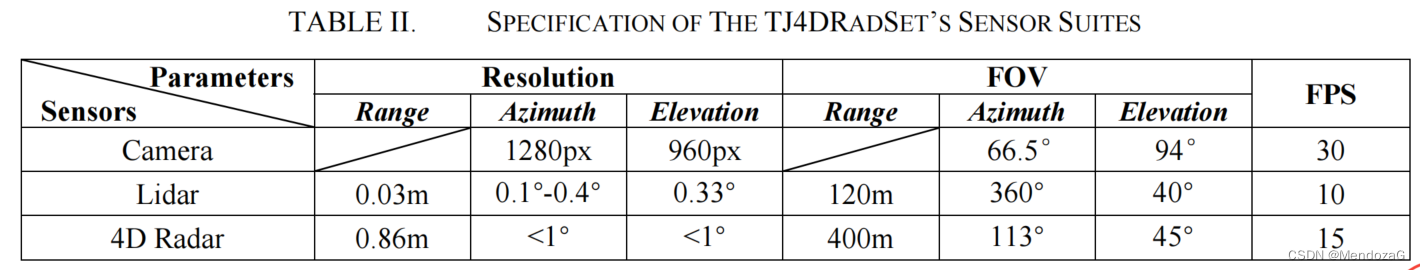

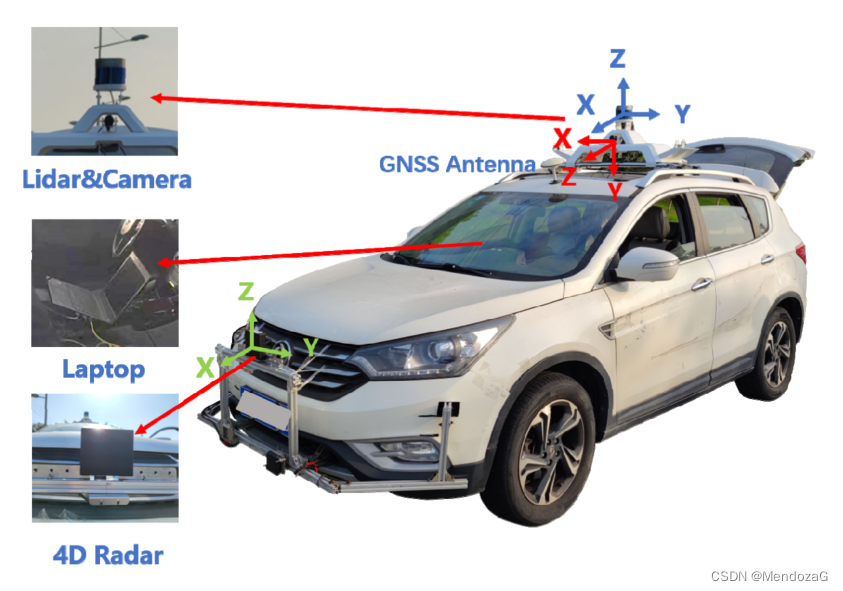

プラットフォームは次のとおりです: LiDAR ( Velodyne-32C LiDAR はパラメーターの比較と写真によって識別できます)、4D レーダー (Oculii Eagle)、および慣性航法を使用し RTK を搭載したコンピューティング プラットフォームです。

次に、PointPillars をベースラインとして使用してテストすると、結果は次のようになります。

補足: RadarScenes 2021

翻訳:RadarScenes: 自動車アプリケーション向けの現実世界のレーダー ポイント クラウドデータ セット

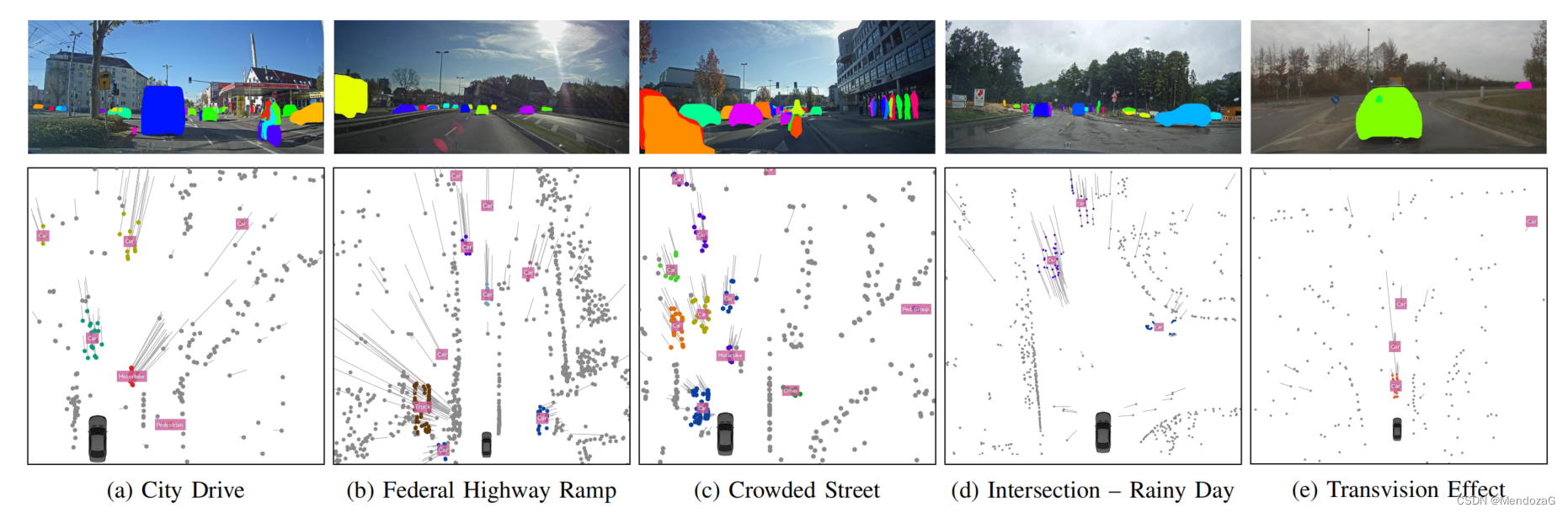

リンクを取得します: RadarScenes - RadarScenes

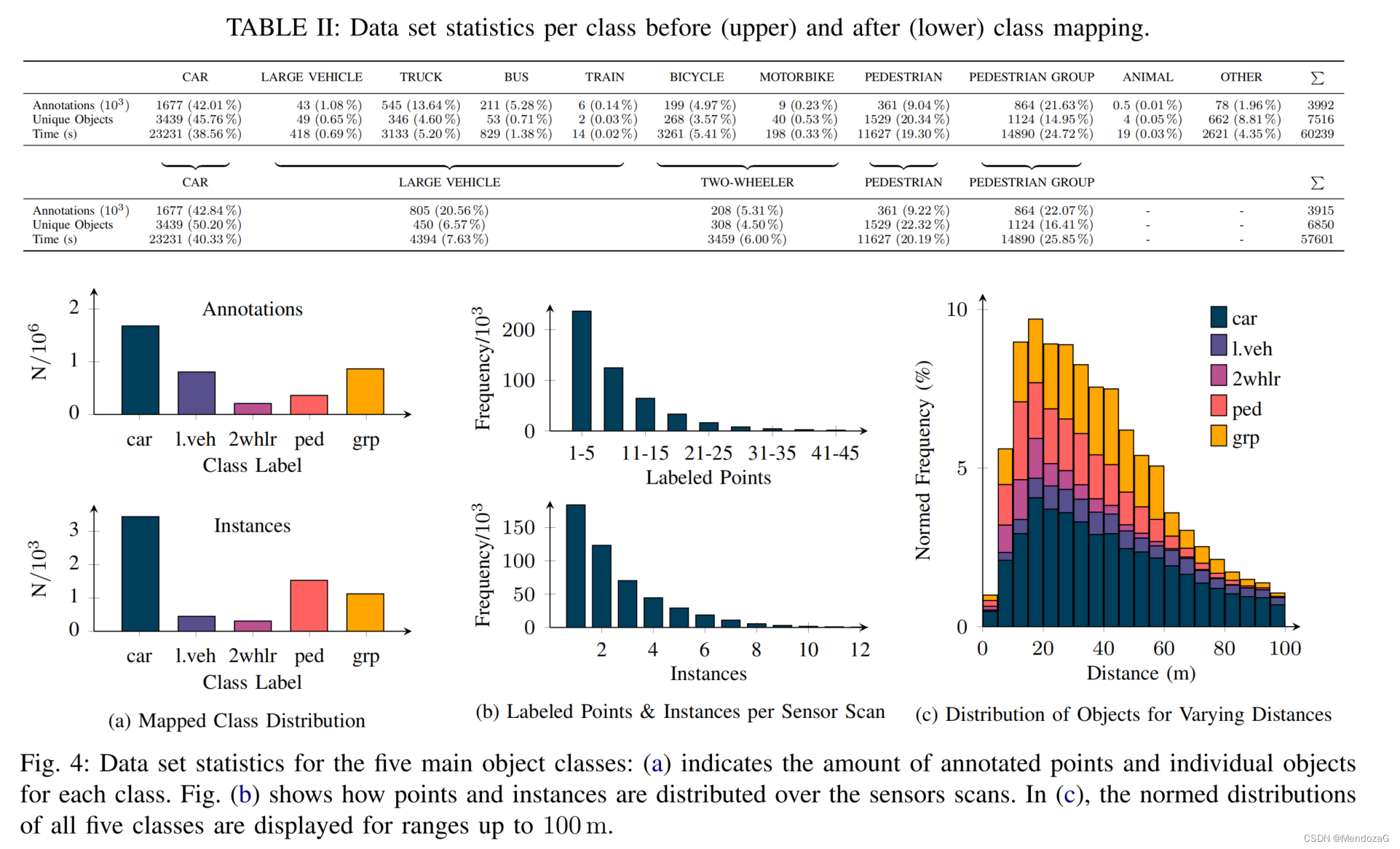

その名の通り、複数のシーンで構成されています。これは、11 のオブジェクト カテゴリ、5 つの大きなメイン カテゴリ、合計 7,000 人を超える道路参加者で構成され、100 km のさまざまな街路シーンに手動でラベルが付けられています。大きく分けて、乗用車、大型車、二輪車、歩行者団体、歩行者の5つのカテゴリーに分かれます。さまざまなシーン列は、気象条件、交通密度、道路クラス (高速道路、郊外、市内中心部) などの要素を組み合わせており、列のシーケンス データは、時間的に一貫したシーケンスが利用可能かどうかを示します。

センサー構成: 77GHz で 4 つのレーダー:

自動車、大型車両、トラック、バス、電車、自転車、原動機付二輪車、歩行者、歩行者団体、動物、その他の 11カテゴリに分類

データセットの配布:

要約:

一般的に言えば、データセット、特に質の高いデータセットはまだ相対的に不足しています。上記の 4 つのデータセットは、さまざまな観点から貢献しています。データセットを使用する際には、データ収集の科学的性質とその基礎となる原則を分析してください。科学的性質は次のとおりです。も非常に重要です。今後対応するアップデートがあった場合には記事に更新いたします。