1. Conceptos relacionados comúnmente utilizados en la parte matemática del aprendizaje automático:

(1) Matemáticas avanzadas

1) función

2) límite

3) derivada

4) Valor extremo y valor máximo

5) serie de Taylor

6) gradiente

7) Descenso de gradiente

(2) Álgebra lineal

1) conceptos básicos

2) determinante

3) matriz

4) Método de mínimos cuadrados

5) correlación lineal de vectores

(3) Teoría de la probabilidad

1) evento

2) permutación y combinación

3) probabilidad

4) Teorema de Bayes

5) Distribución de probabilidad

6) Expectativa y varianza

7) Estimación de parámetros

2. Contenido de aprendizaje en video: https://www.bilibili.com/video/BV1Tb411H7uC?p=2

1) Teoría de probabilidad P2 y previo bayesiano

2) matriz P3 y álgebra lineal

El aprendizaje automático es una materia interdisciplinaria multidisciplinaria que involucra más conocimiento matemático. El conocimiento en esta lección se ha aprendido antes. Esta vez se reorganizará de acuerdo con los puntos clave. Debemos prestarle más atención. Al ver el video, todos profundizaron su impresión de las matemáticas básicas del curso.

Se recomienda que tome notas mientras mira, registre los puntos principales y el punto de tiempo, para que pueda mirar hacia atrás cuando sea necesario. Las notas de estudio también son parte de la tarea.

3. Requisitos:

(1) Pegue las notas de estudio de video, que requieren autenticidad, no copie, puede tomar fotografías a mano.

1) Teoría de probabilidad P2 y previo bayesiano

Grabar notas (fórmula) aprendidas en el video

2) matriz P3 y álgebra lineal

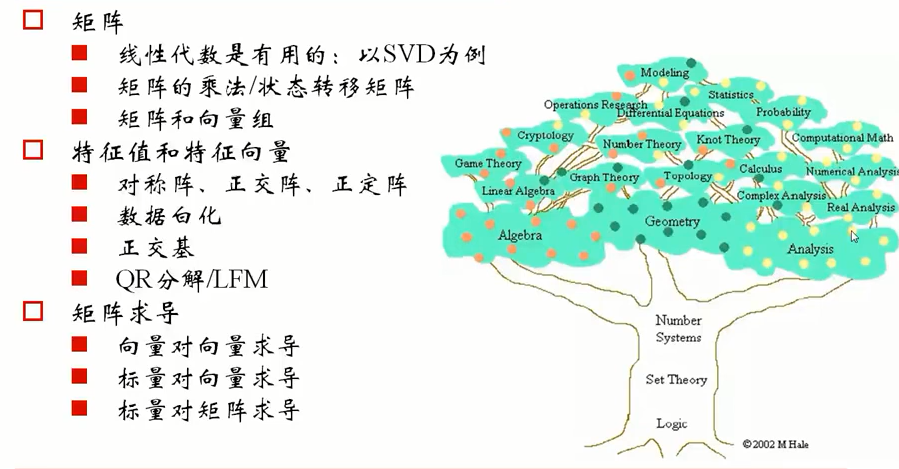

Los principales contenidos de la matriz y el álgebra lineal son los siguientes:

El conocimiento del álgebra lineal utilizado es:

1. Operaciones entre determinantes de matriz cuadrada

2. cofactor algebraico

3. Determinante de Vandermonde Vandermonde

4. Multiplicación matricial

5. El rango de la matriz

6. La relación entre el rango y la solución de ecuaciones lineales.

7. matriz ortogonal

8. Valores propios y vectores propios

9. Matriz definida positiva

(2) Resuma "gradiente", "pendiente de gradiente" y "teorema de Bayes" en sus propias palabras. Se requiere edición de palabras, mapeo mental, escritura a mano y fotografía, y se requiere concisión y diseño ordenado.

El significado original del gradiente es un vector (vector), lo que significa que la derivada direccional de una función en ese punto toma el valor máximo a lo largo de la dirección, es decir, la función cambia en el punto a lo largo de la dirección (la dirección del gradiente) más rápido, el cambio La tasa es la más grande (el módulo del gradiente). En pocas palabras, en el caso de funciones univariadas de valor real, el gradiente es solo una derivada o, para un álgebra lineal, es decir, la pendiente de la línea.

El descenso de gradiente es un método iterativo que se puede utilizar para resolver problemas de mínimos cuadrados (tanto lineales como no lineales). Al resolver los parámetros del modelo de algoritmos de aprendizaje automático, es decir, problemas de optimización sin restricciones, el descenso de gradiente es uno de los métodos más utilizados. En pocas palabras, es encontrar la ruta más rápida y empinada por la montaña desde la cima de la montaña .

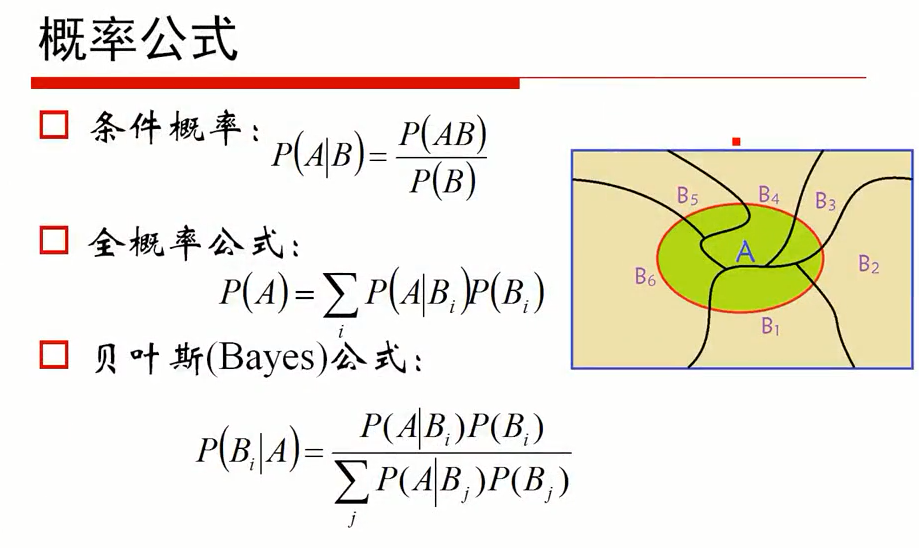

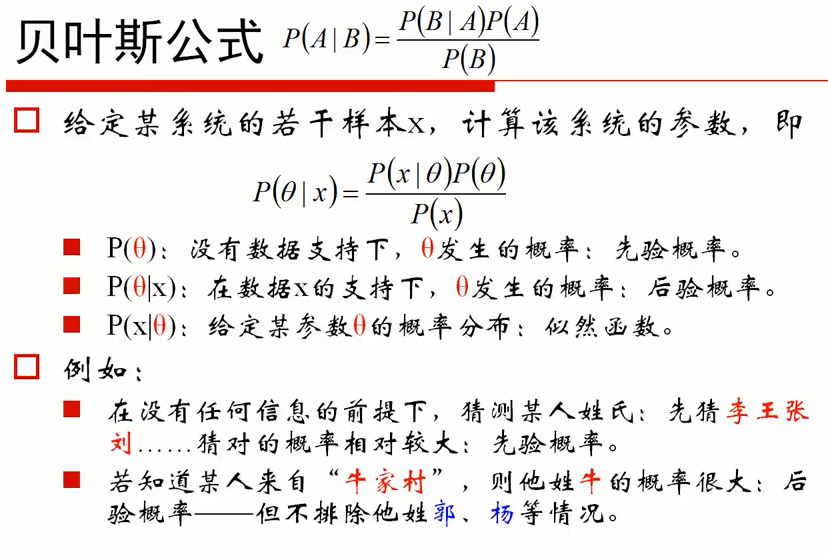

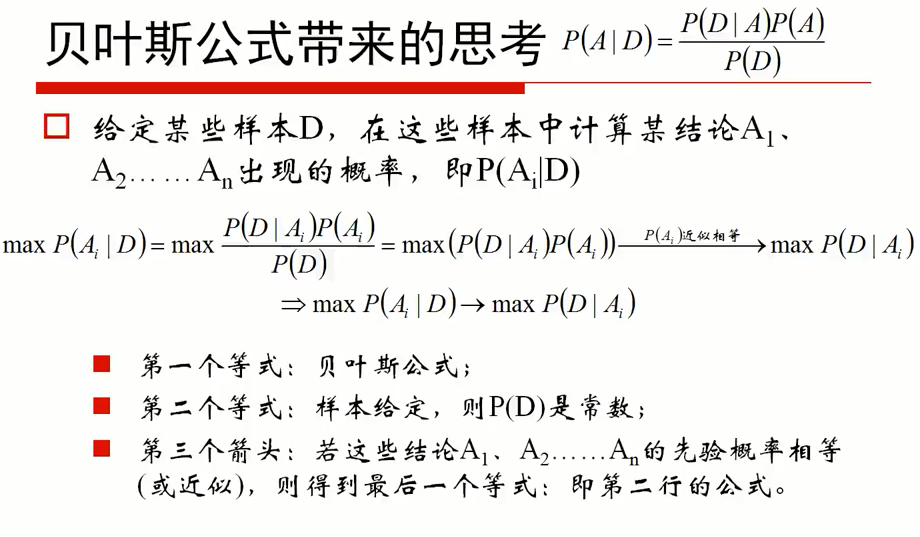

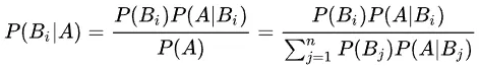

Teorema de Bayes: la fórmula bayesiana se basa en la probabilidad condicional de encontrar la causa del evento (es decir, bajo la condición de que haya ocurrido el evento grande A, el evento pequeño en la segmentación

Probabilidad), supongamos

Es una división del espacio muestral Ω, luego, para cualquier evento A (P (A)> 0), existe el teorema de Bayes:

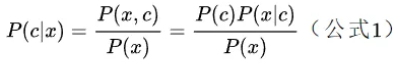

Para el conjunto de características x, queremos saber a qué categoría pertenece la muestra bajo este conjunto de características x, es decir, encontrar la etiqueta de clase con la mayor probabilidad posterior P (c | x). Según la fórmula de Bayes, podemos obtener:

El teorema de Bayes es un teorema utilizado para describir la relación entre dos probabilidades condicionales, como P (A | B) y P (B | A). Generalmente, la probabilidad del evento A bajo la condición de que ocurra el evento B {P (A | B)} La probabilidad {P (B | A)} del evento B bajo la condición del evento A es diferente, pero existe una relación definida entre los dos, y la regla de Bayes es una declaración de esta relación.