线性回归

文章目录

学习目标

- 掌握线性回归的实现过程

- 应用LinearRegression或SGDRegressor实现回归预测

- 知道回归算法的评估标准及其公式

- 知道过拟合与欠拟合的原因以及解决方法

- 知道岭回归的原理及与线性回归的不同之处

- 应用Ridge实现回归预测

- 应用joblib实现模型的保存与加载

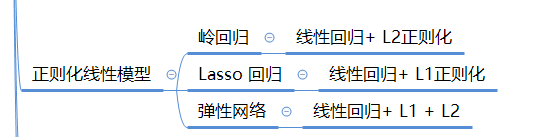

2.9 正则化线性模型

- Ridge Regression 岭回归

- Lasso 回归

- Elastic Net 弹性网络

- Early stopping

1 Ridge Regression (岭回归,又名 Tikhonov regularization)

岭回归是线性回归的正则化版本,即在原来的线性回归的 cost function 中添加正则项(regularization term): ![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-9uWhOdxa-1583245409408)(../images/%E5%B2%AD%E5%9B%9E%E5%BD%92%E6%A8%A1%E5%9E%8B1.png)]](https://img-blog.csdnimg.cn/20200303222359764.png)

以达到在拟合数据的同时,使模型权重尽可能小的目的,岭回归代价函数:

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-Evfg44rV-1583245409409)(../images/%E5%B2%AD%E5%9B%9E%E5%BD%92%E6%A8%A1%E5%9E%8B2.png)]](https://img-blog.csdnimg.cn/20200303222354465.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3FxXzM1NDU2MDQ1,size_16,color_FFFFFF,t_70)

- α=0:岭回归退化为线性回归

2 Lasso Regression(Lasso 回归)

Lasso 回归是线性回归的另一种正则化版本,正则项为权值向量的ℓ1范数。

Lasso回归的代价函数 :

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-l0VLGzuW-1583245409409)(../images/lasso%E5%9B%9E%E5%BD%921.png)]](https://img-blog.csdnimg.cn/20200303222349280.png)

【注意 】

- Lasso Regression 的代价函数在 θi=0处是不可导的.

- 解决方法:在θi=0处用一个次梯度向量(subgradient vector)代替梯度,如下式

- Lasso Regression 的次梯度向量

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-Qs8E8o58-1583245409410)(../images/lasso%E5%9B%9E%E5%BD%922.png)]](https://img-blog.csdnimg.cn/20200303222344962.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3FxXzM1NDU2MDQ1,size_16,color_FFFFFF,t_70)

Lasso Regression 有一个很重要的性质是:倾向于完全消除不重要的权重。

例如:当α 取值相对较大时,高阶多项式退化为二次甚至是线性:高阶多项式特征的权重被置为0。

也就是说,Lasso Regression 能够自动进行特征选择,并输出一个稀疏模型(只有少数特征的权重是非零的)。

3 Elastic Net (弹性网络)

弹性网络在岭回归和Lasso回归中进行了折中,通过 混合比(mix ratio) r 进行控制:

- r=0:弹性网络变为岭回归

- r=1:弹性网络便为Lasso回归

弹性网络的代价函数 :

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-H3m7ekO2-1583245409410)(../images/elastic_net.png)]](https://img-blog.csdnimg.cn/20200303222338158.png)

一般来说,我们应避免使用朴素线性回归,而应对模型进行一定的正则化处理,那如何选择正则化方法呢?

小结:

-

常用:岭回归

-

假设只有少部分特征是有用的:

- 弹性网络

- Lasso

- 一般来说,弹性网络的使用更为广泛。因为在特征维度高于训练样本数,或者特征是强相关的情况下,Lasso回归的表现不太稳定。

-

api:

-

from sklearn.linear_model import Ridge, ElasticNet, Lasso

-

4 Early Stopping [了解]

Early Stopping 也是正则化迭代学习的方法之一。

其做法为:在验证错误率达到最小值的时候停止训练。