Enhancing the Discriminative Feature Learning for Visible-Thermal Cross-Modality Person

当前的问题及概述:

为了解决模式间和模式内的差异这两个问题,本文从两个方面入手,采用三种简单的方法来增强鉴别特征学习(EDFL)

(1)skip-connection:我们从下图的灰度CAM可以看到,以backbone是ResNet-50为例。我们可以发现深度CNN的不同层次确实是针对不同的位置来预测的。因此,我们尝试将CNN模型中中间层的特征通过跳连接的方式融合进来,增强person特征的识别性和鲁棒性。

(2)dual-modality triplet loss:同时考虑到模态内部差异模态间变化。

(3)Two-stream:利用两个独立的CNNs来学习模态相关的信息,从而解决跨模态差异问题,然后利用一些共享层将这些特定于模态的信息嵌入到一个公共空间中。同时考虑模态的共同性和差异性,Two-stream CNN结构可以生成多模态的可共享特征。

模型及loss:

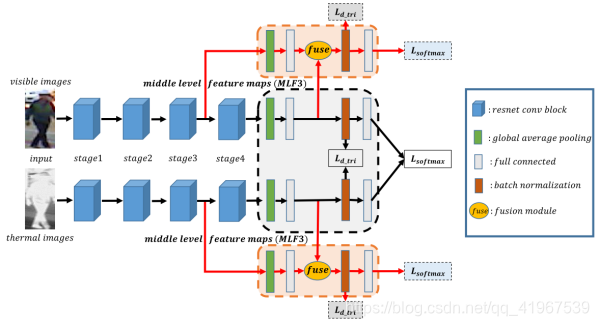

本文提出的EDFL框架如上图,该模型采用two-stream CNN结构提取人的特征,一流提取RGB图像,另一流提取热图像,分别以两个ResNet50模型作为每个流中的backbone,它们彼此独立,以提取特定于模式的信息。然后,以参数共享的方式将两个流的顶部全连接层嵌入到一个公共特征空间中。最后,采用dual-modality triplet loss (Ld tri) and identity softmax loss (Lsoftmax)进行网络训练。其中,没有Ld tri的黑线是baseline,添加红线是加入中层特性的skip connections。相同颜色的虚线方块中的这些层共享参数。

1.two-stream structure

同Hierarchical Discriminative Learning for Visible Thermal Person Re-Identification文章的双流结构相似具体讲解见Hierarchical Discriminative Learning for Visible Thermal Person Re-Identification的论文解读:其中,FBV为RGB分支函数,Iv为RGB输入图像,经过visible-stream输出特征为Vb(BN层前),tb同理,公式如下:

2.Mid-level features incorporation

本文中,过跳跃连接的方式,将CNN模型的中间层特征融合进来,以增强person特征的无描述性和鲁棒性,其中,红线描述了合并中间层特征的过程。

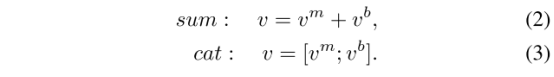

如图,以visible-stream为例,在stage3中提取中间层特征,即MLF3,取名为vm,由1得到,取baseline中BN层前特征为vb,如何fuse是这个skip-connection的关键,有两种思路,求和或级联:

3.Dual-modality triplet loss

Triplet loss第一次在 Facenet: A unified embedding for face recognition and clustering提及,在ReID中的应用也比较广泛,如:Cross-Modality Person Re-Identification with Generative Adversarial Training。

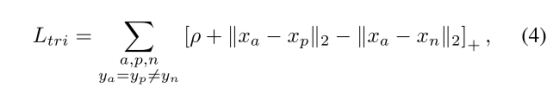

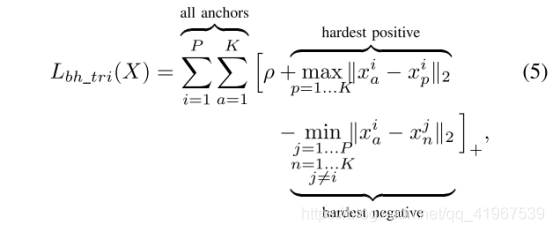

从式4,5可以看到,a,p为positive anchor,a,n为negative anchor,Triplet loss筛选出positive distance大于negative distance的部分进行优化,尽可能使得最终结果为positive distance小于等于negative distance,具体讲解见Cross-Modality Person Re-Identification with Generative Adversarial Training的论文解读。

其中,

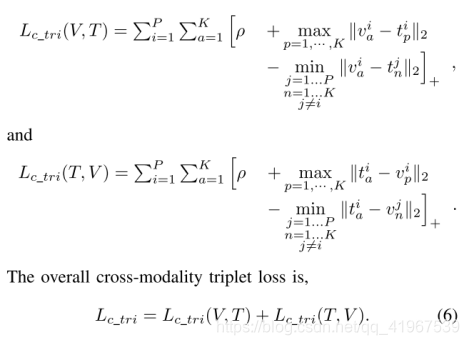

3.1Cross-modality triplet loss:

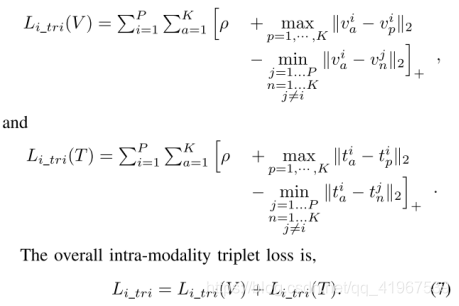

3.2Intra-modality triplet loss:

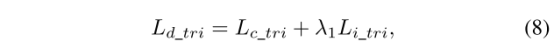

3.3The dual-modality triplet loss

其中,λ1和λ2的取值对结果的影响:

实验:

数据集选用 RegDB和SYSU-MM01,评价指标为ReID rates (%)和MAP (%)。

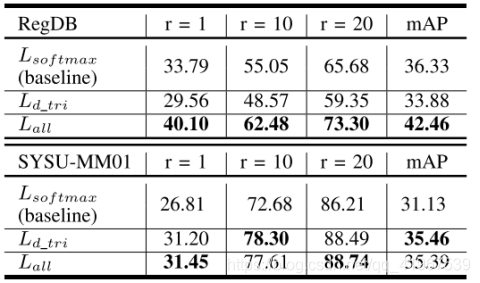

1,消融实验证明triplet loss的作用:

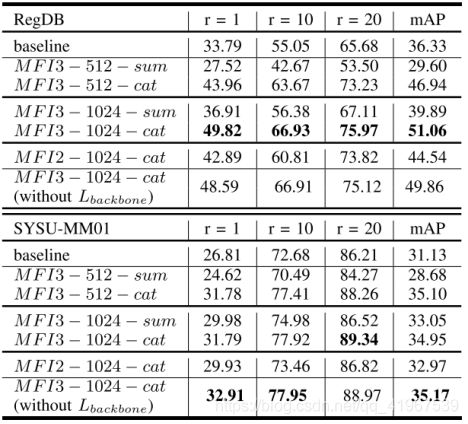

2.跳连接以及跳连接中fuse具体方式的比较:

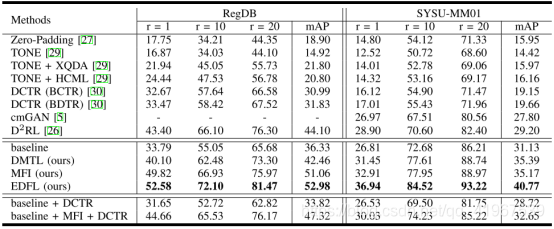

3.目前,所有方法及本方法的对比:

其中:

zero-padding:Rgb-infrared cross-modality person re-identification

HCML:Hierarchical discriminative learning for visible thermal person re-identification

DCTR:Visible thermal person re-identification via dual-constrained top-ranking

cmGAN:Cross-modality person re-identification with generative adversarial training

D2RL:Learning to reduce dual-level discrepancy for infrared-visible person re- identification