本博客是 CVPR 2019 论文 deep network interpolation for continuous imagery effect translation 的翻译,因作者本人水平有限,可能有部分地方翻译的不准确,希望读者不吝赐教,我会及时改正!

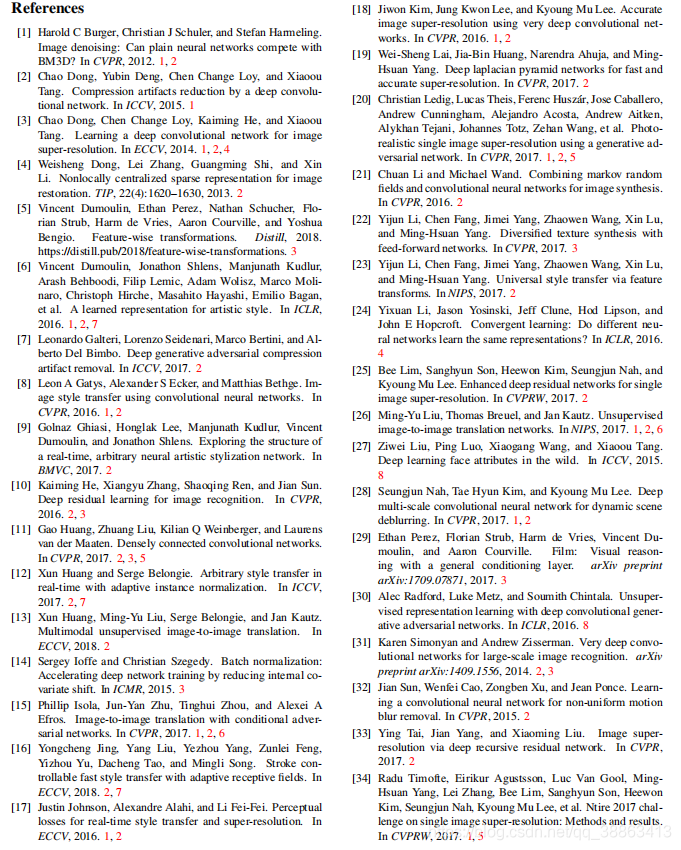

图形一

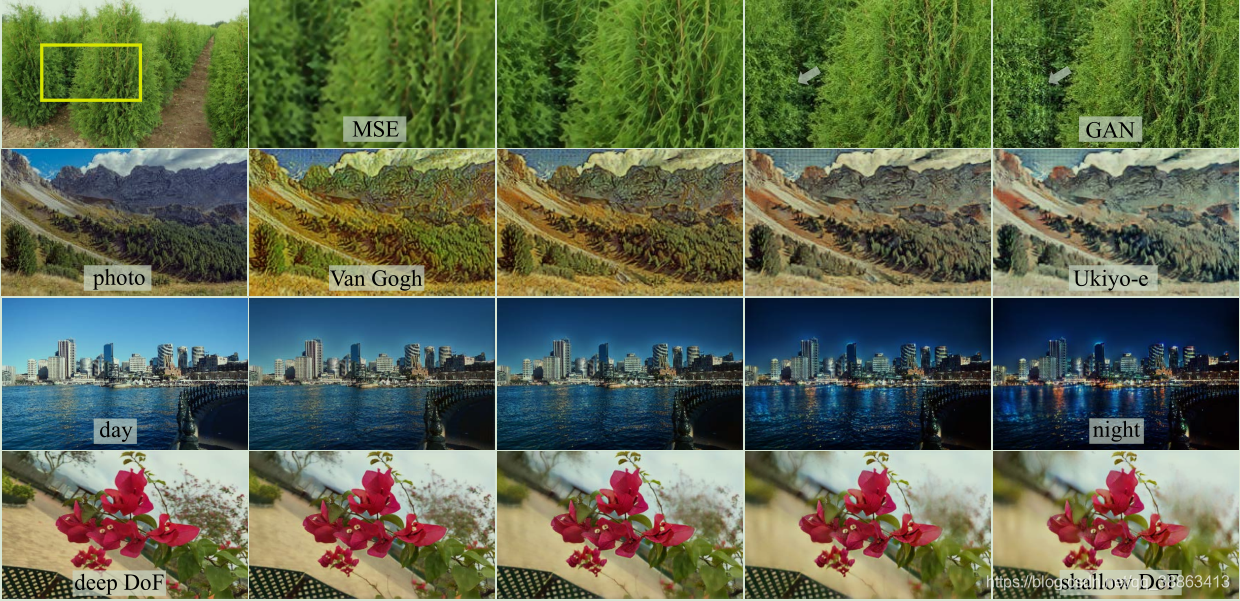

深度网络插值可以产生连续的图像特效的转换,第一行是在超分辨率的情况下从 MSE 效果转换到GAN 效果,第二行是在Van Gogh 风格转换到 Ukiyo-e 风格,第三行是从白天到夜晚的转换,第四行是从 DOF(deep of filed) 到shadow DOF 。 更多的应用请见第四节。 (放大以获得最佳视图)

摘要

深度卷积神经网络已经证明了对于一个理想的图片效果,它学习到一个确定的映射的能力。然而,多种多样的用户品味激发了在不同的输出图像之间进行连续效果转换的可能性。与现有的方法,即需要特定的设计来实现特定的过渡(例如样式转换) 所不同的是,我们提出了一种简单而且通用的方法在许多低级的视觉任务中实现对各种图形效果的平滑控制,包括图像恢复,图像到图像的转换,以及样式转换。特别的,我们的方法,即深度网络差值(DNI)在两个或者多个相关网络的参数空间中应用线性的插值。图像效果的平滑控制可以通过调整插值系数来实现,除了DNI以及它广泛的应用,我们还从学习的过滤器的角度来研究网络插值的机制。

介绍

深度卷积神经网络已经已经在很多低级的视觉任务,例如图像修复,图像到图像的转换,图像风格转换,取得了重大的成功。对于每一个具体的任务,深度网络学习一个确定性的映射,并为相同的输入输出固定的图像,但是确定的输出不能满足用户多样的品味以及各种情况下的需求,从而限制了它实际应用的适用性。

在很多实际的应用中,都希望对于不同的输出效果之间的连续转换能有一个平滑的控制,举例来说,1) 在超分辨率的情况下,使用mse(mean square error) 作为损失函数的模型倾向于产生过度平滑的图像,然而那些使用 GAN(generative adversarial network)网络(生成对抗网络)生成的图像具有生动的细节,但是也有一个令人不愉快的噪声。只有两个不同效果之间达到一个平衡的结果,才会达到视觉的愉悦,减少伪影。2) 许多图像恢复任务处理多个降级级别,例如不同的噪声级别和模糊内核。大多数现有方法只能处理有限的降级级别。在实践中,要为连续降级水平训练大量模型是很昂贵的。 因此,具有调整修复强度的,灵活的模型将扩大其应用范围。3) 在一些艺术操作中,诸如图像到图像的转换,图像样式的变换,不同的用户具有不同的审美风格,在这些应用中使用滑杆来实现对各种效果的平滑控制很有吸引力。

已经有几种方法被提出来用于提高 CNN (卷积神经网络)在不同任务中进行连续转换的灵活性。以图像风格转换为例,实例规范化层使用自适应的缩放和移位参数来对不同的样式进行建模。对这些不同样式的归一化参数进行插值运算,就会产生各种艺术样式的组合。为了进一步控制样式结果中的笔划大小,一个精心设计,由许多笔划分支组成的金字塔结构被提出来。尽管这些方法可以实现连续转换,但也有一些缺点:1)这些精心的设计是特定问题的解决办法,对于其他问题缺乏一般性。2)需要对现有网络进行修改,因此,复杂化了训练过程 。3) 仍然没有一个有效,一般的方法解决一些问题(像在高分辨率的情况下,MSE 和 GAN 效果的平衡)的平滑控制。

本篇论文中,我们通过引入一种更加通用,简单但是有效的方法(也就是深度网络插值(DNI))来解决这些缺点。通过在现有训练网络的参数空间中进行线性插值,可以实现连续的图像效果转换。具体来说,为特定效果A提供模型,我们对其进行微调来实现另外一个相关效果B,DNI将线性插值应用于这两个深度网络的所有相应参数。然后可以通过可控制的插值系数来得出各种插值模型,使用相同的输入在这些插值模型上执行前馈操作,使我们能够在不同效果A和B之间进行连续过渡的输出。

尽管DNI 很简单,但它可以应用于许多低级视觉任务,图片1 中展示了一些例子。第4节中展示的广泛应用程序证明,深度网络插值对于许多问题是通用的。DNI 具有以下优点:1)过渡效果是平滑的,插值期间不会突变,过渡的系数可以通过插值系数轻松的控制。2)线性插值操作简单,每次过渡都不需要进行网络训练,并且计算DNI的时间可以忽略不计。3)与流行的网络网络结构(比如VGG,Res Net,Dense Net)兼容。我们在这项工作中的主要贡献是参数空间中插值的新颖概念及其在低级视觉任务中的应用,我们证明了参数空间中的插值比单纯的像素插值可以获得更好的效果。我们将进一步进行系统研究,通过仔细分析学到的过滤器来研究参数插值的机理和有效性。

相关工作

图像修复 . 基于CNN的方法已为多种图像恢复任务带来了一系列突破,包括超分辨率,去噪,去块和去模糊,尽管先前的大多数工作都专注于解决一种类型的失真而没有调整修复强度的灵活性,但是有一些开创性的工作旨在利用可控的“超参数”来处理各种实际情况。[45]采用CNN去噪器,通过在基于模型的优化框架中手动选择超参数来解决图像修复任务。但是,需要使用具有区别性的CNN降噪器,并且优化中的超参数选择并非易事[4]。SRMD [46]提出了一种有效的超分辨率网络,通过将降级图作为额外输入来处理多个降级。但是,所采用的维数拉伸策略是针对特定问题的,缺乏其他任务的通用性。

图像风格转换. Gatys等, [8]提出了一种用于艺术风格化的神经风格转移算法。 开发了许多方法来进一步提高其性能和速度[35,17,21]。 为了在一个模型中对各种/任意样式建模,开发了几种技术,包括条件实例规范化[6],自适应实例规范化[12,9]以及白化和着色转换[23]。这些精心设计的方法也能够实现用户控制。例如,内插不同样式的规格化参数会产生各种艺术样式的组合。可以通过在混合过程中调整其相应特征的权重来实现内容和样式的平衡。为了控制笔画大小,进一步提出了一种由几个笔画分支组成的特殊设计的金字塔结构[16]。在这些研究中,不同的可控因素需要特定的结构和策略。

图片到图片的转换 图像到图像的转换[15、37、26、47、13]旨在学习将图像从一个域转换到另一个域。例如,从风景照片到莫奈画作,从智能手机快照到专业数码单反相机照片。这些方法只能将输入图像转移到特定的目标流行,并且无法产生连续的转换。图像恢复和图像样式转换中提出的可控制方法是特定于问题的,不能直接应用于不同的图像到图像转换任务。相反,DNI 能够以一般方式处理所有这些问题,而不管每个任务的具体特征如何。

插值 除了执行参数插值外,还可以在像素空间或特征空间中插值。 然而,众所周知,由于自然图像位于非线性流形上,因此逐像素内插图像会导致重影伪影[41]。Upchurch等。 [36]提出了一种预训练的深度卷积特征的线性插值,以实现图像内容的变化。将特征反转回像素空间时,此方法需要优化过程。而且,它主要用于传递面部属性,不适合为低级视觉任务生成连续的过渡效果。更广泛地说,在输入和特征空间中进行多次CNN操作被提出会提高模型的灵活性。将额外条件连接到输入[46]或中间特征[22]会改变网络在各种场景中的行为。用仿射变换[29、5、38]调制特征能够有效地合并其他信息。与这些工作不同,我们尝试研究参数空间中的操作。ESRGAN [39]对网络插值进行了非常初步的研究,重点是提高竞争效果。DNI提供更全面的研究,并扩展到更多应用。

方法

3.1 深度网络插值

许多低级视觉任务,例如图像修复,图像样式转换和图像到图像转换,旨在将损坏的图像或条件图像x映射到期望的y。应用深度卷积神经网络直接学习映射函数Gθ :y =Gθ(x) ,其中θ为参数。考虑两个具有相同结构的网络GA和GB,分别实现不同的效果A和B。网络由常见操作组成,例如卷积,上/下采样和非线性激活。CNN中的参数主要是卷积层的权重(称为过滤器),用于过滤输入图像或先验特征。我们假设它们的参数θA和θB彼此之间具有“强相关性”,即GA和GB相同位置的滤波器阶数和滤波器模式相似。这可以通过一些约束(如微调)来实现,这将在第3.2节中进行分析。该假设为有意义的内插值操作提供了可能性。

我们的目标是实现效果A和B之间的连续过渡。我们通过深度网络插值(DNI)来实现。DNI对这两个模型的所有相应参数进行插值,以得出新的插值模型

,其参数为:

其中α∈[0,1]是插值系数。实际上,这是两个参数向量

和

的线性插值。插值系数α控制效果A和B的平衡。通过使α平稳滑动,我们可以获得连续的过渡效果而不会发生突然的变化。通常,DNI可以扩展到N个模型,分别由

,

,…,

表示,其参数彼此之间具有“紧密相关性”。然后将DNI公式表示为:

其中

满足

并且

,换句话说,它是参数向量

,

,…,

的凸组合。 通过调整

,可以实现具有连续过渡的丰富多样的效果。

插值是在网络中具有参数的所有网络层上执行的,包括卷基层和正则化层,卷积层具有两个参数,即权重(filter) 和偏差,使用filter 进行filtering 操作之后,会将偏差添加到结果中,除权重外,DNI还对偏差进行操作,因为增加的偏差会影响连续的非线性激活。

批处理规范化(BN)层[14]具有两种参数。1)统计量running_mean和running_var跟踪训练期间整个数据集的均值和方差,然后将其用于评估期间的归一化。2)学习的参数γ和β用于进一步的仿射变换。在推论过程中,所有这四个参数实际上都可以吸收到先前的或连续的卷积层中。因此,DNI也执行归一化参数。实例规范化(IN)具有与BN相似的行为,除了IN在训练和评估中都使用从输入数据计算出的实例统计信息之外。我们采取与Bn相同的动作。实际上,插值不仅在权重上执行,而且在偏差和其他归一化层上执行。我们认为,考虑到各种参数的属性的更好的插值方案值得开发。

值得注意的是,DNI的网络结构选择是灵活的,只要要插值的模型结构保持相同即可。 我们在不同体系结构上的实验表明DNI与流行的网络结构兼容,例如VGG [31],ResNet [10]和DenseNet [11]。 我们还注意到DNI的计算可以忽略不计。 计算仅与参数数量成正比。

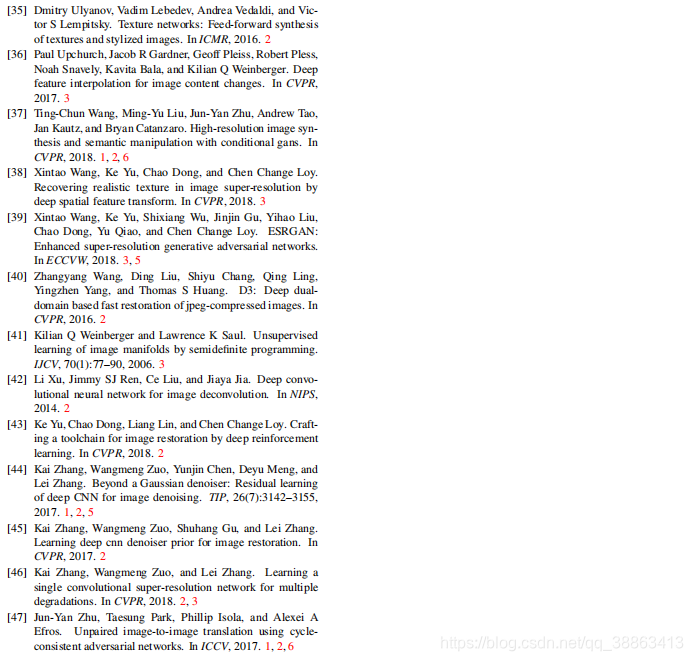

图片二

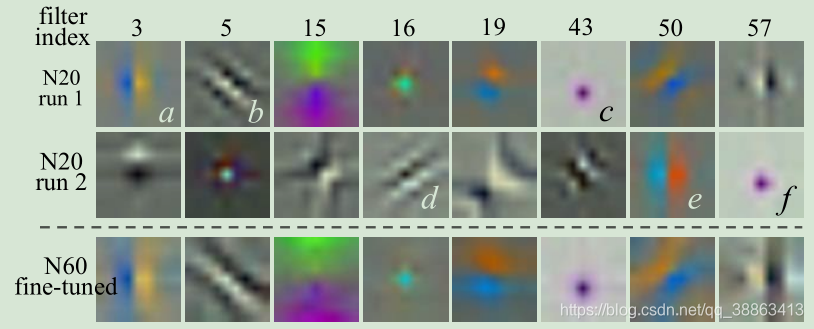

参数相关:前两行是针对降噪(N20)任务的不同运行(从头开始)的filter。 相同位置的filter顺序和filter 图案不同。 微调模型(N60)(第3行)与预先训练的模型(第1行)具有“强相关性”。

3.2 了解网络插值

我们试图从一些经验研究中获得对网络插值的更多理解。 从我们的实验中,我们观察到:

1)微调促进了不同网络参数之间的高度相关性,为有意义的内插提供了可能性。

2)一系列相关任务的微调过滤器呈现连续变化。

3)我们的分析表明,内插滤波器可以很好地拟合实际学习的滤波器。 请注意,我们的分析主要集中在过滤器上,因为CNN中的大多数参数都是过滤器的形式。

我们用具有代表性的去噪任务介绍我们的主要观察结果,并着重于使用N20,N30,N40,N50和N60提高噪声水平,其中N20表示均值为零且方差为20的高斯噪声。为了更好地可视化和分析滤波器 ,我们采用类似于SRCNN [3]的三层网络,其中第一和最后的卷积层具有9×9的滤波器大小。 遵循[3]的概念,第一层和最后一层可以分别视为特征提取和重构层。

微调网络间关联 即使对于像使用N20电平进行去噪这样的任务,如果我们简单地从头开始训练两个模型,则通道之间的滤波器顺序和相应位置的滤波器模式也可能非常不同(图2)。 然而,这两个网络之间共享核心表示[24]。 例如,在图2中,过滤器c与过滤器f相同; 滤镜a和滤镜e具有相似的图案,但颜色不同; 过滤器b是过滤器d的反向旋转部分。

但是,微调可以帮助维持过滤器的顺序和样式。 为了说明这一点,我们将预训练的网络(N20)调整为相关任务(N60)。 可以观察到,过滤器阶数和过滤器模式得以保持(图2)。 这两个网络的参数之间的“高度相关性”为有意义的内插提供了可能性。 我们注意到,除了微调之外,其他约束(例如带有正则化的联合训练)也可能实现这种网络间关联。

学到的相关任务过滤器会不断变化。 当我们从一个预训练的模型(N20)中微调一些用于相关任务的模型(N30,N40,N50和N60)时,相应学习的滤波器具有平滑过渡的内在联系。

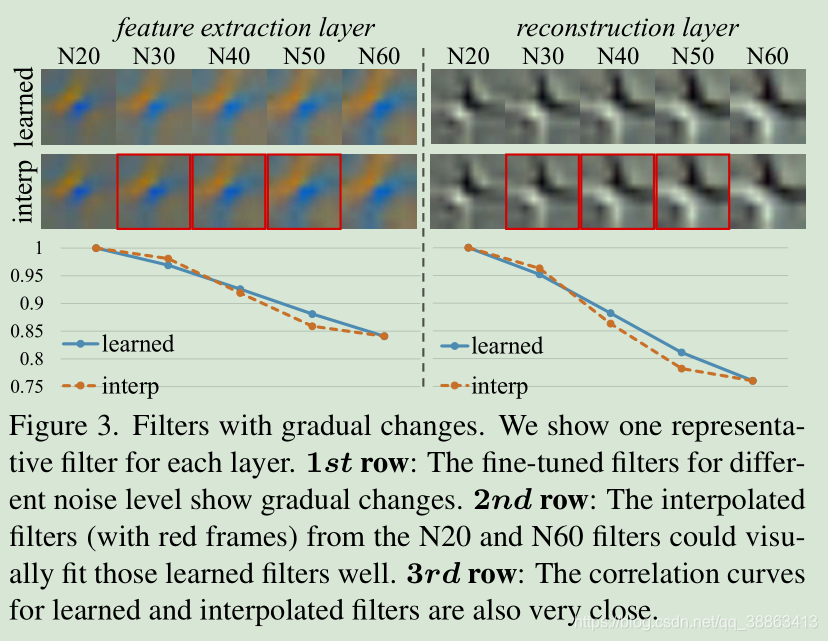

图3.逐渐变化的过滤器。 我们为每一层显示一个代表性的过滤器。 第一行:针对不同噪声水平的微调滤波器显示出逐渐变化。 第二行:来自N20和N60滤镜的插值滤镜(带有红色框)可以很好地适应那些学到的滤镜。 第三行:学习滤波器和插值滤波器的相关曲线也非常接近。如图3(第1行)所示,经过训练的滤波器会随着噪声水平的增加而逐渐变化。 除了可视化之外,我们还计算相关指数

以测量滤波器

和

的相关性:

我们选择这种形式(类似于Pearson相关),因为它忽略了比例和移位的影响,并专注于滤波器模式本身。 我们使用第一个N20滤波器计算每个滤波器的相关指数,并绘制曲线(图3中的蓝色曲线)。 结果表明,学到的滤波器之间存在密切的关系,随着噪声水平的提高,其呈现出逐渐变化的趋势。

内插滤波器非常适合学到的滤波器。 学习到的滤波器的连续变化表明,可以通过对两端进行插值来获得中间滤波器。 为了进一步验证这一观察结果,我们在N20和N60模型的滤波器之间执行线性插值。 利用最佳系数α,插值滤波器可以在视觉上拟合那些学习的滤波器(带有红色框的第二行,图3)。 我们使用第一个N20滤波器进一步计算每个插值滤波器的相关指数。 学习滤波器和插值滤波器的相关曲线也非常接近。

最佳α是通过内插网络的最终性能获得的。 具体来说,我们以0到1的α间隔执行0.05的DNI。 根据每个噪声水平选择最佳的α,基于此,内插网络可以在测试数据集上产生最高的PSNR。

讨论 值得注意的是,在其他许多任务中也可以找到类似的观察结果,例如具有不同内核的超分辨率和具有不同压缩级别的JPEG伪像去除。 我们在补充材料中提供详细信息。

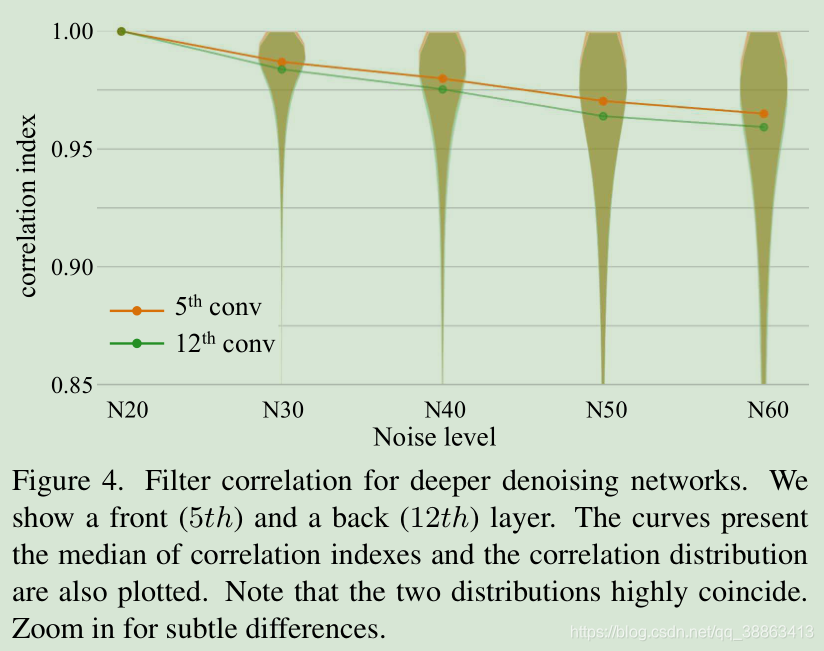

上面的分析绝不是完整的,但是从滤波器的角度对DNI进行了初步解释。随着网络的深入,非线性度增加,网络行为也变得更加复杂。但是,对于更深层的网络,我们仍然观察到类似现象。由于滤波器的可视化在深度网络中很困难,因为深度网络通常使用3×3内核的卷积层堆栈进行设计,因此我们采用相关指数(等式3)来分析一系列噪声水平模型之间的滤波器相关性。我们使用具有17层的DnCNN [44]并分析第5(前)和第12(后)卷积层。在图4中,相关曲线表示相关指数w.r.t的中值。还绘制了第一个N20模型和相关分布。除了这些模型之间的高度相关性,我们还可以观察到随着噪声水平的提高而逐渐变化。此外,前卷积层和后卷积层呈现相似的过渡趋势,即使它们的分布高度一致。

图片4.滤波器相关性用于更深的去噪网络。 我们显示了前(第5)层和后(第12)层。 曲线表示相关指数的中位数,并绘制了相关分布。 请注意,这两个分布高度一致。 放大细微的差异。

4. 应用

我们通过实验表明,提出的DNI可以应用于广泛的低级视觉任务,例如图像恢复(第4.1节),图像到图像翻译(第4.2节)和图像样式转换(第4.3节)。 关于面部属性的平滑过渡的另一个示例在第4.4节中给出,表明其潜在的语义变化。 由于篇幅所限,补充材料和项目页1提供了更多示例和分析。

4.1 图像修复

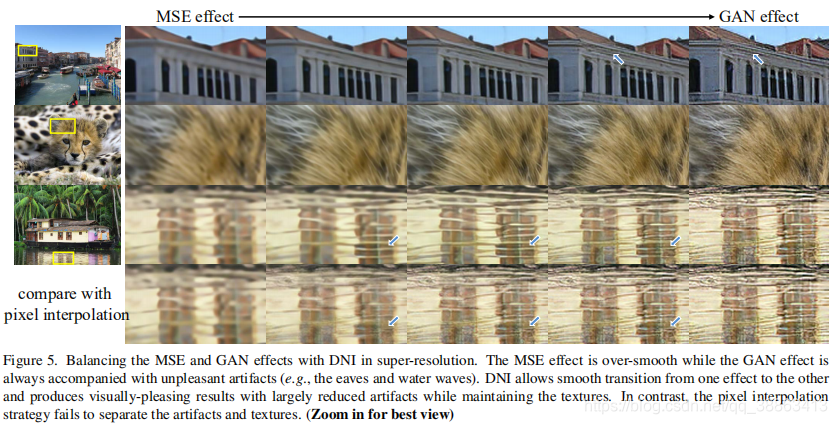

超分辨率下平衡MSE和GAN效果 从低分辨率的对应对象开始变老。 经过MSE损失训练的超分辨率模型[34]往往会产生过平滑的图像。 我们用GAN损失和感知损失[20]对其进行微调,获得具有生动细节的结果,但始终伴随令人不快的伪影(例如,图5中的屋檐和水浪)。 我们在网络体系结构中使用密集块[11,39],并且将比例因子为4的MATLAB双三次内核用作下采样内核。

如图5所示,DNI能够平稳地将输出从MSE效果更改为GAN效果。借助适当的插值系数,它可以在保持纹理的同时,在视觉上带来令人愉悦的结果,同时减少了伪影。我们还将其与像素插值进行比较,即逐像素插值输出图像。然而,像素插值不能分离伪像和细节。以水浪为例(图5),在过渡期间水浪纹理和伪影同时出现并增强。取而代之的是,DNI首先增强了生动的水波而没有伪影,然后出现了更精细的纹理和不想要的噪音。有效的分离有助于去除令人不快的伪影,同时保留优于像素插值的良好纹理。在图5的动物皮毛过渡中也可以观察到这种特性,其中皮毛的主要结构首先出现,然后是更精细的结构和微妙的纹理。

通过调整训练过程中MSE损失和GAN损失的权重,还可以获得针对不同混合效应的几种模型。 但是,这种方法需要调整损失权重并为各种平衡训练许多网络,因此实现连续控制的成本太高。

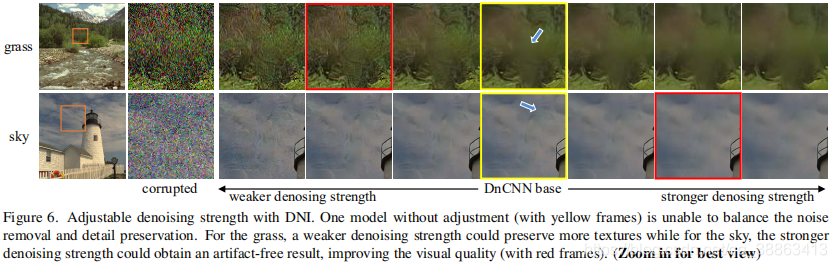

调整降噪强度 去噪的目的是从嘈杂的观察中恢复干净的图像。 为了满足各种用户需求,最流行的图像编辑软件(例如Photoshop)为每个工具提供可控制的选项。 例如,降噪工具带有滑动条,用于控制降噪强度以及保留或锐化细节的百分比。

我们显示一个示例来说明可调降噪强度的重要性。 我们提供了专门针对特定高斯噪声水平N40的降噪模型。 我们使用DnCNN [44]作为实现。 但是,如图6所示,由于图像内容不同,确定的输出(带有黄色框)不令人满意。 尤其是,草的去噪强度太强,会产生过度平滑的效果,而在光滑的天空区域中,则需要更大的强度才能去除不需要的伪影。

现有的基于深度学习的方法无法满足该用户要求,因为它们经过训练以生成确定性结果,而没有控制降噪强度的灵活性。 相反,我们提出的DNI可以通过简单地调整N20,N40和N60的不同降噪模型的插值系数α来实现可调节的降噪强度。 对于草来说,较低的去噪强度可以保留更多细节,而在天空区域中,较高的降噪强度可以得到无伪像的结果(图6中的红色框)。 此示例说明了DNI可以灵活地根据手头任务和特定用户偏好来定制恢复结果。

图片5

以超分辨率平衡MSE和GAN效果与DNI。 MSE效果过度平滑,而GAN效果始终伴随着令人不愉快的伪影(例如,屋檐和水波)。 DNI允许从一种效果到另一种效果的平滑过渡,并在保持纹理的同时产生视觉上令人愉悦的结果,同时大大减少了伪影。 相反,像素插值策略无法分离伪像和纹理。 (放大以获得最佳视图)

图6. DNI的可调降噪强度。 一种未经调整的模型(带有黄色框)无法平衡噪声消除和细节保留。 对于草来说,较低的降噪强度可以保留更多的纹理,而对于天空,较高的降噪强度可以获得无伪影的结果,从而改善了视觉质量(使用红色框)。 (放大以获得最佳视图)

4.2 图片到图片的转换

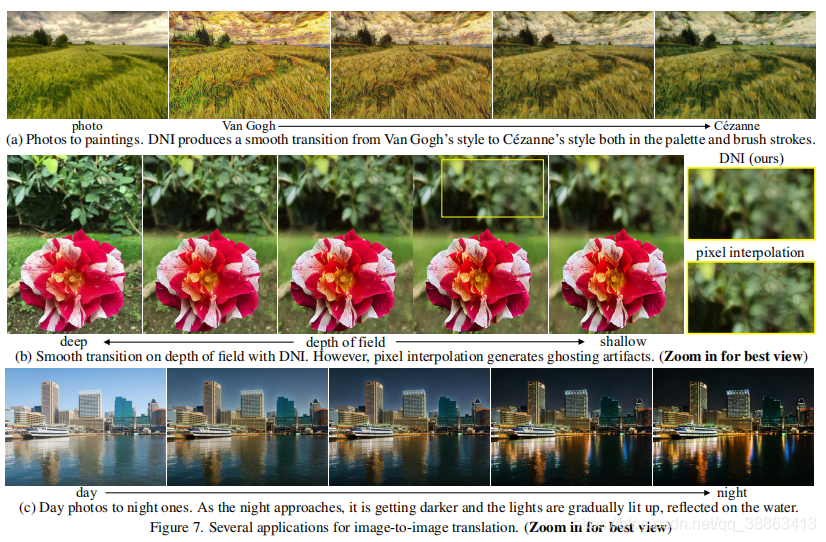

图像到图像的转换旨在学习将图像从一个领域转换到另一个领域。 大多数现有方法[15、37、26、47]只能将一个输入图像传输到几个离散输出,而缺乏针对各种用户口味的连续转换。 例如,一个模型可能能够模仿梵高或塞尚的风格,但是将风景照片转换为这两位画家的混合风格仍然具有挑战性。

DNI可以轻松实现两种画家风格之间所需的连续过渡。 流行的CycleGAN [47]被用作我们的实现。 我们首先训练一个捕捉梵高特征的网络,然后对其进行微调以产生塞尚风格的绘画。 通过调整插值系数,DNI能够在给定风景照片的情况下生成这两种样式的各种混合。 图7a在调色板和笔触中呈现了从梵高风格到塞尚风格的平滑过渡。 我们注意到,可以使用DNI进一步使用等式2来混合两个以上画家的样式。 结果在补充材料中提供

除了在整个图像的绘画样式之间进行转换外,DNI还可以为特定图像区域实现平滑自然的转换。 图7b示出了照片增强以生成具有更浅景深(DoF)的照片的示例。 我们训练一个模型来生成具有浅景深的花朵照片,然后使用身份映射对其进行微调。 然后,DNI可以通过对这两个模型进行插值来生成DoF的连续过渡。 我们还将DNI与像素插值进行了比较,其中由于重影伪影(例如,模糊的叶子边缘出现了半透明的细节)而导致结果看起来不自然。

DNI可以进一步应用于实现其他维度的连续图像转换,例如光线变化,即将白天的照片转换为夜间的照片。 仅受过白天和黑夜照片训练的DNI才能生成一系列图像,模拟夜晚的来临。 在图7c中,随着夜晚的临近,天色越来越暗,灯光逐渐照亮,反射在水面上。

4.3 图像风格转换

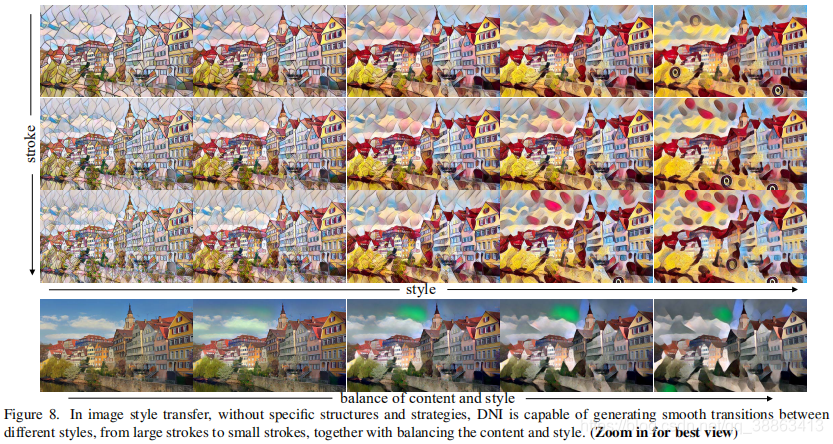

将一种或多种艺术品的样式转移到输入图像时,有几个可控因素,例如样式混合,笔画调整以及内容和样式的平衡。 一些现有的方法设计了特定的结构来实现对这些因素的连续控制[16]。 相反,DNI提供了通用的方法来实现相同的目标而无需特定的解决方案。 如图8所示,DNI能够在从大笔画到小笔画的不同样式之间生成平滑过渡,并平衡内容和样式。 此外,DNI可以应用于多个模型,以同时实现对各种因素的连续控制。 例如,可以根据用户的喜好同时调整笔触和样式,如图8所示。

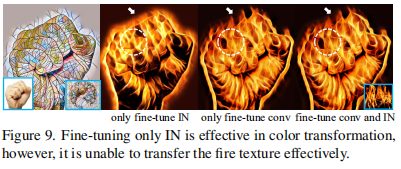

现有方法的另一个分支是通过插值实例规范化(IN)的参数来实现各种艺术风格的组合[6,12]。这些方法可以视为DNI的特例,其中仅对IN参数进行微调和插值。为了阐明DNI和IN插值之间的区别,我们使用3种设置进行实验:1)微调IN; 2)对卷积层进行微调,以及3)对IN和卷积层进行微调。具体来说,如图9所示,我们尝试了一项艰巨的任务,从生成具有马赛克样式的图像到具有火风格的图像(其中两种样式在颜色和纹理上看起来都非常不同)进行微调。可以看出,仅对IN进行微调在颜色转换中是有效的,但是与其他两个设置相比,它无法有效地传递火焰纹理。该观察结果表明,卷积层在样式建模中也起着重要作用,尤其是对于纹理而言,因为IN参数对于捕获空间信息可能无效。但是,由于IN在大多数情况下也有效,因此我们并不能声称DNI始终优于IN插值。还需要进行更彻底的研究以供将来工作。

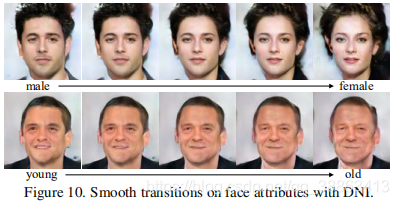

4.5 语义过渡

除了低级视觉任务外,我们还显示DNI也可以应用于面部属性的平滑过渡,这表明其可以进行语义调整。 我们首先使用具有一个属性(例如,年轻或男性)的CelebA [27]数据集训练DCGAN模型[30]。 之后,我们对其进行微调,以生成具有其他属性(例如,老年或女性)的人脸。 然后,通过对这些模型进行插值,DNI便可以生成一系列具有平滑变换属性的人脸(图10)。 尽管两个插值模型均未观察到任何具有中间属性的数据,但是处于中间状态的人脸具有中间属性并且看起来自然。

4.5 局限性

我们已经证明DNI提供了一种简单而通用的过渡操作方法。 但是,DNI也有局限性:1)需要微调或联合训练,否则插值模型就没有意义了; 2)如果两个(或几个)任务关系不大(即为不同任务训练的DNN),则插值模型将无法产生有意义的结果。 我们检查成功插值模型的相关指数,该指数在[0.689,1)中。 但是对于那些故障情况,相关指数非常小(<0.1)。 未来的工作将研究如何量化DNI的网络“距离”和任务“距离”

5.结论

在本文中,我们提出了一种在参数空间中进行插值的新颖概念,即在多个相关网络的相应参数之间应用线性插值。 调整插值系数时,图像效果平滑变化。 通过对超分辨率,降噪,图像到图像的转换和样式转换的大量实验,我们证明了所提出的方法尽管简单但仍适用于各种低级视觉任务。 与通过任务特定设计实现连续过渡的现有方法相比,我们的方法易于推广,而计算开销却可以忽略不计。 未来的工作将调查网络插值对高级任务的影响

致谢 这项工作得到了Sense Time Group Limited,中科院香港联合实验室,香港特别行政区研究资助局资助的普通研究基金(CUHK 14241716,14224316。14209217)和新加坡教育部AcRF Tier 1(M4012082)的支持。 020)。

参考文献