Python爬虫-2018年-我破解天眼查和启信宝企业数据爬虫--破解反爬技术那些事情

最近在自己用python+mongdb写了一套分布式多线程的天眼查爬虫系统,实现了对天眼查整个网站的全部数据各种维度的采集和存储,并且根据天眼查网页的数据结构建立了19个表来存储19个维度的数据,很多做技术的朋友在爬天眼查的时候会遇到以下几个问题,我把我的经历和解决方案分享给大家。(需要爬虫技术交流的朋友欢迎加我qq:2779571288)

1、天眼查和启信宝哪一个的数据更难爬呢?

其实在准备爬天眼查数据的时候,我对启信宝、企查查类似的网站分布从数据的完整性和数据的更新及时性分析了,结果个人觉得天眼查的数据比其他网站的要完整,数据维度要多一些,数据更新的时候也比较快,所以最后选择了爬取天眼查里面的企业数据

2、天眼查的19个核心数据维度:

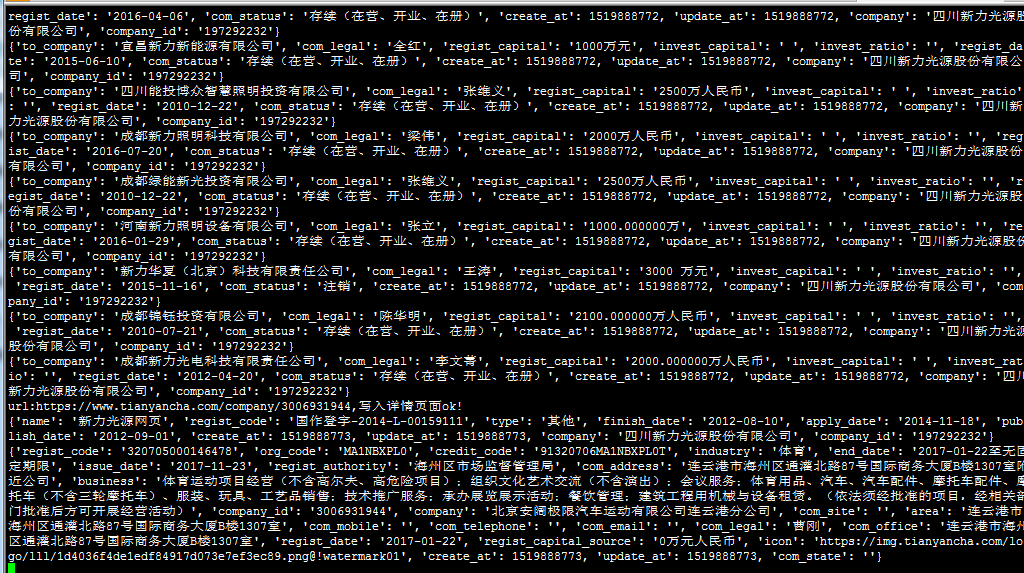

首先整个网站有主要核心数据有以下19大模块:1基本信息、2法人代表、3主要成员、4股东&出资、5变更记录、6公司年报、7司法风险、8舆情事件、9岗位招聘、10商品信息、11网站备案、12商标数据、13专利数据,、14 作品著作权软件著作权、16对外投资关系、17税务评级、18行政处罚、19进出口信用、20企业评级信用等十九个维度的企业数据,如果把这些数据爬下来,并且结构化,实现可以查询可以检索使用,可以导出到excel,可以生成企业报告,那么需要建立数据库来存储这些数据,像这种非结构化的数据我们选择mongdb数据库是最合适的。

3. 采集速度太频繁了,会被封IP问题 怎么解决

当我们发出去的http请求到天眼查网站的时候,正常情况下返回200状态,说明请求合法被接受,而且会看到返回的数据,但是天眼查有自己的一套反爬机制算法,如果检查到同一个IP来不断的采集他网站的数据,那么他会被这个IP列入异常黑名单,您再去采集它网站数据的时候,那么就永远被拦截了。怎么解决这个问题呢,其实很简单,没有错用代理IP去访问,每一次请求的时候都采用代理IP方式去请求,而且这个代理IP是随机变动的,每次请求都不同,所以用这个代理IP技术解决了被封的问题。

4 天眼查2个亿的数据量怎么存储?需要多少的代理IP

我在写爬虫去爬天眼查的时候,刚开始使用网上的免费或者收费的代理IP,结果90%都被封号,所以建议大家以后采集这种大数据量网站的时候 不要使用网上免费的或者那种收费的IP,因为这种ip几秒钟就会过期,意思就是你没有采集网或者刚刚访问到数据的时候,这个IP就过期了导致你无法采集成功,所以最后我自己搭建了自己的代理池解决了2个亿天眼查数据的采集封IP问题。(需要爬虫技术交流的朋友欢迎加我qq:2779571288)