文章目录

作为深度学习中非常重要的研究方向之一,卷积神经网络(CNN)的创新不仅表现在提升模型的性能上,还更进一步拓展了深度学习的应用范围。

具体来讲,CNN的创新架构和参数优化可以显著提高模型在各种任务上的性能。例如,深度CNN使用多个非线性特征提取阶段从数据中自动学习分层表征,从而在各种竞赛基准上取得了当前最优结果。另外,CNN的创新也推动了科学研究和实际应用的发展,其创新不仅局限于网络结构,还包括损失函数设计、分类器设计等多个方面。

一、基于CNNs的空间开发

1.1 LeNet

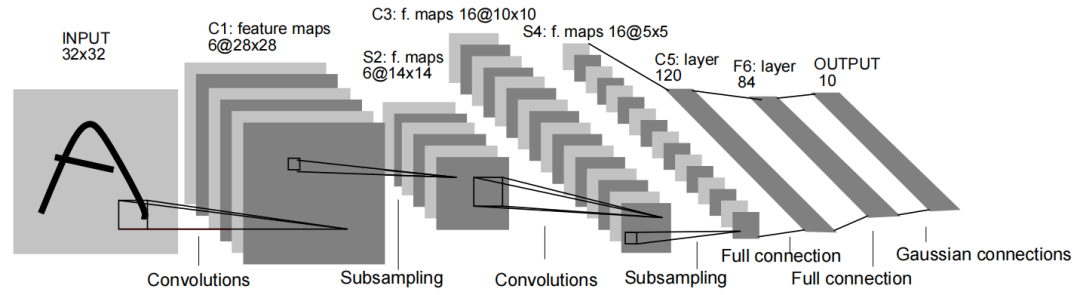

论文:Gradient-Based Learning Applied to Document Recognition

基于梯度学习的文档识别

「简述:」神经网络和基于梯度的学习算法是处理高维数据如手写字符和文档的有效方法。通过设计适当的网络结构和训练方法,可以合成复杂的决策表面来分类这些数据,而无需太多预处理。特别是卷积神经网络,它特别适合处理二维形状的变化,因此在手写字符识别等任务中表现最好。此外,图变换网络是一种新的训练范式,可以使多个模块组成的系统进行全局训练,以实现更高的性能。

1.2 Alexnet

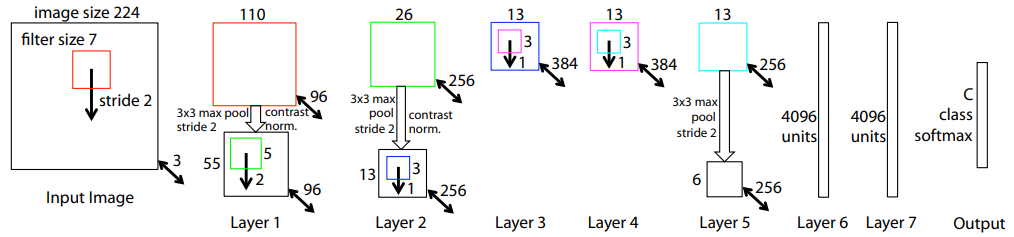

论文:ImageNet Classification with Deep Convolutional Neural Networks

使用深度卷积神经网络进行ImageNet分类

「简述:」作者训练了一个很大的深度卷积神经网络,用来把120万张高分辨率图片分成1000类。这个网络有6千万个参数和65万个神经元,包括五个卷积层、一些最大池化层和三个全连接层,最后是一个1000层的softmax。作者用非饱和神经元和高效的GPU实现来让它训练得更快,还用了称为“dropout”的新正则化方法来防止过拟合。这个模型在ILSVRC-2012竞赛中获得了top-5错误率为15.3%的好成绩,而第二名的错误率是26.2%。

1.3 ZfNet

论文:Visualizing and Understanding Convolutional Networks

可视化和理解卷积网络

「简述:」大型卷积神经网络模型在ImageNet基准测试中表现出色,但原因和改进方式不明确。本文通过一种新的可视化技术,让我们了解特征层和分类器的工作方式,并找到更好的模型架构。作者还研究了不同模型层对性能的贡献,发现模型可以很好地推广到其他数据集。当重新训练分类器时,它在Caltech-101和Caltech-256数据集上取得了最佳成绩。

1.4 VGG

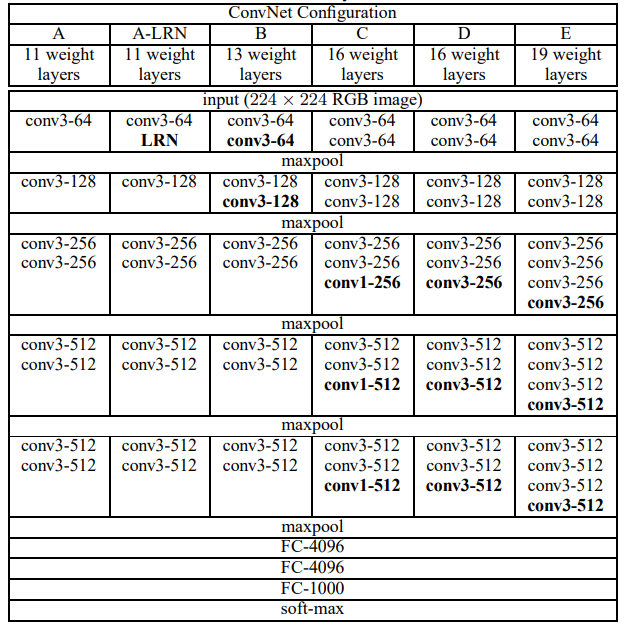

论文:VERY DEEP CONVOLUTIONAL NETWORKS FOR LARGE-SCALE IMAGE RECOGNITION

用于大规模图像识别的非常深的卷积网络

「简述:」本文研究了卷积神经网络深度对其在大规模图像识别设置中的准确性的影响。作者的主要贡献是使用具有非常小的(3×3)卷积滤波器的架构对增加深度进行全面的评估,表明通过将深度推到16-19个权重层可以对先前的艺术配置进行重大改进。

1.5 GoogleNet

论文:Going deeper with convolutions

深入探索卷积神经网络

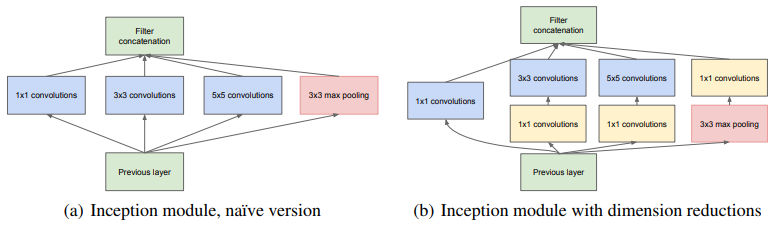

「简述:」论文提出了一个名为Inception的深度卷积神经网络架构,它打破了ImageNet大规模视觉识别挑战赛中的分类和检测纪录。这个架构的特点是更有效地利用了网络内部的计算资源。通过精心设计,我们可以在保持计算预算不变的同时增加网络的深度和宽度。这个架构的设计基于Hebbian原理和多尺度处理的直观性,以提高质量。在ILSVRC14挑战赛中,作者使用了一种特定变体,称为GoogLeNet,这是一个22层深的网络,其分类和检测效果都非常出色。

二、基于深度的CNNs

2.1 Highway Networks

论文:Highway Networks

高速神经网络

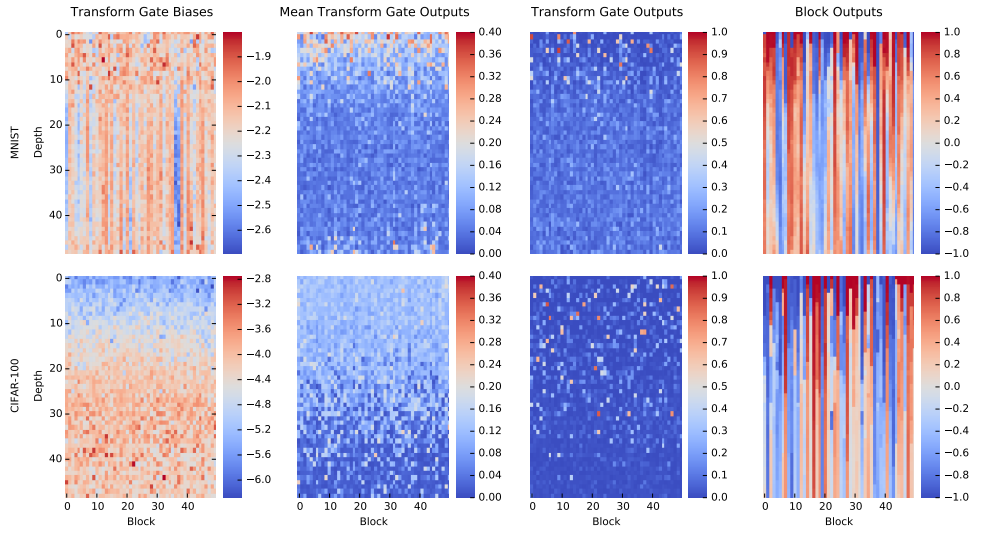

「简述:」神经网络的深度对其成功至关重要,但训练深度增加会变得更难。论文介绍了一种新架构,称为高速神经网络,旨在简化深度网络的训练。这种网络允许信息在多层次之间顺畅流动,由门控单元调节。这种架构允许使用随机梯度下降法直接训练数百层网络,并使用各种激活函数,从而开辟了研究深度高效网络的可能性。

2.2 ResNet

论文:Deep Residual Learning for Image Recognition

用于图像识别的深度残差学习

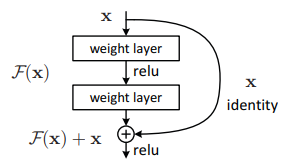

「简述:」本文介绍了一种名为残差学习框架的方法,可以更容易地训练深度神经网络。通过重新定义层为学习残差函数,这些网络可以更优化且具有更高的准确性。在ImageNet数据集上,评估了深度达152层的残差网络,并获得了第一名。此外,作者还对CIFAR-10进行了分析。该方法的深度表示对于许多视觉识别任务非常重要,并在COCO对象检测数据集上获得了28%的相对改进。

2.3 Inception V4

论文:Inception v4, Inception-ResNet and the Impact of Residual Connections on Learning

Inception v4、Inception-ResNet和残差连接对学习的影响

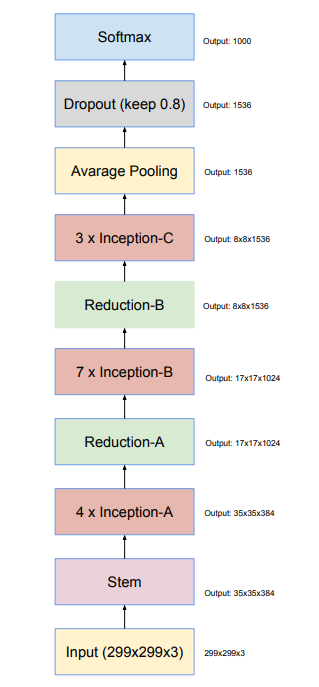

「简述:」深度卷积神经网络和Inception架构在图像识别方面有很大进步。使用残差连接可以加速Inception网络的训练并提高性能。新型流线型架构可提高识别性能,适当的激活缩放有助于稳定训练。通过集成三个残差架构和一个Inception-v4,作者在ImageNet挑战的测试集上实现了3.08%的top-5错误率。

2.4 ResNext

论文:Aggregated Residual Transformations for Deep Neural Networks

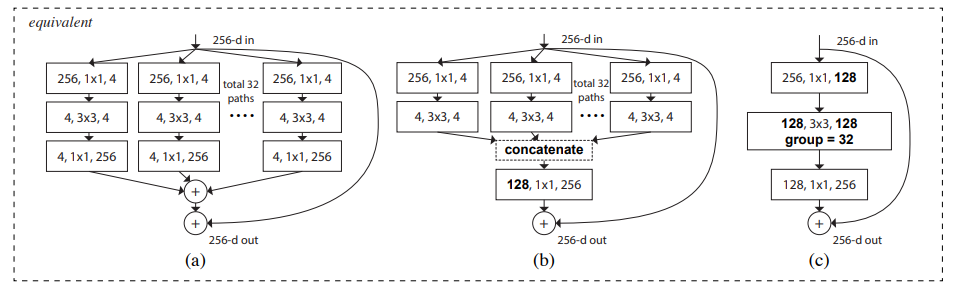

深度神经网络的聚合残差变换

「简述:」本文介绍了一种简单、高度模块化的用于图像分类的网络架构。该网络通过重复一组具有相同拓扑的变换来构建,形成一个同构的多分支架构,只需要设置很少的超参数。在ImageNet-1K数据集上,作者发现增加基数能够提高分类准确性。该模型名为ResNeXt,在ILSVRC 2016分类任务中获得了第二名。作者还进一步研究了ResNeXt在ImageNet-5K集和COCO检测集上的表现,也显示出比其对应的ResNet更好的结果。