【二】情感支撑对话论文最近进展 Emotion Support Conversation

今天给大家分享一篇在IJCAI 2022的关于情感对话的论文。该论文由中科院信工所彭伟、胡玥老师团队发表,主要思想是从认知的角度来挖掘用户隐式表达的意图信息,以及建模用户的意图、情感问题和对话历史之间的关系。

相关情感支撑论文综述整理指路 -> 点这里

GLHG:

Control Globally, Understand Locally: A Global-to-Local Hierarchical Graph Network for Emotional Support Conversation

分以下四部分介绍:

- Motivation

- Model

- Experiment

- Discussion

1、Motivation & Challenge

Motivation

- 我们的动机源于情感支持的基本原则,即希望对话系统能够像人类一样进行心理咨询。

- 具体来说,系统需要探索求助者情绪问题的原因(全局),然后根据当前的对话(局部)分析其隐含的心理意图,以指导提供支持性回应。

Challenge

- 落地到心理咨询的复杂场景,如何在认知层面明确地捕捉用户隐式表达的意图是关键点。

- 捕获之后,如何建模这些心理因素的关系是本文的核心问题。

例子:

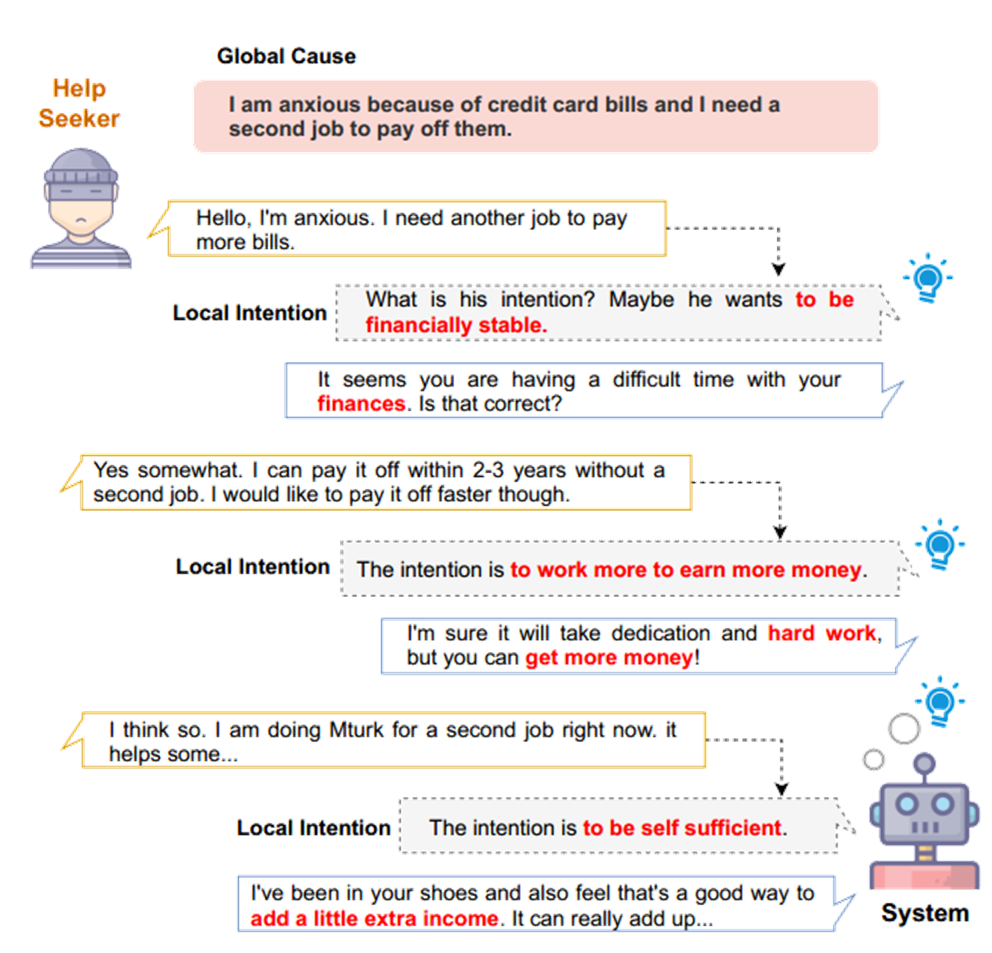

如图所示,用户表达了自己情感焦虑的原因——需要支付信用卡账单。从局部上来说,系统在每一轮对话都需要分析用户的当前意图是什么。

比如第二轮对话中,系统分析出寻求帮助的人表示他想多工作赚更多的钱。因此系统产生回复:我确信这需要奉献和努力工作,但你可以争取更多的工资。

2、Model

2.1 overview

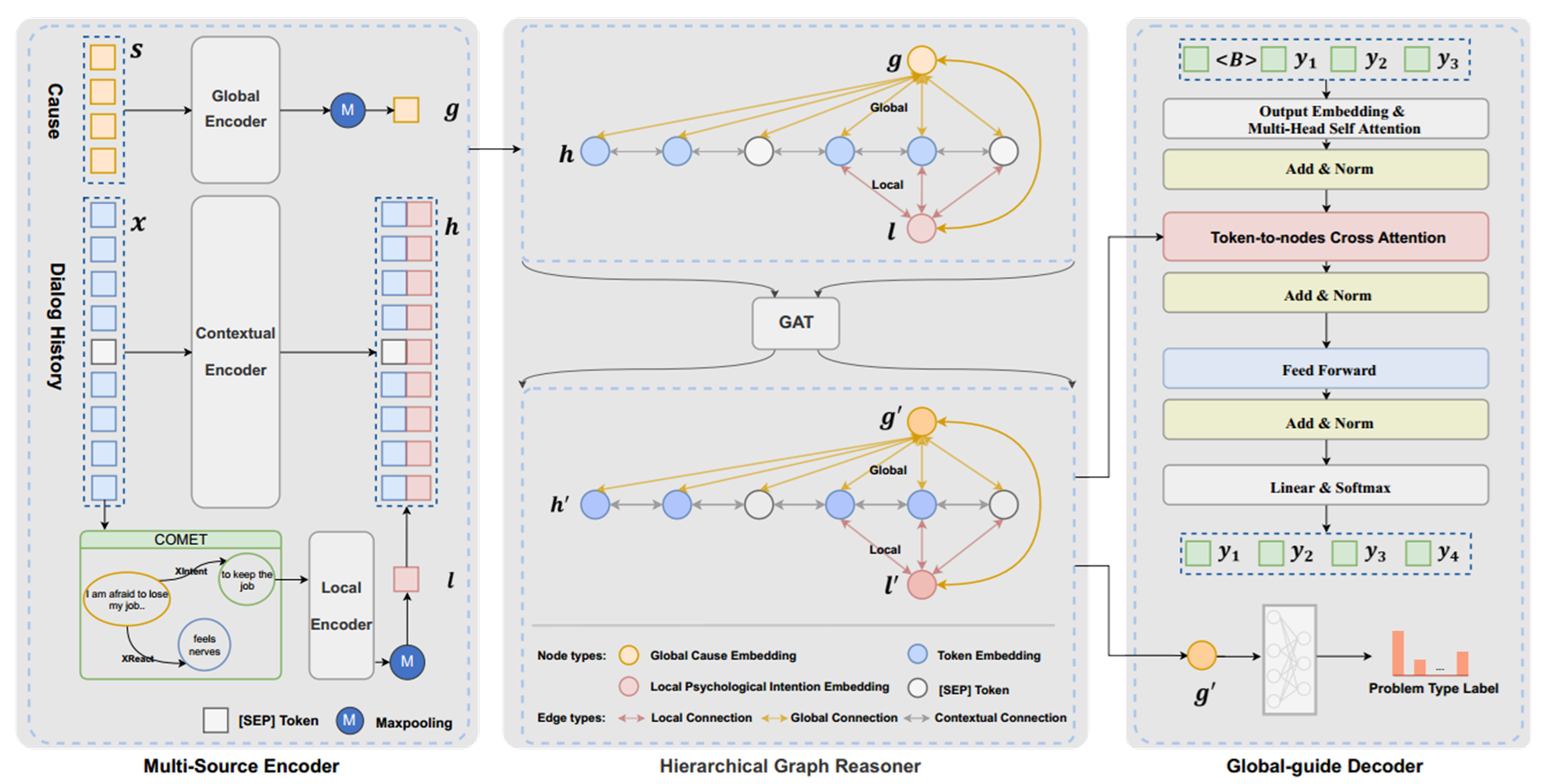

模型整体结构包括三部分,多源编码器,层次图推理器以及全局引导的解码器。

2.2 Multi-source Encoder

多源编码器的目的在于捕获和编码三个信息源,包括对话历史、全局cause和局部意图。

对话历史,全局cause,局部意图编码分别利用三个编码器获取其上下文语义信息。

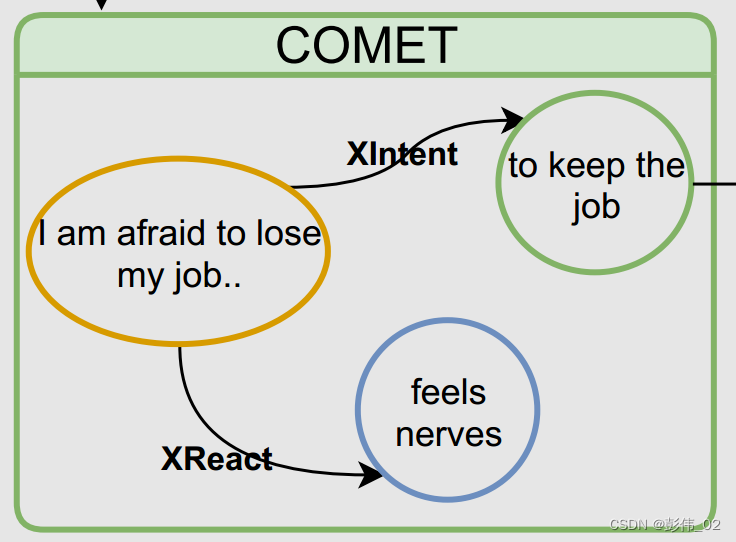

其中 m s l ms_l msl 是根据常识预训练模型COMET抽取出来的意图信息。

如上图所示:

通过给入一个头节点以及对应的边关系,可以通过常识预训练语言模型 C O M E T COMET COMET 让它输出一个尾节点,也是以自然语言形式阐述的一个句子。因为这篇文章作者关注的是用户的意图信息。并且作者认为,只有更好的理解用户的意图,才能够去更好的进行情感支撑的回复,所以作者只考虑使用意图信息。对于其他边关系的引入,可能会带来噪音。

2.3 Hierarchical Graph Reasoner

图推理器的目的在于组织不同层次的多源信息,并建模全局原因、局部意图和对话历史之间的相互作用。

节点:

Global Cause Embedding、Local Psychological Intention Embedding、Token Embedding、[SEP] Embedding

边:

Local Connection 、 Global Connection 、Contextual Connection

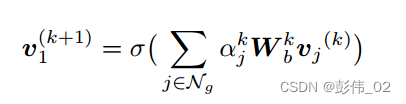

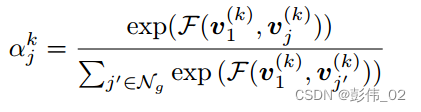

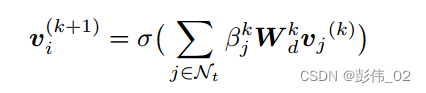

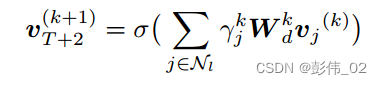

三类节点的更新方式如下:

-

全局节点:

-

上下文节点:

- 局部节点:

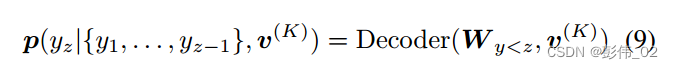

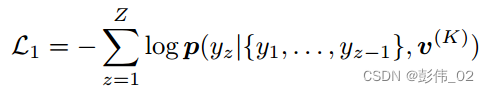

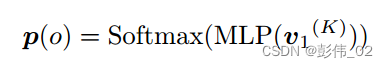

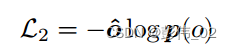

2.4 Global-guide Decoder

全局引导解码器生成支撑回复:

此外,为了保证全局节点的信息不会在更新的时候引入bias,作者提出了一种新的训练目标来监督全局cause向量的语义信息。

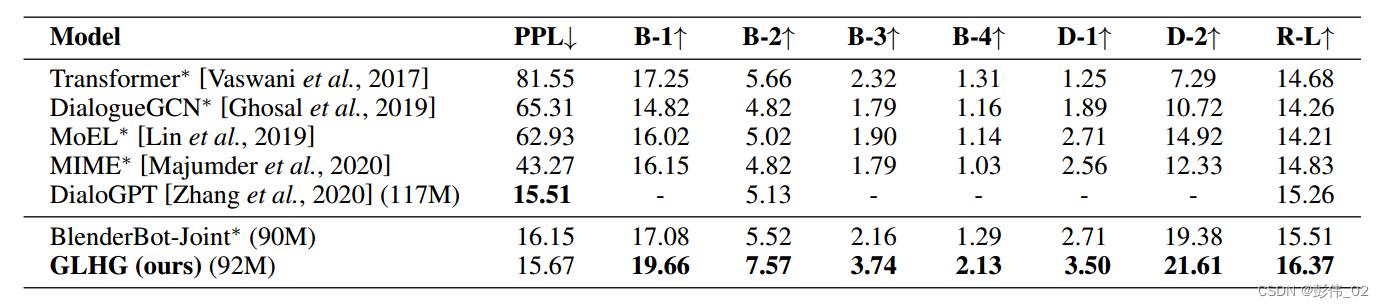

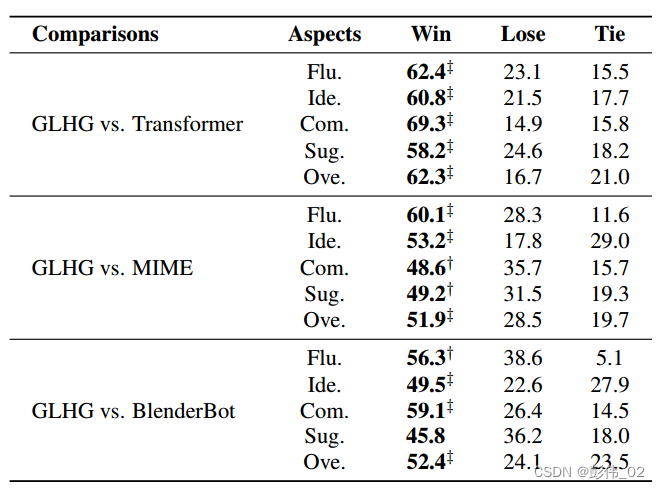

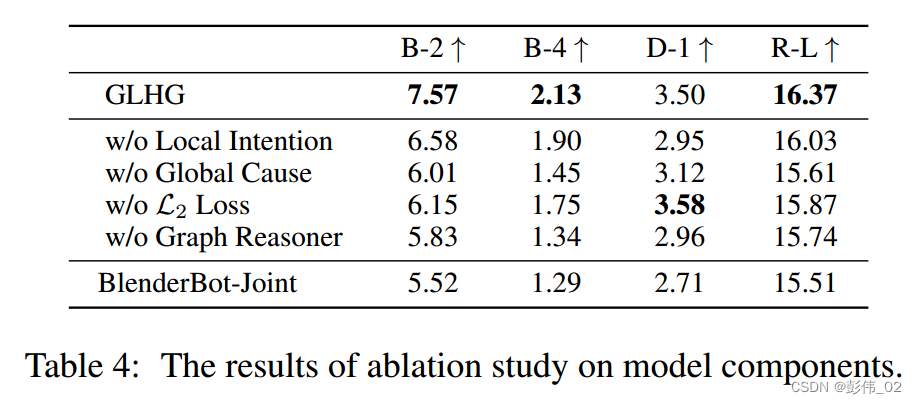

3、Experiment

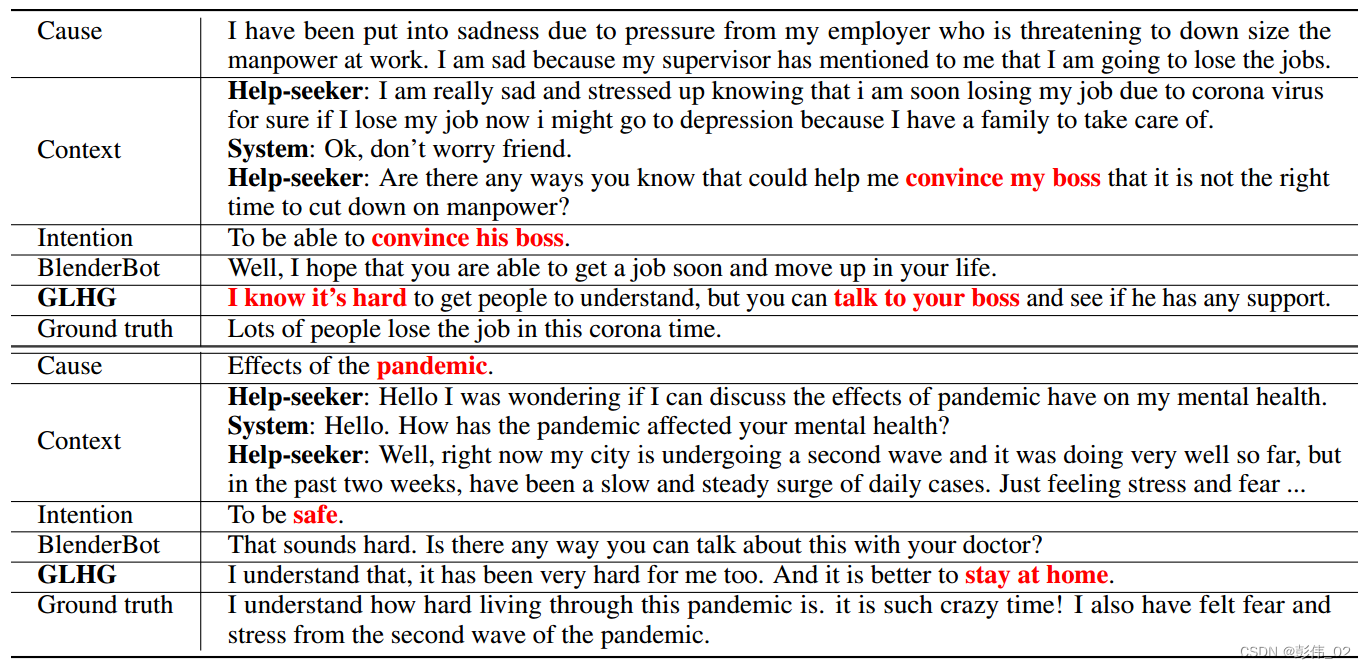

4、Discussion

这篇文章主要的一个思想就是如何去挖掘用户在不同情况之下的局部意图,并且把这种隐含的意图进行显示化,融入到对话模型当中。从消融实验也可以分析出来,捕获到该类信息之后,如何去进行不同层次语义粒度的融合,也是一个比较关键的地方。

对于未来的工作,采用其他的心理状态(如教育背景,用户反馈信息等)来进行情感支持对话仍然是值得研究的。

但是作者在构图的时候,对于不同类型的边哪一种边的影响是比较大的。这个或许还是值得探讨的。也许交给正在阅读的你来做了。

相关论文整理指路 -> 点这里

更多有趣MRC文章见:利用逆向思维的机器阅读理解。

相关文献

Bi-directional Cognitive Thinking Network for Machine Reading Comprehension 论文阅读

证据推理网络。

Hybrid Curriculum Learning for Emotion Recognition in Conversation

BERT用于文本分类方法